终结多智能体视觉幻觉“滚雪球”!新国立等提出ViF:无需改造模型,即插即用

终结多智能体视觉幻觉“滚雪球”!新国立等提出ViF:无需改造模型,即插即用基于视觉语言模型(VLM)的多智能体系统(MAS)正成为复杂多模态协作的核心方案,却被一个致命痛点死死卡住:多智能体视觉幻觉滚雪球——单个智能体的视觉误判通过纯文本信息流逐级放大,早期细微错误最终演变成系统性崩溃。

搜索

搜索

基于视觉语言模型(VLM)的多智能体系统(MAS)正成为复杂多模态协作的核心方案,却被一个致命痛点死死卡住:多智能体视觉幻觉滚雪球——单个智能体的视觉误判通过纯文本信息流逐级放大,早期细微错误最终演变成系统性崩溃。

Claude 4.7才刚发布就遭全网吐槽:太拉跨了!价格贵了50%,却更懒更爱撒谎,做计算密集型任务时充满了不易察觉的危险幻觉。老用户集体崩溃了:快还我4.6!

一个在 AI 社区广泛流传的架构思路,正在让大量团队走弯路。

已经记不清这是第几次,有网友爆出来 Claude 降智了,思考深度下降 67%,Opus 幻觉加深。关键是能力变弱和可靠性降低的同时,我们的 Token 使用还增加了。 网友们在社交媒体上抱怨,「过去

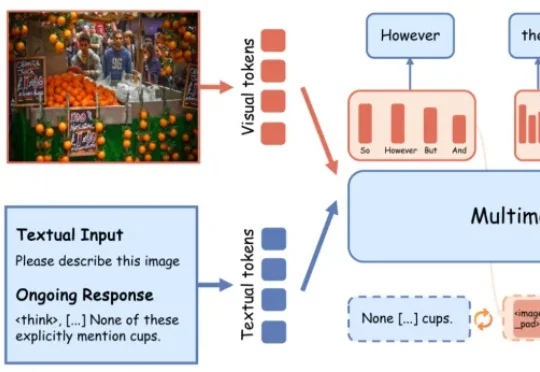

多模态大推理模型的幻觉,很多时候并非「没看见」,而是在最不确定的推理阶段想偏了。最新研究发现,模型在生成because、however、wait等transition words时,往往处于高熵关键节点,更容易脱离图像证据、转向语言脑补。LEAD在高熵阶段不急于输出单一离散token,而是先在潜在语义空间保留多种候选推理方向,并通过视觉锚点持续拉回图像证据,显著缓解幻觉。

AI圈的节奏已经快到让人产生幻觉了。

2亿美元A轮融资,估值110亿,成立仅一年就成为独角兽。更震撼的是创始人——25岁的广州00后洪乐潼,父母是从未上过大学的普通务工者。她用数学解决AI最大的痛点:让模型推理步步可验证,彻底杜绝幻觉。为了加入她,弗吉尼亚大学终身教授直接辞职。

你以为AI答错就一定是幻觉?不,它也可能是在故意骗你。

AI最强幻觉,原来不是不会,而是太会「装会」。 「你是专家」这句咒语,可能骗了整个AI圈一年。

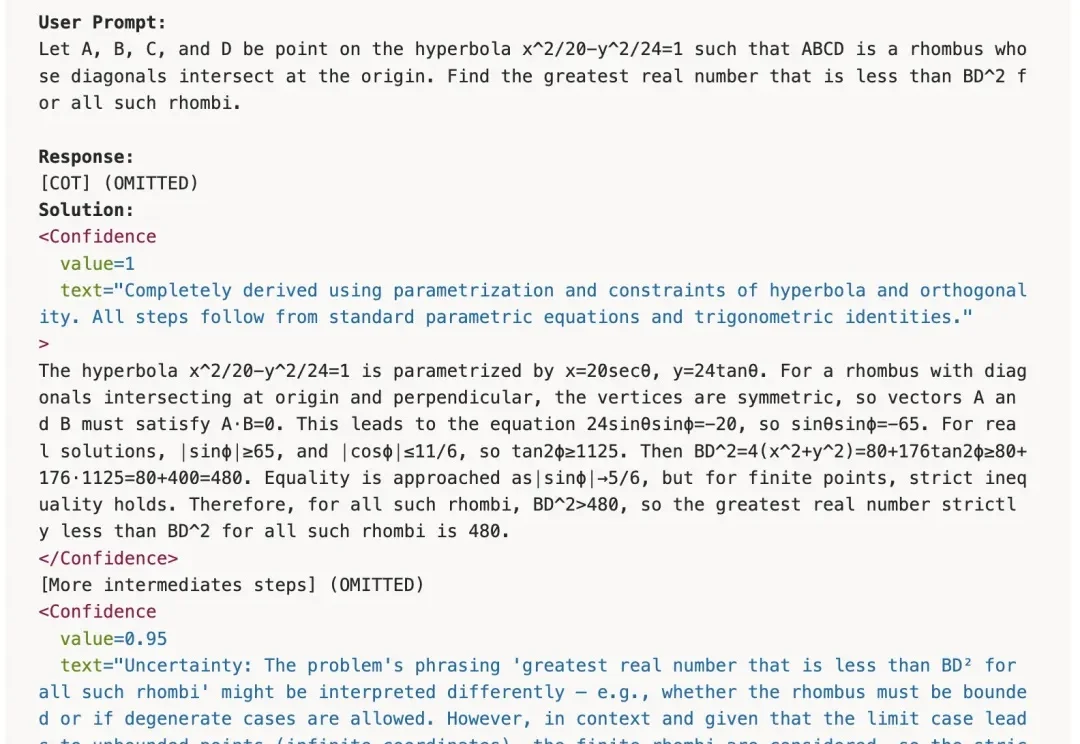

大语言模型(LLM)的幻觉问题一直是阻碍其在关键领域部署的核心难题。近日,研究人员提出了一种名为行为校准强化学习(Behaviorally Calibrated Reinforcement Learning)的新方法,通过重新设计奖励函数,让模型学会「知之为知之,不知为不知」。