大佬深度解析:Coding Agent的底层运行逻辑是什么?

大佬深度解析:Coding Agent的底层运行逻辑是什么?在本文中,我将探讨编码智能体(coding agents)及其智能体编排(agent harnesses)的整体设计:它们究竟是什么、工作原理如何,以及在实际应用中各组件是如何协同运作的。

搜索

搜索

在本文中,我将探讨编码智能体(coding agents)及其智能体编排(agent harnesses)的整体设计:它们究竟是什么、工作原理如何,以及在实际应用中各组件是如何协同运作的。

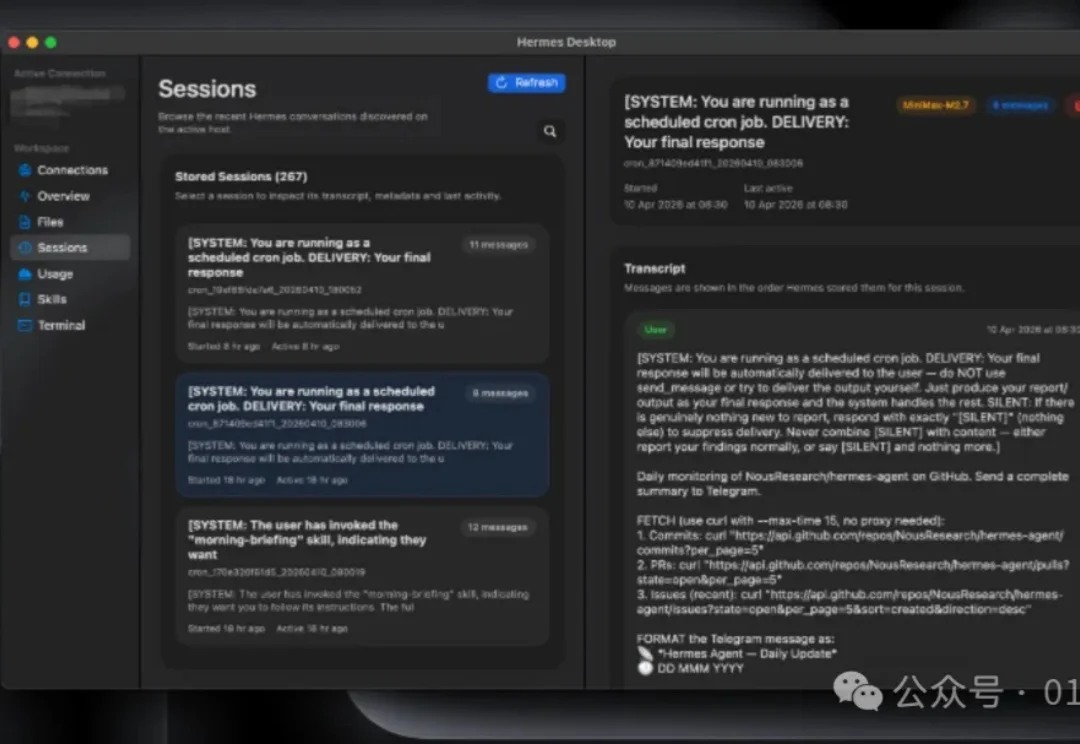

对于已经在使用强大的 Hermes Agent 的 Mac 用户来说,现在有了一款能让您的工作流更加流畅、更具原生体验的工具——Hermes Desktop。它并非一个简单的浏览器封装,而是一款专为 macOS 设计的本地应用程序,旨在将您最关心的工作流程无缝集成到一个窗口中。

Factory 发布桌面端应用,让自治 AI 代理(Droids)直接在你的电脑上操控 VS Code、浏览器、终端和 Excel——官方原话是「像你一样操作你的电脑」。多代理并行、持久化机器、本地模型部署一步到位,官方称企业团队采用速度翻倍、会话量暴涨 4.6 倍。发布推文 21 万人围观,近 900 人点赞。

近日,上海人工智能实验室联合南京大学、香港中文大学及上海交通大学,将OpenClaw的成功应用于多模态生成领域。他们提出GEMS(Agent-Native Multimodal Generation with Memory and Skills),激发小模型潜力,甚至让6B小模型在部分任务超越了Nano Banana 2。

近日,支付宝开始内测一款名为AClaw的“AI龙虾”小程序。如今,支付宝搜索“龙虾”,结果页除了满屏的外卖推荐,服务一栏里还会出现AClaw的身影。根据官方介绍,AClaw是一个基于当前热门AI Agent框架OpenClaw的Agent类应用。

总部位于首尔的 Wrtn Technologies 表示,该公司通过为韩国和日本的硬核动漫和游戏粉丝运营 AI 故事讲述应用,每月产生超过 800 万美元的收入。Wrtn(发音为"written")即将以一款名为 OOC("out of character"的缩写)的类似应用扩展到美国市场,这是龙与地下城角色扮演游戏中的常用术语。

许多长期与文字和代码打交道的创作者,应该对 Obsidian 这款软件并不陌生。作为目前全球最具影响力的本地化 Markdown 笔记应用之一,它凭借独树一帜的知识图谱和开源生态,在知名度与用户忠诚度上,已然能与 Notion 分庭抗礼。

过去 3 年多时间里,从能云录制生成纪要,AI小助手做纪要总结,到元宝纪要再到 AI 托管,它一直在往会议流程里加入 AI 能力。近日,腾讯会议智能录制再次做了一次全面升级。我们深度体验后,和大家分享一手的体验和观察。

刚刚,Ilya Sutskever 又拿了一个奖:美国国家科学院科学工业应用奖。获得奖金 2.5 万美元。值得注意的是,这也是该奖项首次被颁发给 AI 领域。

Tanay Jaipuria 本周写了一篇很有意思的文章,核心论点只有一句话:每家 AI 应用公司最终都会垂直整合,变成全栈公司。