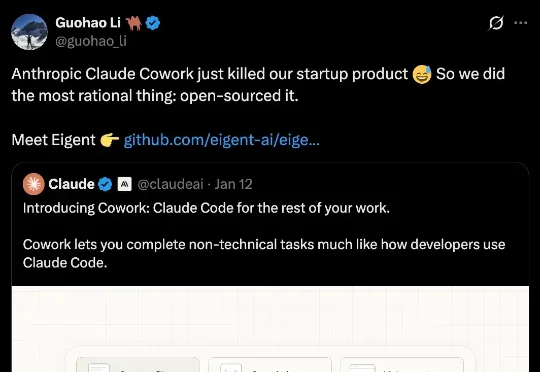

开源版 Cowork 项目在 X 爆火,创始人:感谢 Cowork,让我们三年的探索被看到

开源版 Cowork 项目在 X 爆火,创始人:感谢 Cowork,让我们三年的探索被看到CAMEL AI 早前的一个开源项目 Eigent,因为和 Cowork 高度相似,作为开源平替,也跟着火了一把。 这条帖子爆火后,CAMEL AI 团队复盘了他们从 2023 年发布 CAMEL 框架开始,到 Eigent 项目的三年探索经历。

搜索

搜索

CAMEL AI 早前的一个开源项目 Eigent,因为和 Cowork 高度相似,作为开源平替,也跟着火了一把。 这条帖子爆火后,CAMEL AI 团队复盘了他们从 2023 年发布 CAMEL 框架开始,到 Eigent 项目的三年探索经历。

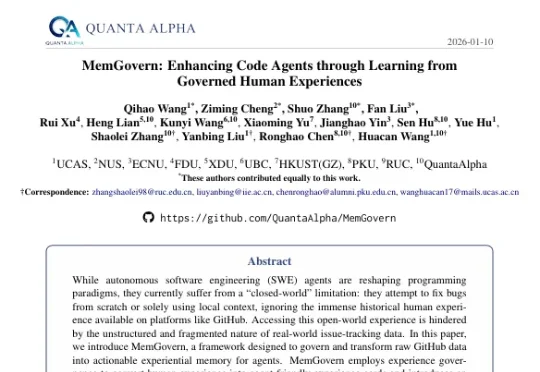

MemGovern团队 投稿 量子位 | 公众号 QbitAI 人类程序员碰到棘手bug通常会上网查询前辈经验。 当前AI虽然开始具备联网搜索能力,但仍不能很好地从网络经验中获取修复bug的能力。 让

最近,一篇由中国团队领衔全球24所TOP高校机构发布,用于评测LLMs for Science能力高低的论文,在外网炸了!当晚,Keras (最高效易用的深度学习框架之一)缔造者François Chollet转发论文链接,并喊出:「我们迫切需要新思路来推动人工智能走向科学创新。」

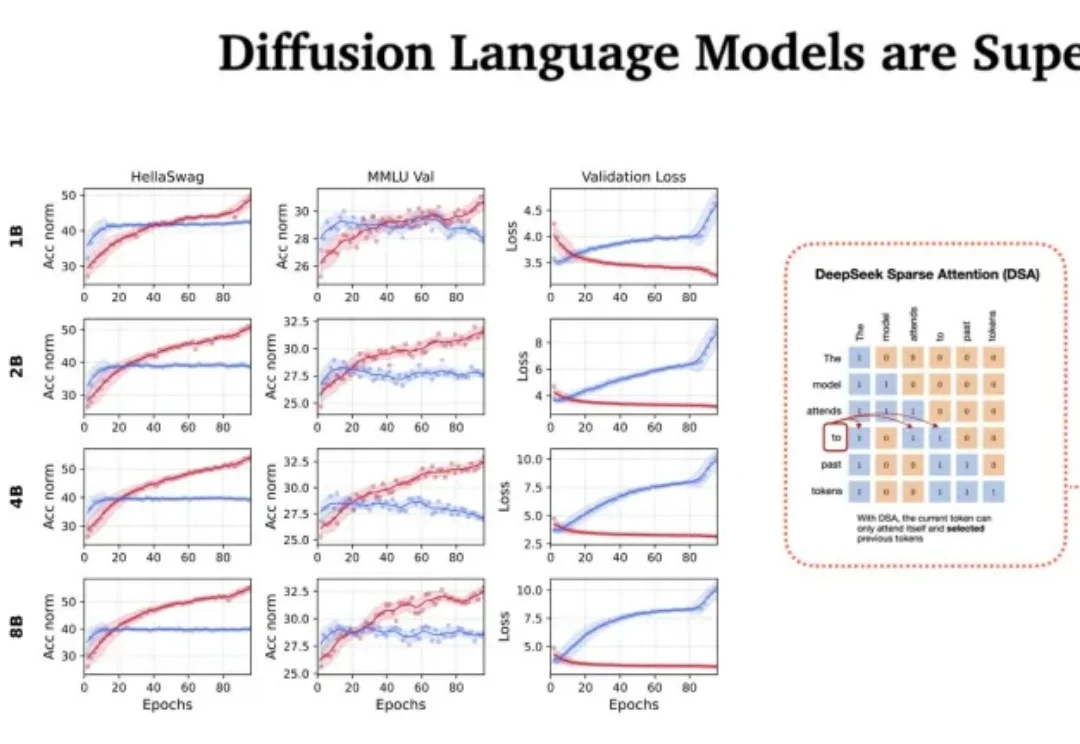

站在 2026 年的开端回望,LLM 的架构之争似乎进入了一个新的微妙阶段。过去几年,Transformer 架构以绝对的统治力横扫了人工智能领域,但随着算力成本的博弈和对推理效率的极致追求,挑战者们从未停止过脚步。

今天,首个在国产芯片上完成全程训练的SOTA(最佳水平)多模态模型开源。这是智谱联合华为开源的图像生成模型GLM-Image。从数据到训练的全流程,该模型完全基于昇腾Atlas 800T A2设备和昇思MindSpore AI框架完成构建。

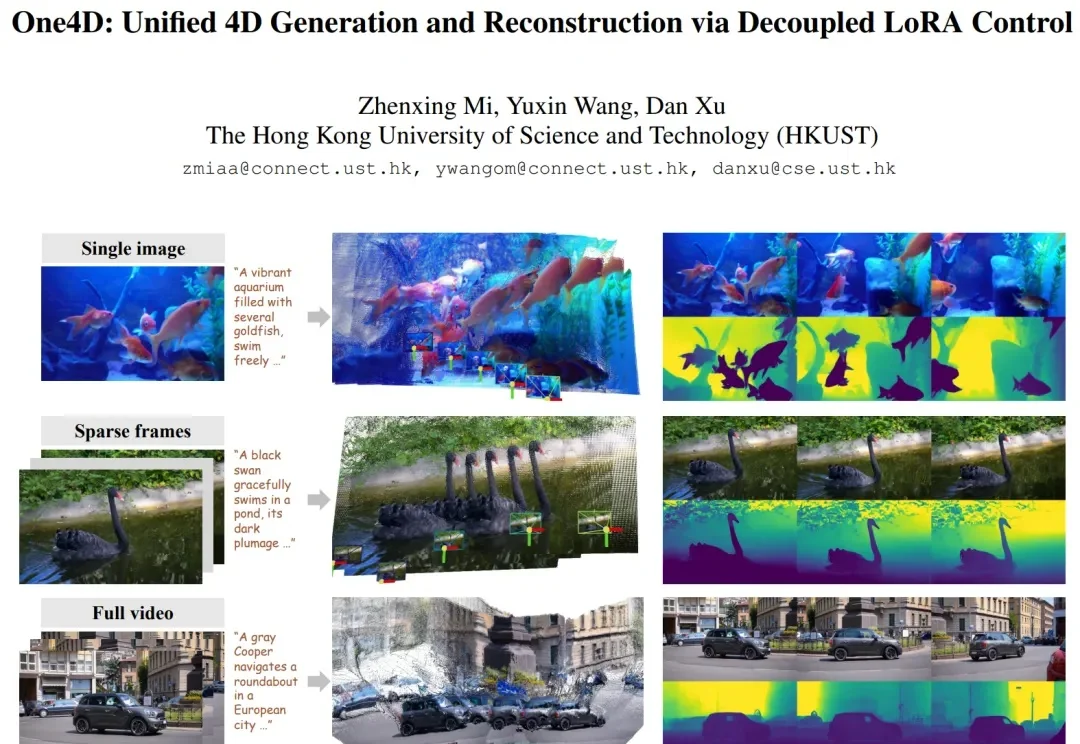

近年来,视频扩散模型在 “真实感、动态性、可控性” 上进展飞快,但它们大多仍停留在纯 RGB 空间。模型能生成好看的视频,却缺少对三维几何的显式建模。这让许多世界模型(world model)导向的应用(空间推理、具身智能、机器人、自动驾驶仿真等)难以落地,因为这些任务不仅需要像素,还需要完整地模拟 4D 世界。

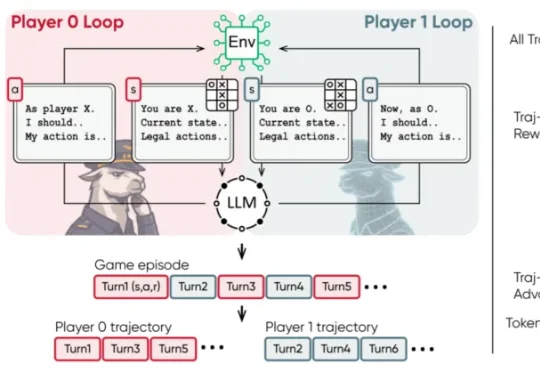

近日,清华大学等机构的研究团队提出了 MARSHAL 框架。该框架利用强化学习,让大模型在策略游戏中进行自博弈(Self-Play)。实验表明,这种多轮、多智能体训练不仅提升了模型在游戏中的博弈决策水

前端生态最具影响力的开源项目之一 Tailwind CSS,正经历一场罕见的生存压力测试。

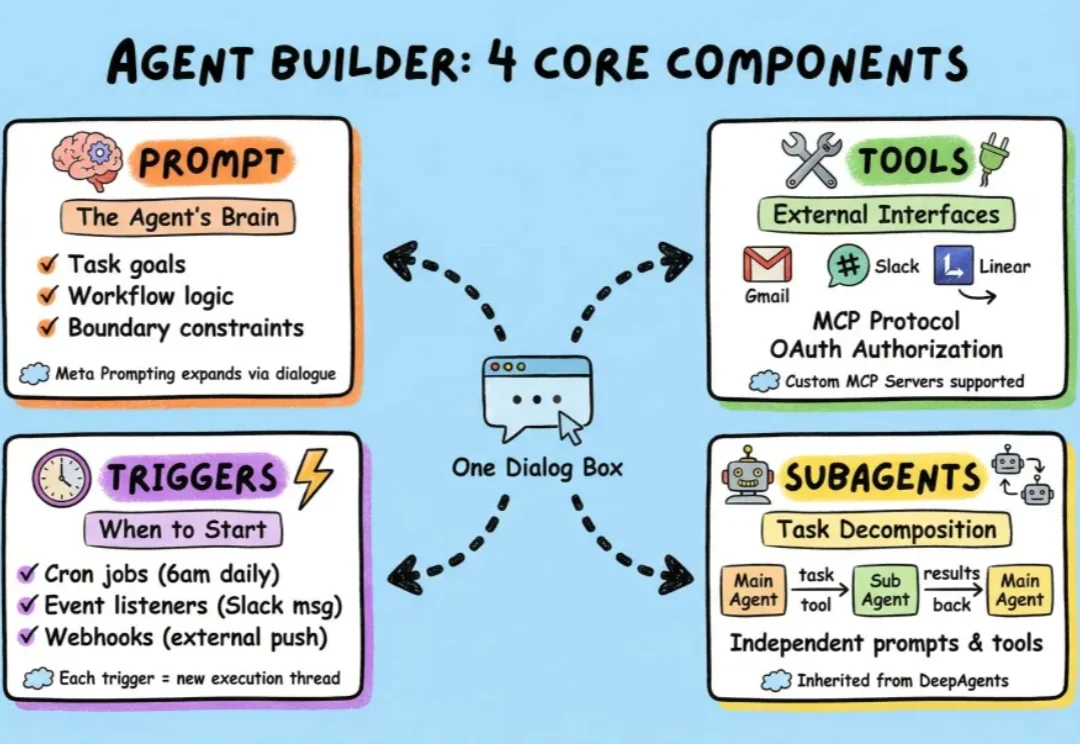

过去一段时间,我们介绍了很多小白入门级的agent框架,也介绍了包括langchain在内的很多专业级agent搭建框架。

现实世界不是 demo,人形机器人该如何进入真实世界?