全网AI看不到的爱心,被这款开源全模态模型攻克了。。

全网AI看不到的爱心,被这款开源全模态模型攻克了。。昨天一大早,就发现美团开源了他们首款全模态实时交互大模型:LongCat-Flash-Omni。

昨天一大早,就发现美团开源了他们首款全模态实时交互大模型:LongCat-Flash-Omni。

是孩子该看的东西。

当下的文本生成图像扩散模型取得了长足进展,为图像生成引入布局控制(Layout-to-Image, L2I)成为可能。

Transformer 语言模型具有单射性,隐藏状态可无损重构输入信息。

Qwen 团队终于在周日的晚上, 兑现了本周会更新Qwen3-Max thinking 的承诺。 而这个更新, 基本也是上周所有更新中为数不多非常期待的了。 毕竟Qwen3-Max也是Qwen整个家族里最大、最强的模型,

当用户向大语言模型提出一个简单问题,比如「单词 HiPPO 里有几个字母 P?」,它却正襟危坐,开始生成一段冗长的推理链:

从豆包的「产品卡」里,可以窥见大模型对产品销售的新链路已经展开。

传统智能体系统难以兼顾稳定性和学习能力,斯坦福等学者提出AgentFlow框架,通过模块化和实时强化学习,在推理中持续优化策略,并使小规模模型在多项任务中超越GPT-4o,为AI发展开辟新思路。

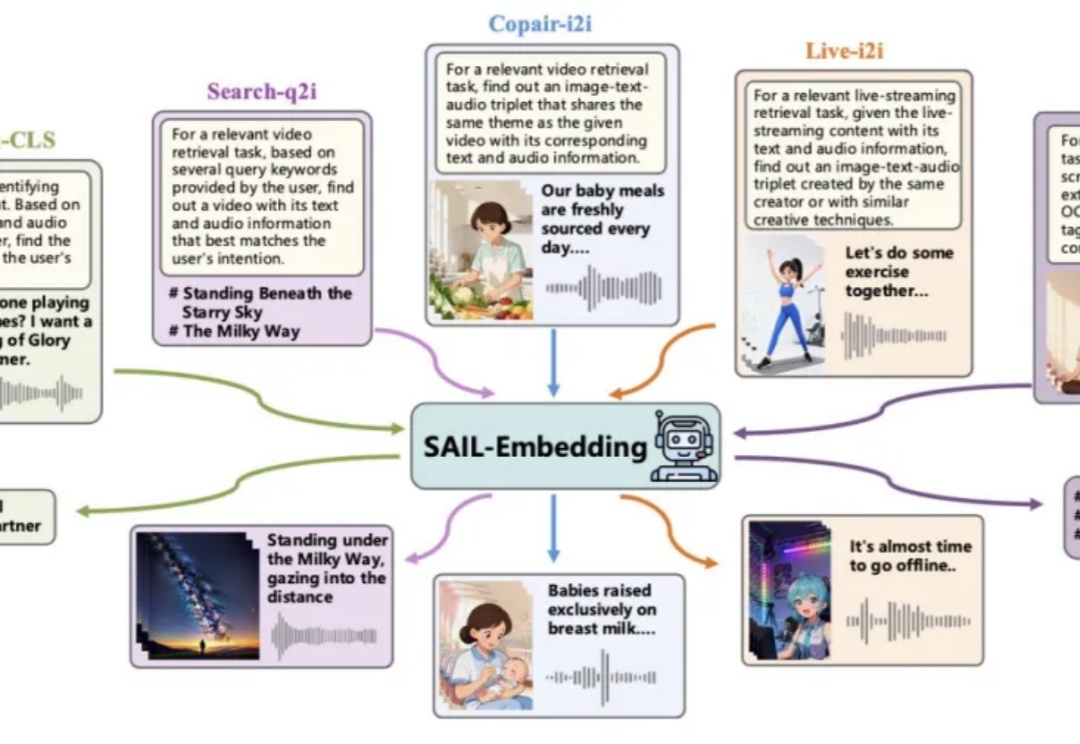

在短视频推荐、跨模态搜索等工业场景中,传统多模态模型常受限于模态支持单一、训练不稳定、领域适配性差等问题。

据《智能涌现》获悉,极佳视界近日完成新一轮亿元级A1轮融资,本轮融资由华为哈勃、华控基金联合投资。此前8月底,极佳视界宣布完成Pre-A&Pre-A+连续两轮数亿元融资。2个月3轮融资,体现了资本市场对极佳视界团队实力、技术路线和业务推进的认可,也折射出投资方对“物理世界通用智能”(物理AI)关键转折点的判断。