RAG还是微调?微软出了一份特定领域大模型应用建设流程指南

RAG还是微调?微软出了一份特定领域大模型应用建设流程指南检索增强生成(RAG)和微调(Fine-tuning)是提升大语言模型性能的两种常用方法,那么到底哪种方法更好?在建设特定领域的应用时哪种更高效?微软的这篇论文供你选择时进行参考。

搜索

搜索

检索增强生成(RAG)和微调(Fine-tuning)是提升大语言模型性能的两种常用方法,那么到底哪种方法更好?在建设特定领域的应用时哪种更高效?微软的这篇论文供你选择时进行参考。

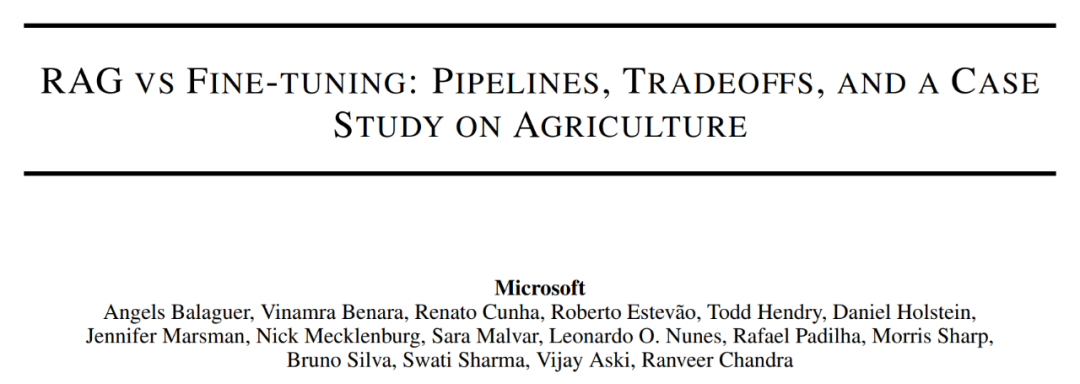

状态空间模型正在兴起,注意力是否已到尽头?

就在十几个小时之前,OpenAI再一次放出大招,发布了一个有望改变世界的产品,那就是文字生成视频的Sora模型。

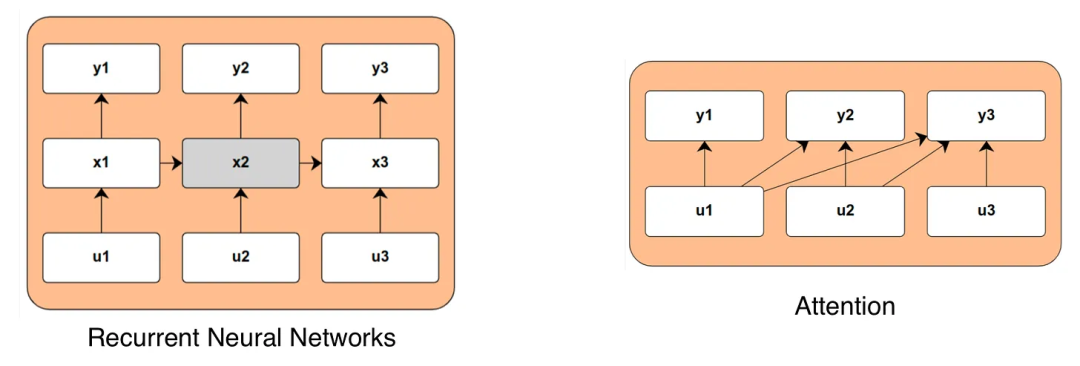

为了应对大模型不断复杂的推理和训练,英伟达、AMD、英特尔、谷歌、微软、Meta、Arm、高通、MatX以及Lemurian Labs,纷纷开始研发全新的硬件解决方案。

近日,北大、斯坦福、以及Pika Labs发布了新的开源文生图框架,利用多模态LLM的能力成功解决文生图两大难题,表现超越SDXL和DALL·E 3

Karpathy力推代码生成任务增强流程,让GPT-4在CodeContests从19%提升到44%,不用微调不用新数据集训练,让大模型代码能力大幅提升。

OpenAI发布了首个AI视频模型Sora,该模型能够根据文字指令生成逼真且充满想象力的视频,且能够生成长达1分钟的连贯视频。通过提供多帧预测,Sora实现了一镜到底的效果。

Stability AI 作为文本到图像的「元老」,不仅在引领该领域的潮流方向,也在模型质量上一次次进行新的突破,这次是性价比的突破。

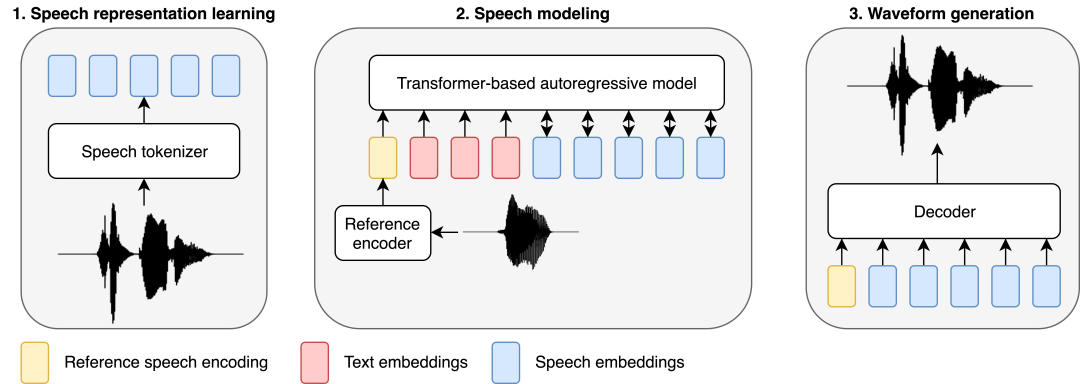

伴随着生成式深度学习模型的飞速发展,自然语言处理(NLP)和计算机视觉(CV)已经经历了根本性的转变,从有监督训练的专门模型,转变为只需有限的明确指令就能完成各种任务的通用模型

奥特曼称,OpenAI计划将部分大模型开源,还谈到了GPT-5。他称人工智能将“像手机一样”改变世界,OpenAI将开源更多大模型,ChatGPT 5将变得更加智能,同时呼吁将阿联酋打造为全球监管人工智能的试验场。