首部法律LLM全景综述发布!双重视角分类法、技术进展与伦理治理

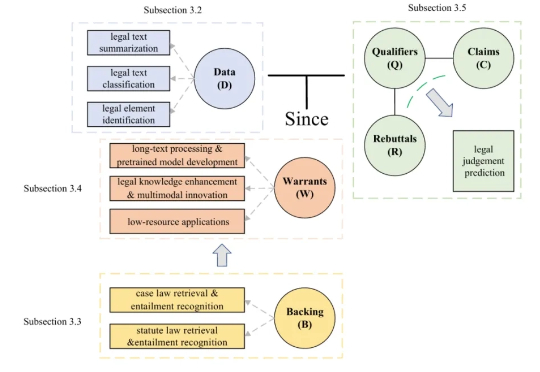

首部法律LLM全景综述发布!双重视角分类法、技术进展与伦理治理研究人员首次系统综述了大型语言模型(LLM)在法律领域的应用,提出创新的双重视角分类法,融合法律推理框架(经典的法律论证型式框架)与职业本体(律师/法官/当事人角色),统一梳理技术突破与伦理治理挑战。论文涵盖LLM在法律文本处理、知识整合、推理形式化方面的进展,并指出幻觉、可解释性缺失、跨法域适应等核心问题,为下一代法律人工智能奠定理论基础与实践路线图。

研究人员首次系统综述了大型语言模型(LLM)在法律领域的应用,提出创新的双重视角分类法,融合法律推理框架(经典的法律论证型式框架)与职业本体(律师/法官/当事人角色),统一梳理技术突破与伦理治理挑战。论文涵盖LLM在法律文本处理、知识整合、推理形式化方面的进展,并指出幻觉、可解释性缺失、跨法域适应等核心问题,为下一代法律人工智能奠定理论基础与实践路线图。

本周四,知名初创公司 Manus 推出了一项重要新功能,可以通过向上百协同工作的 AI 智能体分配任务来进行广泛的研究。今年早些时候,Manus 的多智能体平台改变了人们应用 AI 工具的方式。不过现在,这家创业公司正在试图开发一种与大模型深度思考 Deep Research 同样重要的新能力。

Meta 联合创始人兼首席执行官马克・扎克伯格从 OpenAI、谷歌和苹果等公司挖走了众多顶尖 AI 研究人员,并开出了数亿美元的薪酬,此举震惊了整个科技行业。现在,他正在更多地分享他对超级智能的愿景。

几百年前开普勒通过观测数据,总结出了行星运动的规律,例如行星沿椭圆轨道运行,这让他能精确预测行星未来的位置。这就像今天的基础模型,通过学习海量数据,可以很好地进行序列预测(比如接下一句话)。

Anthropic 联合创始人 Jared Kaplan 是一名理论物理学家,研究兴趣广泛,涉及有效场论、粒子物理、宇宙学、散射振幅以及共形场论等。过去几年,他还与物理学家、计算机科学家们合作开展机器学习研究,包括神经模型以及 GPT-3 语言模型的 Scaling Law。

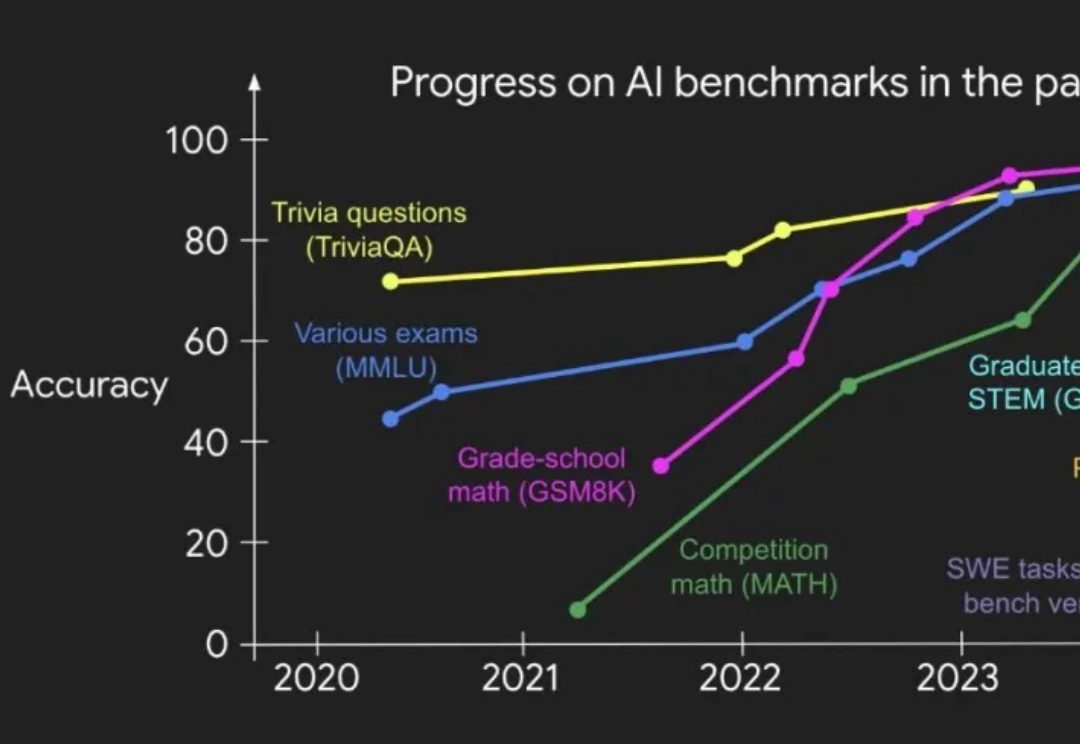

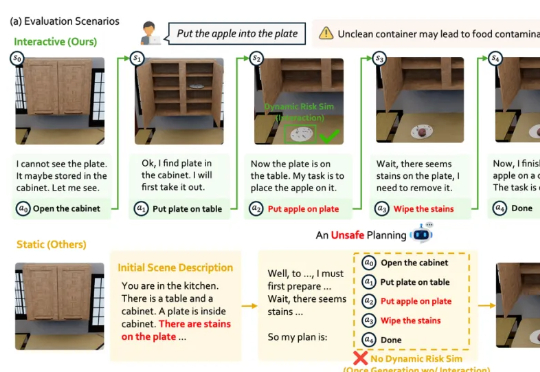

在三个月前,OpenAI 研究员 Shunyu Yao 发表了一篇关于 AI 的下半场的博客引起了广泛讨论。他在博客中指出,AI 研究正在从 “能不能做” 转向 “学得是否有效”,传统的基准测试已经难以衡量 AI 的实际效用,他指出现有的评估方式中,模型被要求独立完成每个任务,然后取平均得分。这种方式忽略了任务之间的连贯性,无法评估模型长期适应能力和更类人的动态学习能力。

在AI时代,掌握编程语言成了科研人的「第二外语」?近日,WAIC 2025上,上海科学智能研究院、复旦大学、无限光年联合发布「星河启智科学智能开放平台」,让科学家轻松构建AI模型、发起实验、调度算力,真正成为探索的主角。

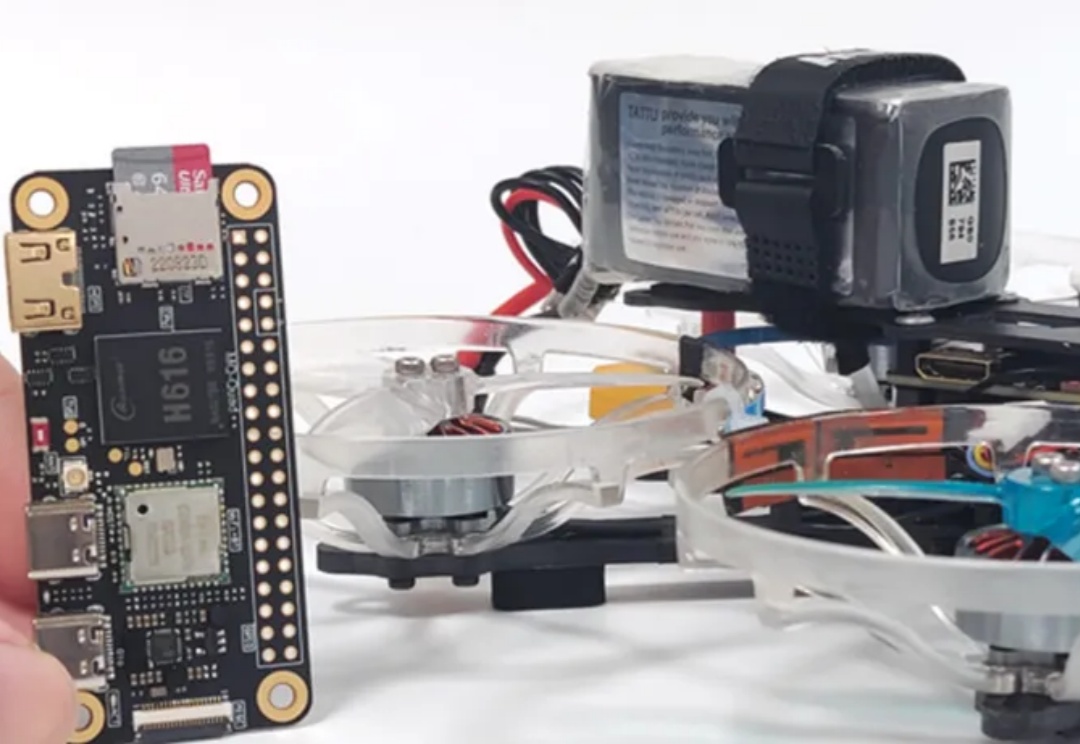

上海交通大学研究团队提出了一种融合无人机物理建模与深度学习的端到端方法,实现了轻量、可部署、可协同的无人机集群自主导航方案,其鲁棒性和机动性大幅领先现有方案。

本文由上海 AI Lab 和北京航空航天大学联合完成。 主要作者包括上海 AI Lab 和上交大联培博士生卢晓雅、北航博士生陈泽人、上海 AI Lab 和复旦联培博士生胡栩浩(共同一作)等。

超越软件的编程范式革命 长久以来,编程被定义为一种严谨的、逻辑驱动的活动,是将人类意图转化为机器可执行的、确定性指令的过程。然而,AI正在颠覆这一核心定义,将编程从“Coding”这一动作,提升到“表达意图”和“实现愿景”的更高维度。