拉爆官方 ralph loop,这个 agent 让你的 Claude Code / Codex / Opencode 持续一个礼拜干活

拉爆官方 ralph loop,这个 agent 让你的 Claude Code / Codex / Opencode 持续一个礼拜干活最近 AI 编程界最火的事情,就是怎么把各种 coding 模型卷到极致了。

最近 AI 编程界最火的事情,就是怎么把各种 coding 模型卷到极致了。

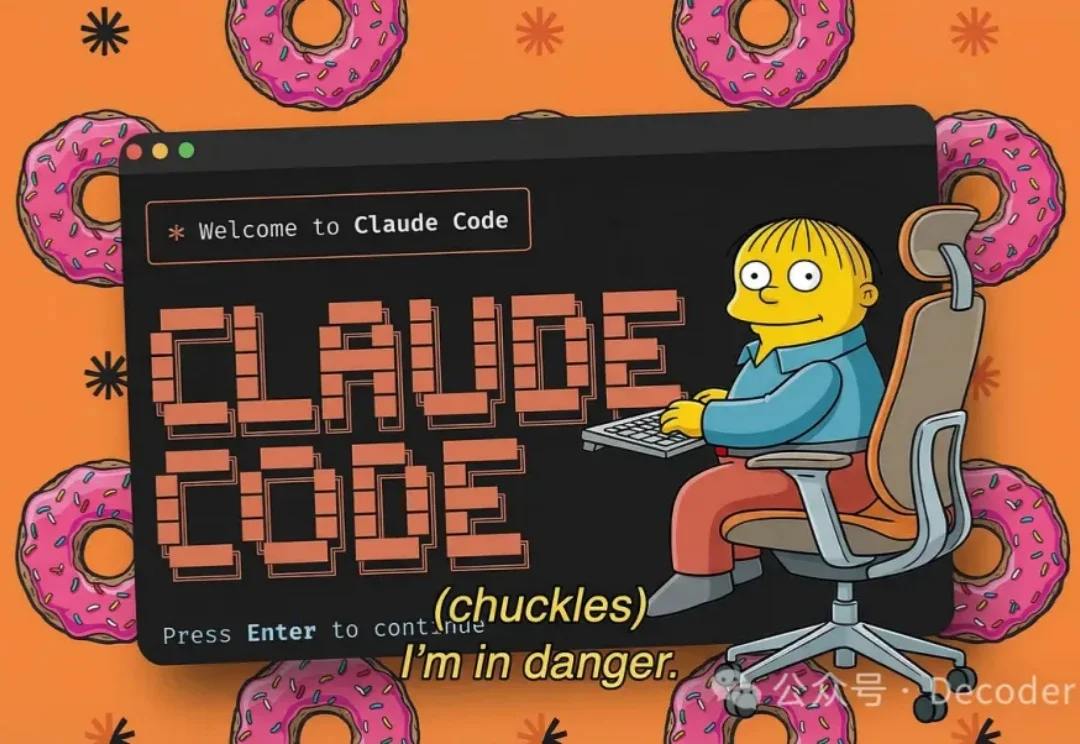

比如前些天,Vercel 创始人 Guillermo Rauch 推出了所谓的「AI skill 的 npm」,让用户仅需一个简单命令 npx skills add [package],就能为自己的 AI 智能体轻松注入专业能力。

我对Atoms的印象是没有印象。

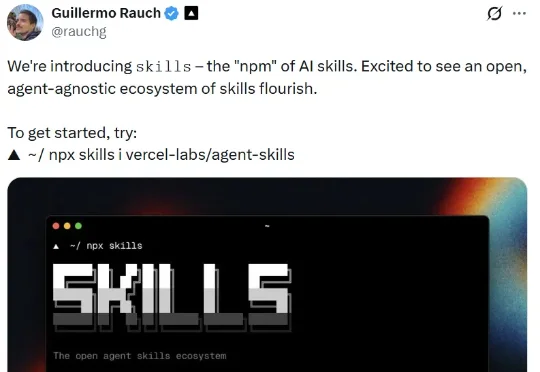

习惯了给 AI 写提示词的你可能不敢相信,现在的 AI 已经开始反过来给人类下达指令了。

这两天都在研究 ralph,一个你睡觉时,都能不眠不休替你干需求、榨干任何 Coding Agent 的工具。

Youware 更新的 Youbase 和 Coview 能力非常牛皮,直接把 Vibe Coding 门槛拉低一万倍。

最近马斯克很头疼:Grok在X上脱人衣服这件事,眼瞅着平息不了了。

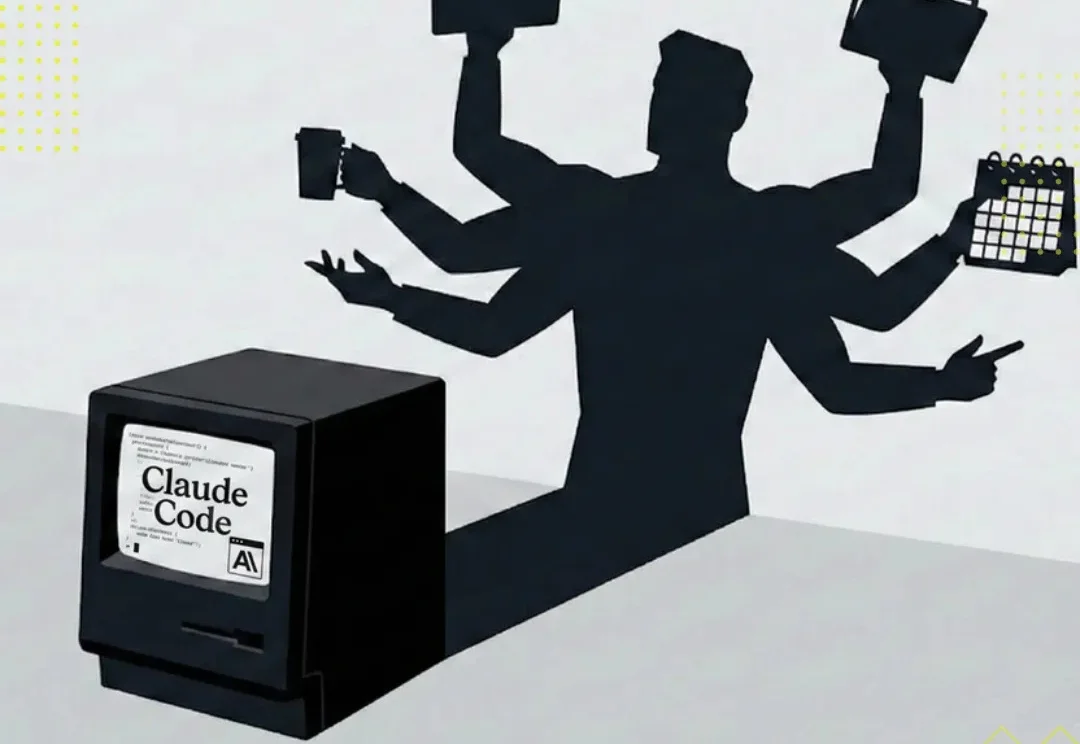

1月12日,Anthropic发布了一款新产品Cowork。官方给它的定义很有意思:Claude Code for the rest of your work,给剩下那些不写代码的人用的Claude Code。

软件行业正站在一个颇为微妙的拐点上。AI 已经从自动补全代码,演进为能够自主执行开发任务的智能体。

今天是一期硬核的话题讨论: Coding Agent 评测。 AI 编程能力进步飞速,在国外御三家和国产中厂四杰的努力下,AI 编程基准 SWE-bench 的分数从年初的 30% 硬生生拉到了年底的