腾讯混元最新开源:440M翻译模型手机离线就能用,翻译质量超谷歌

腾讯混元最新开源:440M翻译模型手机离线就能用,翻译质量超谷歌腾讯混元团队刚刚开源了一份硬核解决方案:推出极致量化压缩版本翻译模型Hy-MT1.5-1.8B-1.25bit,把支持33种语言的翻译大模型压缩至440MB。无需联网,下载后即可在手机本地运行 。官方测试显示,其翻译质量优于谷歌翻译。

搜索

搜索

腾讯混元团队刚刚开源了一份硬核解决方案:推出极致量化压缩版本翻译模型Hy-MT1.5-1.8B-1.25bit,把支持33种语言的翻译大模型压缩至440MB。无需联网,下载后即可在手机本地运行 。官方测试显示,其翻译质量优于谷歌翻译。

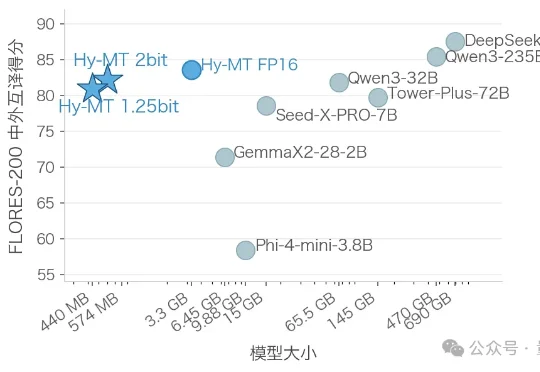

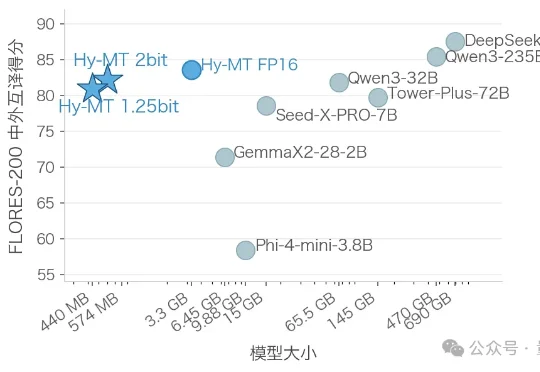

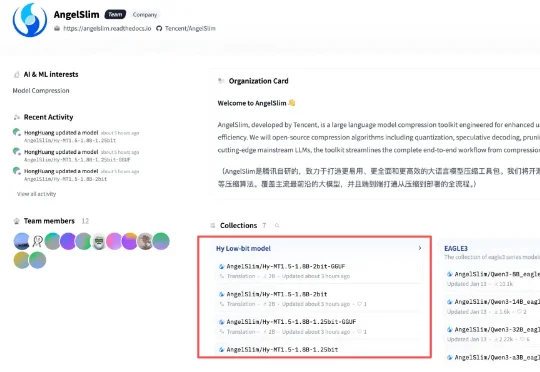

今日,腾讯混元开源翻译模型Hy-MT1.5-1.8B-1.25bit。该模型仅0.4G,就实现了33种语言高质量互译,且下载后可直接在手机本地离线运行,翻译表现优于谷歌翻译。这一原始模型的参数规模为1.8B,为降低用户手机内存压力,腾讯混元团队通过量化压缩推出了适配中高性能手机的2-bit、适配全系列手机的1.25-bit两种方案,模型体积分别被压缩至574MB、440MB。

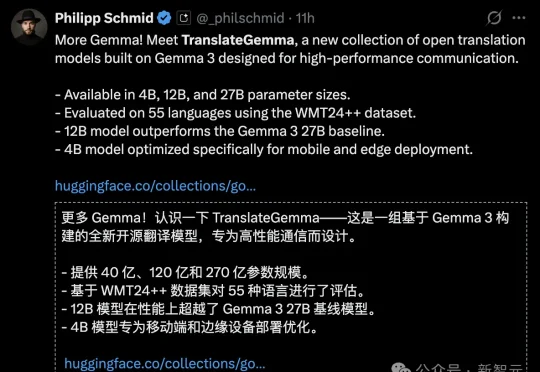

OpenAI悄悄发布了翻译产品ChatGPT Translate,谷歌则祭出强势回应——TranslateGemma,一个能在手机上翻55种语言的开源模型。

能翻译33语种+5方言,医学术语/粤语翻译实测“能打”。

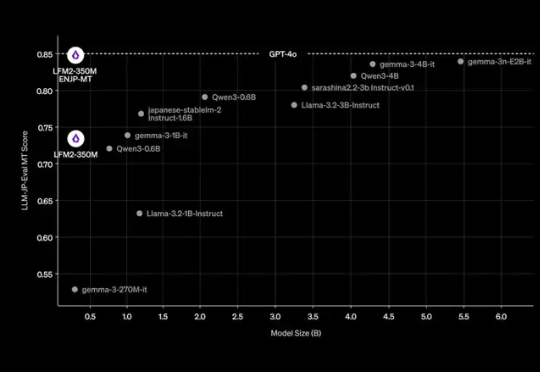

在大模型的竞赛中,参数规模往往被视为性能的决定性因素。但近期,Liquid AI 的研究团队提出了一个不同寻常的案例:一个仅有 3.5 亿参数的模型,经过微调后,竟能在中短上下文的实时日语英语翻译任务上,与 GPT-4o 竞争。

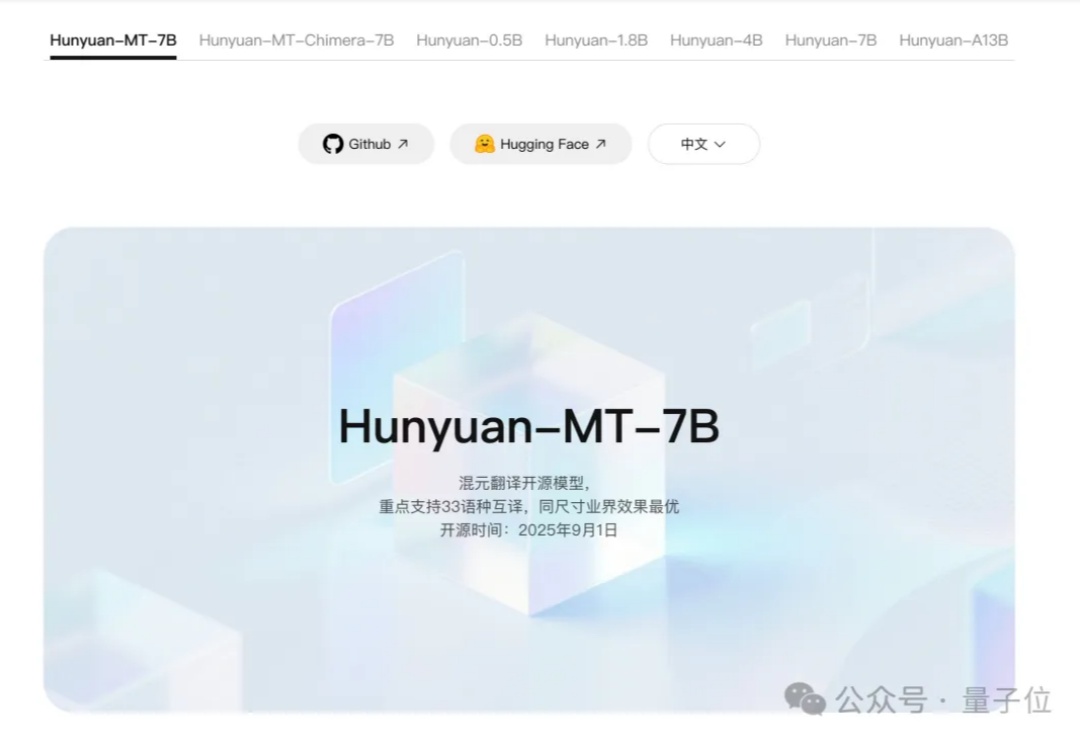

腾讯混元,刚刚又拿下一个国际冠军—— Hunyuan-MT-7B,以7B总参数量获得国际翻译比赛冠军。该模型支持33个语种、5种民汉语言/方言互译,是一个能力全面的轻量级翻译模型。

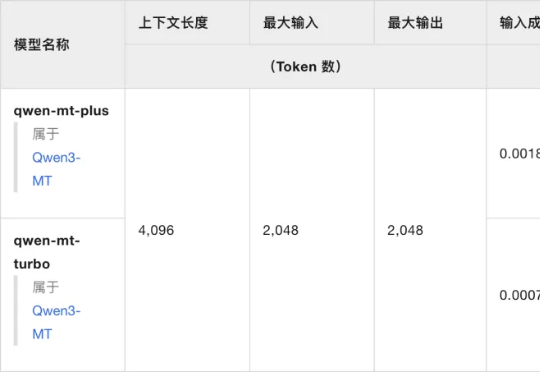

Qwen最近属实声势不小,开源方面刚靠Qwen3-Coder炸场,在翻译领域也卷出花

都说通用大模型轻松拿捏翻译,结果有人来掀桌了。

Meta谷歌接连放出重磅成果!Meta开源无缝交流语音翻译模型,谷歌放出无监督语音翻译重大突破Translation 3。