CLIP被淘汰了?LeCun谢赛宁新作,多模态训练无需语言监督更强!

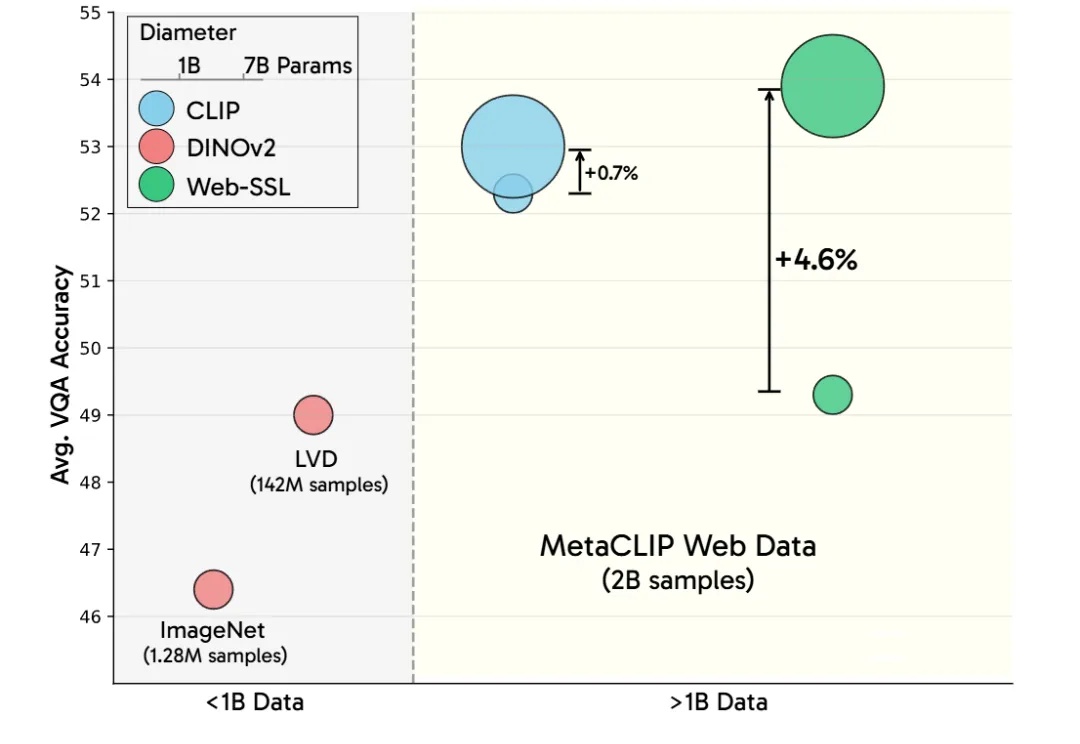

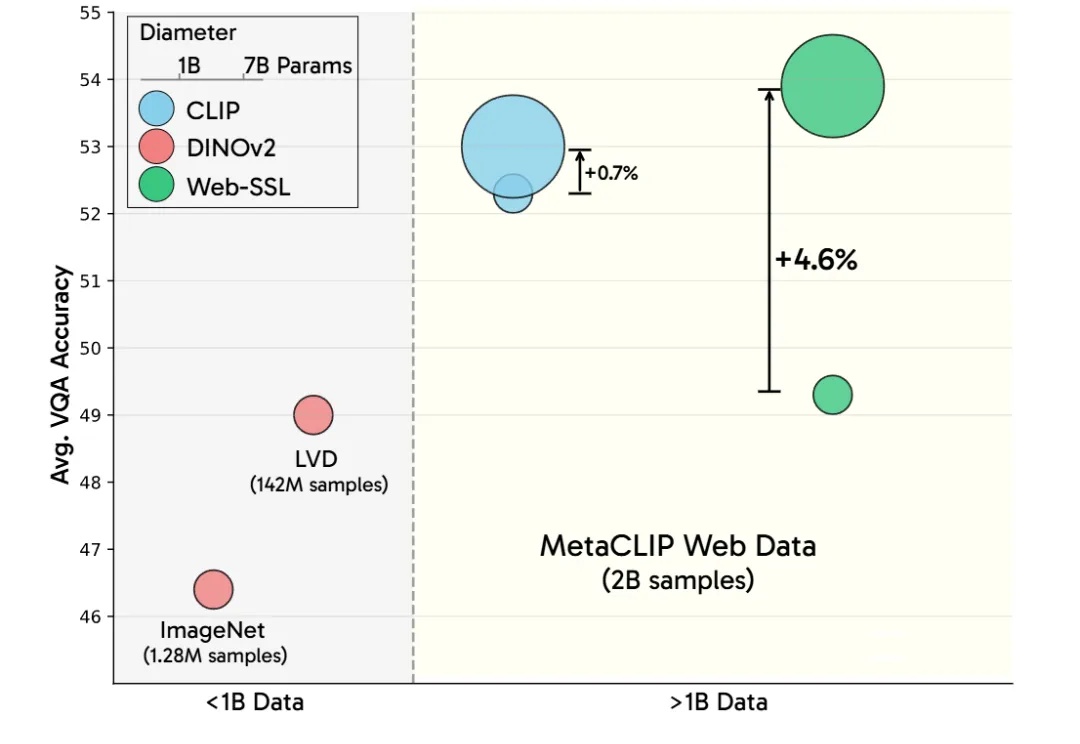

CLIP被淘汰了?LeCun谢赛宁新作,多模态训练无需语言监督更强!LeCun谢赛宁等研究人员通过新模型Web-SSL验证了SSL在多模态任务中的潜力,证明其在扩展模型和数据规模后,能媲美甚至超越CLIP。这项研究为无语言监督的视觉预训练开辟新方向,并计划开源模型以推动社区探索。

LeCun谢赛宁等研究人员通过新模型Web-SSL验证了SSL在多模态任务中的潜力,证明其在扩展模型和数据规模后,能媲美甚至超越CLIP。这项研究为无语言监督的视觉预训练开辟新方向,并计划开源模型以推动社区探索。

想象一下,耗费动画大师宫崎骏数十年心血、一帧一画精雕细琢的艺术风格——比如《起风了》中耗时一年多的四秒人群场景,或是《幽灵公主》里那个生物钻地镜头背后一年零七个月的 5300 帧手绘,如今,在GPT-4o手中,似乎变得“唾手可得”。

视觉Token可以与LLMs词表无缝对齐了!

扩展无语言的视觉表征学习。

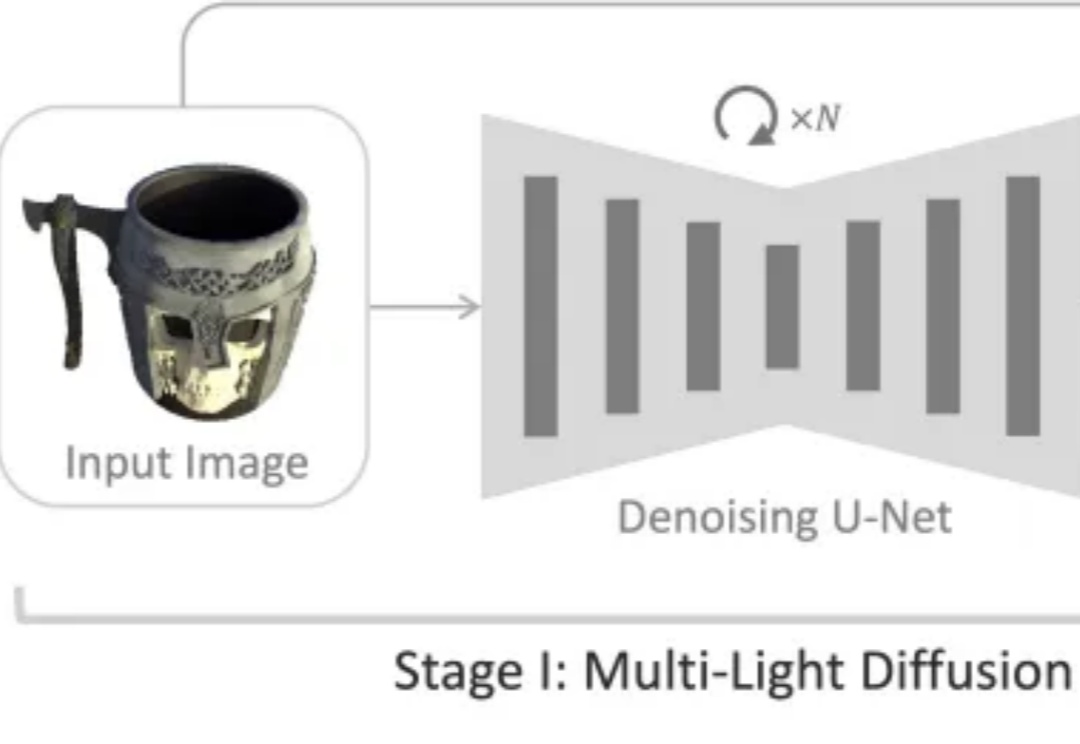

如何从一张普通的单幅图像准确估计物体的三维法线和材质属性,是计算机视觉与图形学领域长期关注的难题。

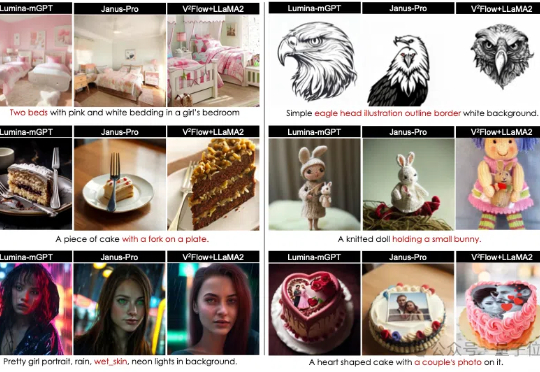

在今天数字图像无处不在,而高质量的图片对于各种项目至关重要。然而,许多人对于那些无聊、过度使用的传统库存照片感到厌倦,他们渴望与众不同、创新的视觉效果。这就是为什么 Lummi 库存图片的出现如此重要。

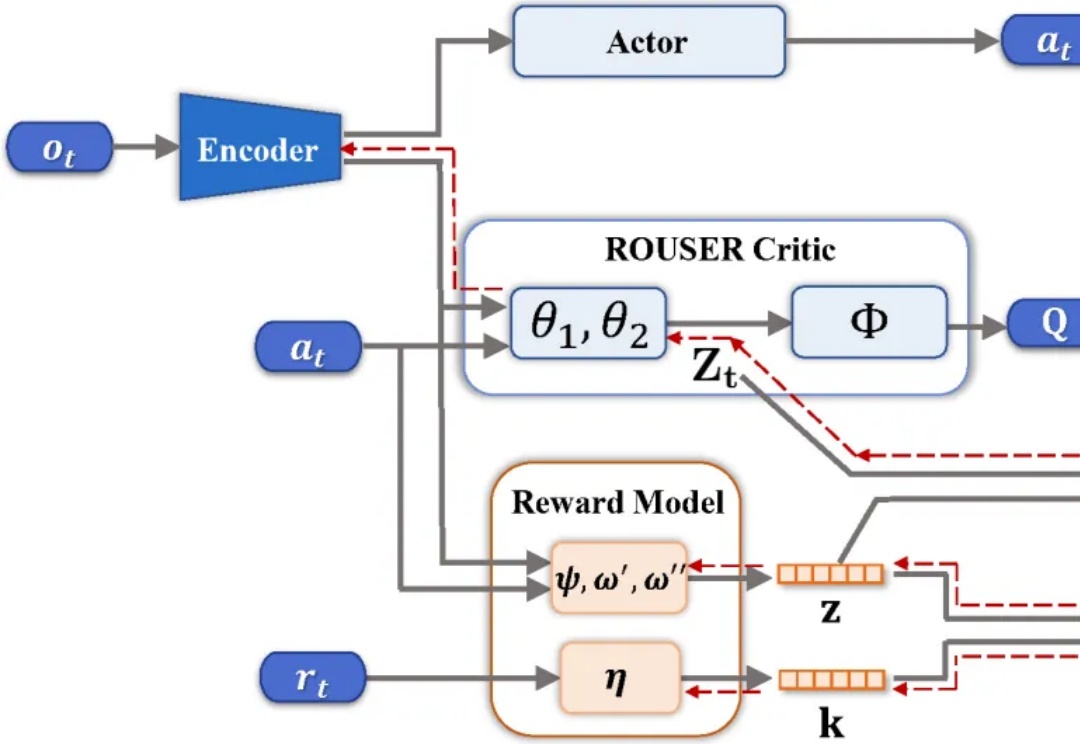

在视觉强化学习中,许多方法未考虑序列决策过程,导致所学表征缺乏关键的长期信息的空缺被填补上了。

你是否注意过人类观察世界的独特方式?

AI圈最热的风头莫过于GPT-4o的原生图像,但别急着下定论。Gemini 2.5 Pro正在悄悄反击,在Chatbot竞技场夺冠、IQ测试拿下第一后,它还能解魔方、建模型、创游戏,甚至一键生成3D打印文件!AI的下一个战场,正在从文字转向视觉与空间,谁能笑到最后?

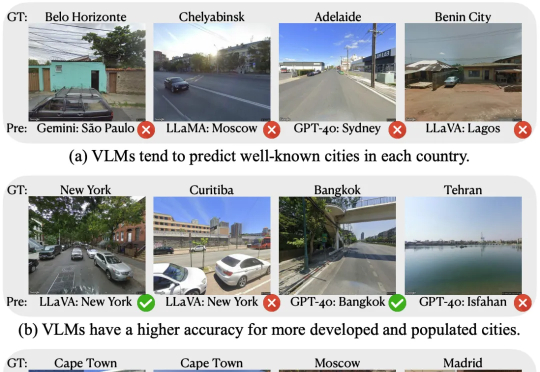

给AI一张全新的照片,它能以相当高的准确率还猜出照片在哪个城市拍摄的。在新研究中,表现最好的AI模型,猜出图片所在城市的正确率比人类高62.6%!以后网上晒图可要当心了,AI可能知道你在哪里!