Perplexity CEO罕见发声:Kimi K2测试表现良好,考虑基于其进行后训练!

Perplexity CEO罕见发声:Kimi K2测试表现良好,考虑基于其进行后训练!美国AI初创公司 Perplexity 的联合创始人兼首席执行官Aravind Srinivas今日在社交平台发文,首次公开评价中国大模型“月之暗面”Kimi K2。他表示,Kimi K2 在内部测试中表现良好,Perplexity 正在考虑在其基础上进行后训练。

美国AI初创公司 Perplexity 的联合创始人兼首席执行官Aravind Srinivas今日在社交平台发文,首次公开评价中国大模型“月之暗面”Kimi K2。他表示,Kimi K2 在内部测试中表现良好,Perplexity 正在考虑在其基础上进行后训练。

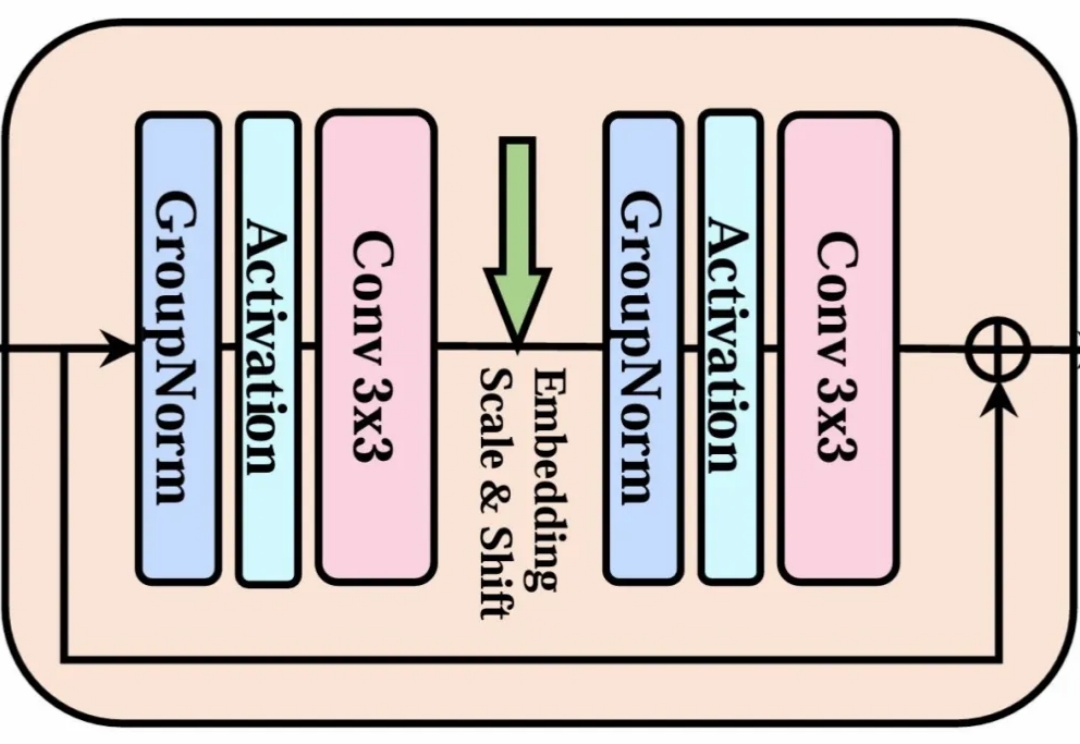

当整个 AI 视觉生成领域都在 Transformer 架构上「卷生卷死」时,一项来自北大、北邮和华为的最新研究却反其道而行之,重新审视了深度学习中最基础、最经典的模块——3x3 卷积。

在大模型狂飙的时代,AI 创业被裹挟进一种“技术正统性”的焦虑:要不要训练模型?有没有算力资源?底层自研是不是护城河?但 Yiran,一位本科学钢琴、靠一段自动发邮件脚本开启创业旅程的 00 后女性创业者,选择了另一种路径——她不训练模型,不押技术论文,而是把 AI 做成一个真正能“成事”的销售助理。

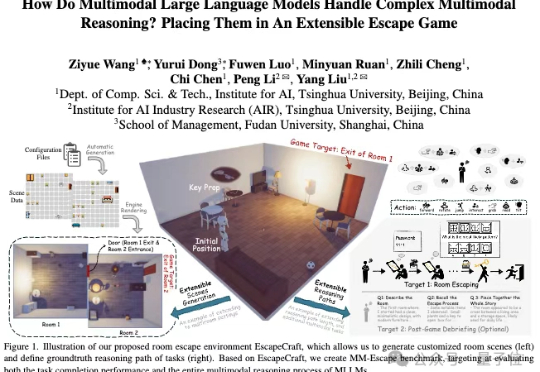

近年来,多模态大模型(MLLMs)发展迅猛,从看图说话到视频理解,似乎无所不能。

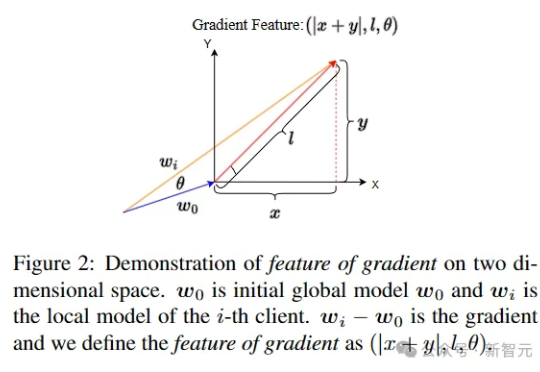

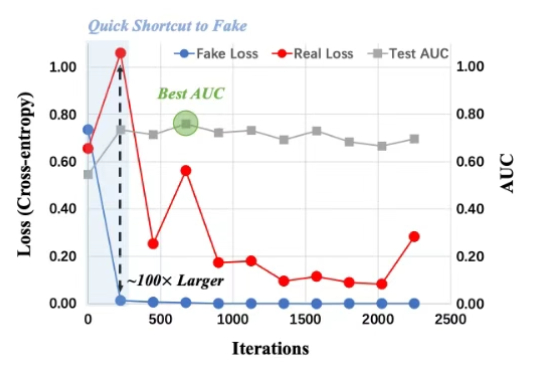

华南理工大学计算机学院AI安全团队长期深耕于人工智能安全,近期联合约翰霍普金斯大学和加州大学圣地亚戈分校聚焦于联邦学习中防范恶意投毒攻击,产出工作连续发表于AI顶刊TPAMI 2025和网络安全顶刊TIFS 2025。

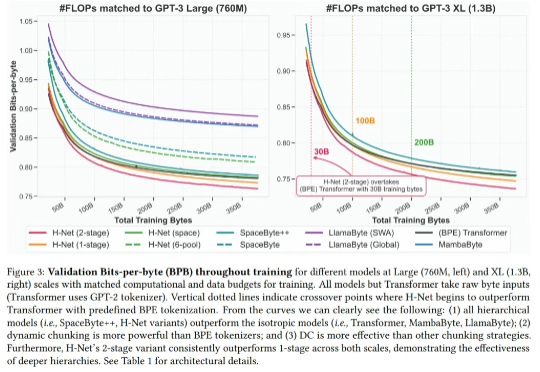

最近,Mamba 作者之一 Albert Gu 又发新研究,他参与的一篇论文《 Dynamic Chunking for End-to-End Hierarchical Sequence Modeling 》提出了一个分层网络 H-Net,其用模型内部的动态分块过程取代 tokenization,从而自动发现和操作有意义的数据单元。

随着 OpenAI 推出 GPT-4o 的图像生成功能,AI 生图能力被拉上了一个新的高度,但你有没有想过,这光鲜亮丽的背后也隐藏着严峻的安全挑战:如何区分生成图像和真实图像?

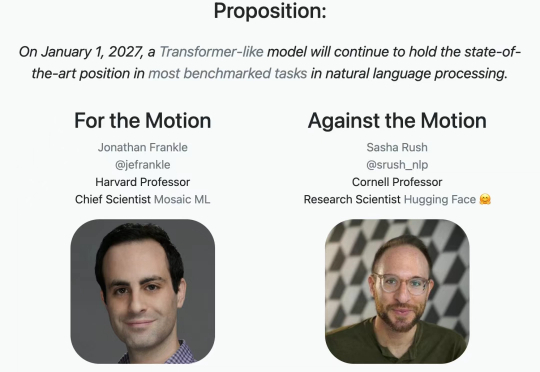

「停止研究 RL 吧,研究者更应该将精力投入到产品开发中,真正推动人工智能大规模发展的关键技术是互联网,而不是像 Transformer 这样的模型架构。」

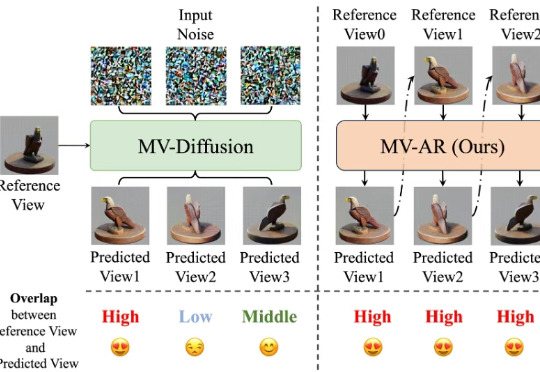

本文介绍并开发了一种自回归生成多视图图像的方法 MVAR 。其目的是确保在生成当前视图的过程中,模型能够从所有先前的视图中提取有效的引导信息,从而增强多视图的一致性。

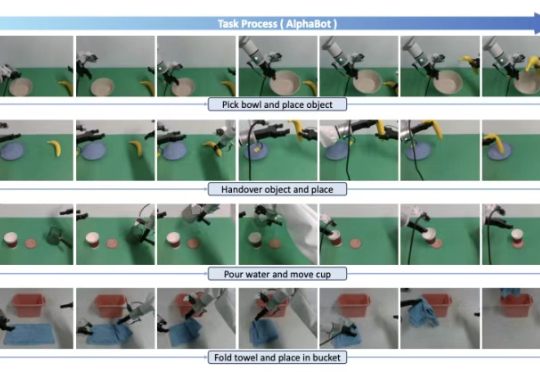

在机器人操控领域,实现高频响应与复杂推理的统一,一直是一个重大技术挑战。近期,北京大学与香港中文大学的研究团队联合发布了名为 Fast-in-Slow(FiS-VLA) 的全新双系统视觉 - 语言 - 动作模型。