讯飞星火X1单挑满血版DeepSeek-R1,全国产算力单机部署!中国AI再下一城

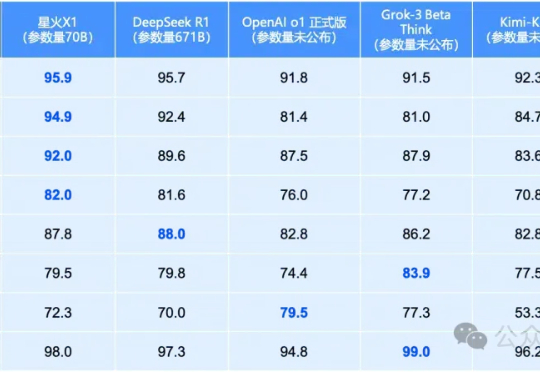

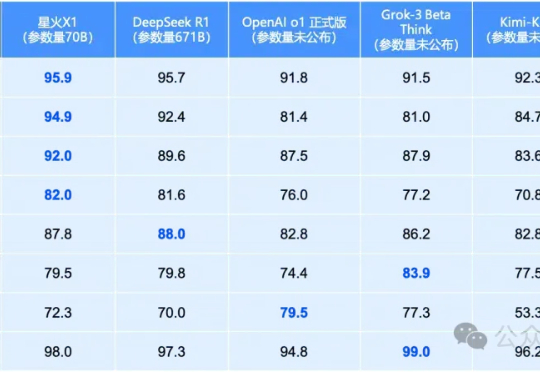

讯飞星火X1单挑满血版DeepSeek-R1,全国产算力单机部署!中国AI再下一城就在昨天,全国产算力训出的讯飞星火X1全面升级!70B小身板在数学领域全面领先,性能直接对标OpenAI o1和DeepSeek-R1。单机部署成本骤降,彻底颠覆行业应用门槛。

就在昨天,全国产算力训出的讯飞星火X1全面升级!70B小身板在数学领域全面领先,性能直接对标OpenAI o1和DeepSeek-R1。单机部署成本骤降,彻底颠覆行业应用门槛。

本文介绍了英特尔®至强®处理器在AI推理领域的优势,如何使用一键部署的镜像进行纯CPU环境下基于AMX加速后的DeepSeek-R1 7B蒸馏模型推理,以及纯CPU环境下部署DeepSeek-R1 671B满血版模型实践。

DeepSeek“爆火”后,各家医疗企业争相部署似乎已成为春节复工以来的头等大事。据36氪不完全统计,节后复工以来,至少20家以上医疗领域企业公开宣布正在引入DeepSeek。其中虽不乏恒瑞医药、云南白药等传统药企;金域医学、圣湘生物等老牌IVD企业,但表现更活跃的各路AI医疗概念公司,如智云健康、鹰瞳科技、医渡科技、树坤科技等。

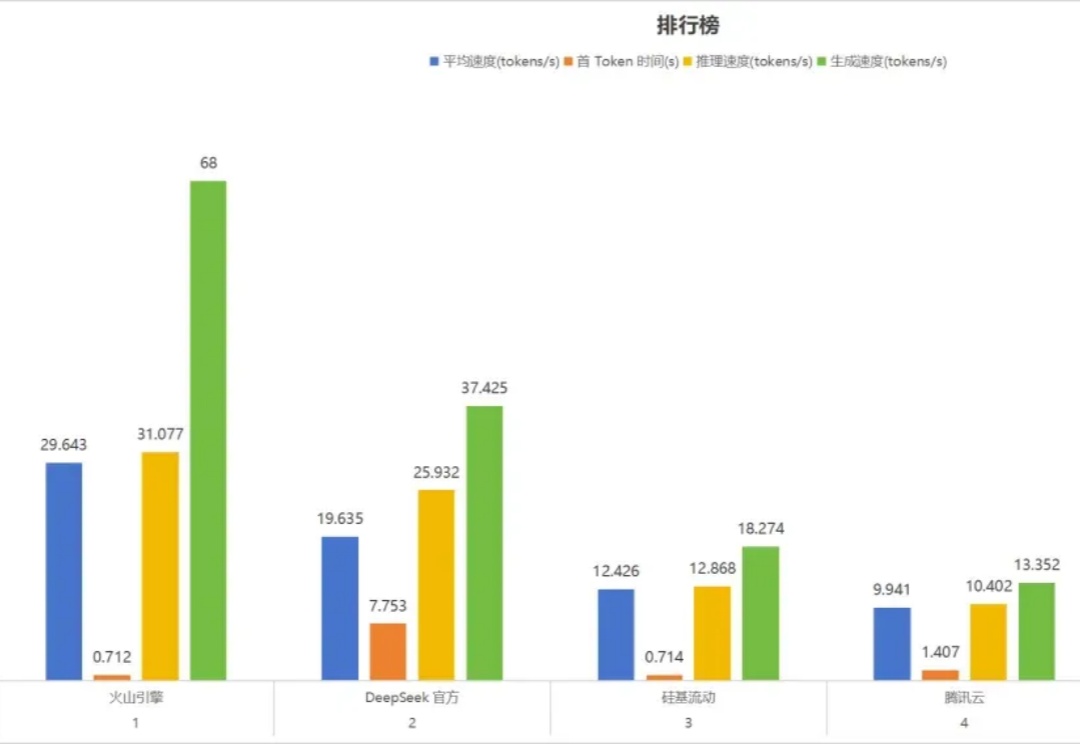

部署 DeepSeek 系列模型,尤其是推理模型 DeepSeek-R1,已经成为一股不可忽视的潮流。

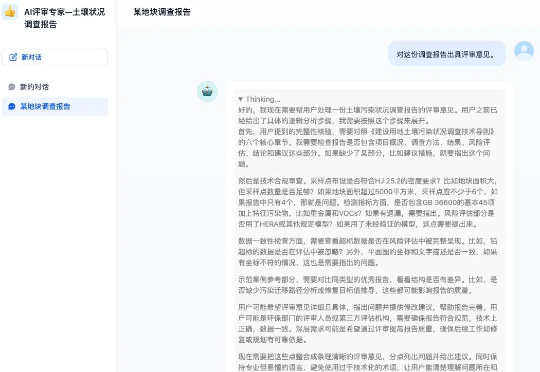

国内首个生态环境“AI报告评审专家”已完成土壤污染状况调查报告领域的前期训练,启动上线试运行。日前,无锡市梁溪生态环境局已完成DeepSeek-R1“满血版”大模型本地化部署,通过AI与生态环境业务深度融合,

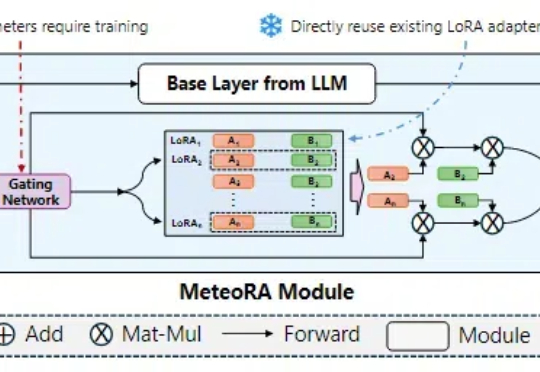

在大语言模型领域中,预训练 + 微调范式已经成为了部署各类下游应用的重要基础。在该框架下,通过使用搭低秩自适应(LoRA)方法的大模型参数高效微调(PEFT)技术,已经产生了大量针对特定任务、可重用的 LoRA 适配器。

DeepSeek-R1及其蒸馏版本模型突破了AI Reasoning和大规模AI性能的新基准,其中DeepSeek-R1-Zero和DeepSeek-R1,已经在推理和问题求解上树立了新的标准。本次研究聚焦于如何利用已有的机器进行模型部署,使用这些先进的模型进行开发和研究。

作为一个技术爱好者,在这样一个特殊的时刻,用代码来记录倒计时是一种很有趣的方式。本文将通过使用Trae开发一个简单的春节倒计时程序,并将其部署到阿里云服务器上,实现一个完整的开发过程。

你真的需要本地部署DeepSeek吗?

开源AI短剧神器来了!来自昆仑万维,一次性开源两大视频模型——国内首个面向AI短剧创作的视频生成模型SkyReels-V1;国内首个SOTA级别基于视频基座模型的表情动作可控算法SkyReels-A1。