快手广告系统全面迈入生成式推荐时代!GR4AD:从Token到Revenue的全链路重构

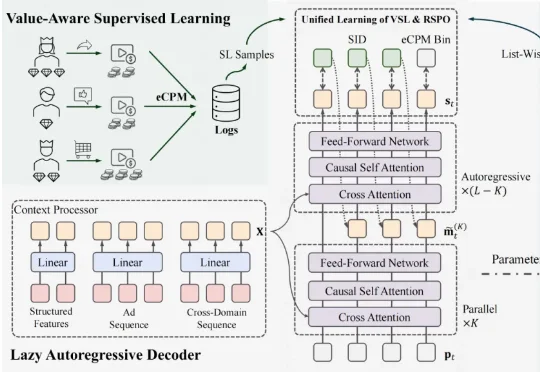

快手广告系统全面迈入生成式推荐时代!GR4AD:从Token到Revenue的全链路重构快手的这篇论文,正是对这一问题交出的一份沉甸甸的工业级答卷。他们提出了 GR4AD(Generative Recommendation for ADvertising),一个横跨表征、学习、服务三大层面协同设计的生成式广告推荐系统,并已全量部署于快手广告平台,服务超过 4 亿用户。

快手的这篇论文,正是对这一问题交出的一份沉甸甸的工业级答卷。他们提出了 GR4AD(Generative Recommendation for ADvertising),一个横跨表征、学习、服务三大层面协同设计的生成式广告推荐系统,并已全量部署于快手广告平台,服务超过 4 亿用户。

就在这个节骨眼上,我发现了一个非常有意思的东西,科大讯飞在 GitHub 上开源了一个叫 SkillHub 的项目。简单说,SkillHub 就是一个可以私有化部署的 Skill 技能包管理平台,团队可以在自己服务器上搭建,数据完全掌握在自己手上。

《读佳》获悉,由北京青阳智维科技有限公司运营“量原求索Labelease”已推出,通过媒体报道可知,该公司隶属于字节跳动。 据悉,Labelease的主要作用是帮助模型团队解决模型从训练到部署全链路中

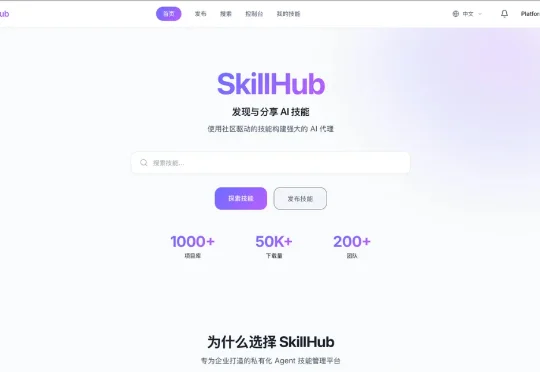

因为 Claude Code 就是目前最顶级的 Agent 系统,没有之一。我敢说,昨晚有大量厂商的技术团队通宵在扒这份源码,疯狂学习里面的架构设计,拿来改进自家产品。下面说说我是怎么部署的,流程其实很简单。

过去几周,国内各大厂纷纷推出了自己的“龙虾”,而阿里云在这条赛道上的动作尤其引人注目。2026 年,阿里云通义实验室旗下 AgentScope 团队开源了 CoPaw,一款本地 / 云端双部署的个人 AI 助理,主打“全域接入、隐私可控、主动干活”。

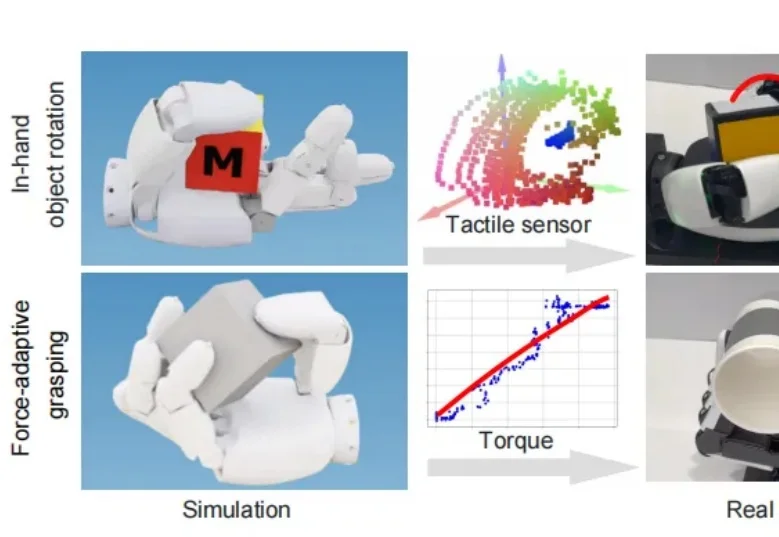

实现具备人类水平的灵巧操作能力,是机器人学领域长期以来的核心挑战之一。尽管多指灵巧手在硬件上具备了类似人类的潜力,但由于接触丰富的物理特性和非理想的驱动机制,训练能够直接部署在真实硬件上的控制策略仍然非常困难。

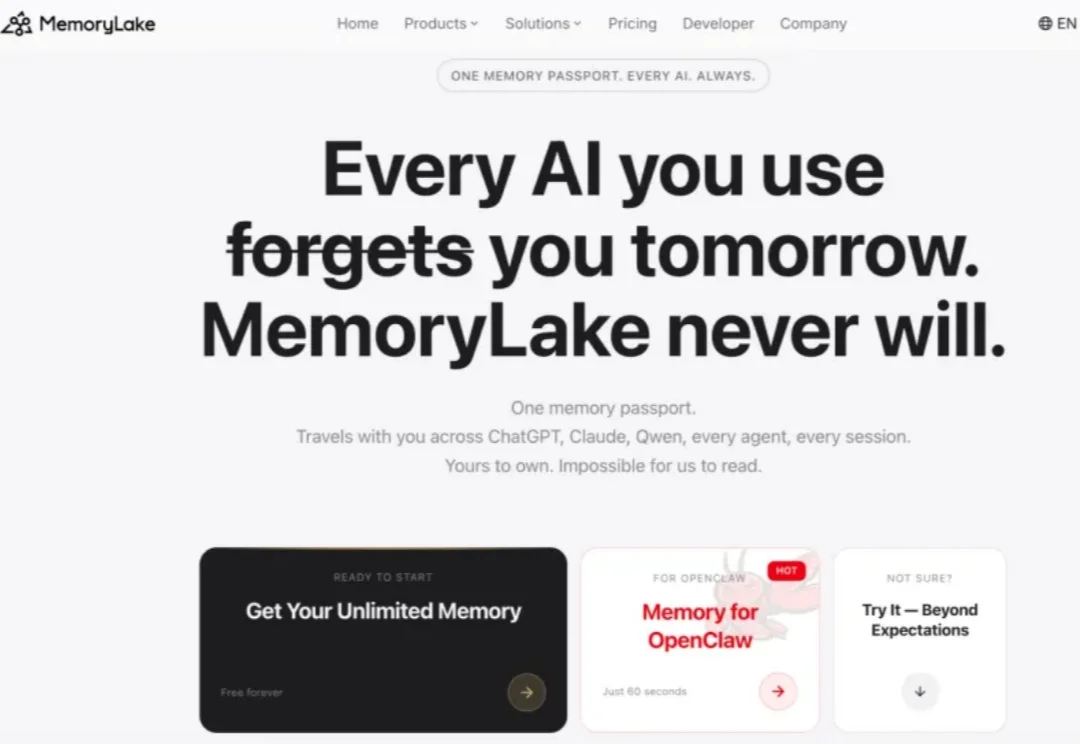

一家企业花了七周时间部署 AI:第 1 周精准回答行业分析问题,团队欢呼;第 3 周反复回答相同的错误结论,因为它“忘了”上周的修正;第 5 周在董事会汇报中引用了已被否定的数据,造成决策偏差;第 7 周项目暂停,“AI 不可信”成为共识。问题不在于 AI 不够聪明,而在于它每次醒来都是一张白纸。

养虾🦞(OpenClaw)这阵风刮得太猛了,不止个人在玩,企业也都在装,生怕落后。

我们也在 Claude Code、本地部署的龙虾里,都接入了 MiniMax M2.7 模型,以及 MiniMax 提供的 MaxClaw,然后把真实的开发过程中遇到的 Bug、枯燥的金融数据,还有大量的长流程任务统统交给它。

昨晚(3月16日),朋友圈里有不少人在转飞书玩虾大会的加更直播链接。说是李诞和呼兰还有小声比比在现场实操演示,怎么玩最近科技圈炙手可热的小龙虾(OpenClaw)。 坦白说,作为一个在AI行业两年多、自己折腾过本地服务器部署、写过无数复杂Prompt的从业者和观察者,我一开始点进直播间的心态,是带着一点傲慢和不屑的。