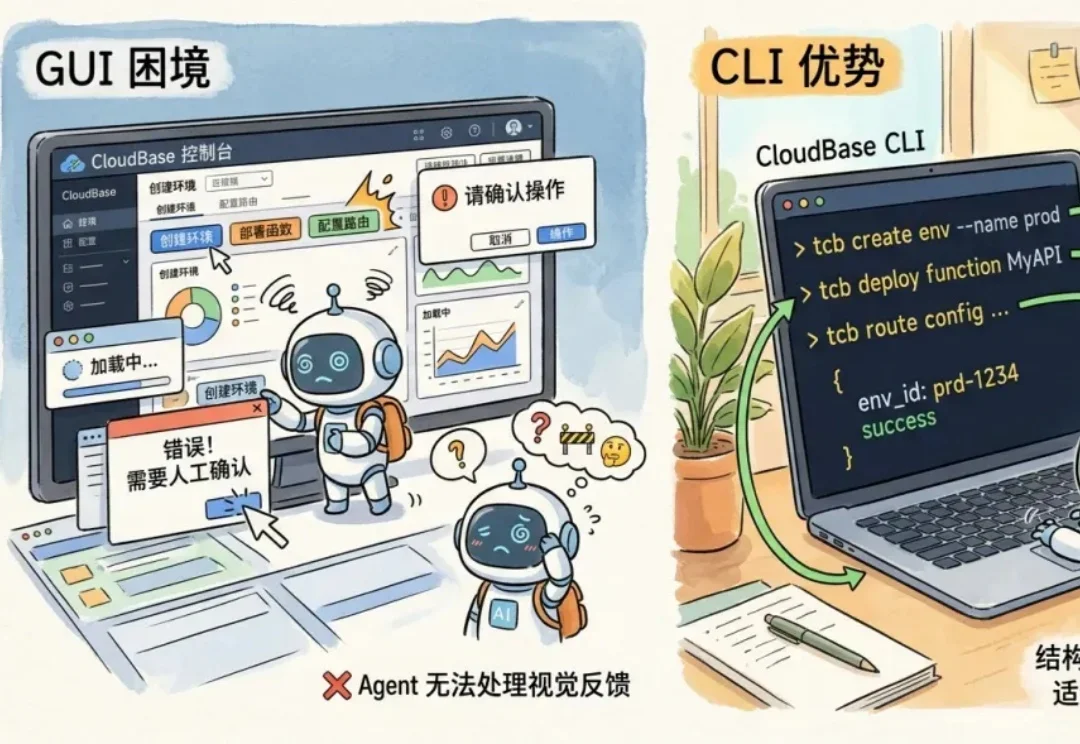

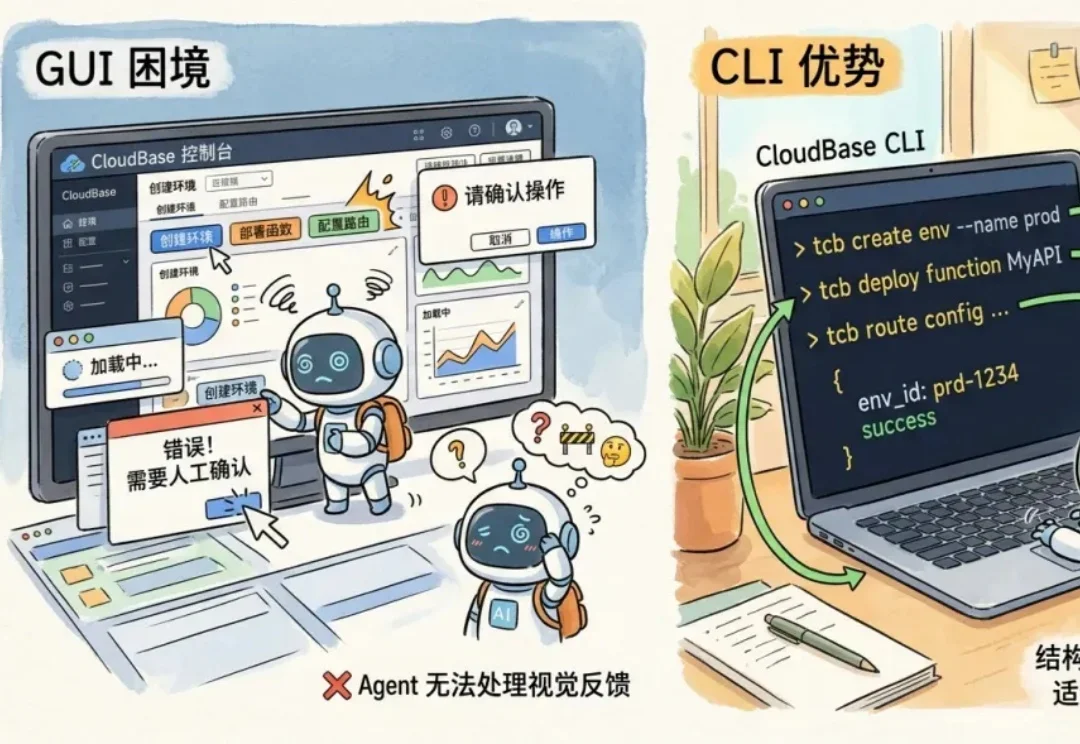

腾讯正式发布面向Agent设计的命令行工具:CloudBase CLI V3

腾讯正式发布面向Agent设计的命令行工具:CloudBase CLI V3我们很荣幸地宣布 CloudBase CLI V3 正式上线,这是一个面向 AI Agent 重新设计的 CloudBase 命令行工具。

我们很荣幸地宣布 CloudBase CLI V3 正式上线,这是一个面向 AI Agent 重新设计的 CloudBase 命令行工具。

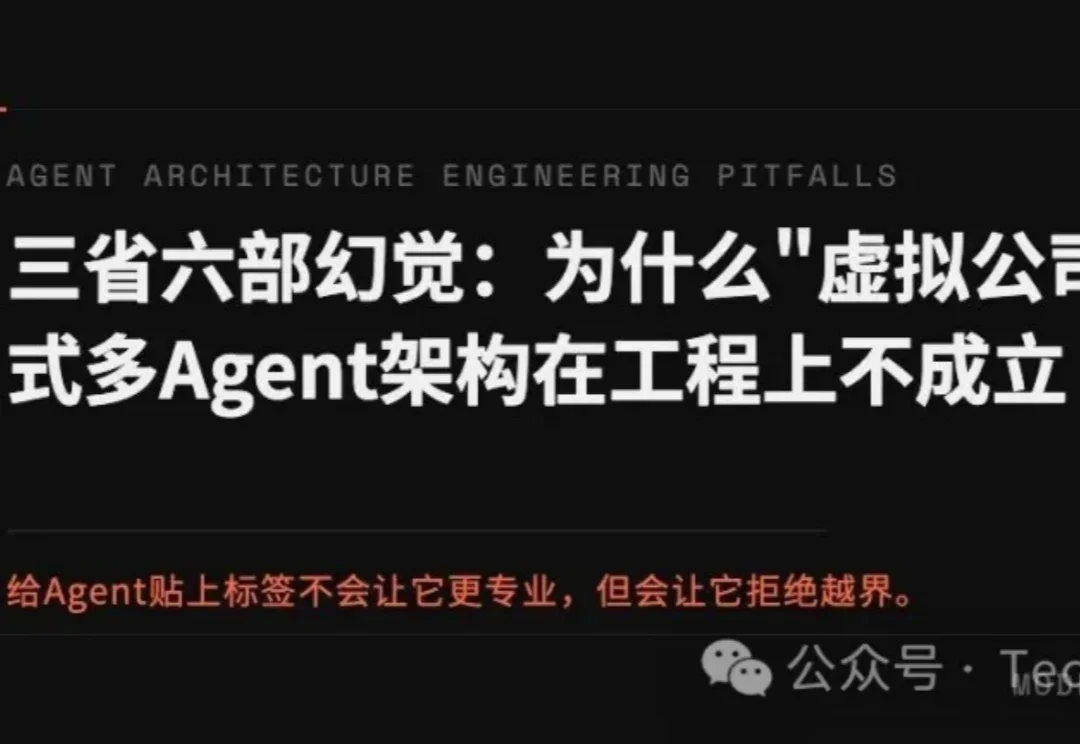

一个在 AI 社区广泛流传的架构思路,正在让大量团队走弯路。

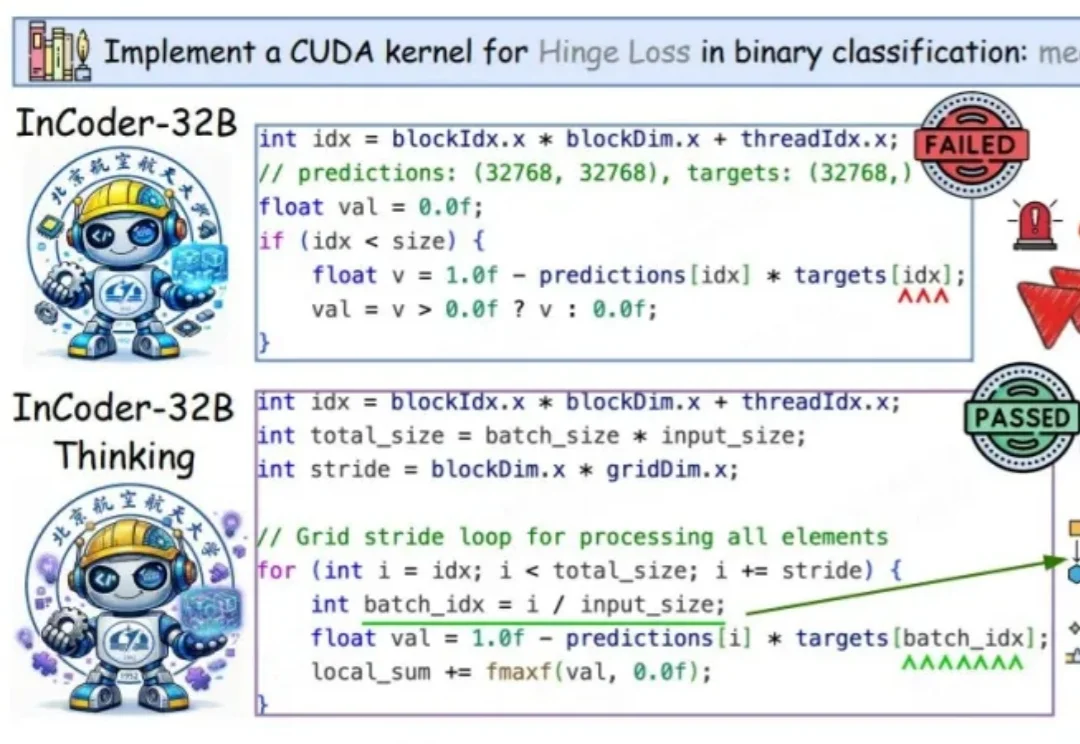

全球最强编程模型,中国造。

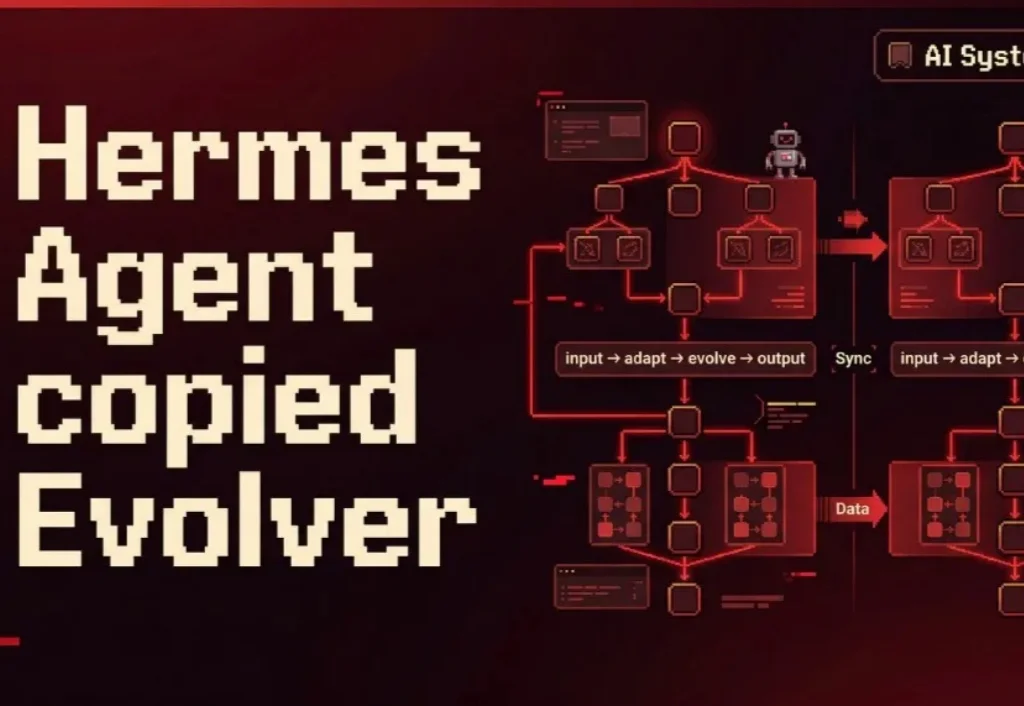

Hermes Agent最近在AI圈彻底火了。

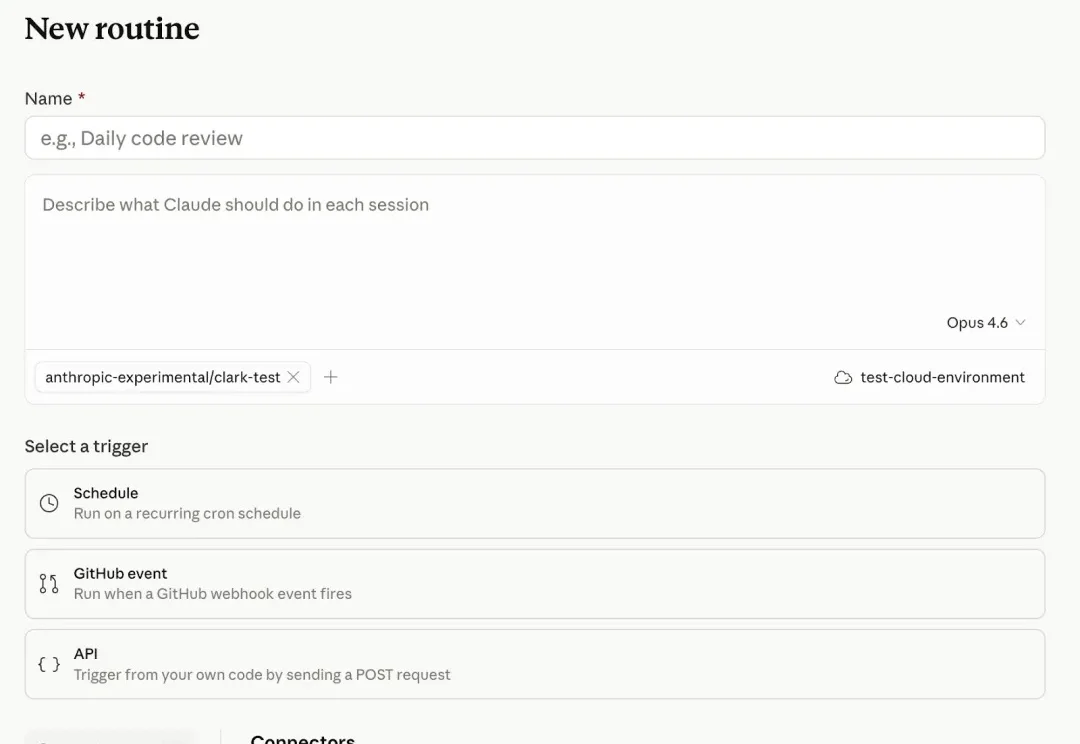

Claude Code 今天上了一个新能力:Routines,面向 Pro、Max、Team 和 Enterprise 用户开放

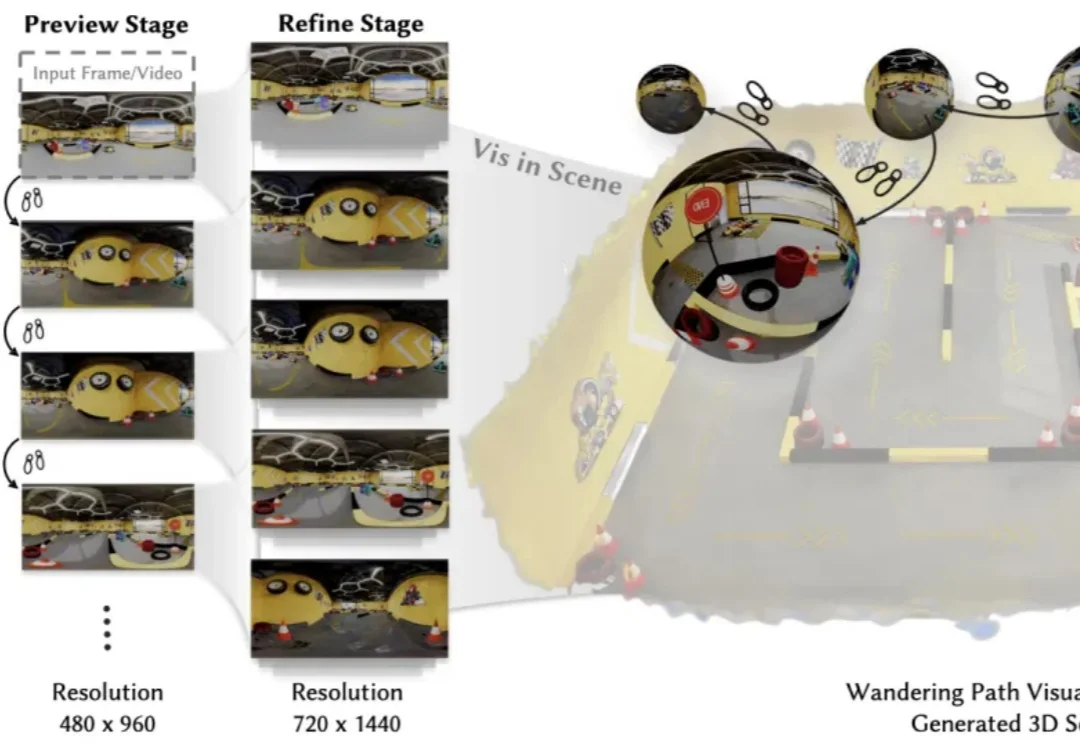

在生成式视频快速发展的今天,模型已经能够生成高质量的短视频片段,但一个更具挑战性的问题正逐渐成为研究焦点:

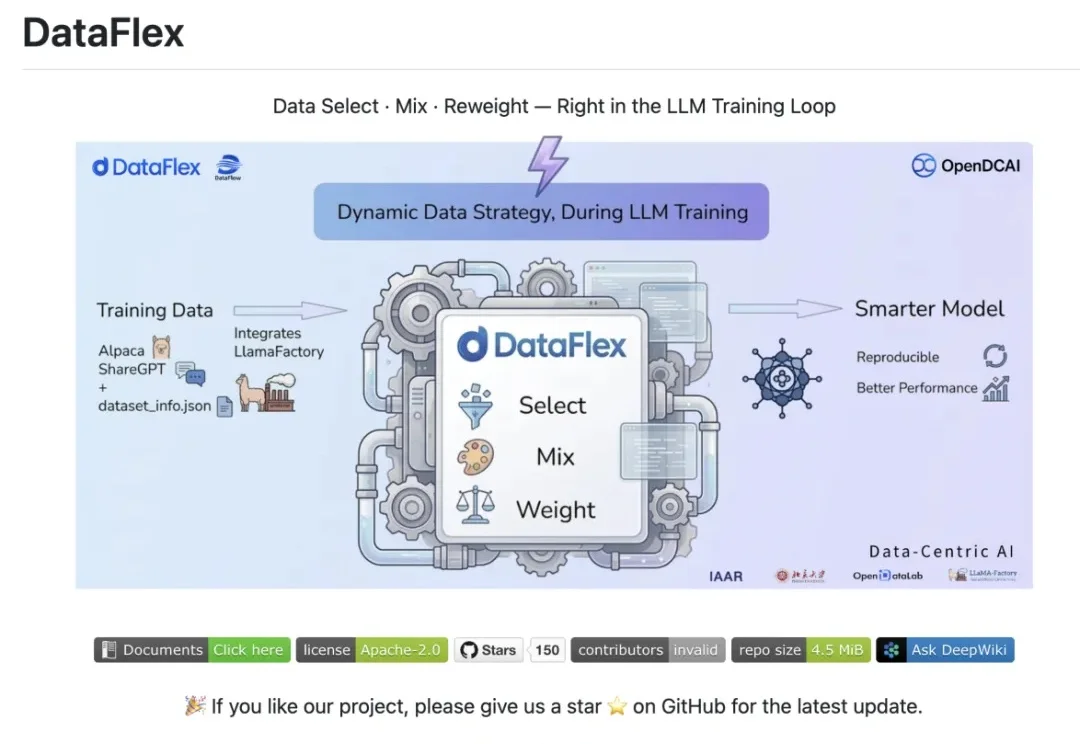

当大模型训练进入深水区,竞争的关键已经不再只是「模型参数怎么调」,而逐渐转向一个更核心、也更难系统解决的问题:模型在训练过程中究竟看到了什么数据、以什么比例看到、哪些样本应该被更频繁地学习。

眼瞅着四月马上过半,OpenClaw 刮起的这股「养虾风」依然没有停歇。

Anthropic正式推出了Claude Code的自动化任务功能Routines,目前处于研究预览阶段。只要配置好一次提示词、代码仓库和连接器,Claude就能在云端全自动干活了。这些任务全部运行在Anthropic的云端基础设施上,意味着完全不需要你一直开着电脑,哪怕你下班关机,它也能按时帮你处理代码积压、审查代码,甚至随时响应云端事件。

上周,我们发布了 MMX-CLI,让 Agent 可以直接通过命令行调用 MiniMax 的全模态能力。命令行是 Agent 在终端中完成工作的常见形态,但用户的工作并不只发生在命令行内,电脑上还有大量任务藏在命令行无法触达的本地软件、内部系统和图形界面中。

拍一圈照片,就能生成一个可交互的 3D 世界,已经不是什么新鲜话题了。但问题是如何把一个大世界塞进普通人的手机浏览器里。

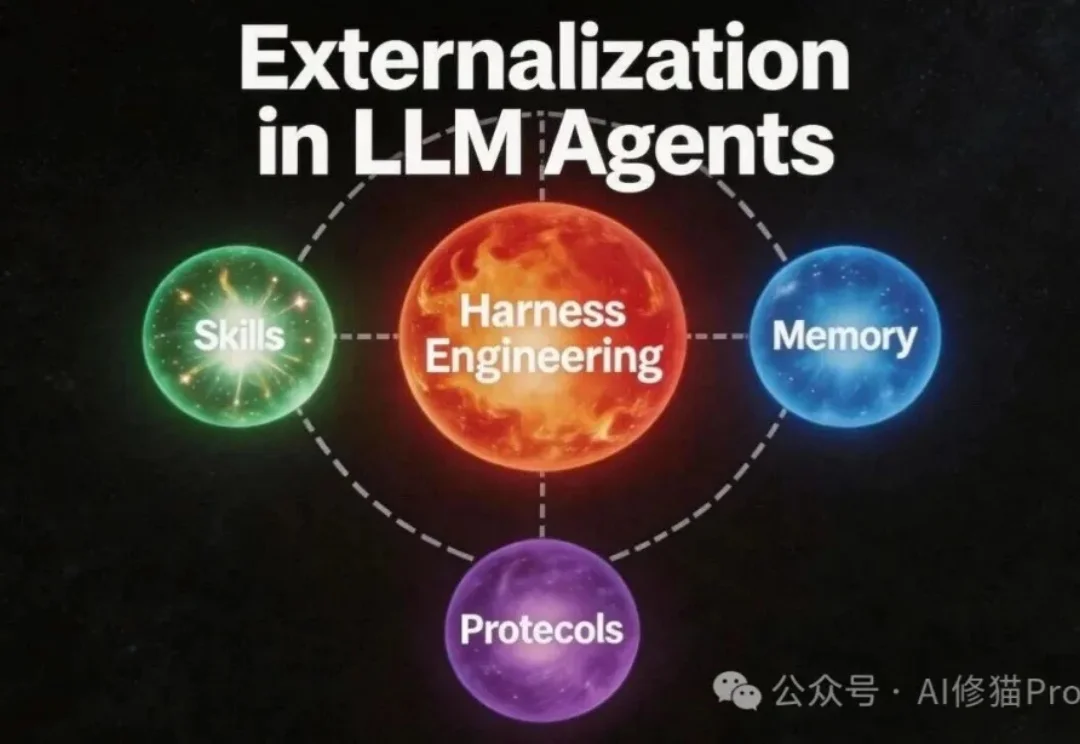

026 年初,OpenAI 和 Anthropic 几乎同时发布了关于 Harness 的技术实践文章,LangChain 工程师 Viv 给出了一个简洁的公式来概括这个理念:Agent = Model + Harness。模型提供智能,Harness 让这个智能能真正投入生产。

LangChain 联合创始人 Harrison Chase 上周发文,说透了 AI Agent 领域一个还没有多少人讲清楚的问题:外壳和记忆是同一件事,你没法分开。

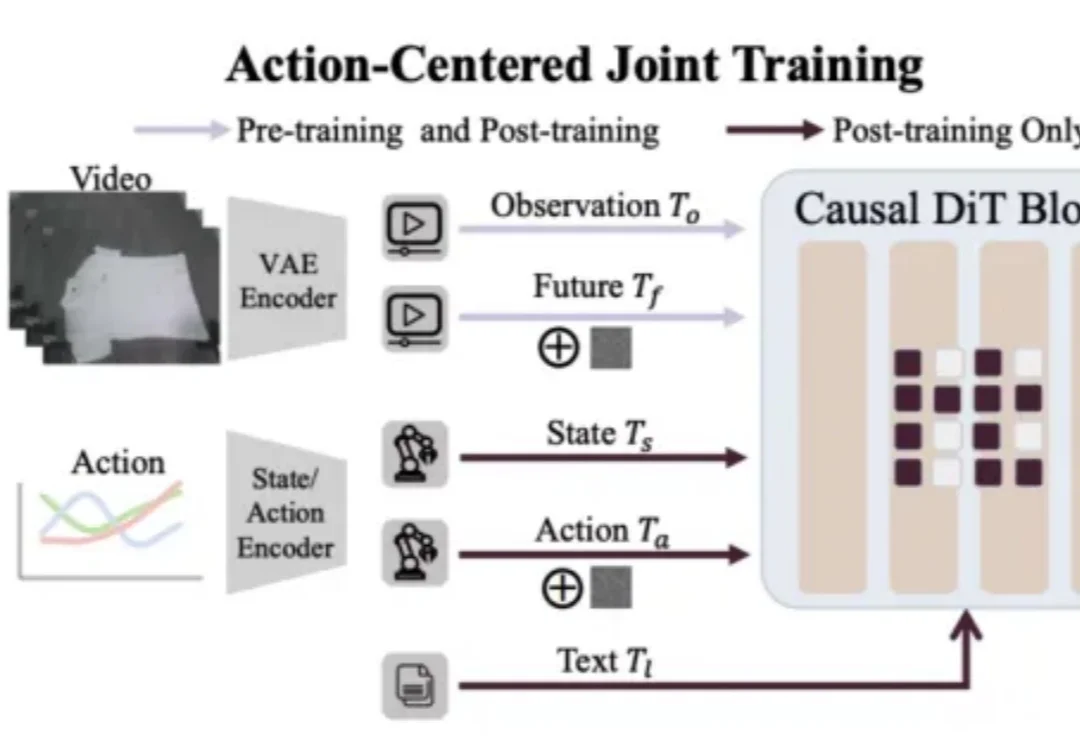

近年来研究者们一直在试图通过仿真环境批量产出具身训练数据。

距离新模型Marble 1.1&1.1-Plus发布不到一个周,李飞飞空间智能独角兽World Labs再度传来新消息—— 开源3D高斯溅射渲染引擎Spark 2.0。

太疯狂了!Anthropic刚刚发布Claude Code新版,上线神秘功能Routine:支持定时、API、GitHub三路触发,直接变身「云端员工」。更刺激的是,Opus 4.7即将本周闪电发布,直接跨界硬刚Adobe、Figma。

随着新一代主动执行型 Agent(如 OpenClaw、Hermes Agent 等)的爆发,AI 正经历从「被动工具」向「具备自我演化(Self-Evolving)能力的智能体」的范式跃迁。然而,受限于上下文窗口极限与记忆缺失,现有 Agent 难以在复杂任务中实现经验的复用与自我进化。

最近,具身智能圈被 Generalist CEO 的一篇长文《Going Beyond World Models & VLAs》刷屏。文章抛出了一个看似振聋发聩的观点:目标远比工具标签更重要。与其陷入 “我们到底是在做 VLA(视觉 - 语言 - 动作模型)还是世界模型(World Model)” 的教条之争,不如回归本源:让机器高效、准确地作用于物理世界。

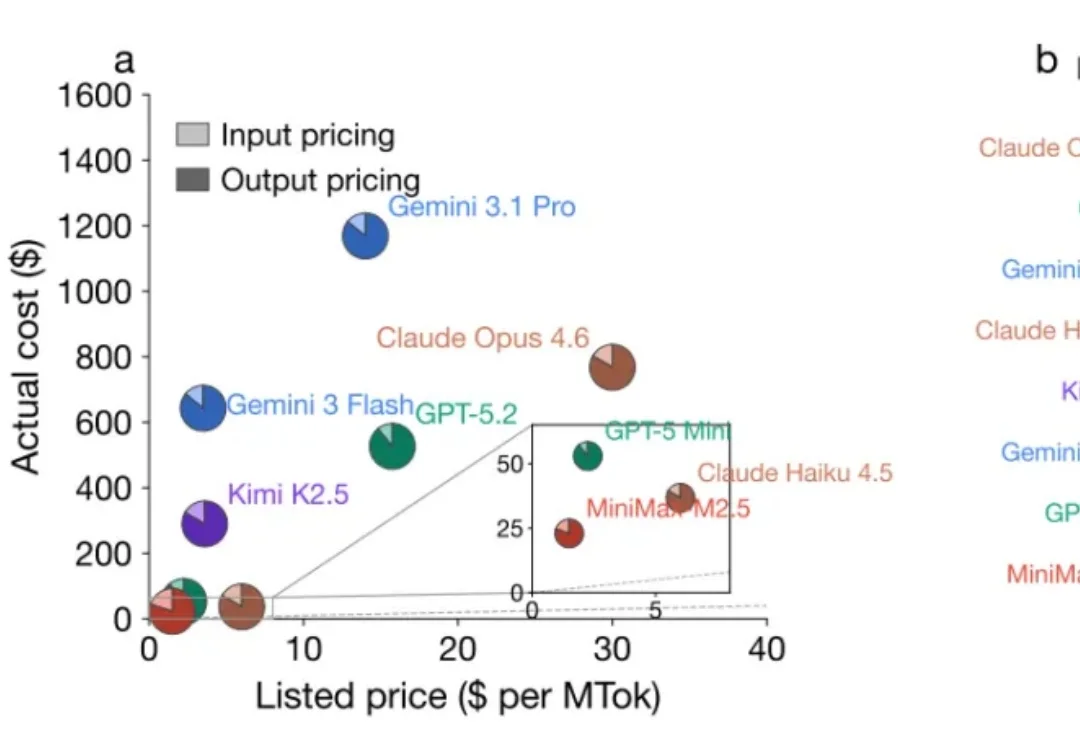

在选择使用大模型 (LLM) 时,除了模型性能强弱,价格也是一个重要指标。人们通常会用大模型的 API 定价更贵或更便宜,来比较模型的价格高低。但事实上,定价低的模型真的比定价高的模型使用起来更便宜吗?

最近,GitHub上Hermes Agent火了,仅仅几周的时间,从0涨到了7万多Star。

代码大模型会写代码,这件事已经不新鲜了。

小红书AI平台团队刚刚开源了Relax——一个为全模态数据、Agentic工作流和大规模异步训练协同设计的现代RL训练引擎!实测全异步Off-Policy模式相比共卡On-Policy吞吐提升76%,相比veRL的全异步实现提升20%!

前两天晚上,我又刷到了小 Lin 说的视频。

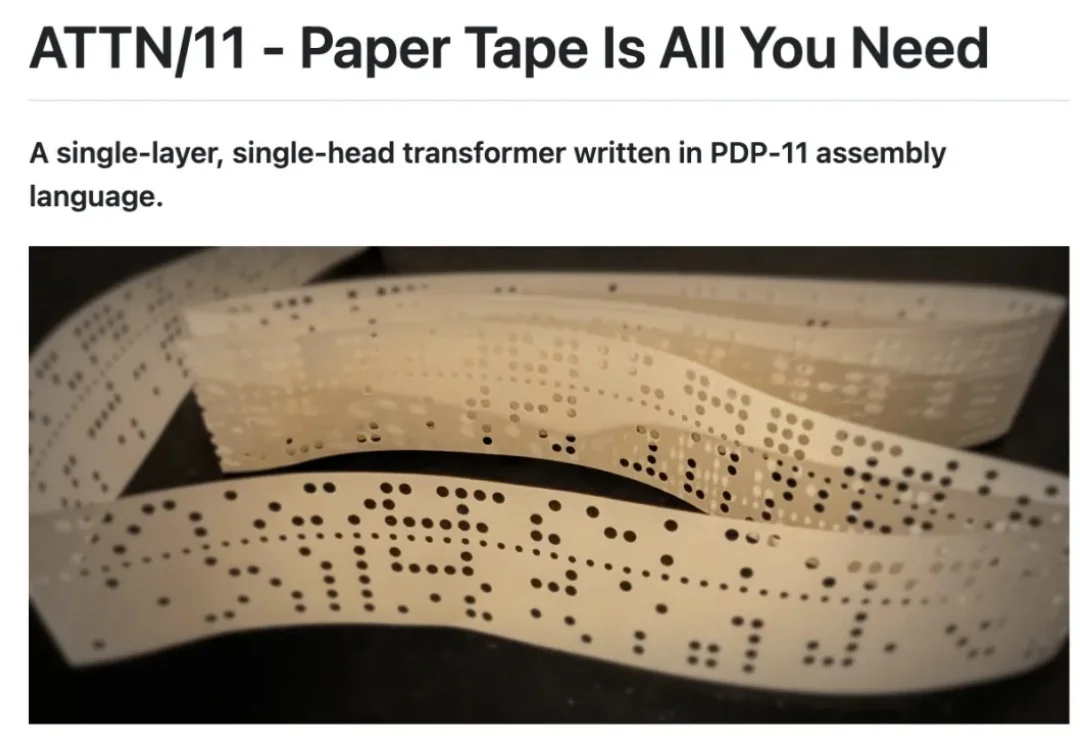

试想一下,如果把当下大火的大模型技术带回 1970 年,会发生什么?

南洋理工大学MMLab团队推出Hand2World,让AI世界模型真正「伸手」互动。只需在空中比划手势,模型就能生成逼真第一人称交互视频,实时响应调整。它摒弃旧有遮挡误导,用3D手部结构与射线编码解耦手与头运动,首次实现闭环持续交互。

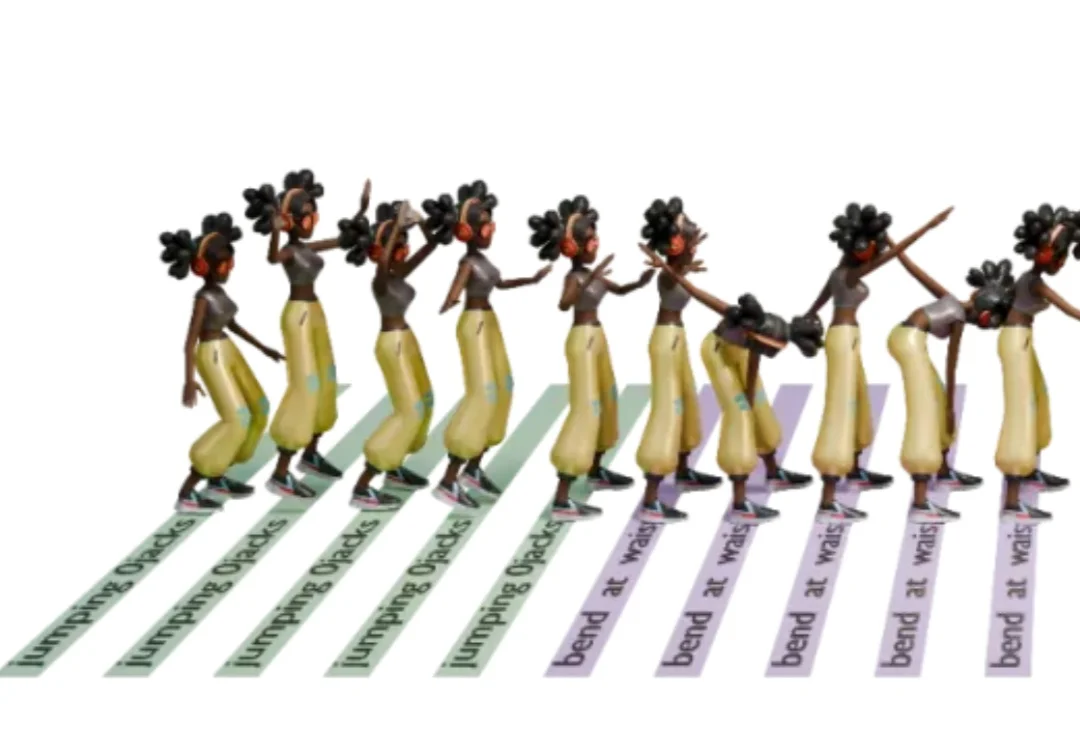

文本驱动的人体动作生成是游戏NPC、虚拟主播、机器人控制等实时交互系统的核心技术。

2026年再看Agent,一个越来越难回避的事实是:能力正在从模型里流到模型外。真正决定系统上限的,不再只是参数、Prompt和tool calling,而是记忆、技能、协议以及统摄这一切的harness。

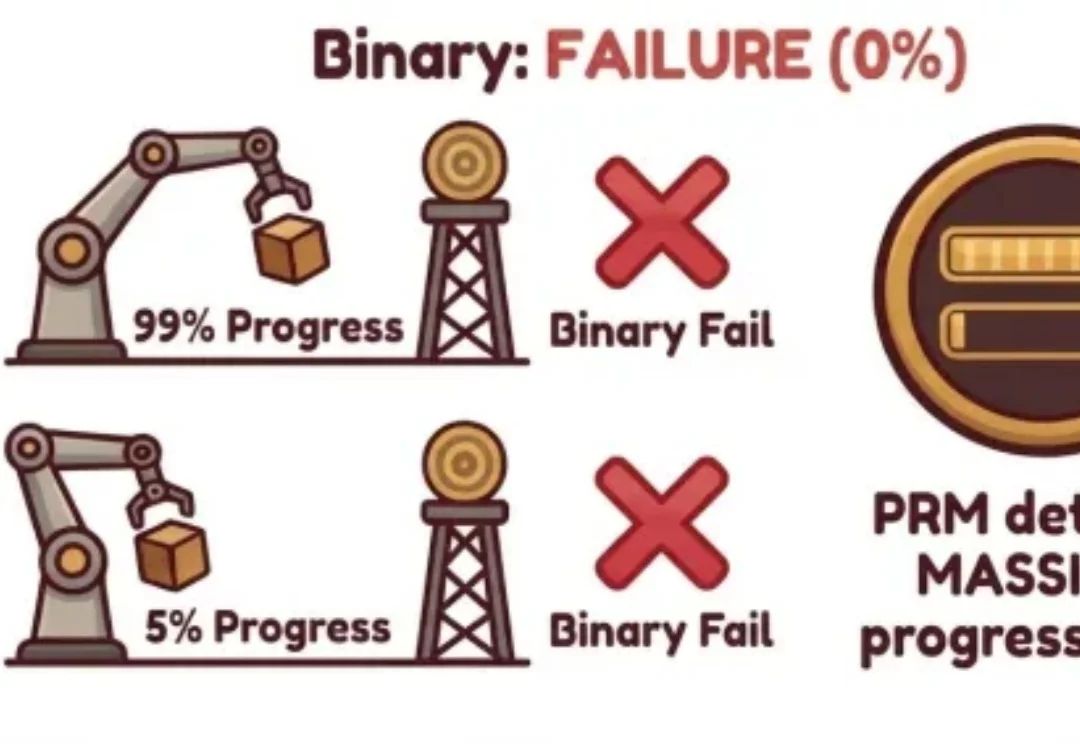

随着机器人操作从短程、单步技能逐步走向长程、富接触、需要持续协调与恢复能力的复杂任务,传统以二元成功率为核心的评测方式开始暴露出明显局限。它能够回答 “任务是否完成”,却难以回答 “策略推进到了哪里”“执行过程是否高效稳定”“失败究竟发生在什么阶段”。

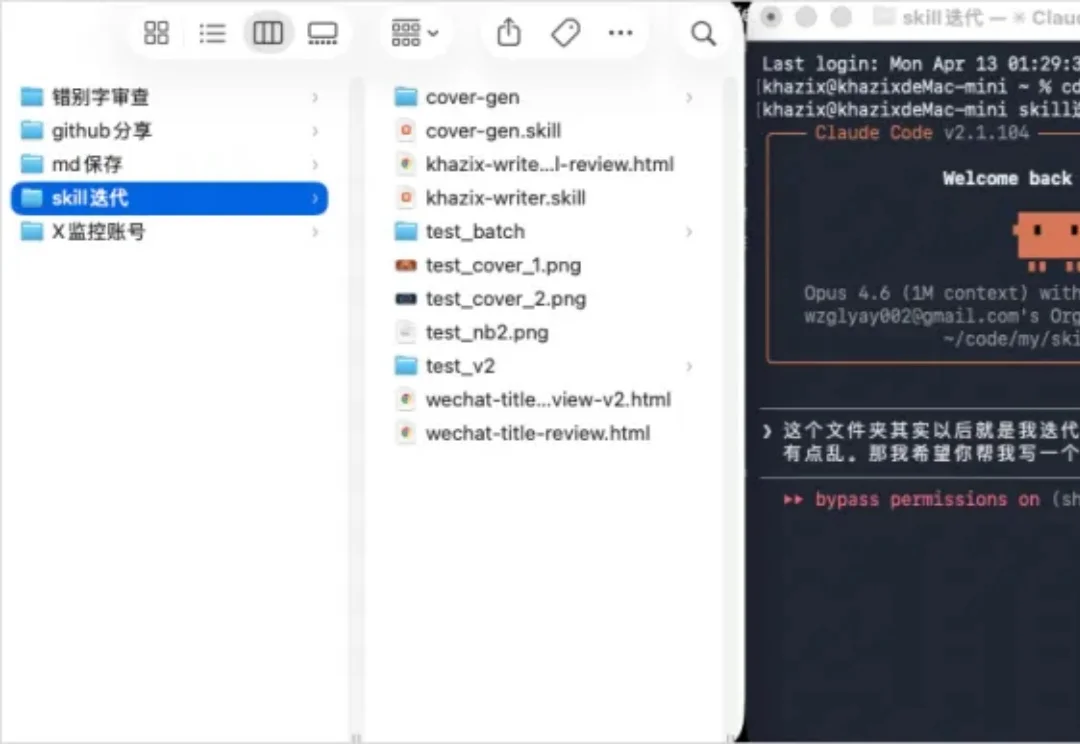

今天这篇文章,来分享一下我自己最近几个月高强度使用Agent之后,我自己总结出来的怎么给Agent设定规则,如何让它Agent更好的工作更聪明的一个非常重要的心得。

斯坦福「2026年AI指数报告」重磅出炉!这份432页长文含金量极高:中美AI巅峰对决,差距几乎抹平,缩减至仅2.7%。全球顶尖AI年产95个,基本都聚集在大厂。最残酷的是,22-25岁开发者的就业已被切掉20%。