创业快三百天,做过的10个选择:一个AI应用创业者的真实复盘

创业快三百天,做过的10个选择:一个AI应用创业者的真实复盘SophiaPro 成立于 2025 年 6 月。 最早,他们做的是一款叫 Karis.im 的 ToB 产品,给出海企业提供市场营销数字员工。后来转向 C 端产品,先是做了浏览器插件 TryClico,最近又推出了桌面端产品 Invoko.ai,一个长在 Mac 灵动岛位置的 notch 工具,帮用户在不同 app 之间自由切换上下文。

搜索

搜索

SophiaPro 成立于 2025 年 6 月。 最早,他们做的是一款叫 Karis.im 的 ToB 产品,给出海企业提供市场营销数字员工。后来转向 C 端产品,先是做了浏览器插件 TryClico,最近又推出了桌面端产品 Invoko.ai,一个长在 Mac 灵动岛位置的 notch 工具,帮用户在不同 app 之间自由切换上下文。

昨晚,开发者sir1st发布了Hermes Agent桌面版:Hermes Desktop,将先前很多人在用的Hermes Web UI打包塞进了一个桌面应用程序中,养马人不仅可以逃离命令行界面,这下连浏览器都不用打开了。

过去一年,AI 出海应用,集中爆发:Gartner 预测 2026 年全球 AI 相关支出将达到 2.53 万亿美元,预计比去年增长 44%。IDC 预测未来五年的复合增速是 31.9%,届时全球 AI IT 投资将突破万亿美元大关。

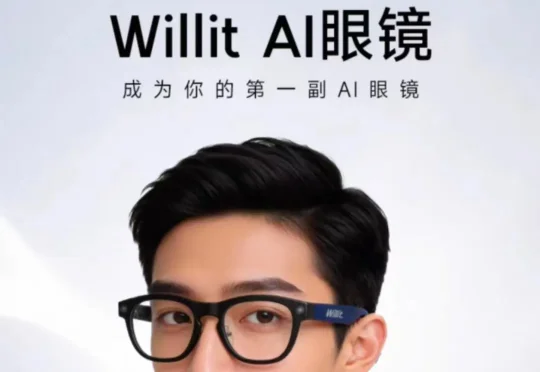

《读佳》获知,蚂蚁集团低调推出一款叫做 “Willit”的AI眼镜产品,且已在淘宝上线,眼镜适配的 “Willit AI”APP亦同步在应用市场上线。此外,适配的“Willit AI”APP已上架部分应用商店,应用宝显示其开发商、运营商、主办者均为萨思数字科技(北京)有限公司

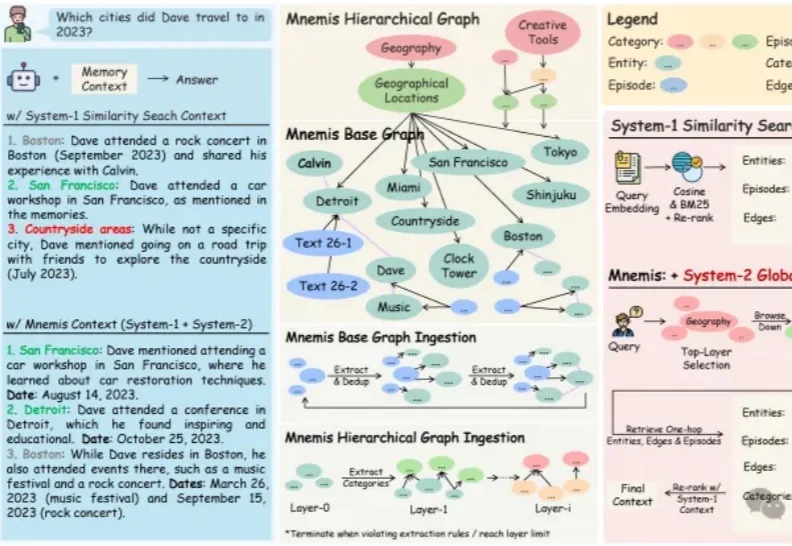

随着大语言模型在各类应用中加速落地,一个核心技术瓶颈日益凸显——AI始终缺乏真正的长期记忆能力。当前主流的RAG(检索增强生成)方案依赖语义相似度检索历史信息,但“语义相似”并不等于“真正相关”,常常出现检索结果不完整、无法区分信息相关性、缺乏推理能力等问题。

三年净利缩水近85%。

过往几个月,我们通过 MiMo Orbit、百万亿 Token 创造者激励计划等活动,让更多人有机会体验 MiMo ,并解决真实的问题——这是 MiMo 在规模化应用道路上的第一步。 而现在,随着底层

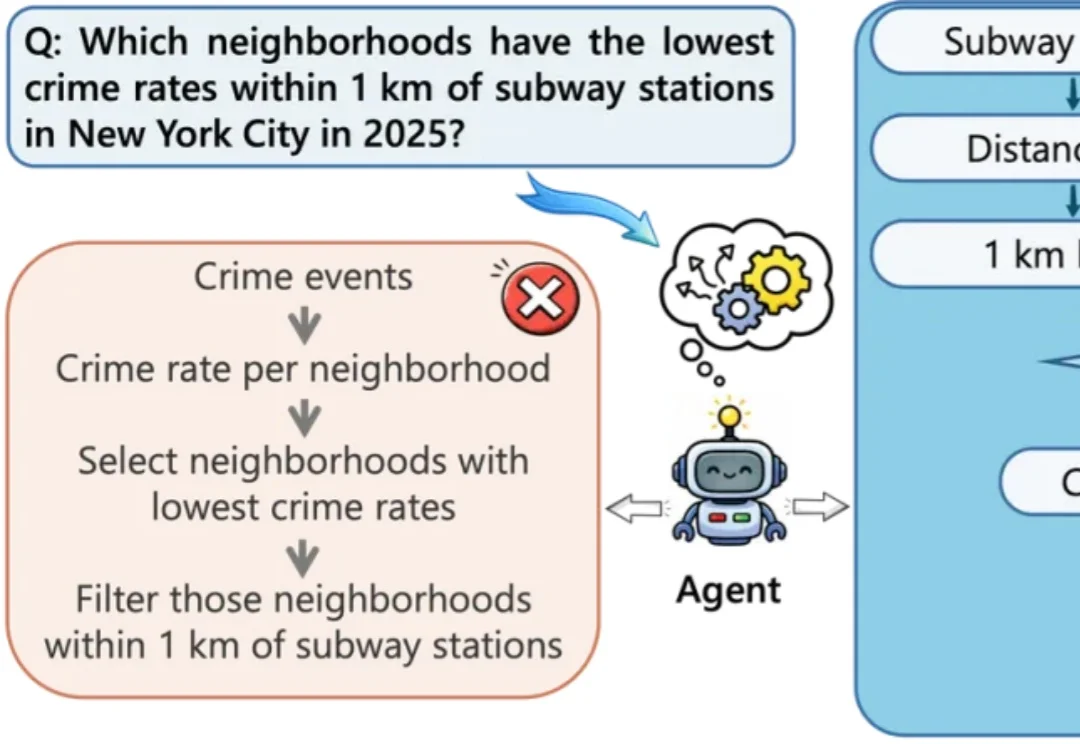

大语言模型在地图、城市、交通等空间领域的应用越来越广泛。对于这些场景来说,问题往往不只是 “查一个地点” 或 “调用一次路线 API” 就能解决的,而是需要把用户的自然语言问题组织成一段可执行、可验证的地理分析流程。

“观猹”想做的事很朴素:重新做一套AI应用的评价体系,让初创公司前期能得到公正的曝光机会。

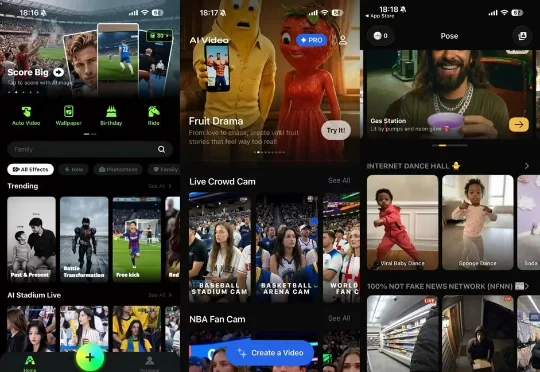

根据 Sensor Tower 发布的《2026 年全球 AI 应用趋势洞察》,2026 年第一季度,全球 AI 图像视频生成 App 的内购收入达到 1.5 亿美元,环比增长 20%,下载量达到 1.7 亿次,环比增长 12%,均超双位数。