对话EverMind:4个月做到SOTA,要给所有Agent装上长期记忆

对话EverMind:4个月做到SOTA,要给所有Agent装上长期记忆EverMind 想做点不一样的。这家由盛大集团孵化的公司,定位是为所有AI Agent提供一个通用的"记忆层"(Memory Layer)。它的核心产品EverOS是一套开源的长期记忆系统,开发者可以把它接入自己的Agent,让AI不仅能记住用户的历史对话和偏好,还能像人一样对记忆进行整理、更新,甚至从过去的经验中学习和进化。

搜索

搜索

EverMind 想做点不一样的。这家由盛大集团孵化的公司,定位是为所有AI Agent提供一个通用的"记忆层"(Memory Layer)。它的核心产品EverOS是一套开源的长期记忆系统,开发者可以把它接入自己的Agent,让AI不仅能记住用户的历史对话和偏好,还能像人一样对记忆进行整理、更新,甚至从过去的经验中学习和进化。

搭了个agent,结果该被记住的历史交互经验一点没记住,不该被记住的工具调用结果、过程输出被一股脑塞进上下文,导致输出质量下滑,类似的上下文失焦问题,这是多少人做agent时候的噩梦?

4月21日,OpenAI正式上线Chronicle研究预览版。Chronicle藏在Codex平台里,但它干的事跟写代码没半毛钱关系。它在后台默默运行,持续读取你的屏幕内容、你打开的文件、你浏览的网页、你写到一半的文档。

2026年初,当大多数企业还在用数据分析师手动写SQL查表时,OpenAI内部曝光的能自主思考、推理甚至自我进化的数据分析智能体,将数据查询从「天数级」缩短至「分钟级」。

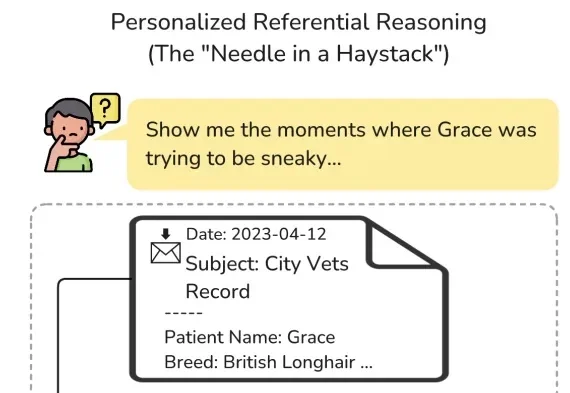

ATM-Bench 将「个人 AI 助手是否真的记得你」这件事,变成了一个研究的测试基准。结果并不乐观:专用记忆智能体系统普遍低于 20%,而 OpenClaw、Codex、Claude Code 等通用智能体普遍表现不佳,最高准确率不到 40%。

用13个月时间完成5轮融资,实现估值30倍暴涨。

全网震撼!《生化危机》女主跨界撸码,用Claude造出地表最强AI记忆系统,斩获全球首个满分。一年仅0.7美元,就能让大模型拥有永久记忆。

今天在榜单上看到一个项目:

AI 科技评论独家获悉,华为诺亚方舟决策与推理实验室主任郝建业创立“深圳忆纪元科技有限公司”(Memorax ai),创业方向聚焦AI 记忆相关的基础设施。企查查信息显示,“忆纪元科技”成立于2026年3月,法人正是郝建业本人,公司业务类型为人工智能软件。

第一篇论文来自字节SEED团队, 打了一些基础; 《Over-Tokenized Transformer》。 论文标题看上去在讨论“过度分词”。 而重点必然是在第二篇上—— DeepSeek公司的学术成果Engram。 《Conditional Memory via Scalable Lookup》 也就是Engram模块所出处的论文。