仅4B!阿里千问最强视觉模型新开源,网友:我的16GB Mac有救了

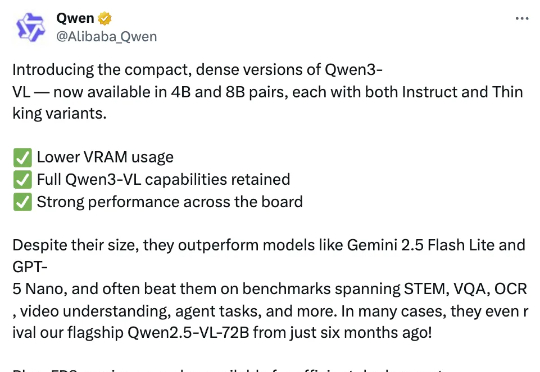

仅4B!阿里千问最强视觉模型新开源,网友:我的16GB Mac有救了智东西10月15日报道,今日,阿里通义千问团队推出其最强视觉语言模型系列Qwen3-VL的4B与8B版本,两个尺寸均提供Instruct与Thinking版本,在几十项权威基准测评中超越Gemini 2.5 Flash Lite、GPT-5 Nano等同级别顶尖模型。

搜索

搜索

智东西10月15日报道,今日,阿里通义千问团队推出其最强视觉语言模型系列Qwen3-VL的4B与8B版本,两个尺寸均提供Instruct与Thinking版本,在几十项权威基准测评中超越Gemini 2.5 Flash Lite、GPT-5 Nano等同级别顶尖模型。

游戏理解领域模型LynkSoul VLM v1,在游戏场景中表现显著超过了包括GPT-4o、Claude 4 Sonnet、Gemini 2.5 Flash等一众顶尖闭源模型。背后厂商逗逗AI,亦在现场吸引了不少关注的目光。

英伟达还能“猖狂”多久?——不出三年! 实现AGI需要新的架构吗?——不用,Transformer足矣! “近几年推理成本下降了100倍,未来还有望再降低10倍!” 这些“暴论”,出自Flash Attention的作者——Tri Dao。

Distyl AI。这家成立三年的初创公司为 T-Mobile 等企业提供所谓的"前置部署工程师"和 AI 软件,可自动化处理客户数据分析或人力资源管理等业务流程。据首席执行官 Arjun Prakash 透露,这家由数据分析软件制造商 Palantir 前员工创立的企业,在合同量激增后已完成 1.75 亿美元融资,投后估值达 18 亿美元。

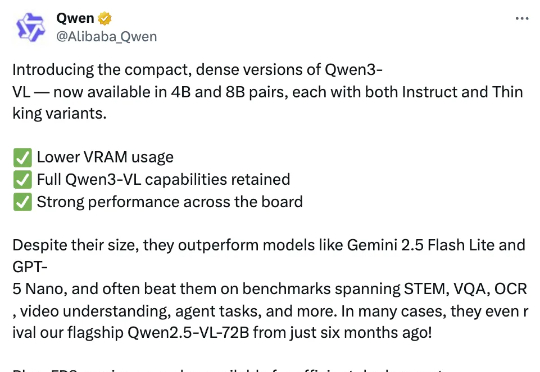

最近,美团在AI开源赛道上在猛踩加速。今天,在开源其首款大语言模型仅仅24天后,美团又开源了其首款自研推理模型LongCat-Flash-Thinking。与其基础模型LongCat-Flash类似,效率也是LongCat-Flash-Thinking的最大特点。美团在技术报告中透露,LongCat-Flash-Thinking在自研的DORA强化学习基础设施完成训练

马斯克在忙着裁人,小扎这边继续忙着挖人。 这不?Optimus AI团队负责人Ashish Kumar决定离开特斯拉,加入Meta担任研究科学家。与此同时,小扎砸钱挖人的形象已经深入人心,使得网友不禁锐评,有10亿美元吗?

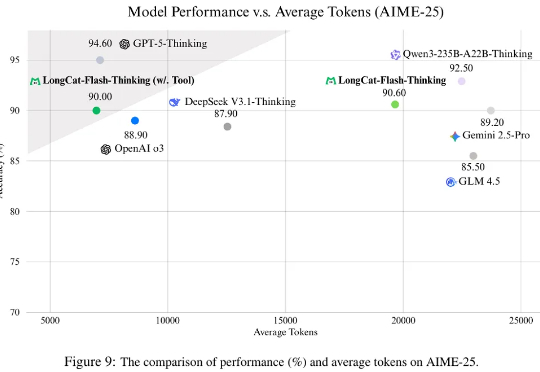

今天,蚂蚁百灵大模型团队正式开源其最新 MoE 大模型 ——Ling-flash-2.0。作为 Ling 2.0 架构系列的第三款模型,Ling-flash-2.0 以总参数 100B、激活仅 6.1B(non-embedding 激活 4.8B)的轻量级配置,在多个权威评测中展现出媲美甚至超越 40B 级别 Dense 模型和更大 MoE 模型的卓越性能。

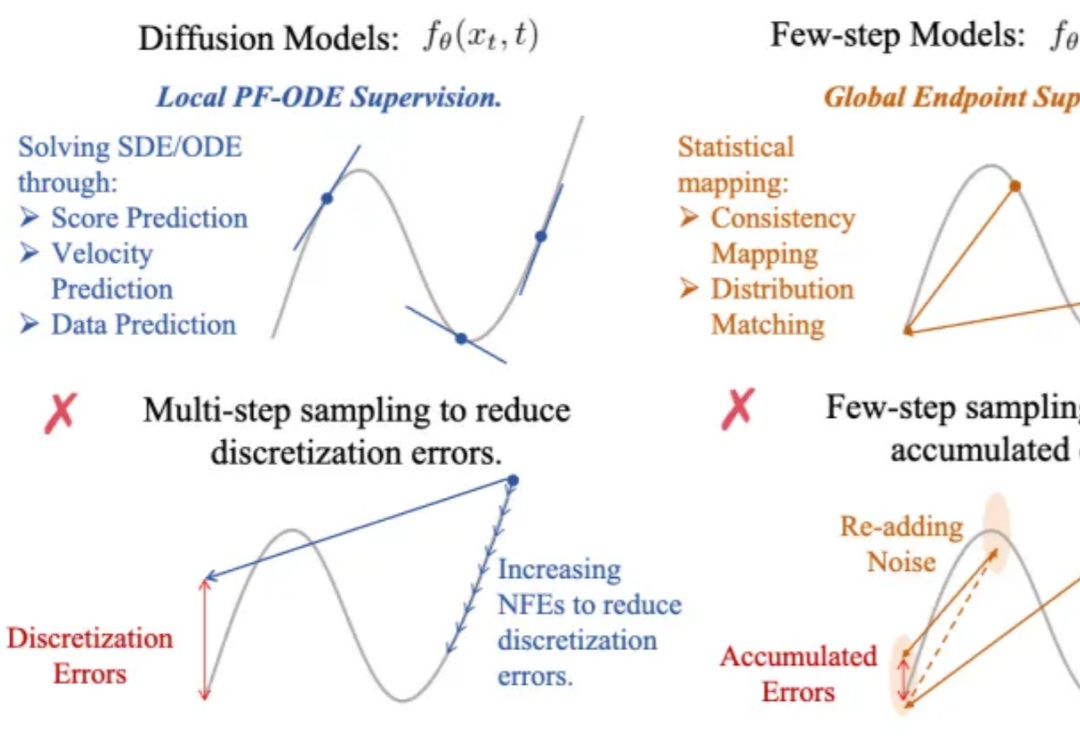

生成式AI的快与好,终于能兼得了?

谷歌这只「香蕉」火得有些疯狂:Nano Banana(即 Gemini 2.5 Flash Image)自 8 月底上线以来,仅用几周就吸引了超过 1,000 万新用户,并在 Gemini 应用中完成了 2 亿次图像编辑请求

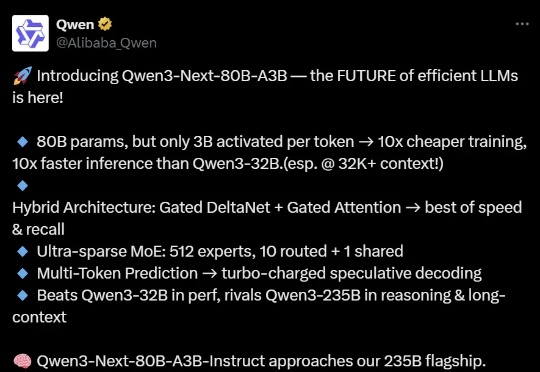

训练、推理性价比创新高。 大语言模型(LLM),正在进入 Next Level。 周五凌晨,阿里通义团队正式发布、开源了下一代基础模型架构 Qwen3-Next。总参数 80B 的模型仅激活 3B ,性能就可媲美千问 3 旗舰版 235B 模型,也超越了 Gemini-2.5-Flash-Thinking,实现了模型计算效率的重大突破。