GPT-5.5参数有10T?病毒式论文刚刚被打假,实际缩水至1.5T

GPT-5.5参数有10T?病毒式论文刚刚被打假,实际缩水至1.5T五一假期前,AI社区被一篇「GPT-5.5拥有近10万亿参数」的论文刷屏,今天这项研究就被研究者打假了!研究者表示,修正论文中的各种问题后,GPT-5.5的参数很可能约为1.5T。

五一假期前,AI社区被一篇「GPT-5.5拥有近10万亿参数」的论文刷屏,今天这项研究就被研究者打假了!研究者表示,修正论文中的各种问题后,GPT-5.5的参数很可能约为1.5T。

一不小心,查理芒格和巴菲特就被炼化,个个加入投资Agent军团,人人可用了。

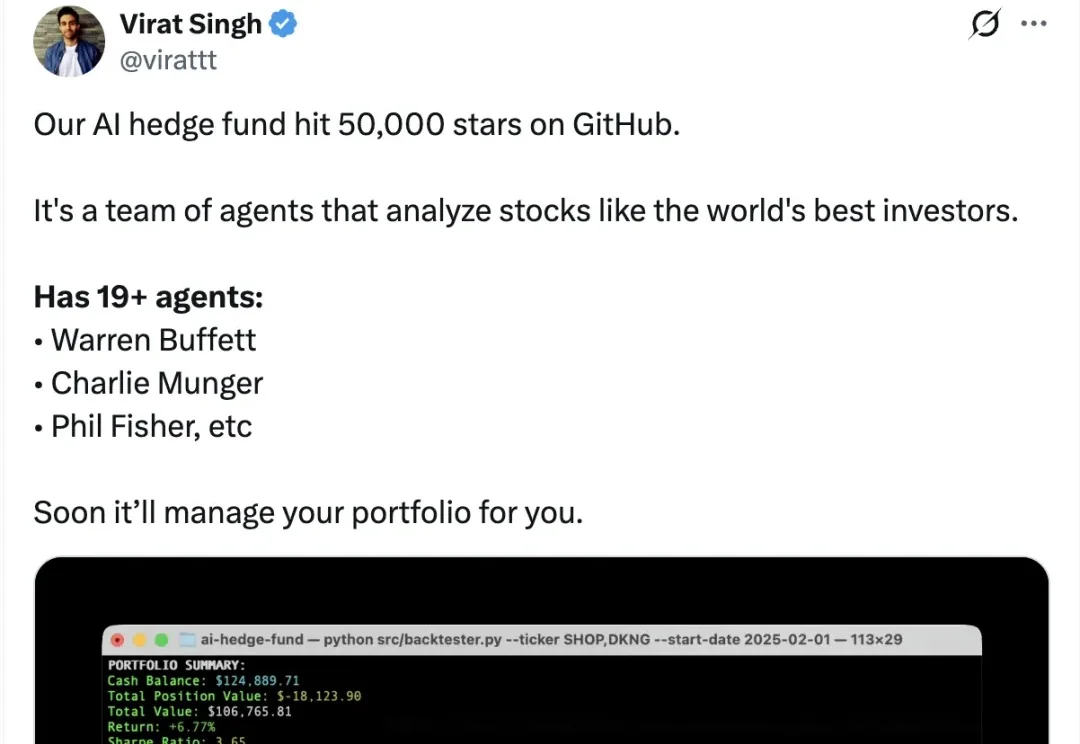

一家叫 Rallies Arena 的团队,6 个月前干了一件事:给 6 个主流大模型各发了 10 万美元,让它们在真实股票市场上自己做研究、自己下单、自己管仓位。

面壁智能为你单独造了个“养虾池”,把数据、模型、“龙虾”都留在本地。

为了 OPC 设计的开源“龙虾”架构,要安全,更要有用。

刚刚,AI医疗新突破,来自谷歌!这一次,他们直接瞄准了真实临床环境的痛点。为此,谷歌祭出了最新模型MedGemma 1.5,找到了破局答案。相较于此前的MedGemma 1.5,MedGemma 1.5在多模态应用上实现重大突破,融合了:

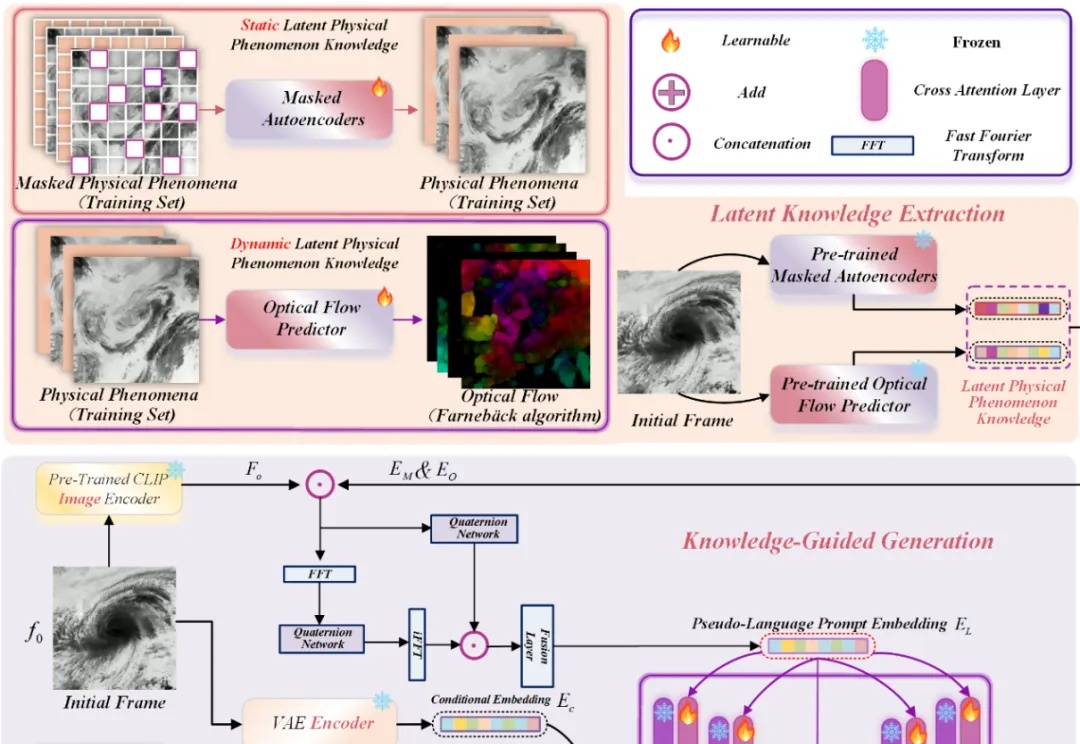

近年来,Stable Diffusion、CogVideoX 等视频生成模型在自然场景中表现惊艳,但面对科学现象 —— 如流体模拟或气象过程 —— 却常常 “乱画”:如下视频所示,生成的流体很容易产生违背物理直觉的现象,比如气旋逆向旋转或整体平移等等。

目前,最先进的对齐方法是使用知识蒸馏(Knowledge Distillation, KD)在所有 token 上最小化 KL 散度。然而,最小化全局 KL 散度并不意味着 token 的接受率最大化。由于小模型容量受限,草稿模型往往难以完整吸收目标模型的知识,导致直接使用蒸馏方法的性能提升受限。在极限场景下,草稿模型和目标模型的巨大尺寸差异甚至可能导致训练不收敛。

过去一周,我把主流 AI 浏览器都体验了个遍。 OpenAI 的 Atlas、Perplexity 的 Comet、Browser Company 的 Dia,再加上 Edge Copilot,市面上最火的 AI 浏览器,各有各的亮点,也各有各的坑。浏览器的未来长啥样?这些产品给出了完全不同的答案。

HTEC团队利用英飞凌的PSoC Edge处理器,研究探讨了如何使用深度神经网络 (DNN) 预测 DC-DC 转换器的最佳占空比,重点在于识别最相关的输入特征,以提高性能和可靠性。