斯坦福MIT天团出手!1美元养龙虾,图文视频全包,打工人神外挂

斯坦福MIT天团出手!1美元养龙虾,图文视频全包,打工人神外挂别人还在卷单点能力,Agnes已经把文本Agent、图像、视频和办公自动化打包进开发者工具箱:1美元「养龙虾」,外加图像、视频、PPT一条龙,给出的不是零散的能力点,而是一整套AI生产力。

搜索

搜索

别人还在卷单点能力,Agnes已经把文本Agent、图像、视频和办公自动化打包进开发者工具箱:1美元「养龙虾」,外加图像、视频、PPT一条龙,给出的不是零散的能力点,而是一整套AI生产力。

你正在地铁上,突然想起有个API文档还没写完。以前你只能忍着到公司再弄,现在——你掏出手机,给AI发了一条指令,20分钟后代码自动跑完了。 这不是科幻,是Google员工已经用上的真东西。 它的名字叫

动点出海获悉,总部位于泰国的AI软件公司Amity宣布完成1亿美元D轮融资。Amity称,这也是迄今东南亚生成式AI领域规模最大的单笔融资之一。据了解,本轮融资由EDBI领投,Asia Partners、SMDV、CMLIM Capital等机构参投。完成本轮融资后,Amity累计融资金额达到1.6亿美元。此前,Amity曾于2024年完成6000万美元C轮融资。

最近,社交媒体上一个帖子火了: MIT 学生如何用 48 小时学完一学期的课?

在当前的 LLM 开发中,后训练阶段通常被视为赋予模型特定能力的关键环节。传统的观点认为,模型必须通过强化学习(如 PPO、GRPO 或 RLHF)和进化策略(ES)等算法,在反复的迭代和梯度优化过程中调整权重,才能在特定任务上达到理想的性能。

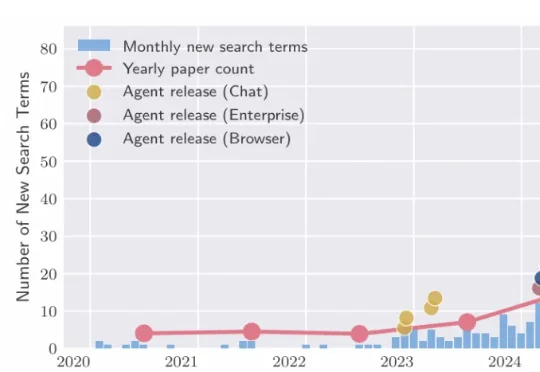

Ben在视频中提到了一个令人震惊的数据对比。虽然ChatGPT的使用率在飞速增长,企业也在疯狂尝试各种AI解决方案,但真正能看到商业价值的却少之又少。根据MIT的研究,在供应商销售的AI解决方案中,只有5%的试点项目最终进入了生产环境。Deloitte(德勤)发现只有15%的组织表示他们从AI中获得了显著的、可衡量的ROI。

过去,科学家观察研究细胞的工具很有限。

这两周,Claude Code 上了个 COBOL 现代化功能,IBM 当天暴跌 13%;又上了个安全扫描功能,一口气翻出 500 多个此前藏了几十年的高危漏洞,网安股集体跳水。彭博社甚至专门做了一期播客讨论“哪些 SaaS 公司能活下来”。

过去一年,大模型写代码的能力几乎以肉眼可见的速度提升。从简单脚本到完整功能模块,GPT、Claude、DeepSeek 等模型已经能够在几秒钟内生成看起来相当 “专业” 的代码。

"我最初装上Codex时说,绝不会让它完全控制我的电脑。这句话大概坚持了两小时。"OpenAI CEO Sam Altman在Cisco AI Summit上坦承,自己现在用两台笔记本电脑工作——一台