独家|字节首个付费“豆包会员”将推出,AI大模型免费时代转向了

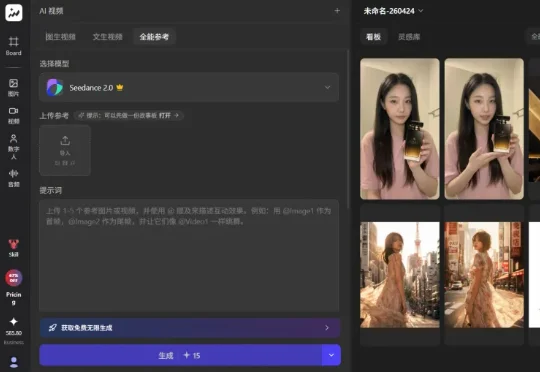

独家|字节首个付费“豆包会员”将推出,AI大模型免费时代转向了独家获悉,字节跳动旗下AI应用“豆包”最快将于5月中下旬上线首款付费包月产品:豆包会员。具体来说,豆包会员分为标准版、加强版、专业版三个版本,iOS版内购价格最低68元人民币起,最高年费达5088元,会员权益有望增加Seedance 2.0生视频额度等功能。

搜索

搜索

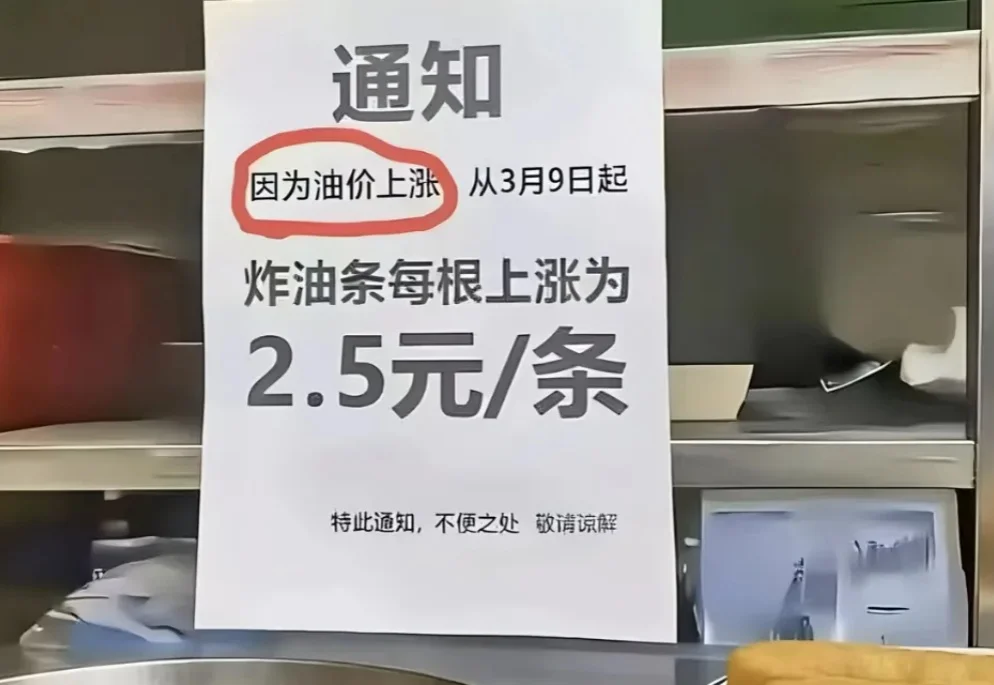

独家获悉,字节跳动旗下AI应用“豆包”最快将于5月中下旬上线首款付费包月产品:豆包会员。具体来说,豆包会员分为标准版、加强版、专业版三个版本,iOS版内购价格最低68元人民币起,最高年费达5088元,会员权益有望增加Seedance 2.0生视频额度等功能。

维塔流动宣布完成数千万元人民币 Pre-Seed 轮融资,由锦秋基金领投,百度风投跟投。所募资金将主要用于产品研发与市场推广。旗下产品 Jovida 定位面向 C 端用户的主动式 Life Agent,围绕个人生活场景,帮助用户完成从目标感知、路径规划到行动执行的闭环。

做过 AI 视频的都懂,除了 Seedance 2.0 本身的高定价,废片所烧掉的 token 算力也是一笔不小的开支。但在 Topview 平台,直接把这笔最大试错成本给重新定义了!热门视频生成模型 Seedance 2.0,加上最新的图片生成模型 Image 2,订阅 Ultra Plan,可不限量使用。

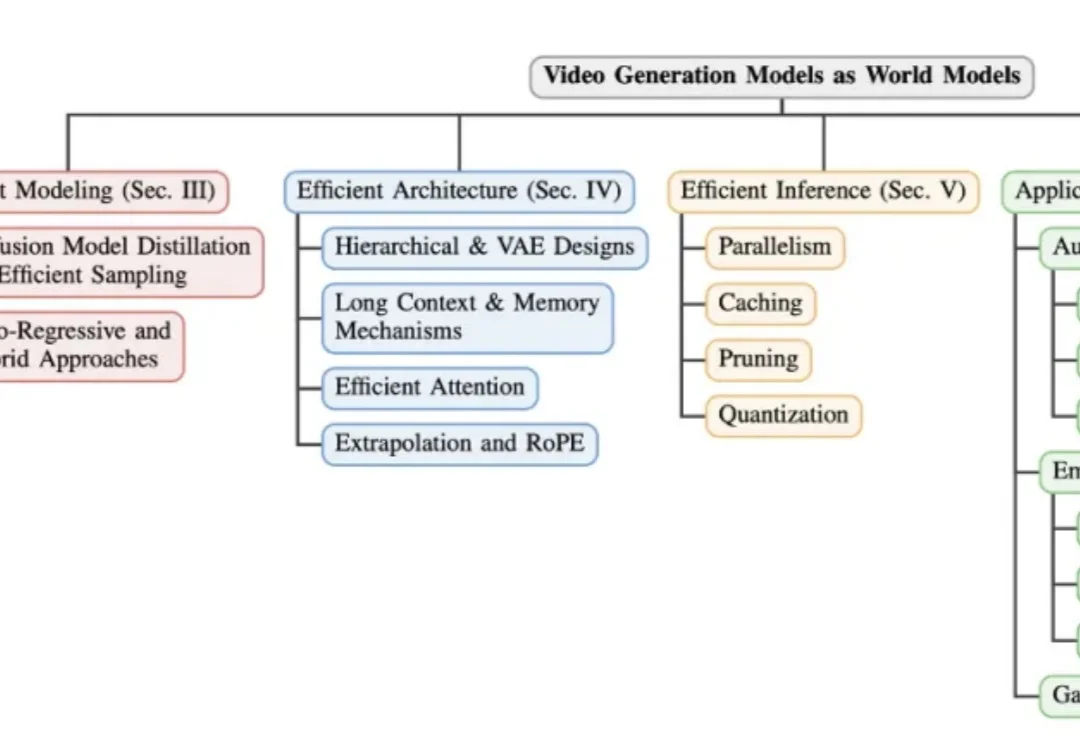

还记得两年前,AI 生视频可谓是「鬼畜专区」—— 人物多一根手指算基操,走路自带鬼步舞才是常态。结果转眼间,从 OpenAI 的 Sora 到字节跳动的 Seedance,这些模型已经开始一本正经地「模拟世界」了:水会流、球会弹、光影能追踪,俨然一副要当「物理引擎」的架势。

看到标题《这个模型让机器人长出了嘴》,你可能会心生疑惑: AI不是早就懂语音播报了吗?

前段时间有个叫 Happy Horse 的模型实火了一把,在知名 AI 评测分析平台 Artificial Analysis 上,直接把 Seedance 2.0 挤到了第二。

现象级AI视频技术、字节Seedance 2.0在arXiv发论文了。晒了26页的Benchmark,和贡献者名单。170位团队成员全公开,署名和尊重都拉满了,不过嘛这就不怕……嘛?

Claude最强“神话”模型,可能用到来自字节的技术?

“你好,老板,你这个视频我们用即梦Seedance 2.0 生成,这一条视频报价1235.25元人民币,我们分分钟就可以用这1609.45元做出来这条视频,这可是仅仅2235.32元人民币就能换来的视频爆款,都不知道有多划算,我们产出一条视频仅需要一天,白天开工,到了晚上您只需要支付3245.98元就可以了,现在签合同吗?”

字节Seed最新研究,让大模型能“原地改参数”了。既不用改模型结构,也不用重新训练,还跑得很快。具体是这么个情况。智能体时代嘛,大家都知道模型们面对的任务开始变得越来越复杂、上下文越来越长。