林俊旸提出离职后,阿里高管紧急答疑 — 林俊旸离职内幕

林俊旸提出离职后,阿里高管紧急答疑 — 林俊旸离职内幕北京时间3月4日下午约13:00,通义实验室紧急召开了All Hands会议,阿里集团CEO吴泳铭向千问员工坦诚表示。12个小时前(北京时间3月4日凌晨0点11分),阿里千问大模型技术负责人林俊旸在X上突然宣布离职——林俊旸是阿里AI开源模型的核心推手,也是阿里最年轻的P10之一——行业一片哗然之时,Qwen的部分成员也无法接受团队灵魂人物的突然出走。

北京时间3月4日下午约13:00,通义实验室紧急召开了All Hands会议,阿里集团CEO吴泳铭向千问员工坦诚表示。12个小时前(北京时间3月4日凌晨0点11分),阿里千问大模型技术负责人林俊旸在X上突然宣布离职——林俊旸是阿里AI开源模型的核心推手,也是阿里最年轻的P10之一——行业一片哗然之时,Qwen的部分成员也无法接受团队灵魂人物的突然出走。

AI打工利器杀入Windows桌面了!阿里QoderWork新版全面上线,多种Skills无限扩展。首测效果惊艳,19页硬核PPT一键支出,班味儿秒散。

在今年的MWC巴塞罗那展会上,整个科技圈都在关注“智能跃升”这个话题。

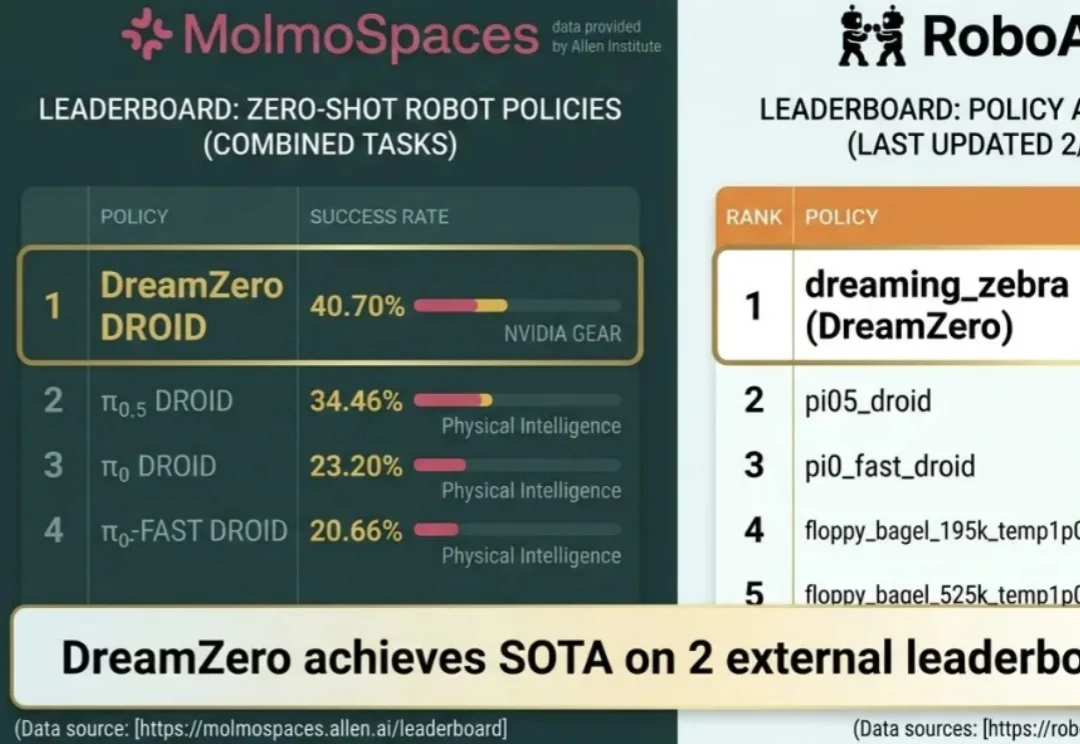

近日,NVIDIA 发布的世界 - 动作模型 DreamZero,在两项颇具代表性的机器人基准测试 RoboArena 、MolmoSpaces 上双双登顶。

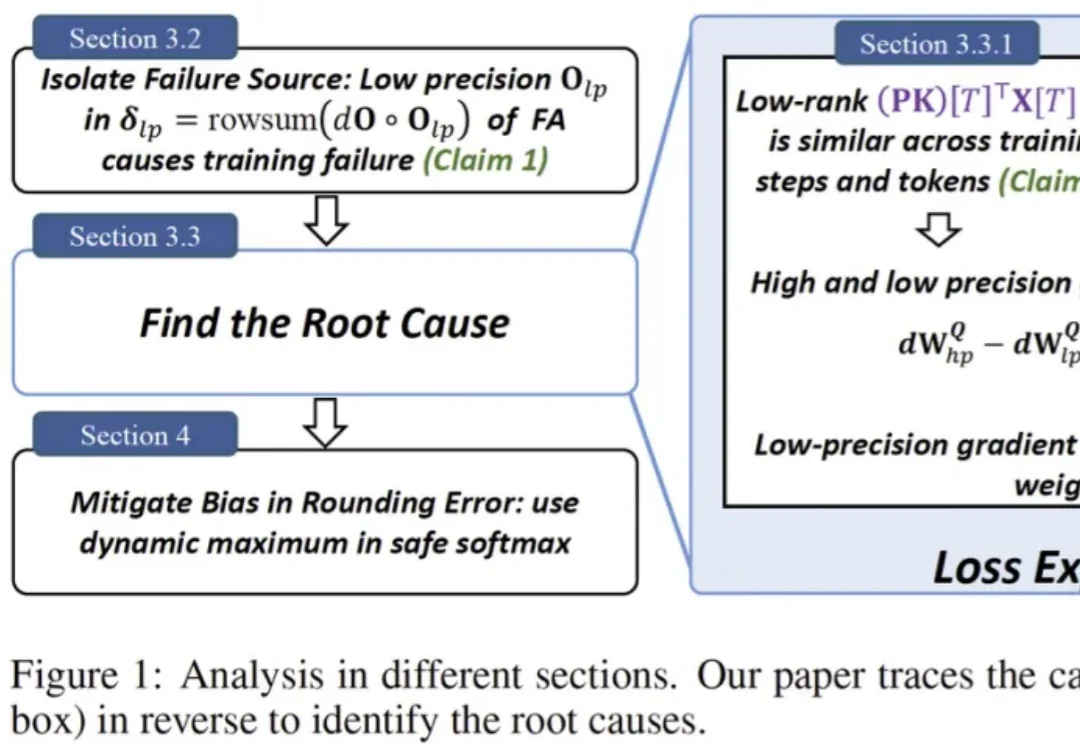

一句话总结:社区里困扰了多年的一个 “玄学” 现象终于被拆解清楚了:在 BF16 等低精度训练里,FlashAttention 不是随机出 bug,而是会在特定条件下触发有方向的数值偏置,借助注意力中涌现的相似低秩更新方向被持续放大,最终把权重谱范数和激活推到失控,导致 loss 突然爆炸。论文还给出一个几乎不改模型、只在 safe softmax 里做的极小修改,实测能显著稳定训练。

如果科研中的文献阅读、代码演进、实验验证都可以由智能体自主完成,科学发现的方式会被重新定义吗?自主科研智能体(Autonomous Research Agent)的兴起,正在把这一设想带入现实:科学家有望回归科学品味和探索源头,智能体承担科研全链路的繁琐工作,两者在人机协同的闭环中共探新的重大科研突破。

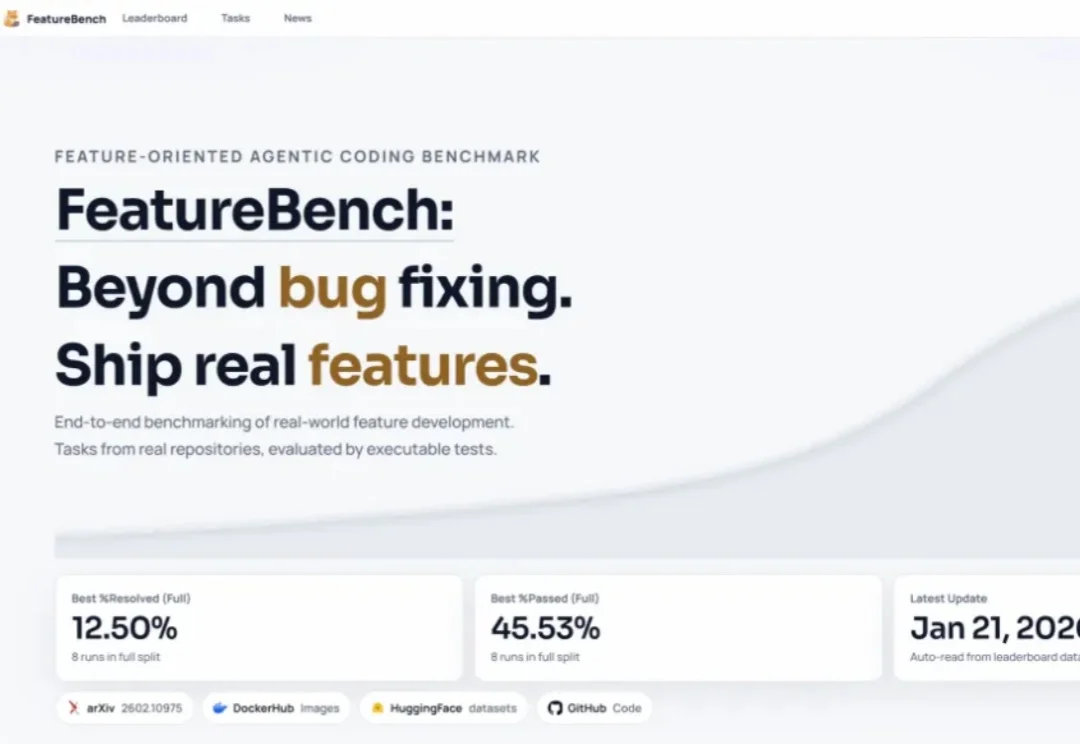

在 Princeton 发布 SWE-Bench 之后,用真实世界代码仓库+可执行测试评测大模型软件工程能力,几乎已成为学术界与工业界的共识。围绕 SWE issue 的评测范式迅速发展,也催生了一系列 SWE 系列 benchmark,在刻画模型 bug 修复能力方面发挥了重要作用。

小雨智造预计,智能焊接机器人需求可达千万台量级,只要占据10%份额,就完全具备成为“爆品”的市场条件。

最近关于OpenClaw的事,除了我昨天说的Github登顶之外。还有另一个非常魔幻的事——就是OpenClaw收费上门安装。一次费用,几百不等。更离谱的价格也有,前段时间在群里看到的:OpenClaw安装,1.6万!?

近日,Flowith 宣布完成千万美元种子轮和种子+轮融资。种子轮为祥峰投资(Vertex Ventures)等机构,种子+轮为红杉中国种子基金、江远投资(LongRiver)等多家顶尖机构联合领投,融资资金将主要用于研发以及全球化市场拓展。