英伟达全模态大模型 Nemotron 3 Nano Omni 来了,几秒搞定老黄3分钟演讲,吞吐量同类9倍

英伟达全模态大模型 Nemotron 3 Nano Omni 来了,几秒搞定老黄3分钟演讲,吞吐量同类9倍英伟达于昨日正式推出全新多模态推理模型Nemotron 3 Nano Omni,将文本、视觉、语音三大模态能力深度融合至单一模型体系,目前可免费使用。

英伟达于昨日正式推出全新多模态推理模型Nemotron 3 Nano Omni,将文本、视觉、语音三大模态能力深度融合至单一模型体系,目前可免费使用。

SenseNova U1 是商汤最新发布的一个开源的多模态模型,它的 Lite 系列 8B 和 A3B 参数版本,目前已经在 Hugging Face 和 GitHub 上开源。APPSO 也提前拿到了测试资格,我们发现商汤这款新一代原生理解生成统一模型,就开源模型来说,已经做到了最好水平。

就在刚刚, DeepSeek 上线了识图模式,显示正在灰测中。这意味着讨论了一整年的 DeepSeek 多模态能力,终于来了!目前 DeepSeek 网页版和 App 更新后都有可能被灰测到识图模式,APPSO 第一时间给大家进行了实测。

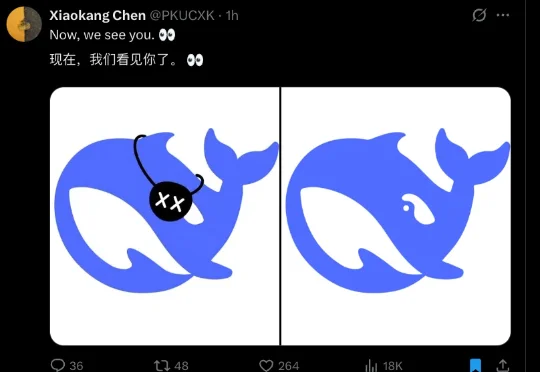

这个生物医学视觉推理框架,被CVPR 2026接收了!

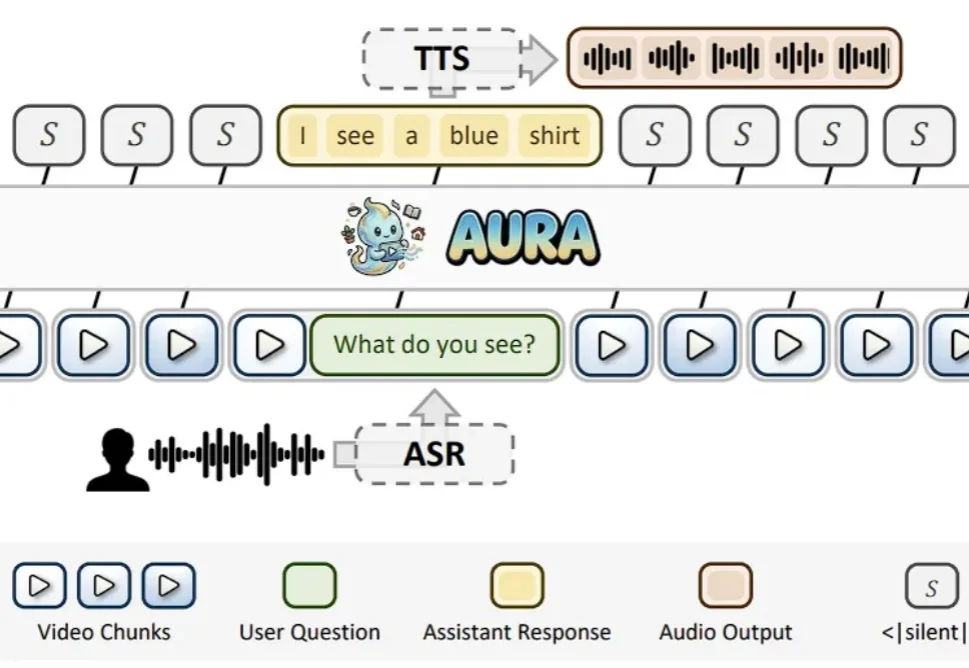

近年来,视频多模态大模型(VideoLLM)发展迅猛,在视频描述、视频问答、时序定位等任务上不断刷新性能上限。随着模型能力持续增强,业界也开始思考一个更重要的问题:视频大模型能不能不再只是 “看完一段视频再回答”,而是真正进入实时世界,持续观察、实时理解,并在关键时刻主动给出反馈?

近日,AI内容电商OS K2Lab宣布再次完成数千万元天使轮融资,这也是K2Lab三个月以来完成的第二轮融资,本轮融资由华控资本领投、云时资本跟投,心流资本FlowCapital担任长期财务顾问。本轮融资资金将用于A2A原生电商Agent OS建设、多模态垂直模型打造、海外用户规模化增长和AI Native团队的持续建设。

就在刚刚,成立恰满一个月的阿里ATH(Alibaba Token Hub)事业群,发布全球首个主动式实时交互的世界模型产品。名也挺有趣的,叫HappyOyster(快乐生蚝)。HappyOyster搭载原生多模态架构,背后是支持多模态输入与音视频联合生成的流式生成世界模型,核心主打漫游(Wander)、导演(Direct)、创造(Create)、分享(Share)。

近日,国内多模态生成式人工智能公司智象未来(HiDream.ai)宣布完成超5亿元新一轮融资。本轮融资由东方富海、安徽省投资集团旗下的省产业投资公司、峰华资本等新股东联合投资,同时合肥产投、兴泰集团、合肥高投、安徽省人工智能母基金等老股东持续加注。

今日,腾讯正式发布并开源混元3D世界模型2.0(HY-World 2.0)。作为一款多模态的世界模型,HY-World 2.0支持文字、图片和视频等形式输入,可自动生成、重建并模拟完整的3D世界。

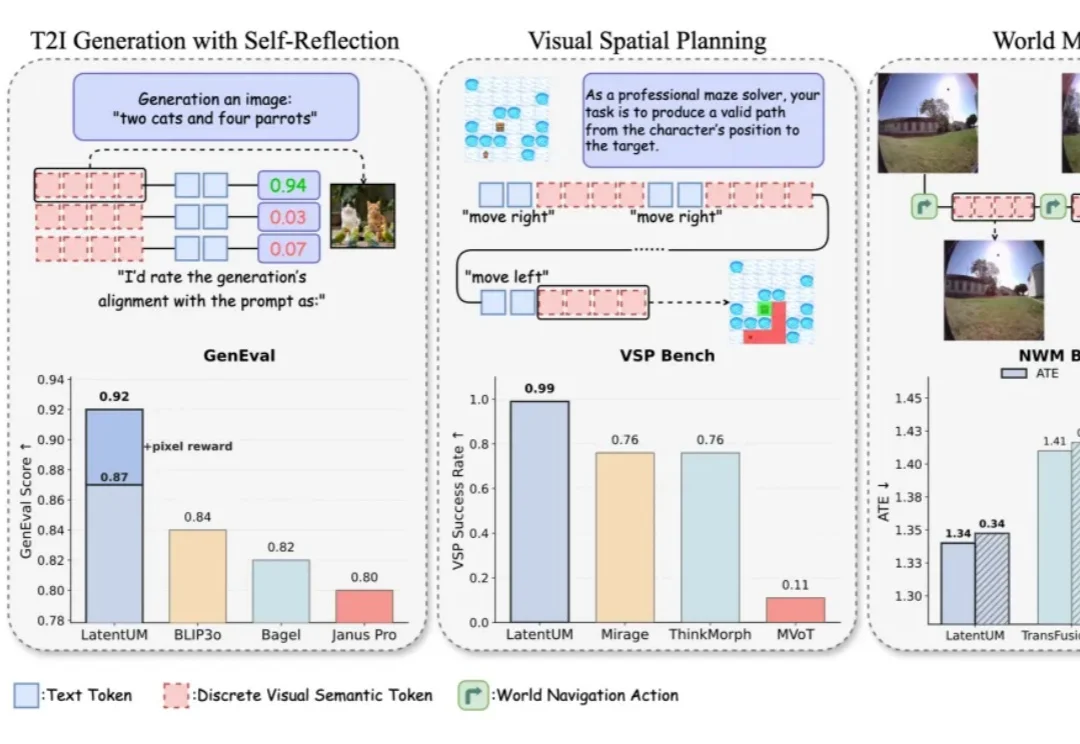

过去一段时间,生成理解统一模型(Unified Model)经常被理解成一种「既能看懂图、又能生成图」的多模态通用系统。