OpenAI拆开AI「黑箱」,终于可以看懂GPT在想什么了

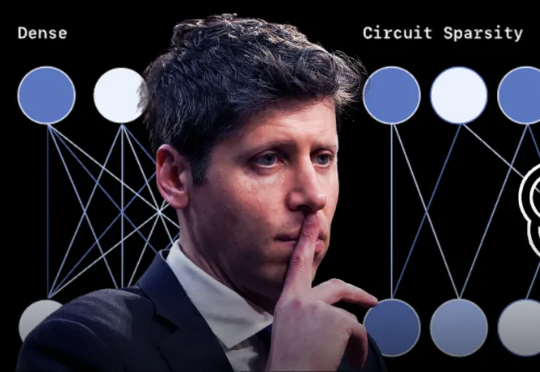

OpenAI拆开AI「黑箱」,终于可以看懂GPT在想什么了刚刚,在理解大模型复杂行为的道路上,OpenAI又迈出了关键一步。他们从自己训练出来的稀疏模型里,发现存在结构小而清晰、既可理解又能完成任务的电路(这里的电路,指神经网络内部一组协同工作的特征与连接模式,是AI可解释性研究的一个术语)。

搜索

搜索

刚刚,在理解大模型复杂行为的道路上,OpenAI又迈出了关键一步。他们从自己训练出来的稀疏模型里,发现存在结构小而清晰、既可理解又能完成任务的电路(这里的电路,指神经网络内部一组协同工作的特征与连接模式,是AI可解释性研究的一个术语)。

随着现在的主流大模型都能轻松通过图灵测试,这个持续了数十年的标准开始逐渐过时。奥特曼和量子计算之父David Deutsch讨论得出了一个新的图灵测试2.0标准,可以更好地衡量究竟怎样AI才算拥有真正的智能。

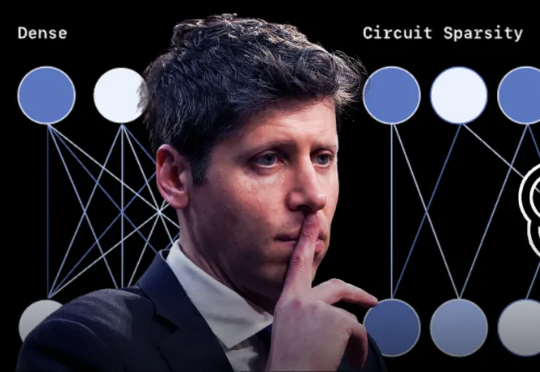

多模态大语言模型(MLLMs)在处理来自图像和文本等多种来源的信息时能力强大 。 然而,一个关键挑战随之而来:当这些模态呈现相互冲突的信息时(例如,图像显示一辆蓝色汽车,而文本描述它为红色),MLLM必须解决这种冲突 。模型最终输出与某一模态信息保持一致的行为,称之为“模态跟随”(modality following)

大模型编程最近太猛了。

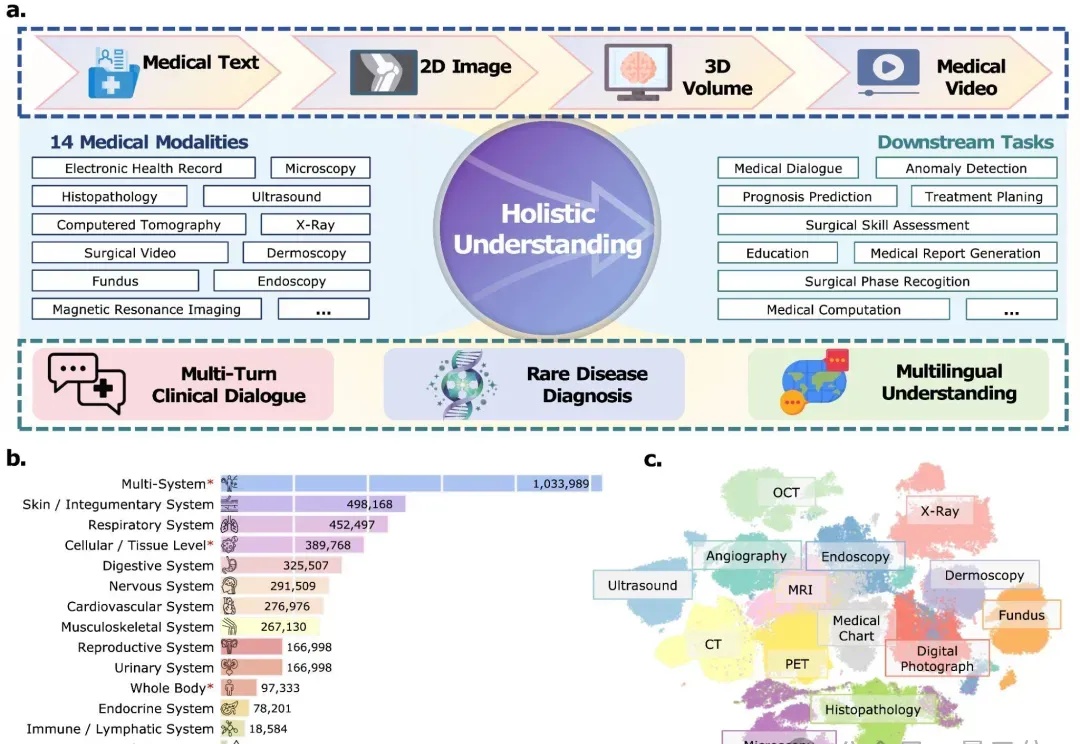

从影像诊断到手术指导,从多语言问诊到罕见病推理—— 医学AI正在从“专科助手”进化为“全能型选手”。

中国最早进行医疗大模型后训练的创新企业之一 ——杭州全诊医学科技有限公司(以下简称“全诊医学”)正式宣布完成1亿元B轮融资:2024年4季度由A股上市公司“创新医疗”(SZ.002173)完成战略轮投资;2025年2季度由中国医药工业百强“好医生集团”完成B轮投资,探针资本担任本轮融资的独家财务顾问。

微软AI负责人Mustafa Suleyman表示,只有生物体才能具备意识,开发者和研究人员应该停止追求让AI具有意识。

就在今天,罗福莉以C位之姿,首次对外官宣了小米任职。刚刚,罗福莉在X上高调宣布——正式加入小米,出任MiMo团队负责人。智能的进化必然会从语言世界走向物理世界,解锁多模态的空间智能——具备感知、推理、生成与行动的能力,这是实现真正通用人工智能(AGI)的关键一步。

华中科技大学团队推出首个水下多模态大模型NAUTILUS,支持8种水下场景理解任务,并开源145万图文对的NautData数据集。模型通过视觉特征增强模块解决水下图像模糊和颜色失真问题,性能超越现有模型,恶劣环境下表现更佳。

临床诊断并非一次性的「快照」,而是一场动态交互、不断「探案」的推理过程。然而,当下的大模型大多基于静态数据训练,难以掌握真实诊疗中充满不确定性的多轮决策轨迹。如何让AI学会「追问」、选择检查,并一步步抽丝剥茧,迈向正确诊断?