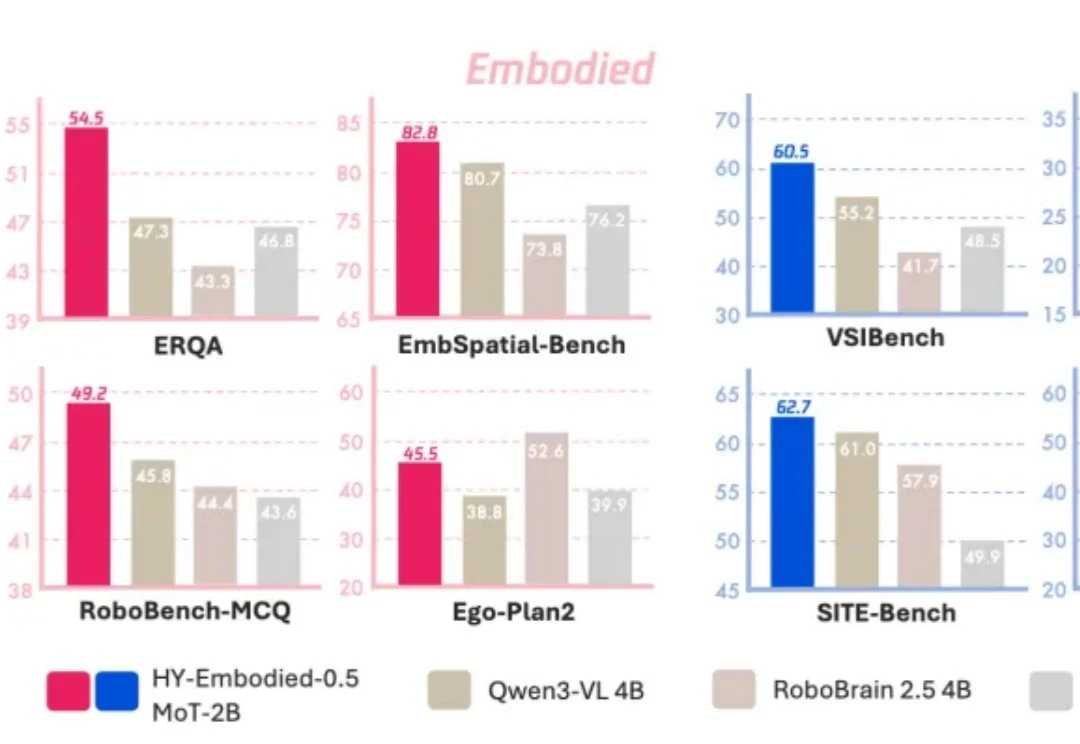

MoE不够看了,腾讯推出MoT:2B具身模型22项评测16项最佳

MoE不够看了,腾讯推出MoT:2B具身模型22项评测16项最佳让大模型真正走进现实世界,是当下最迫切的需求之一。

搜索

搜索

让大模型真正走进现实世界,是当下最迫切的需求之一。

RL之后,大模型为什么更容易「越训越单一」?面对五花八门的改进思路,也许答案并不复杂:先试着改一改KL项。

被动成为新一代 AI 黄埔军校的字节跳动。

大模型(LLM)的世界知识和推理能力是实现下一代推荐系统,即基于大模型的推荐系统(LLM4Recsys)的重要基石。来自meta ai的研究者们尝试将推理模型引入再排序阶段,推荐系统的最后一环。

刚刚,Meta 重金组建的超级智能实验室(SML)交卷!这也是年轻华人 Alexandr Wang 带领该团队后,交出的首份成绩。全新自研模型 Muse Spark 上线。

全网震撼!《生化危机》女主跨界撸码,用Claude造出地表最强AI记忆系统,斩获全球首个满分。一年仅0.7美元,就能让大模型拥有永久记忆。

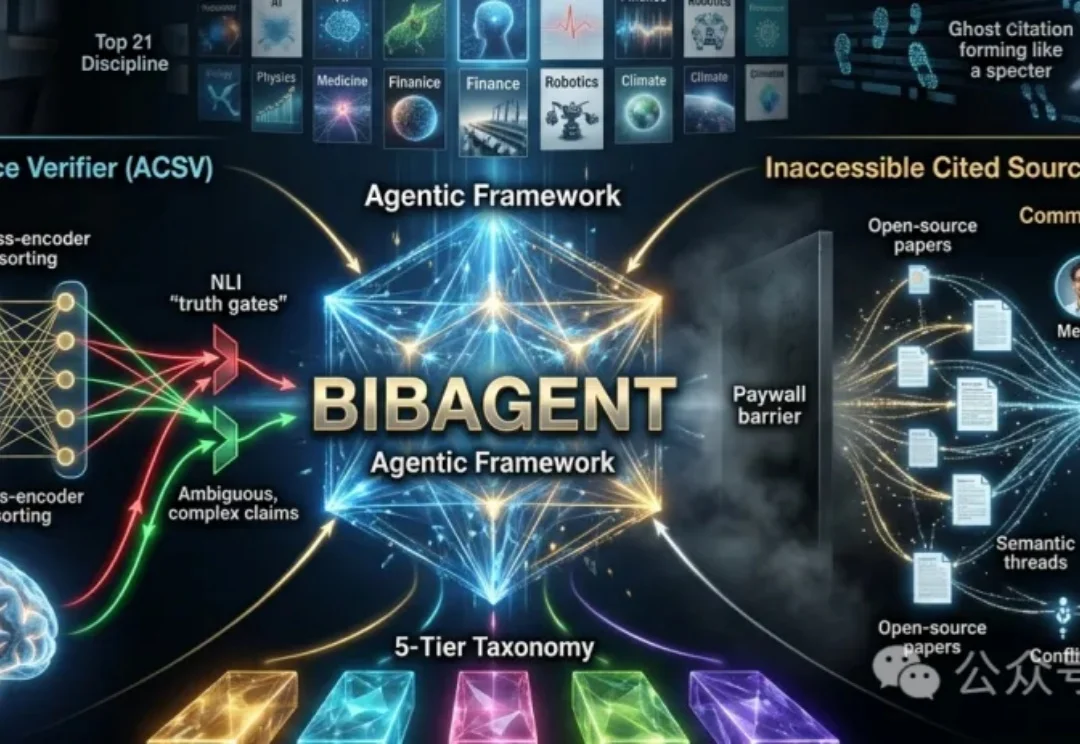

大模型正在批量生成「看起来很像真的」学术论述,但这些论述背后的引用,真的成立吗?更关键的是:当被引论文被付费墙锁住、原文根本读不到时,自动化核验是否就注定失效?

LangChain 只换了模型外面的基础设施——同一个模型、同一套权重——就从 TerminalBench 2.0 排行榜 30 名开外直接跳到了第 5 名。另一个独立研究项目让大模型自己优化这层基础设施,达到了 76.4% 的通过率,超过了所有人工设计的方案。

OpenAI和Anthropic的上市竞速,是硅谷最受关注的一场IPO竞赛。

一家叫 Rallies Arena 的团队,6 个月前干了一件事:给 6 个主流大模型各发了 10 万美元,让它们在真实股票市场上自己做研究、自己下单、自己管仓位。