性能暴涨100倍!AI抗体模型迎历史级突破,连斩礼来、辉瑞两大巨头!

性能暴涨100倍!AI抗体模型迎历史级突破,连斩礼来、辉瑞两大巨头!近日,AI制药独角兽Chai Discovery宣布与制药巨头辉瑞达成许合作许可。合作后辉瑞将获得Chai Discovery首次曝光的新一代模型Chai-3的优先访问权限,以及利用辉瑞专有数据、量身定制的定制模型。

搜索

搜索

近日,AI制药独角兽Chai Discovery宣布与制药巨头辉瑞达成许合作许可。合作后辉瑞将获得Chai Discovery首次曝光的新一代模型Chai-3的优先访问权限,以及利用辉瑞专有数据、量身定制的定制模型。

复盘三年多的AI行情,就是一个不断找硬件瓶颈的过程:最开始涨GPU,后来涨服务器,再后来涨数据中心,然后涨电力,接着涨HBM存,现在又开始涨CPU、高速互联和ASIC。

近日,欧拉万象正式宣布再次完成超过亿元的天使轮融资,这也是欧拉万象三个月以来完成的第三轮融资。本轮融资由某产业资本、慕华科创、百度风投、玖兆投资、聚合资本联合投资,老股东持续跟投。这是欧拉万象继获得高瓴创投、五源资本、招商局创投等顶级机构密集加持后,再次迎来市场化与产业资本的重磅加注。

官宣全球顶尖医院,微软要为AI医疗定制一款大模型!

训练大模型时,工程师绝对不会指望网络做一次前向传播就能收敛。它需要数据喂养、Batch切分、学习率控制、验证集筛选以及优化器状态的迭代试错。

都以为让AI查数据省事,结果它答得漂亮你却不敢信。Anthropic最近说这事有解了,靠的是一套和代码无关的「笨功夫」。

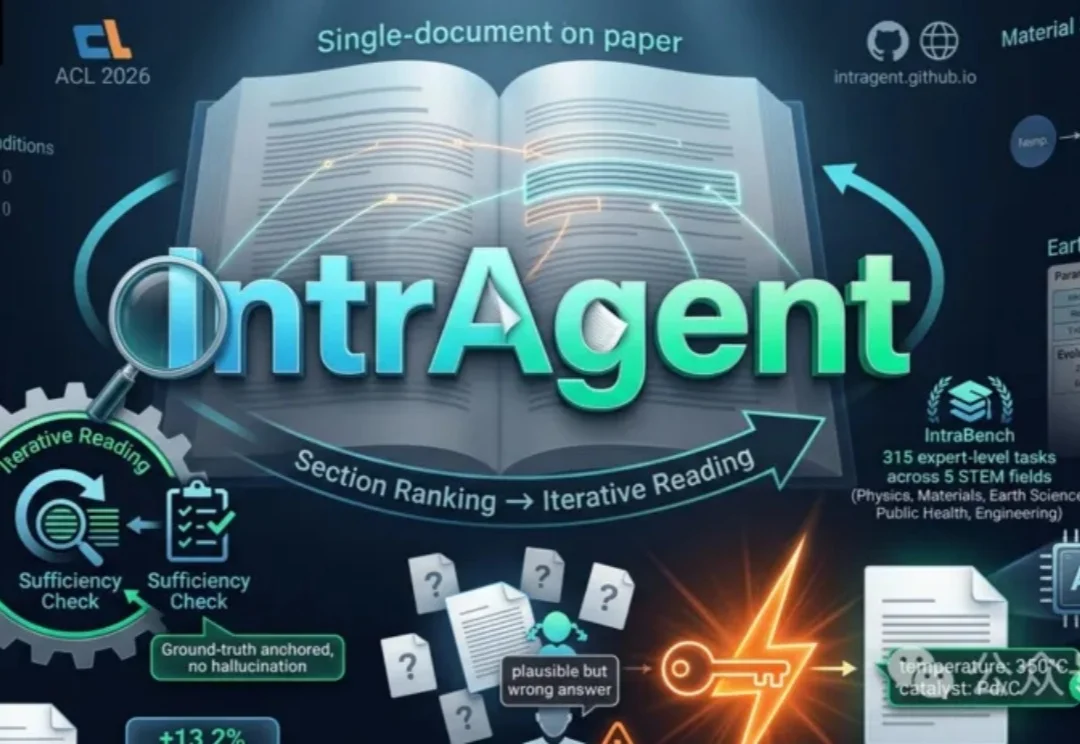

为解决科研中对单篇文献深度解析的需求,佐治亚大学团队提出IntrAgent,专注单篇内容,避免大模型幻觉。通过段落排序与迭代阅读机制,精准提取实验细节与元数据。

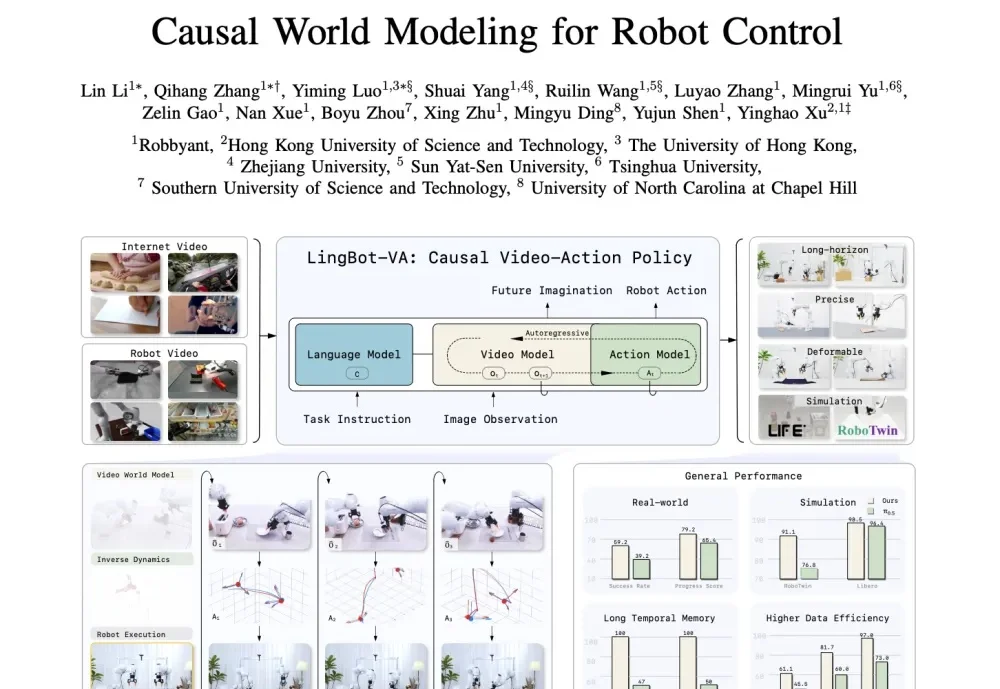

赋予机器人物理理解和预测能力是通用操作的关键。蚂蚁灵波等机构提出的 LingBot-VA 试图将视频帧预测与动作推理统一起来,让机器人通过自回归扩散框架学会“一边思考一边行动”。

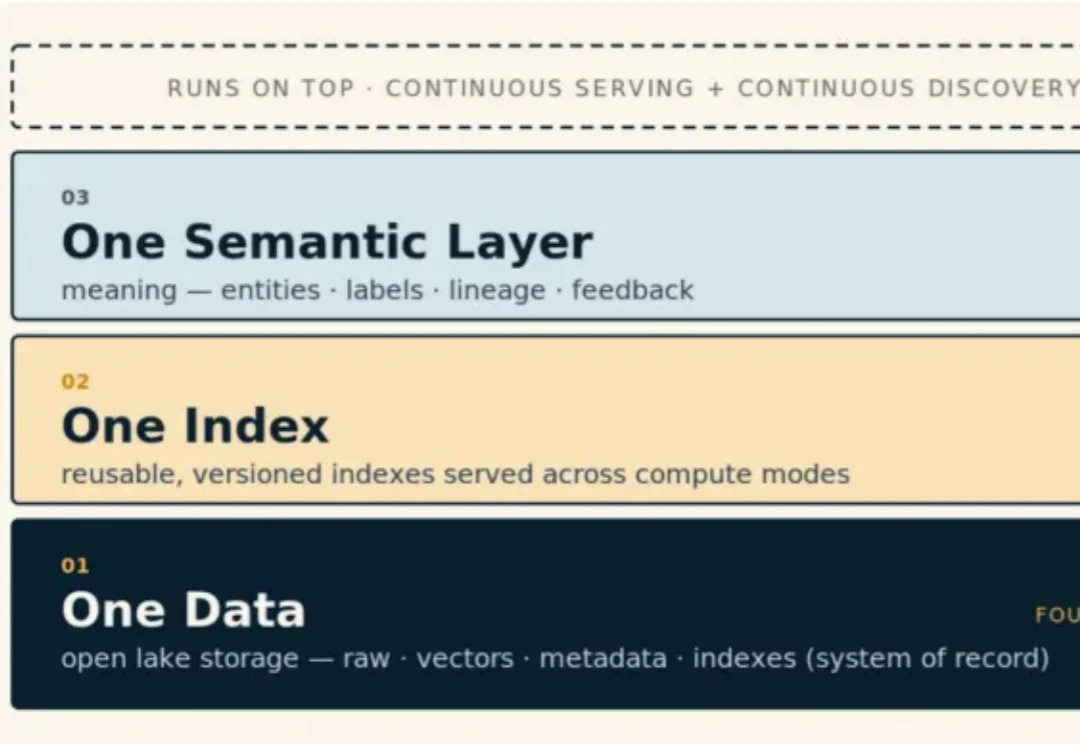

这篇文章想回答几个大家更关心的基础问题:Vector Lakebase 能解决你的什么问题,什么场景下用它最合适,如何用好Vector Lakebase 。

过去半年,几乎所有Agent框架都在补长期记忆能力。最常见的做法,是给系统接一个向量数据库,把历史对话、用户偏好、项目经验、工具调用结果、失败案例都存进去。看起来,只要把“记忆”这块补上,Agent就能从一次性对话工具变成长期协作伙伴。