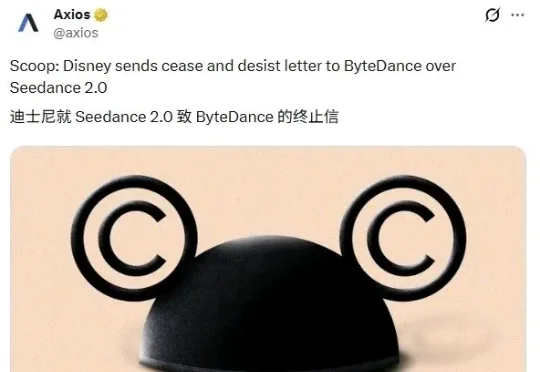

深度拆解:迪士尼围剿Seedance 2.0,一场AI版权海啸正在席卷全球

深度拆解:迪士尼围剿Seedance 2.0,一场AI版权海啸正在席卷全球2026年2月12日,字节跳动正式发布新一代AI视频生成模型Seedance 2.0,同步接入豆包App、即梦App等平台,凭借广播级画质、丝滑运镜、多镜头叙事控制的工业级生成能力,迅速引发全球行业关注。

搜索

搜索

2026年2月12日,字节跳动正式发布新一代AI视频生成模型Seedance 2.0,同步接入豆包App、即梦App等平台,凭借广播级画质、丝滑运镜、多镜头叙事控制的工业级生成能力,迅速引发全球行业关注。

随着 MiniMax M2.5 的发布并在社区引发热烈反响,很高兴能借此机会,分享在模型训练背后关于 Agent RL 系统的一些思考。 在大规模、复杂的真实世界场景中跑 RL 时,始终面临一个核心难

来自上海科学智能研究院(上智院)、北京大学、复旦大学的联合团队,提出了一套名为PackingStar的强化学习系统,一口气刷新了25-31连续7个维度的世界纪录。

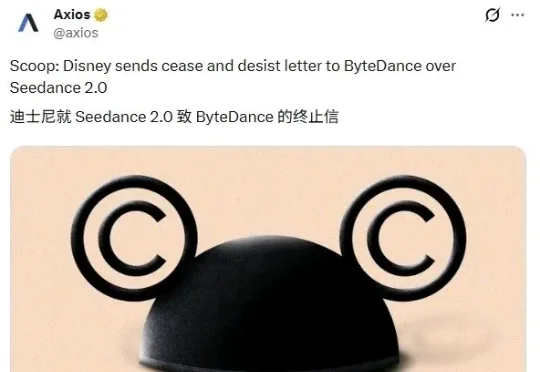

OpenAI深夜突袭,GPT-5.3-Codex-Spark正式炸场。核心卖点只有一个:快!每秒1000个token,让代码生成告别加载条。联手Cerebras怪兽级硬件,物理外挂直接拉满。这不再是简单的工具升级。而是一场关于速度的暴力美学。

当大多数人还在测试它的单点逻辑推理能力时,敏锐的开发者已经发现了一个更具破坏力的玩法:将GLM-5的高密度思维模型注入到Anthropic最新推出的Claude Code Agent Teams架构中。

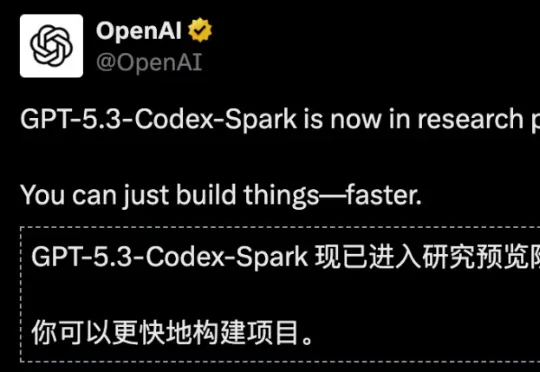

2月7日,中文医疗大模型评测平台MedBench公布最新多模态大模型评测榜单,数坤科技的数坤坤多模态医学大模型V3以63.6分拿下第一。在榜单中,V3的表现超过微医、云知声旗下医疗行业大模型,以及OpenAI、谷歌、阿里千问旗下通用大模型。

Jane 打开 ChatGPT,熟练地切换到 GPT-4o,屏幕上弹出那行熟悉的提示。 「你正在使用 GPT-4o,该模型将于 2 月 13 日下线。欢迎试用我们更新、更强大的模型,享受更佳体验。」

清华大学团队推出的Dolphin模型突破了「高性能必高能耗」的瓶颈:仅用6M参数(较主流模型减半),通过离散化视觉编码和物理启发的热扩散注意力机制,实现单次推理即可精准分离语音,速度提升6倍以上,在多项基准测试中刷新纪录,为智能助听器、手机等端侧设备部署高清语音分离开辟新路。

基于真实居民健康档案构建的MedLLM-EHR-EVAL-V2评测集显示,星火医疗大模型在智能健康分析、报告解读、运动饮食建议、辅助诊疗、智能用药审核等关键任务上,得分均显著超越国内外主流大模型。

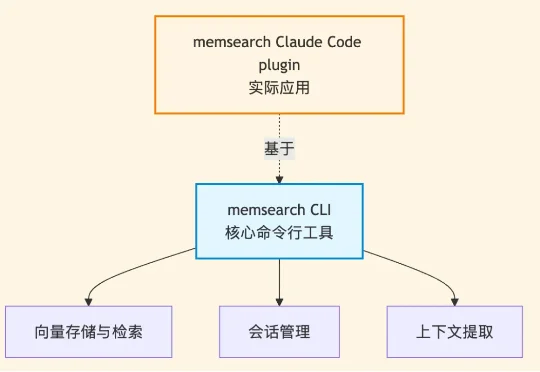

但考虑到在代码领域,如何做好记忆与检索,相比其他场景又有所不同,因此,基于 memsearch CLI ,我们同时也为Claude Code 做了个永久记忆的 plugin——memsearch ccplugin(可适用所有AI coding软件)。