近2亿美元!VAST完成新一轮融资,正式披露世界模型路线

近2亿美元!VAST完成新一轮融资,正式披露世界模型路线VAST近期完成合计近2亿美元的A+及A++轮融资,领投方为渶策资本、国寿长三角科创基金。拿到这笔钱的同时,VAST也带来了他们最新的世界模型进展:Project Eden。区别于业内「动作条件视频生成」与「静态3D场景生成」等常规路径,Project Eden创造性地将底层状态推演与视觉呈现进行了原生解耦。

搜索

搜索

VAST近期完成合计近2亿美元的A+及A++轮融资,领投方为渶策资本、国寿长三角科创基金。拿到这笔钱的同时,VAST也带来了他们最新的世界模型进展:Project Eden。区别于业内「动作条件视频生成」与「静态3D场景生成」等常规路径,Project Eden创造性地将底层状态推演与视觉呈现进行了原生解耦。

连续创业的 York 开启了又一段新征程。过去十几年里,他几乎一直在做软硬一体系统:从计算机视觉、嵌入式,到后来的机器人。他的上一个创业项目——智能购物车 Caper AI,在 2021 年被 Instacart 以 3.5 亿美元收购。

继 Step 3.5 Flash 后,阶跃星辰最近又推出新一代高效率 Flash 开源模型 ——Step 3.7 Flash。该模型最大特点就是多(模)、快(速)、好(用)、省(钱)。总参数 196B,采用稀疏 MoE 架构,推理激活参数仅 11B,配备 1.88B ViT 视觉编码器,推理速度最高 400 TPS,支持 256K 上下文。

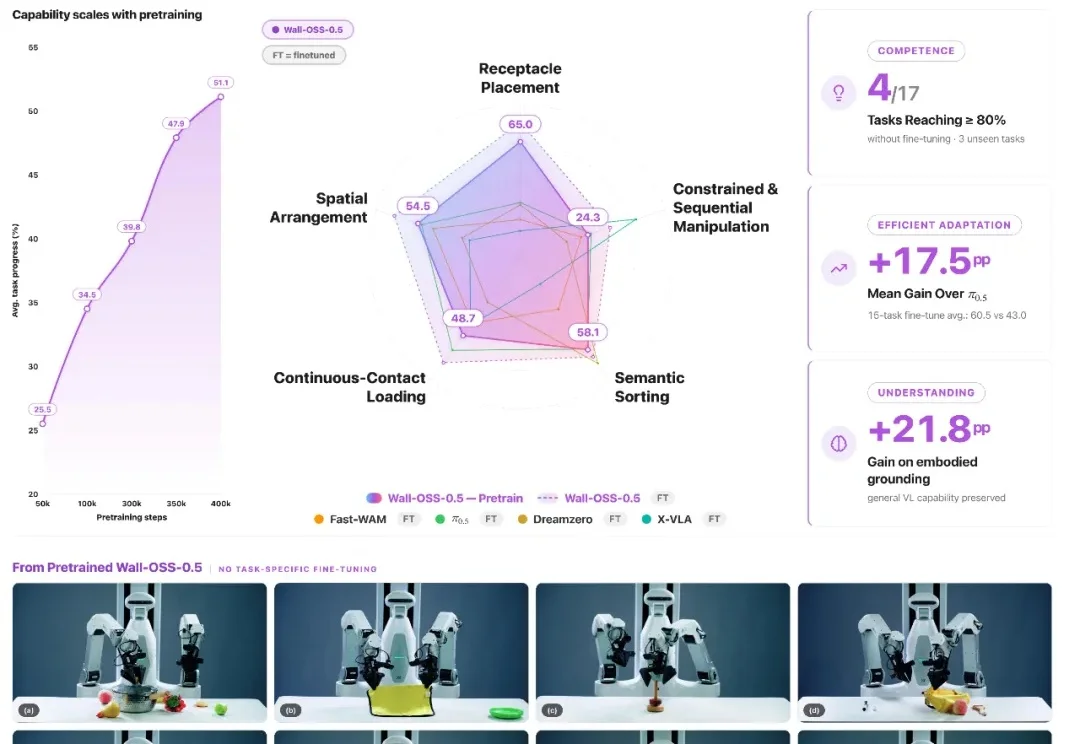

2026 年初,国内具身智能赛道掀起了一波开源潮,越来越多团队开始公开自己的视觉-语言-动作(VLA)模型、数据集与训练框架。与此同时,行业竞争也逐渐集中到 benchmark 成绩、任务成功率以及跨任务泛化能力上,尤其是在标准化或已训练任务中的表现。

腾讯设计领域的WorkBuddy来了。

过去两年,具身智能的资源与研究重心高度集中于视觉感知,聚焦于“让机器人看懂世界”。

过去十年,大模型世界里很多最关键的技术路线背后,都能看到Andrew Dai的身影。从早期预训练与监督微调,到后来主流的MoE(Mixture of Experts)架构;从Google Brain最初只有几十人的研究时代,到后来支撑Gemini的大规模数据体系,这位在 Google 工作超过14年的研究科学家,几乎站在了大模型时代每一次关键转折的现场。

智能体时代,如何让视觉分割更准确?

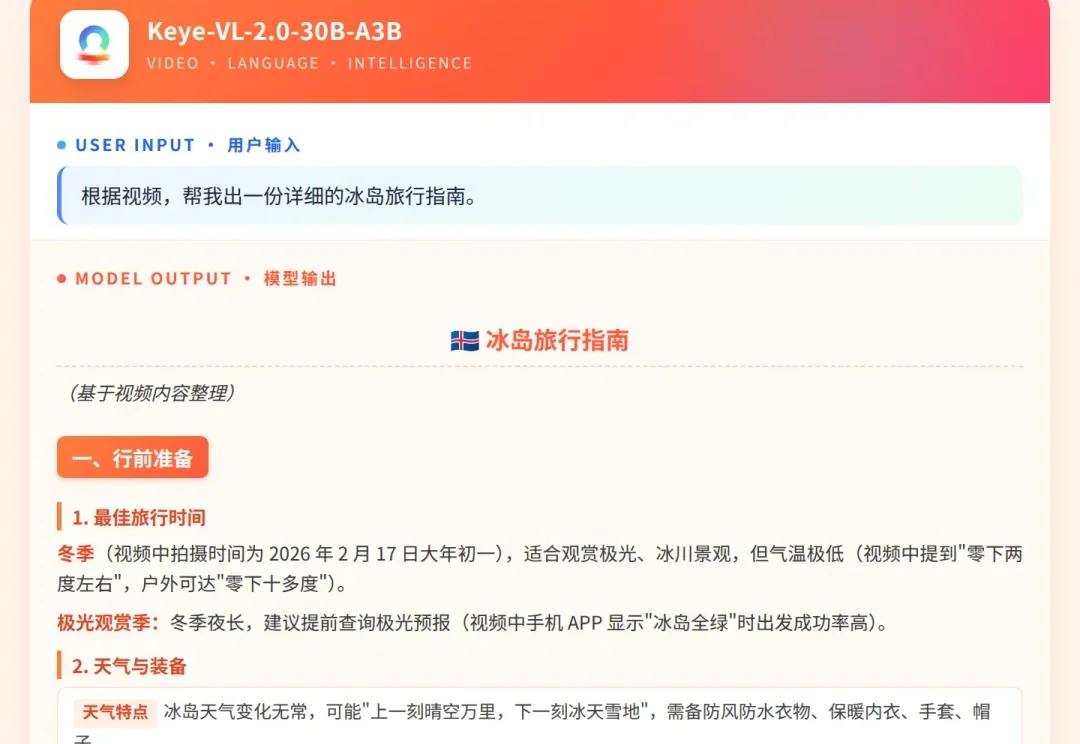

当你把一段长达9分钟、在“晴空万里”与“冰天雪地”间剧烈切换的冰岛旅行Vlog输入给大模型,并要求它做一份旅行攻略时,常规的视觉大模型通常只能给出一份基于字幕和画面标签拼凑的“流水账”。

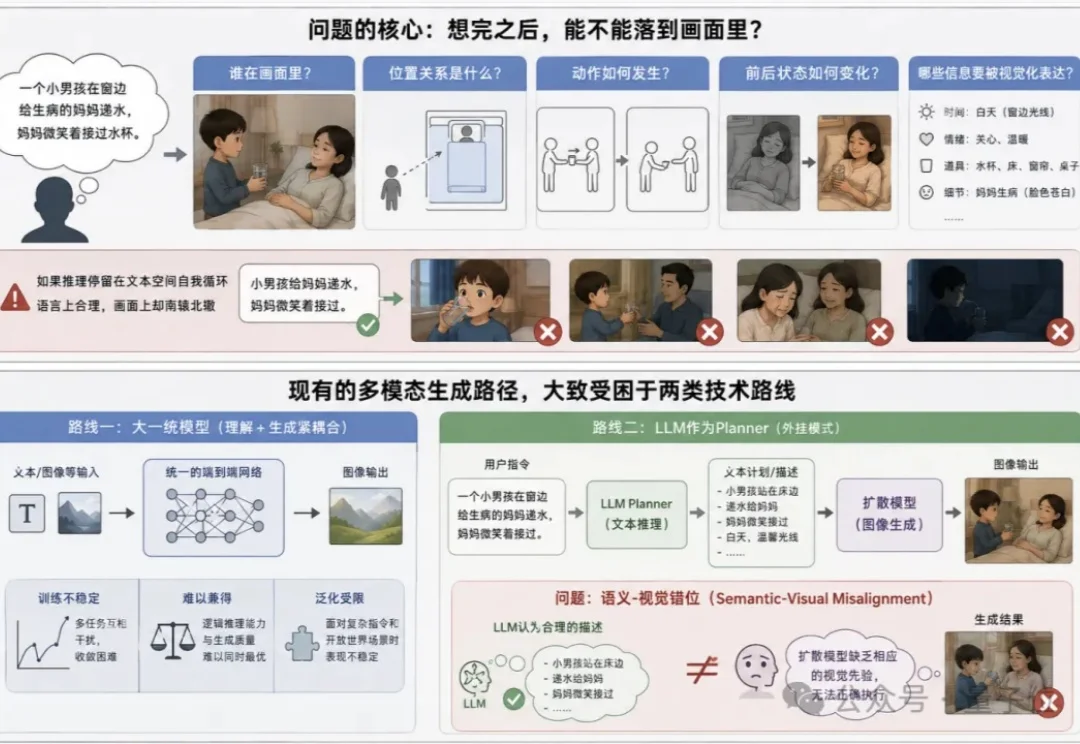

当下视觉生成正陷入一个能力错位困境—— 扩散模型的像素画质已接近完美,但一遇到需要逻辑推理的生成任务就频频翻车。