仅需10%思维链标注,等同全量性能!计算所发布推理监督新范式

仅需10%思维链标注,等同全量性能!计算所发布推理监督新范式大语言模型(LLMs)推理能力近年来快速提升,但传统方法依赖大量昂贵的人工标注思维链。中国科学院计算所团队提出新框架PARO,通过让模型学习固定推理模式自动生成思维链,只需大模型标注1/10数据就能达到全量人工标注的性能。这种方法特别适合像金融、审计这样规则清晰的领域,为高效推理监督提供了全新思路。

大语言模型(LLMs)推理能力近年来快速提升,但传统方法依赖大量昂贵的人工标注思维链。中国科学院计算所团队提出新框架PARO,通过让模型学习固定推理模式自动生成思维链,只需大模型标注1/10数据就能达到全量人工标注的性能。这种方法特别适合像金融、审计这样规则清晰的领域,为高效推理监督提供了全新思路。

在当前评测生成式模型代码能力的浪潮中,传统依赖人工编写的算法基准测试集,正日益暴露出可扩展性不足与数据污染严重两大瓶颈。

在文化遗产与人工智能的交叉处,有一类问题既美也难:如何让机器「看懂」古希腊的陶器——不仅能识别它的形状或图案,还能推断年代、产地、工坊甚至艺术归属?有研究人员给出了一条实用且富有启发性的答案:把大型多模态模型(MLLM)放在「诊断—补弱—精细化评估」的闭环中训练,并配套一个结构化的评测基准,从而让模型在高度专业化的文化遗产领域表现得更接近专家级能力。

直到我看到 Dedalus Labs 宣布完成 1100 万美元种子轮融资的消息,才意识到有人正在系统性地解决这个问题。这家由 Cathy Di 和 Windsor Nguyen 创立的公司,正在构建一个基础设施层,让开发者能够用 5 行代码就搭建起一个功能完整的 AI agent。这不是夸张的营销话术,而是他们真正在做的事情。

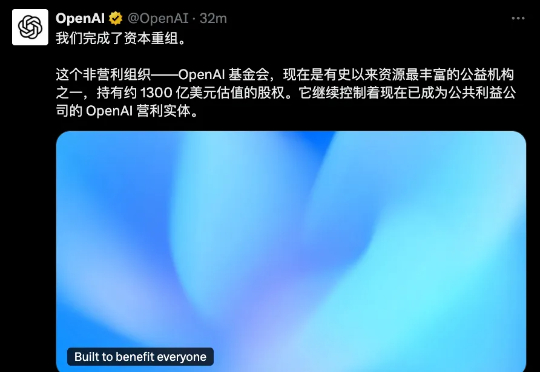

刚刚,OpenAI宣布已完成资本结构重组。这就意味着,OpenAI上市的道路已经铺平,而软银前几天刚批准的225亿美元投资,也将顺利到账。具体来说,OpenAI重组后,非营利主体(即原本的OpenAI Nonprofit)改名为OpenAI Foundation,继续掌控营利实体——

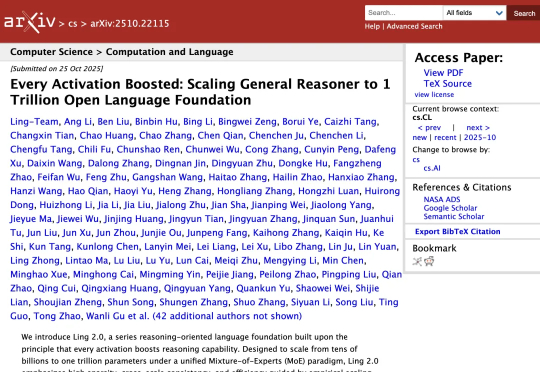

蚂蚁集团这波操作大圈粉!智东西10月28日报道,10月25日,蚂蚁集团在arXiv上传了一篇技术报告,一股脑将自家2.0系列大模型训练的独家秘籍全盘公开。今年9月至今,蚂蚁集团百灵大模型Ling 2.0系列模型陆续亮相,其万亿参数通用语言模型Ling-1T多项指标位居开源模型的榜首

母亲被杀,尸体藏进洗衣机,女儿却用AI伪造她的声音、假扮她的样子,让世界以为她还活着。十天后,真相才浮出水面,竟是亲生女儿弑母,后用AI伪造母亲声音!AI没有杀人,却做了帮凶。我们该害怕的,是机器的失控,还是人性的冷酷?

AI大house真来了。

凌晨三点,一个用户在 ChatGPT 的对话框里输入,「我已经没有办法再坚持了。」

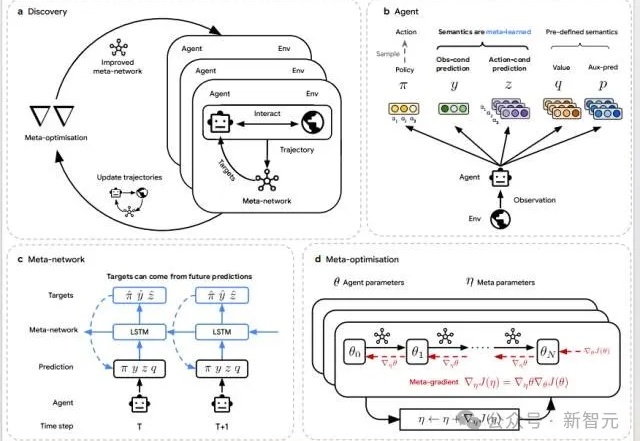

当AI开始「自己学会学习」,人类的角色正在被重写。DeepMind最新研究DiscoRL,让智能体在多环境交互中自主发现强化学习规则——无需人类设计算法。它在Atari基准中击败MuZero,在从未见过的游戏中依旧稳定高效。

当地时间 10 月 27 日,埃隆·马斯克为互联网带来了一个新的知识工具。这位亿万富翁名下的人工智能公司 xAI 推出了 Grokipedia,一个由 AI 生成的在线百科全书平台。马斯克在社交媒体 X 上宣称,这将是对维基百科(Wikipedia)的“巨大改进”,甚至称其为实现 xAI“理解宇宙”目标的“必要步骤”。但这个雄心勃勃的项目在上线几小时后就引发了争议。

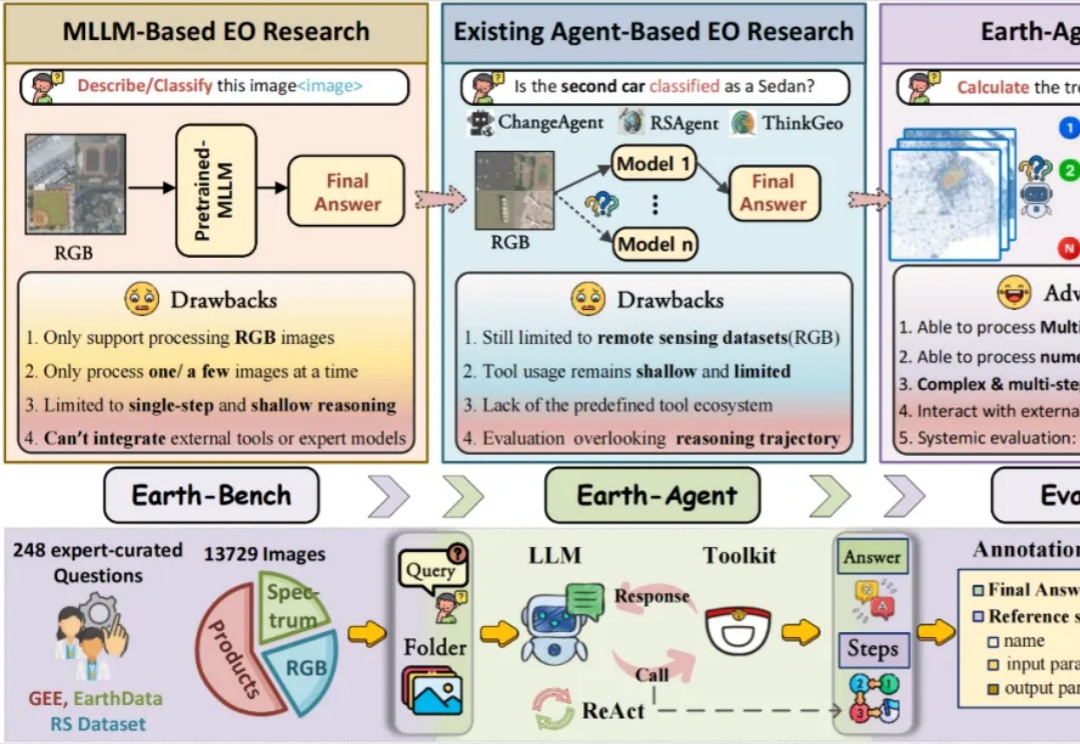

当强大的多模态大语言模型应用于地球科学研究时,它面临着无法忽视的 「阿克琉斯之踵」

近期,DeepSeek-OCR提出了“Vision as Context Compression”的新思路,然而它主要研究的是通过模型的OCR能力,用图片压缩文档。

人眼秒懂,AI抓瞎!网友用光学错觉玩坏大模型,全网百万人围观。

能看懂相机参数,并且生成相应视角图片的多模态模型来了。

周日晚上,都准备去睡觉了。结果在 X 上刷到一条消息,有个国外的博主说,MiniMax 的 M2 模型将会成为中国最好的模型,与 Sonnet 4.5 旗鼓相当。 我当时心里咯噔一下。MiniMax?

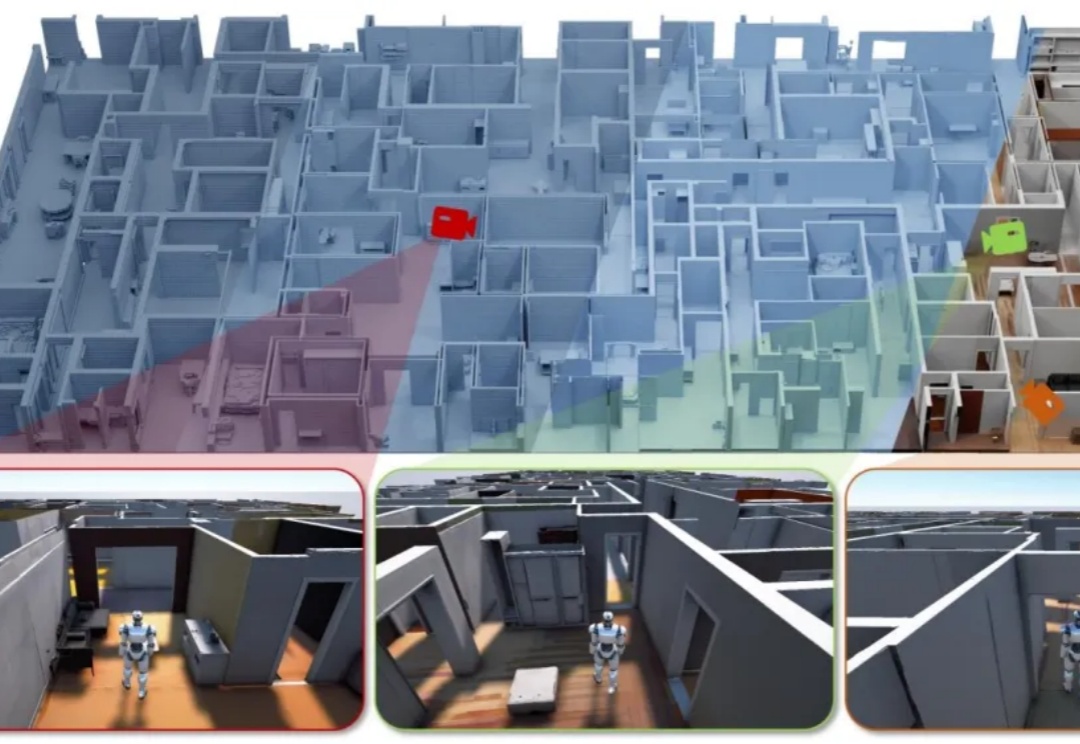

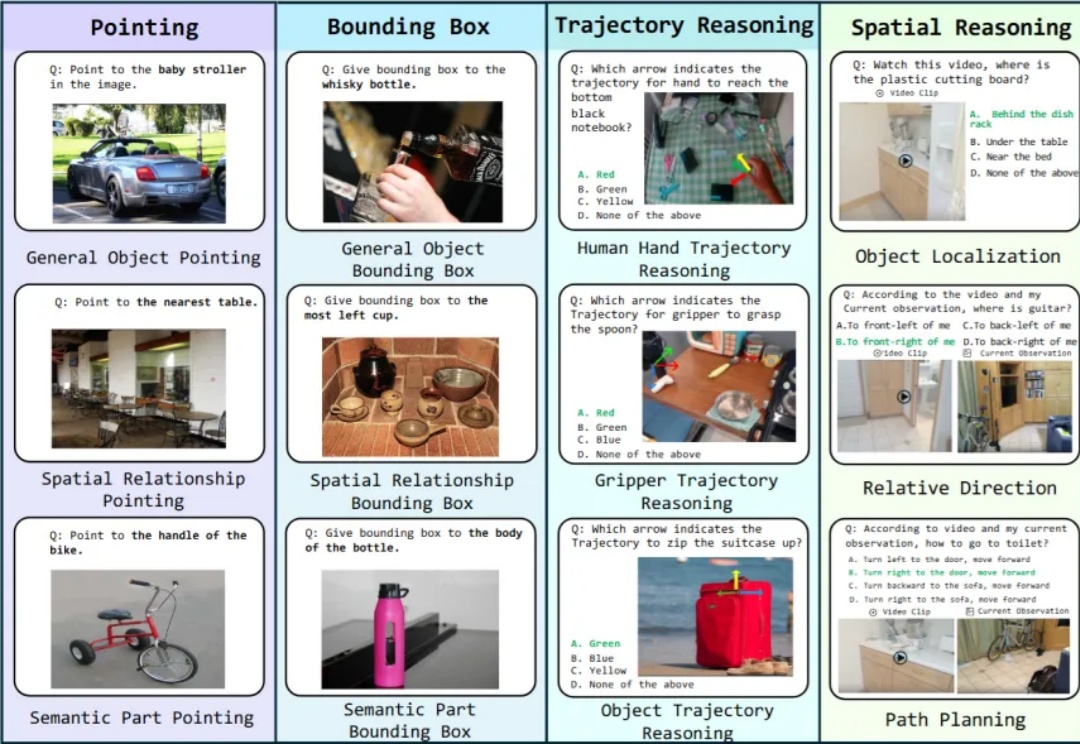

具身智能是近年来非常火概念。一个智能体(比如人)能够在环境中完成感知、理解与决策的闭环,并通过环境反馈不断进入新一轮循环,直至任务完成。这一过程往往依赖多种技能,涵盖了底层视觉对齐,空间感知,到上层决策的不同能力,这些能力便是广义上的具身智能。

今日(10 月 28 日),高通正式宣布推出两款全新芯片——高通 AI200 和高通 AI250,以及相应的机架级解决方案。此举直接挑战了由英伟达和超威半导体长期主导的 AI 芯片领域。消息宣布后,高通股价依然应声飙升,涨幅超 11%,创 2024 年 7 月以来新高。

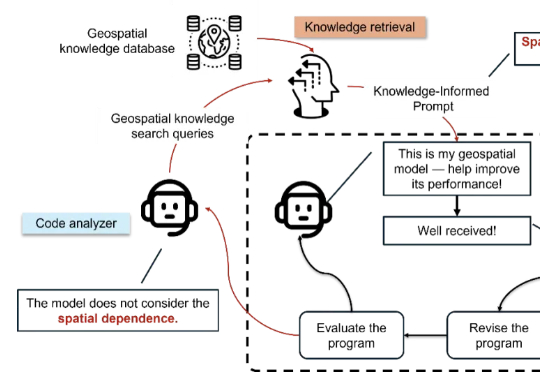

让AI懂地理,它才会走得更远。GeoEvolve让AI从助理变成「地理学博士生」,自己修bug、改算法、进化模型——这下,科学家可能真的要有个AI同事了。MIT和斯坦福学者提出了GeoEvolve,尝试了这样一种探索:

近日,在 CNCC2025 大会上,郑波首次公开了淘宝全模态大模型的最新进展,并系统介绍了多模态智能在淘宝 AIGX 技术体系的研究应用。另外,结合 AI 模型技术在淘宝应用中的实践,他认为,「狭义 AGI 很可能在 5-10 年内到来。」

刚刚,不发论文、爱发博客的 Thinking Machines Lab (以下简称 TML)再次更新,发布了一篇题为《在策略蒸馏》的博客。在策略蒸馏(on-policy distillation)是一种将强化学习 (RL) 的纠错相关性与 SFT 的奖励密度相结合的训练方法。在将其用于数学推理和内部聊天助手时,TML 发现在策略蒸馏可以极低的成本超越其他方法。

彭超曾在华为印度、阿里任消费硬件业务1号位;联合创始人齐炜祯为Multi-token架构开创学者,被Deepseek、Qwen引入预训练方法。

2023 年的秋天,当全世界都在为 ChatGPT 和大语言模型疯狂的时候,远在澳大利亚悉尼的一对兄弟却在为一个看似简单的问题发愁:为什么微调一个开源模型要花这么长时间,还要用那么昂贵的 GPU?

学界杀入主赛道!UCL 校园团队 EuniAI 抛出开源智能体 Prometheus,在 SWE-bench Verified 上 71.2% Pass@1、主榜实锤合并;成本低至 $0.23/issue。

OpenAI现在已经完全是互联网大厂的路数了。

OpenAI 发布了一份报告: AI in Japan: OpenAI’s Economic Blueprint 如何利用 AI,加速创新、增强竞争力,并推动可持续、包容性的增长

可能很多人还不知道,京东云早就做了类似字节 Coze 这样的产品,并且已经 100% 开源。目前市面上同类产品有不少,京东云 JoyAgent 主打的一个亮点就是它在京东内部的场景中验证过,更贴合企业严肃商业场景的需求。今天,我做个记录,也把操作流程和经验分享给大家。

预训练的核心是推动损失函数下降,这是我们一直追求的唯一目标。

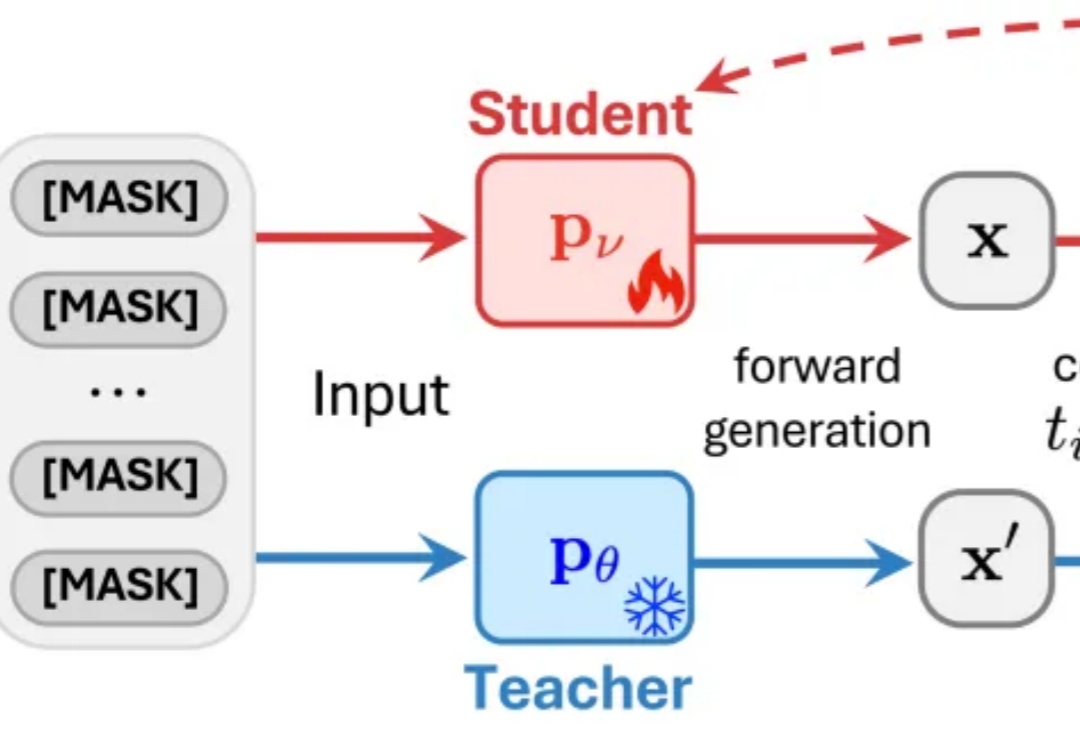

近日,来自普渡大学、德克萨斯大学、新加坡国立大学、摩根士丹利机器学习研究、小红书 hi-lab 的研究者联合提出了一种对离散扩散大语言模型的后训练方法 —— Discrete Diffusion Divergence Instruct (DiDi-Instruct)。经过 DiDi-Instruct 后训练的扩散大语言模型可以以 60 倍的加速超越传统的 GPT 模型和扩散大语言模型。

3D点云异常检测对制造、打印等领域至关重要,可传统方法常丢细节、难修复。上海科大与密歇根大学携手打造PASDF框架,借助「姿态对齐+连续表征」技术,达成检测修复一体化,实验显示其精准又稳定。