做AI研究时Claude会偷偷变笨,Anthropic被研究界围攻

做AI研究时Claude会偷偷变笨,Anthropic被研究界围攻Claude Fable 5 是今天 AI 领域的核心热点,这个「神话级」的模型性能表现非常卓越,吸引了无数眼球。

搜索

搜索

Claude Fable 5 是今天 AI 领域的核心热点,这个「神话级」的模型性能表现非常卓越,吸引了无数眼球。

随着大语言模型逐步进入复杂推理、自动化研究和网络安全等高难度任务,传统的模型评测方式正在面临新的挑战。

世界模型(World Model),正在成为AI领域新的技术高地。从OpenAI的Sora,到图灵奖得主Yann LeCun力推的JEPA体系,再到李飞飞创办的World Labs,全球最顶尖的一批研究者都在试图回答同一个问题:AI究竟如何像人一样理解世界,而不仅仅是生成语言和图像。

还在手动在不同工具间来回切换查文献、跑代码、看结果?两个月前发起内侧的科研龙虾SciClaw,经过上万名科研人的「考核」,正式升级为Mira,推出专家小队、科研画布、LLM WIKI 三大核心能力,首次将「Vibe Researching」理念产品化,让研究者像组建实验室团队一样配置 AI,把时间还给真正的科学思考。

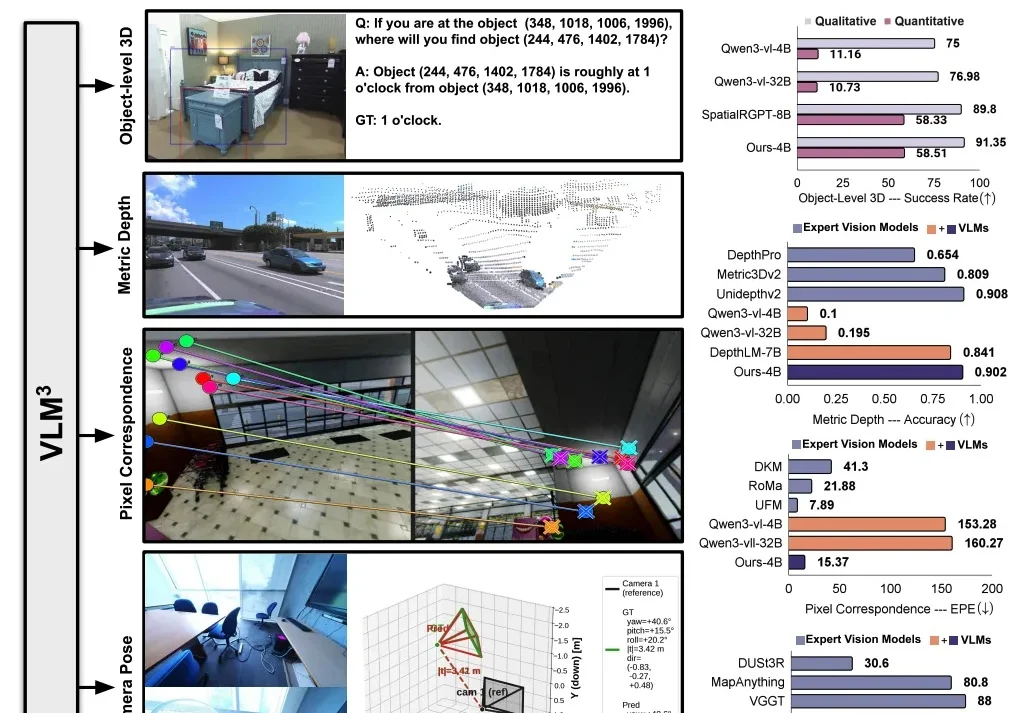

Meta 发布了一项令人震撼的研究工作 VLM³,首次揭示了三维视觉学习的 Bitter Lesson:标准的视觉语言模型 + scale 数据就是最简单有效的范式,针对特定任务的架构、损失函数以及数据增强的设计,甚至是 regression 的 formulation,均不是三维视觉学习的必要条件。

阿里巴巴今天宣布了围绕AI业务的一次重要组织升级调整: 宣布合并通义大模型事业部和未来生活实验室,成立Token Foundry事业部,由集团CEO吴泳铭直接负责。周靖人将担任阿里巴巴首席科学家,牵头成立阿里巴巴AI未来研究院,专注前沿AI科技的探索与突破。郑波带领Happy Horse、Happy Oyster等加入Token Foundry事业部。

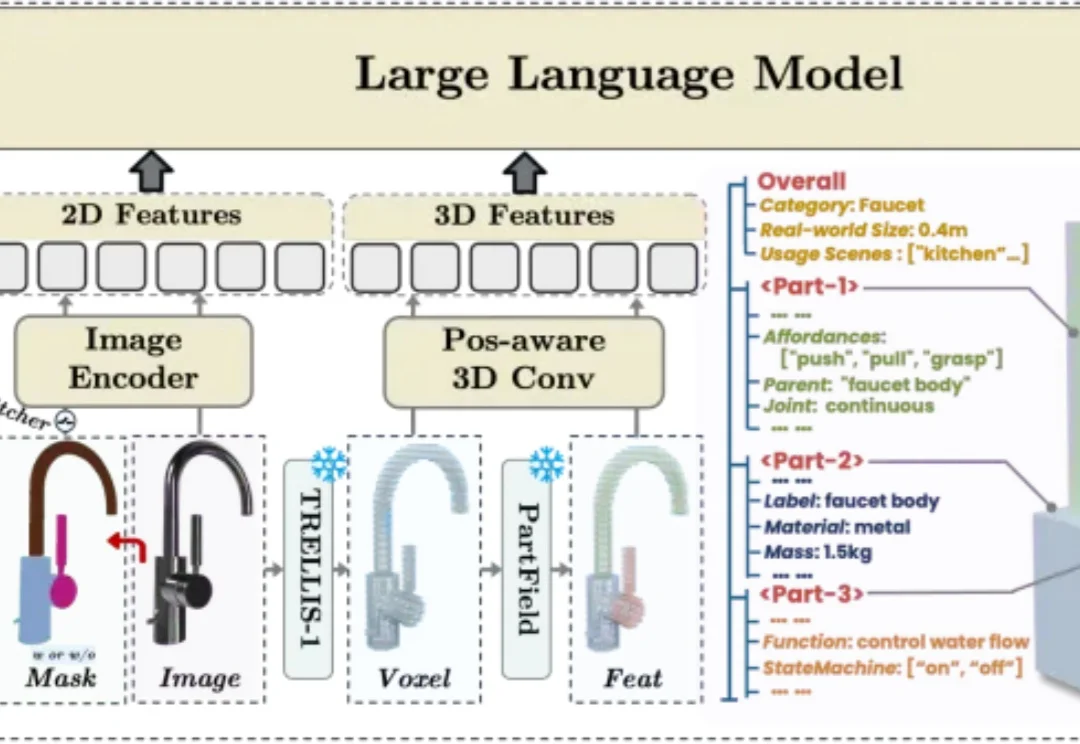

在交互式虚拟世界和具身智能快速发展的今天,高质量 3D 资产已经不再只是 “看起来像” 就足够。一个柜门不仅要有柜门的外观,还需要知道绕哪条轴旋转;一个按钮不仅要有按钮的形状,还需要具备 “按下 / 弹起” 的状态;一个抽屉不仅要有完整几何,还需要拥有滑动方向、运动范围、材质和质量等物理属性。该研究已被 ICML 2026 接收。

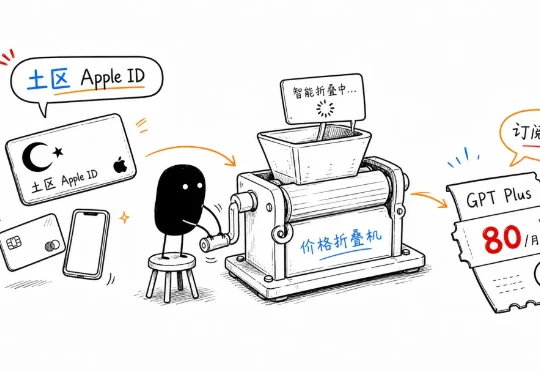

不过,好用归好用,常规渠道订阅一个月大概需要 140 元,长期积累下来也是一笔不小的开销。最近我研究了不同的订阅途径,发现通过土耳其区进行订阅,费用大概能省下一半。

刚刚,OpenAI秘密递交IPO申请,即将冲刺万亿市值!奥特曼扔出使命宣言,2028年让AI进行自我研究,给地球上每个人发一个属于自己的AGI。

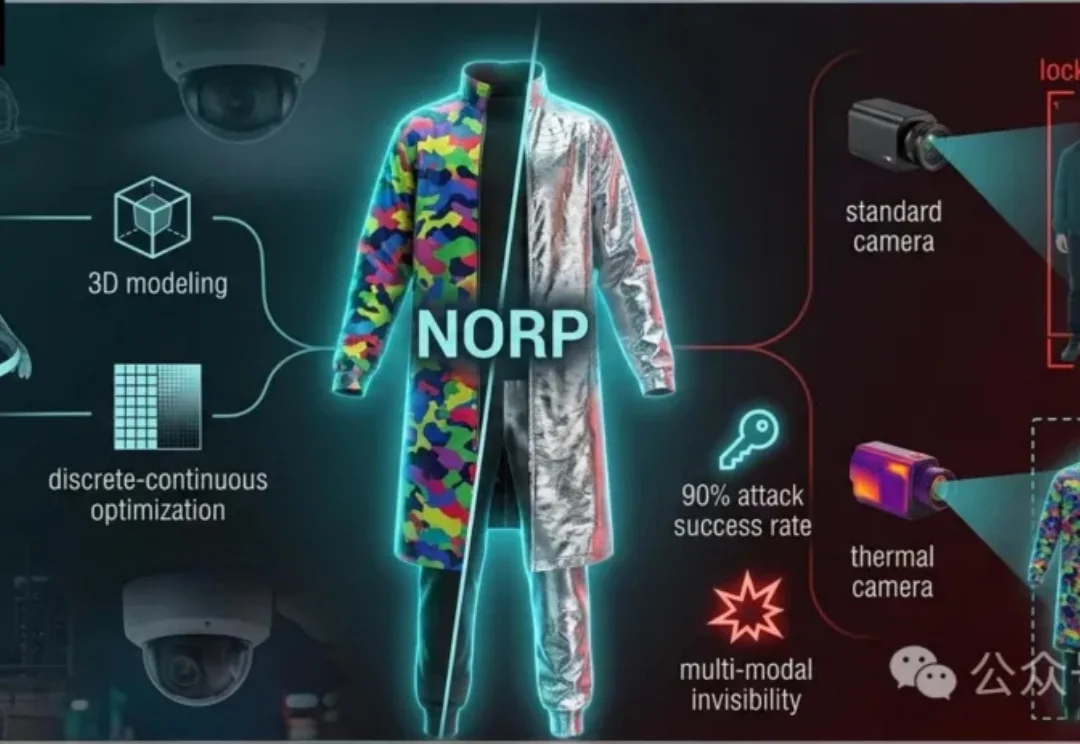

清华大学提出一种新型物理对抗方法,利用特殊服装同时干扰可见光和热成像检测。这种服装通过非重叠设计和三维建模优化,可有效躲避RGB-T检测器,促进系统安全性研究。