首个真正“能用”的LLM游戏Agent诞生!可实时高频决策,思维链还全程可见

首个真正“能用”的LLM游戏Agent诞生!可实时高频决策,思维链还全程可见不讲武德!游戏圈这回真是被AI抄家了。(doge)

不讲武德!游戏圈这回真是被AI抄家了。(doge)

刚刚,𝕏 平台(原 Twitter 平台)公布了全新的开源消息:已将全新的推荐算法开源,该算法由与 xAI 的 Grok 模型相同的 Transformer 架构驱动。

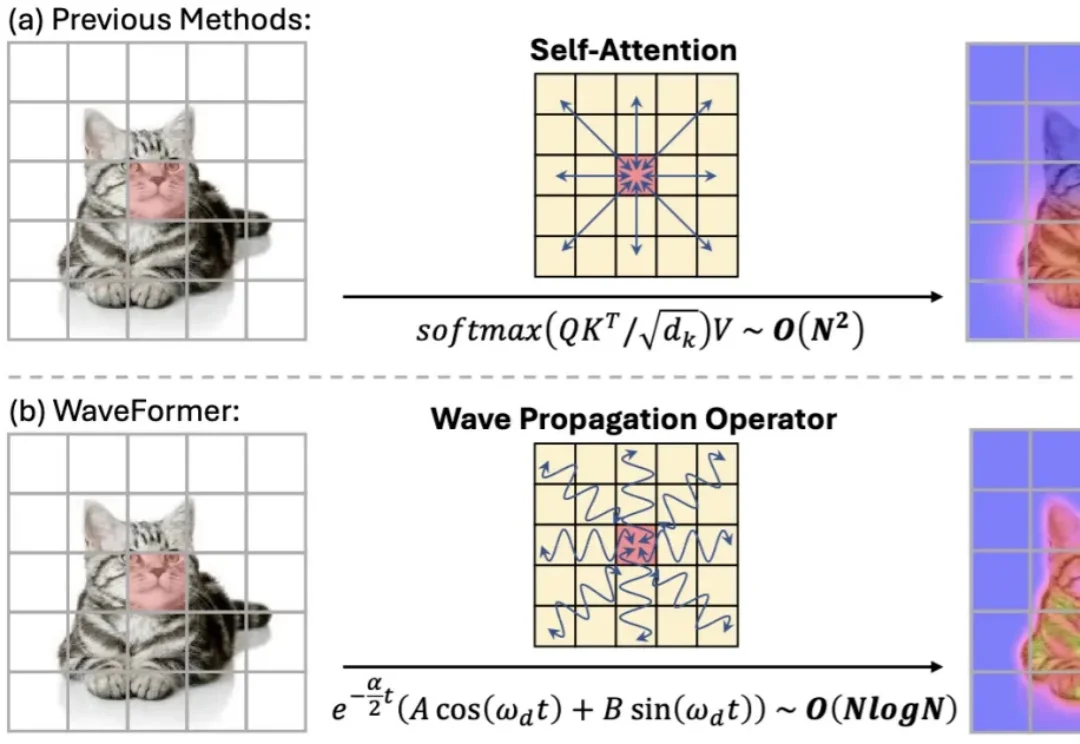

“全局交互” 几乎等同于 self-attention:每个 token 都能和所有 token 对话,效果强,但代价也直观 —— 复杂度随 token 数平方增长,分辨率一高就吃不消。现有方法大多从 “相似度匹配” 出发(attention),或从 “扩散 / 传导” 出发(热方程类方法)。但热方程本质上是一个强低通滤波器:随着传播时间增加,高频细节(边缘、纹理)会迅速消失,导致特征过平滑。

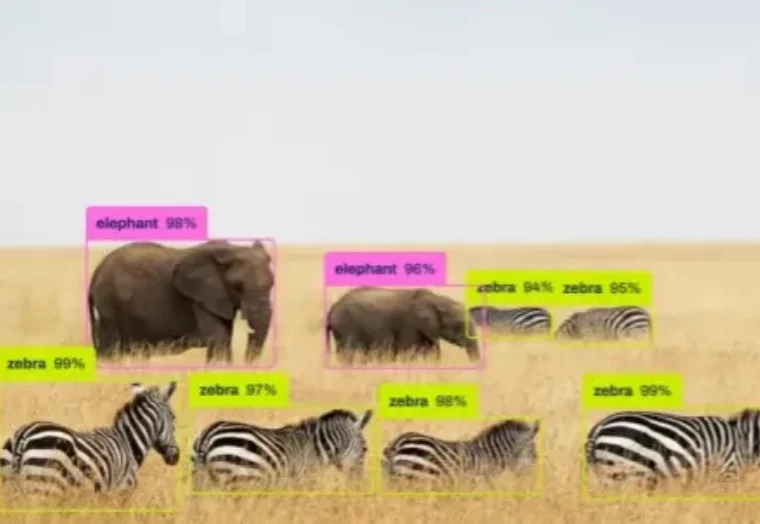

如果你最近关注了 GitHub,可能会注意到一个有趣的现象: YOLO 的版本号,直接从 11 跳到了 26。

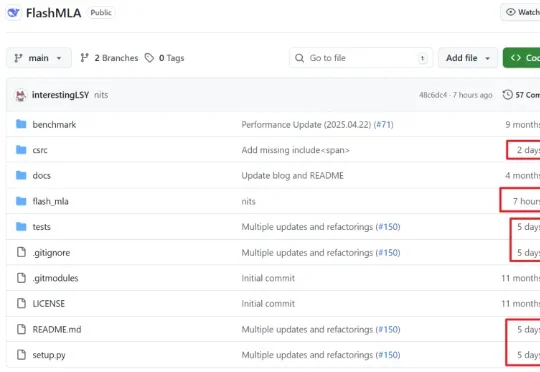

2025 年 1 月 20 日,DeepSeek(深度求索)正式发布了 DeepSeek-R1 模型,并由此开启了新的开源 LLM 时代。在 Hugging Face 刚刚发布的《「DeepSeek 时刻」一周年记》博客中,DeepSeek-R1 也是该平台上获赞最多的模型。

知情人士独家讲述:陈天桥与代季峰的MiroMind团队发生了什么?1月18日,盛大集团与MiroMind发布联合声明,代季峰从即日起卸任技术顾问一职。这周一,MiroMind内部员工发现,代季峰已经退出了公司群。

今天,MiniMax Agent 2.0 推出了 Desktop App,能操作本地文件、自动化网页操作。MiniMax Agent 2.0 这次更新了两个核心能力:一个是 Desktop App,一个是 Expert Agents。

《读佳》获悉,Z世代社交平台Soul近期低调推出AI情绪服务小程序“塔塔疗愈所”,聚焦情绪记录、正念练习、泛心理趣味测试三大核心功能,以轻量化形态深化情绪价值供给。这一动作正值Soul冲刺IPO的关键节点,是其强化AI战略、丰富情绪服务生态的重要布局,为上市故事再添新筹码。

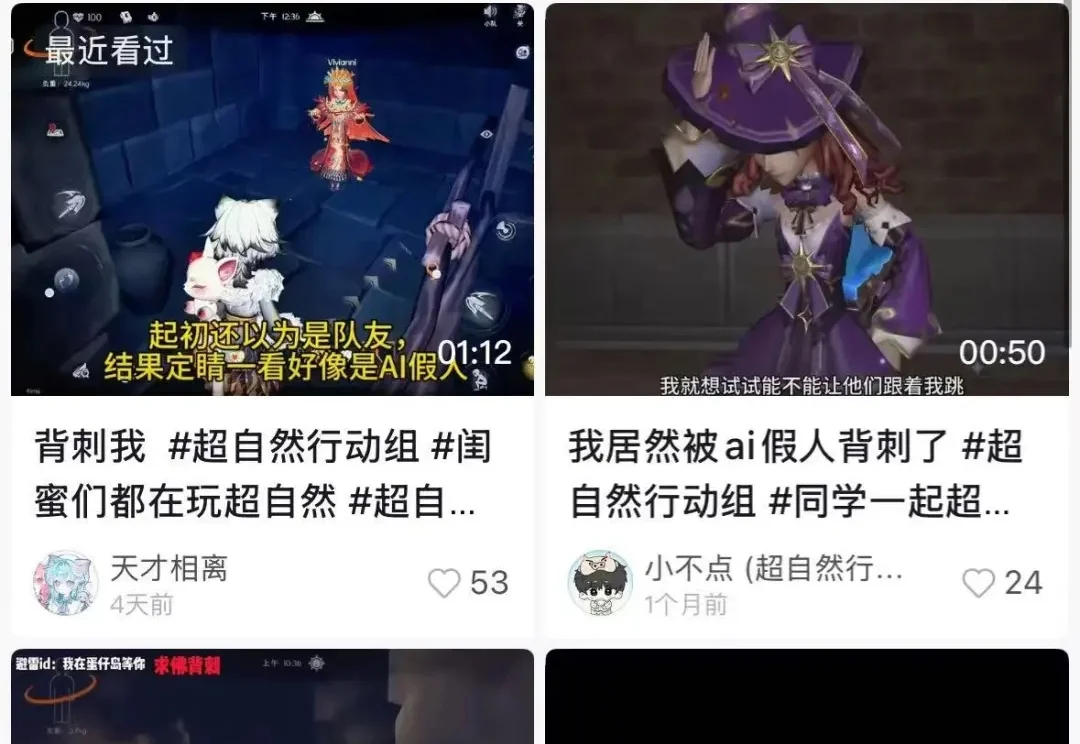

谁能想到,有朝一日,人在游戏里会被 AI 耍得团团转。

当 DeepSeek 和 OpenAI 的核心突破者越来越年轻,传统的简历筛选正在失效。一位前阿里达摩院的研究员,试图用 Agent 编织一张能捕捉「下一个 Ilya」的网。