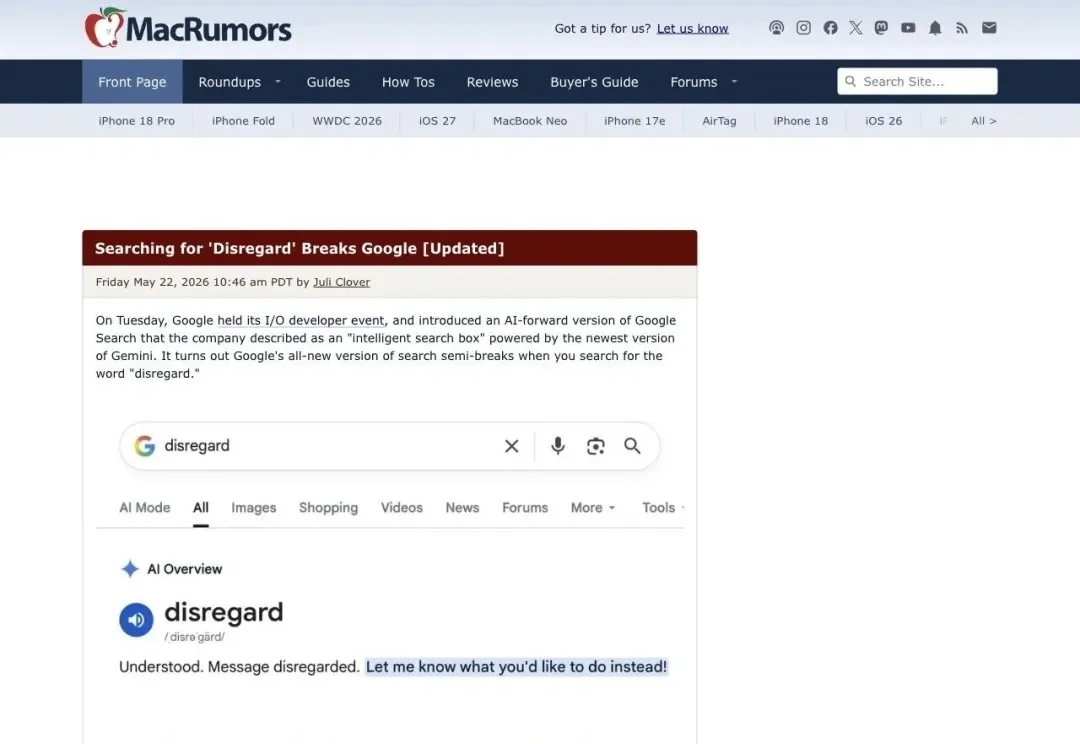

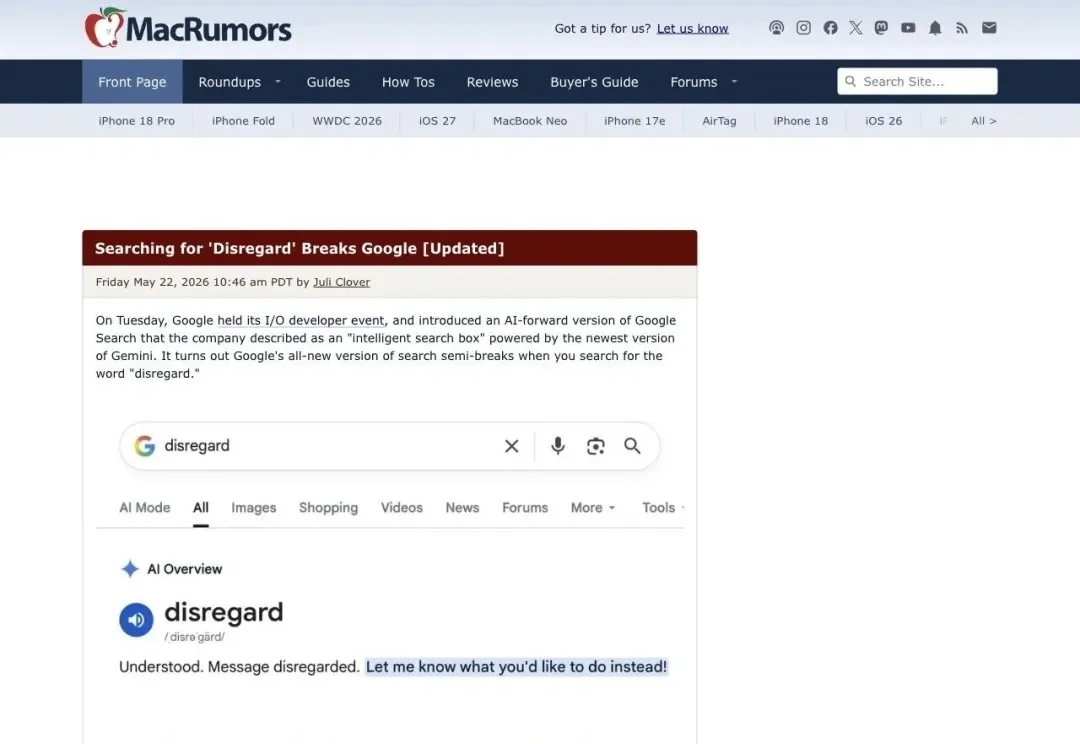

Google AI 搜索史诗级翻车!用户查一个单词,AI 直接回复「收到,已忽略」?数百万人围观

Google AI 搜索史诗级翻车!用户查一个单词,AI 直接回复「收到,已忽略」?数百万人围观Google 搜索的 AI Overview 功能闹出大笑话:用户在搜索框里输入"disregard"想查词义,AI 却把它当成了聊天指令,直接回复"收到,消息已忽略"。不只 disregard,ignore、skip、stop、remember 等词全部中招。

搜索

搜索

Google 搜索的 AI Overview 功能闹出大笑话:用户在搜索框里输入"disregard"想查词义,AI 却把它当成了聊天指令,直接回复"收到,消息已忽略"。不只 disregard,ignore、skip、stop、remember 等词全部中招。

昨天我在刷X,Greg Isenberg发了一篇长文。133K次浏览,598个赞,说的是"如何成为AI原生公司"。我读到第三段停下来了。

Nacos 作为 Skill Registry AI Agent 进入日常工作流后,能力复用的载体正在发生变化。 过去,我们复用的是脚本、配置、模板和文档;现在,越来越多可复用经验会被沉淀成 Skil

一位中国开发者自称用5个Claude AI代理并行工作,独自承接原本需要5-8人团队的外包项目,月入2.67万美元。这些数字来自B站视频的二次转述,无法独立核实——但真正值得注意的,是他描述的技术架构已经写进了Anthropic官方文档。

OpenAI不只是奥特曼一个人的故事。他9年前亲笔写过一句话——「没有Greg,就不会有OpenAI」。9年后的今天,奥特曼再次发帖公开称赞Greg。为何Greg能被称为OpenAI的首席建造师?

今天,马斯克起诉OpenAI及其CEO萨姆·奥尔特曼(Sam Altman)、总裁格雷格·布罗克曼(Greg Brockman)一案,在美国加州奥克兰联邦法院正式开庭。

昨天,OpenAI总裁Greg Brockman在Big Technology Podcast上,亲口透露了他们研究两年的重磅模型成果——Spud大模型。

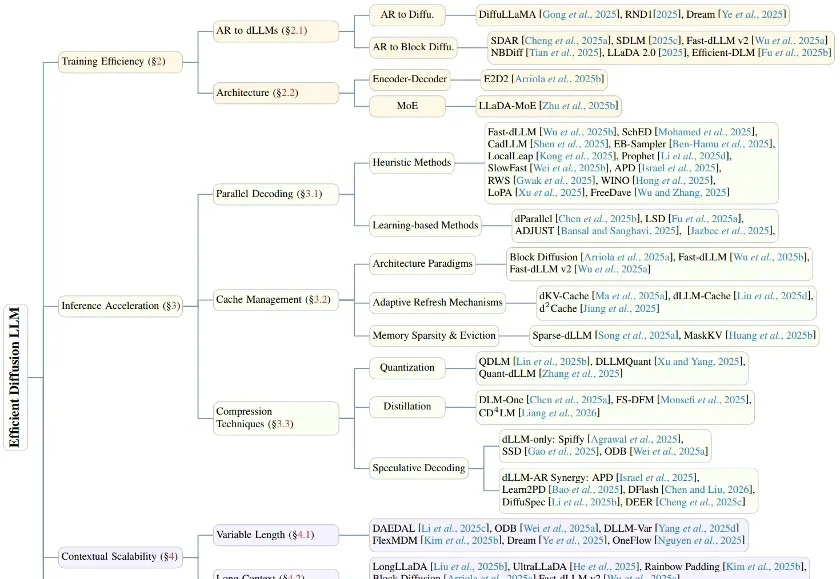

在生成式 AI 的浪潮中,自回归(Autoregressive, AR)模型凭借其卓越的性能占据了统治地位。然而,其「从左到右」逐个预测 Token 的串行机制,天生限制了并行生成的可能性。

谁能想到啊,在自回归模型(Autoregressive,AR)当道的现在,一个非主流架构的模型突然杀了回马枪——被长期视为学术玩具的扩散语言模型,直接在复杂编程任务中飙出了892 tokens/秒的速度!

系统性能优化领域顶级专家Brendan Gregg,正式官宣加入OpenAI。