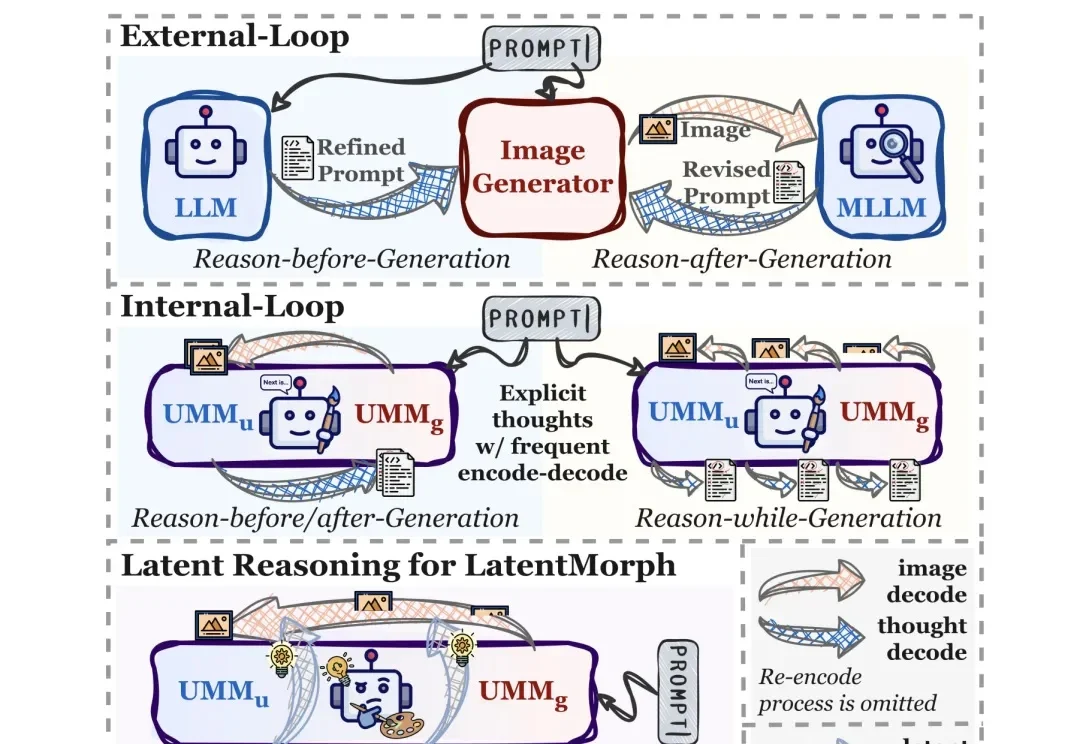

Transformer祖制,被Kimi捅破了!谷歌大V高赞:Kimi触碰了十年没人敢碰的禁区!性能炸裂,相当于免费得1.25倍算力,网友:简直天才洞察

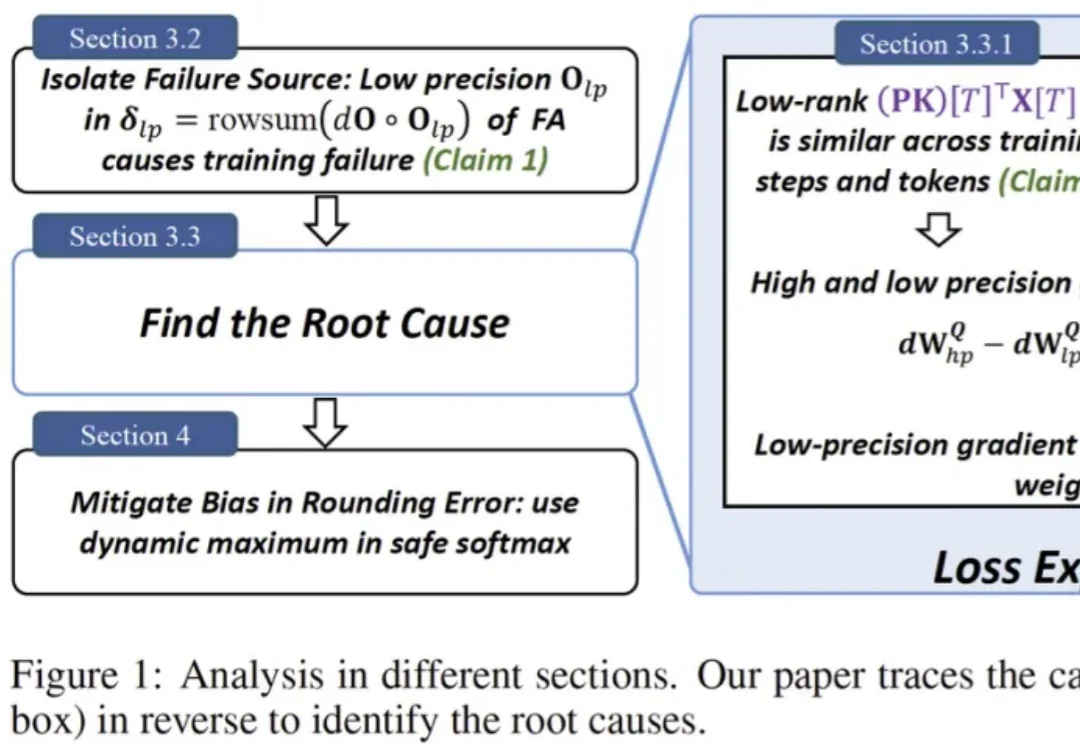

Transformer祖制,被Kimi捅破了!谷歌大V高赞:Kimi触碰了十年没人敢碰的禁区!性能炸裂,相当于免费得1.25倍算力,网友:简直天才洞察就在刚刚,Moonshot AI(月之暗面)发布了一项足以撼动 Transformer 底层的研究:《Attention Residuals》。海外科技大 V,谷歌高级AI产品经理 Shubham Saboo 直接开启了“高赞”模式:“他们触碰了那个十年没人敢碰的部分。”