Flash Attention作者最新播客:英伟达GPU统治三年内将终结

Flash Attention作者最新播客:英伟达GPU统治三年内将终结英伟达还能“猖狂”多久?——不出三年! 实现AGI需要新的架构吗?——不用,Transformer足矣! “近几年推理成本下降了100倍,未来还有望再降低10倍!” 这些“暴论”,出自Flash Attention的作者——Tri Dao。

搜索

搜索

英伟达还能“猖狂”多久?——不出三年! 实现AGI需要新的架构吗?——不用,Transformer足矣! “近几年推理成本下降了100倍,未来还有望再降低10倍!” 这些“暴论”,出自Flash Attention的作者——Tri Dao。

刚发V3.1“最终版”,DeepSeek最新模型又来了!DeepSeek-V3.2-Exp刚刚官宣上线,不仅引入了新的注意力机制——DeepSeek Sparse Attention。还开源了更高效的TileLang版本GPU算子!

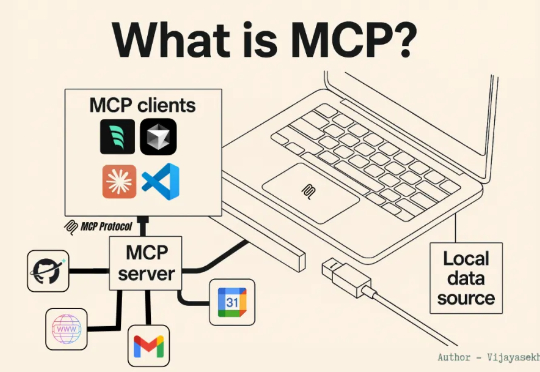

据 9to5Mac 报道,iOS 26.1、iPadOS 26.1 和 macOS Tahoe 26.1 开发者测试版隐藏的代码显示,苹果正在为 App Intents 引入 MCP 支持打基础。这也意味着未来,我们能让 ChatGPT、Claude 或其他任何兼容 MCP 的 AI 模型直接与 Mac、iPhone 和 iPad 应用交互。

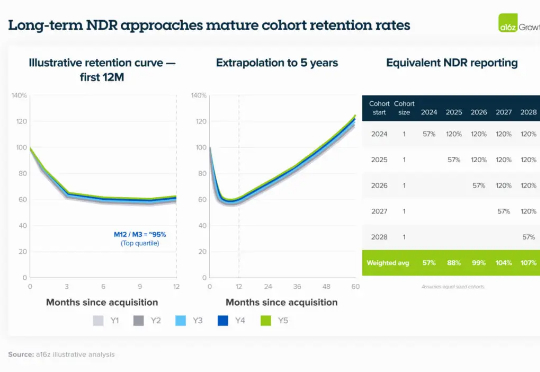

近期,a16z 的研究团队发布了一篇博客文章《Retention Is All You Need》,在分析了数百家 AI 企业的情况后发现:将衡量用户留存率的基准点从第 0 个月(M0)后移至第 3 个月(M3),反而能更清晰地评估 PMF 和 GTM 策略。

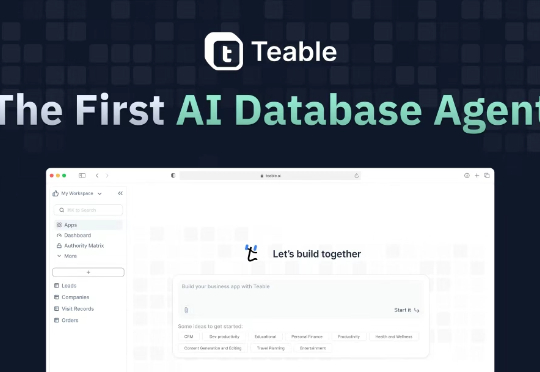

回溯TOB工具与数据库领域的发展历程,从早期依赖代码开发的传统数据库,到Airtable开启的表格式数据库新赛道,再到Notion等工具推动的 “无代码” 协作浪潮,每一次技术迭代都在降低企业数据管理的门槛。

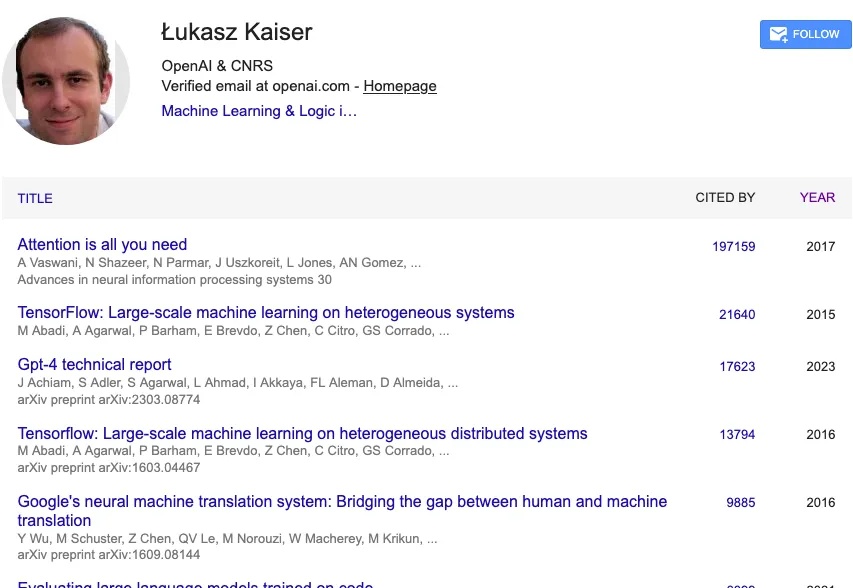

2017 年,一篇标题看似简单、甚至有些狂妄的论文在线上出现:《Attention Is All You Need》。

随着豆包和元宝两大头部智能助手的入场,能够在短短数分钟内将任何内容(话题、链接或文档)转为对话式播客的AI播客工具从小众走向了大众视野。但疑问依旧重重——

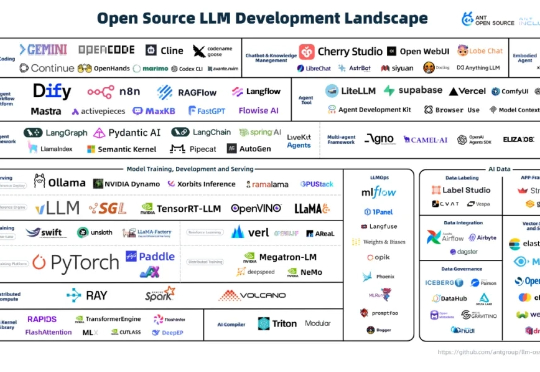

等了一百多天,悬念终于揭晓。 9 月 13 日上午,蚂蚁集团开源团队(「开源技术增长」)携《 2025 大模型开源开发生态全景图 》2.0 版,亮相上海外滩大会。

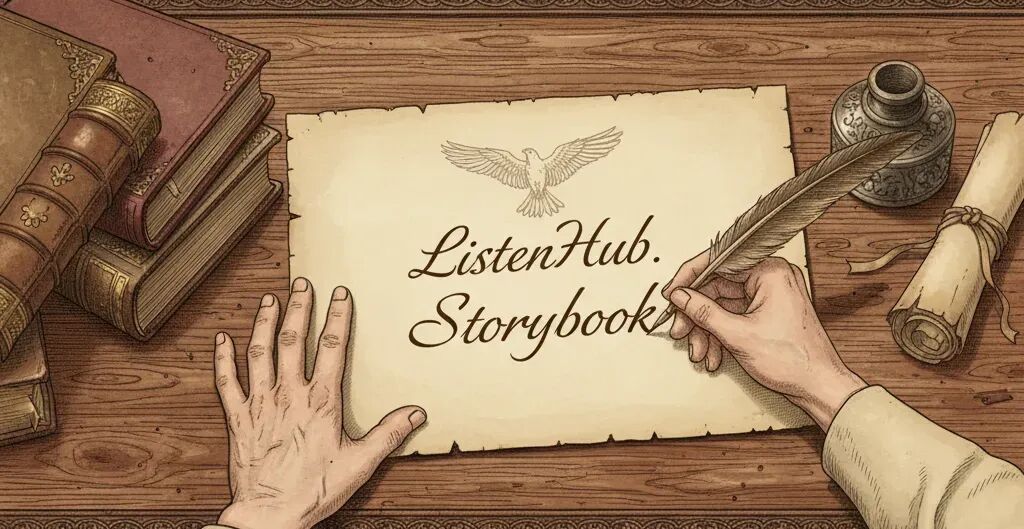

缘起 我们为什么要做视频绘本呢?它源于一位父亲小小的愿望。 ListenHub 的 CTO Kris 是一名新手爸爸,他每天在家听到孩子说的最多的三个字就是:讲故事。 孩子永远有数不清的故事想听,同一

在大厂内部“从0到1”推动并构建数据基础设施十余年之后,离哲选择走向台前,开启一场真正意义上的“从技术到产品、从产品到服务闭环”的创业实验。