动动嘴写SQL!Codex+终身记忆,OpenAI把查询难度直接归零

动动嘴写SQL!Codex+终身记忆,OpenAI把查询难度直接归零2026年初,当大多数企业还在用数据分析师手动写SQL查表时,OpenAI内部曝光的能自主思考、推理甚至自我进化的数据分析智能体,将数据查询从「天数级」缩短至「分钟级」。

搜索

搜索

2026年初,当大多数企业还在用数据分析师手动写SQL查表时,OpenAI内部曝光的能自主思考、推理甚至自我进化的数据分析智能体,将数据查询从「天数级」缩短至「分钟级」。

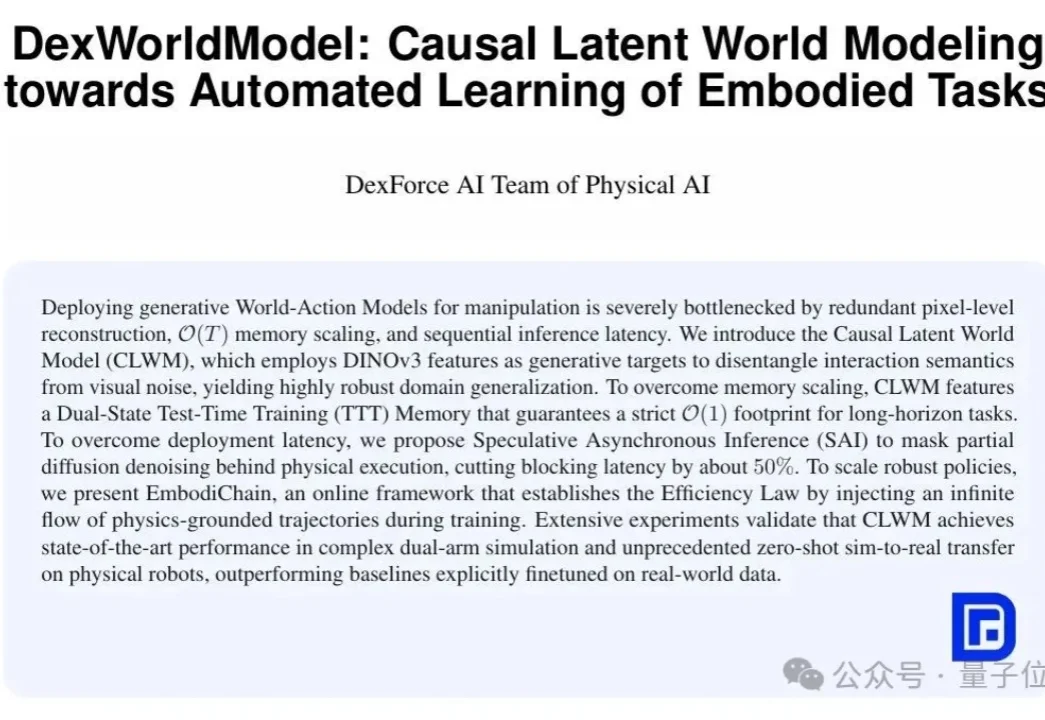

今年4月,具身智能领域发生了一件看起来不大、但意味深长的事。

当谈及数学时,我们近乎本能地认为,数学是一个严谨、精确、不容置疑的完美逻辑体系,但在菲尔兹奖得主迈克尔・弗里德曼(Michael Freedman)眼中,人类真正创造和关心的数学,本质上是「柔软且可塑」的。

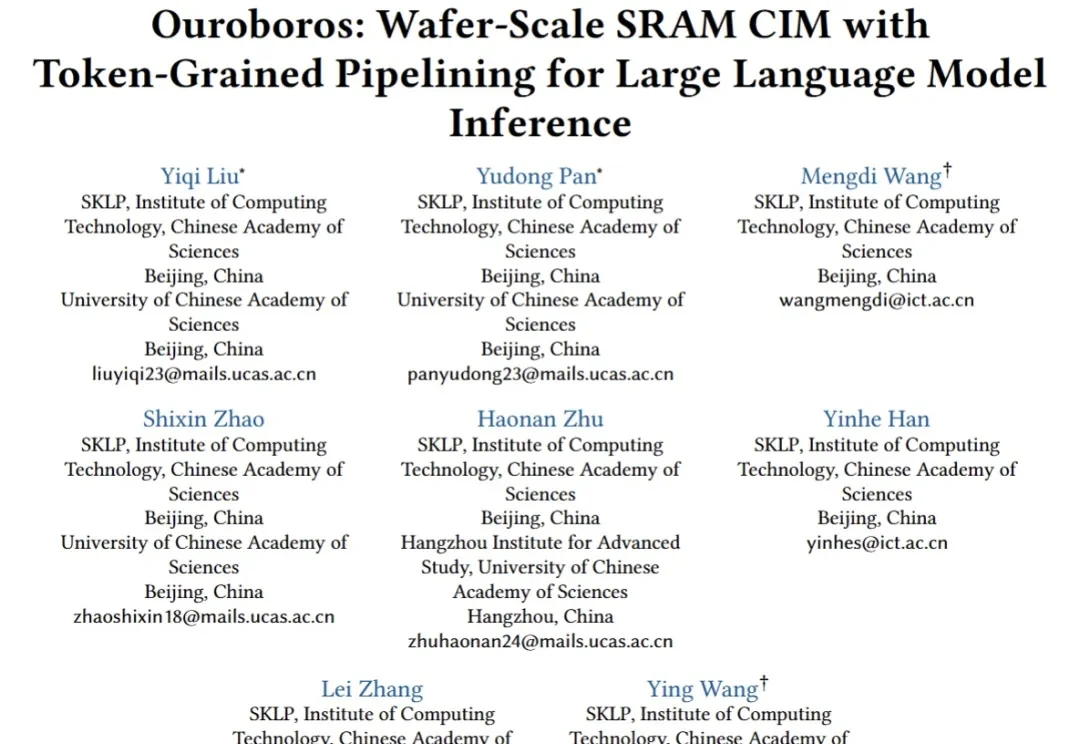

当前大模型的发展呈现出类似于“军备竞赛”的趋势——模型规模持续攀升,对计算硬件的需求也随之快速增长。

如果把今天最热门的几个方向摆在一起看,你会发现它们其实在卡同一道坎。

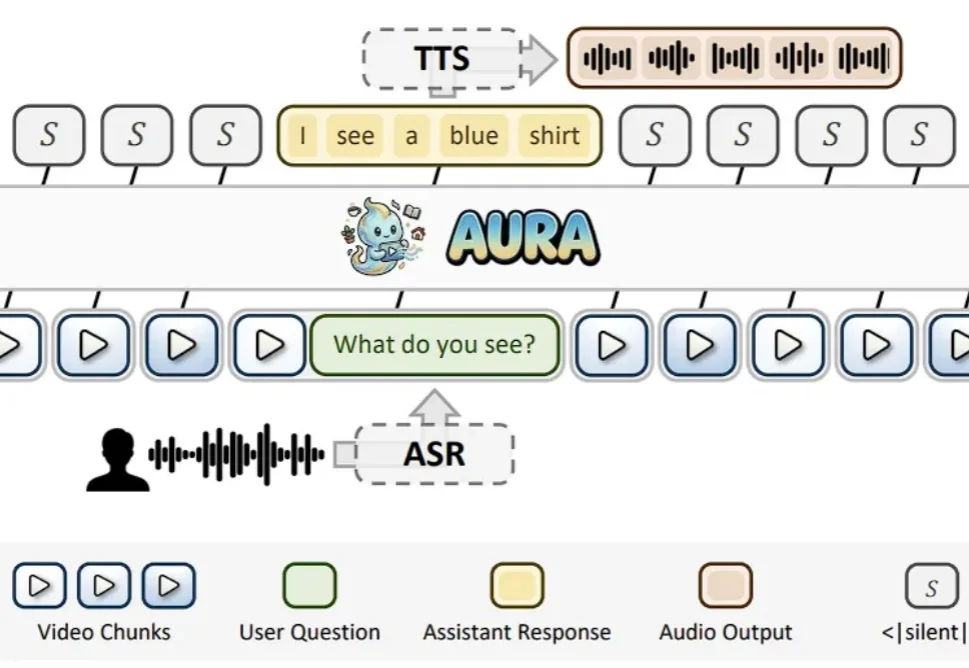

近年来,视频多模态大模型(VideoLLM)发展迅猛,在视频描述、视频问答、时序定位等任务上不断刷新性能上限。随着模型能力持续增强,业界也开始思考一个更重要的问题:视频大模型能不能不再只是 “看完一段视频再回答”,而是真正进入实时世界,持续观察、实时理解,并在关键时刻主动给出反馈?

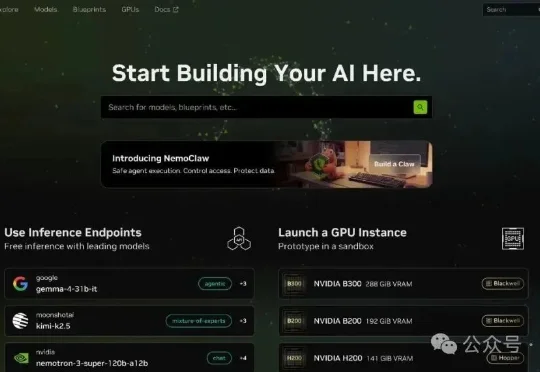

英伟达良心福利!免费领一年顶级大模型订阅,MiniMax / Kimi / DeepSeek 全都能用!NVIDIA 官方平台build.nvidia.com开放了一批"Free Endpoint"模型,注册账号、验证手机号后就能生成一把最长有效期12 个月的 API Key,免费调用几十个当下最火的大模型——不计 Token、无余额限制、无需信用卡。

今天,我们发布并开源 Kimi K2.6 模型,带来行业领先(state-of-the-art)的代码、长程任务执行和 Agent 集群能力。Kimi K2.6 现已上线 kimi.com、最新版 Kimi 应用、Kimi API 和 Kimi Code 编程助手,所有用户都可以开始使用。

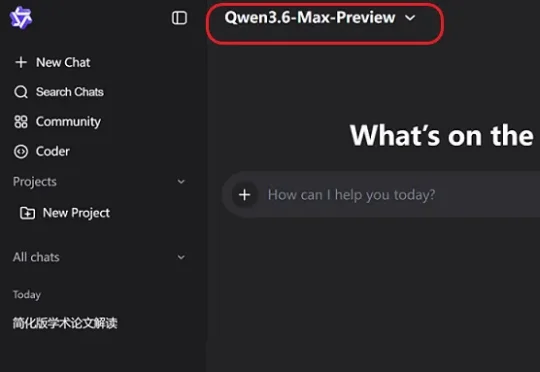

今天,阿里发布了其下一代旗舰模型的早期预览版:Qwen3.6-Max-Preview。在第三方评测榜单Artificial Analysis的智能指数排名中,Qwen3.6-Max-Preview的得分为52分,小幅超过GLM-5.1、MiniMax-M2.7,成为这一榜单上得分最高的国产模型。

刚刚,一批 ChatGPT Pro 用户在社交媒体上炸了锅: 他们发现自己的 Pro 模型好得「不对劲」。没有推送通知,没有官方发布会,没有「奥特曼瘫坐」。就这样,OpenAI悄悄完成了一次可能改变竞争格局的升级。