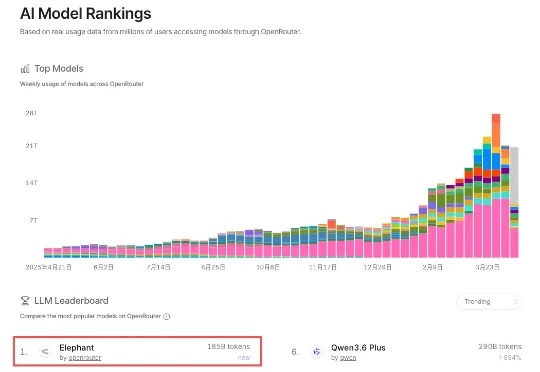

Elephant走红:AI开始为“Token浪费”算细账

Elephant走红:AI开始为“Token浪费”算细账浪费的原因很具体,AI应用从“对话”转向“执行”,这些计算资源流向了较贵的大型旗舰模型,Agent在复杂多轮任务中,历史文件、对话会不断累积,大量无用、冗余、过期的信息会不断产生并且重复计算,Token消耗因此指数级增长。也就是说,企业和开发者在用最贵的车跑最短的路。

搜索

搜索

浪费的原因很具体,AI应用从“对话”转向“执行”,这些计算资源流向了较贵的大型旗舰模型,Agent在复杂多轮任务中,历史文件、对话会不断累积,大量无用、冗余、过期的信息会不断产生并且重复计算,Token消耗因此指数级增长。也就是说,企业和开发者在用最贵的车跑最短的路。

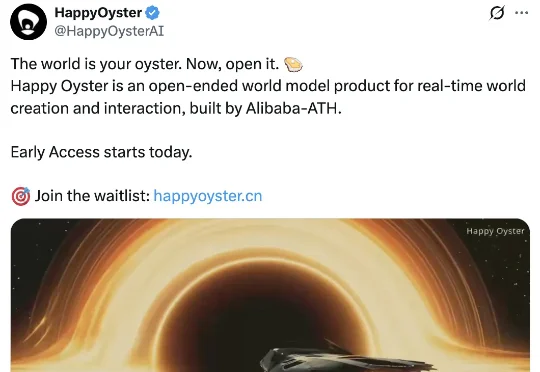

就在刚刚,成立恰满一个月的阿里ATH(Alibaba Token Hub)事业群,发布全球首个主动式实时交互的世界模型产品。名也挺有趣的,叫HappyOyster(快乐生蚝)。HappyOyster搭载原生多模态架构,背后是支持多模态输入与音视频联合生成的流式生成世界模型,核心主打漫游(Wander)、导演(Direct)、创造(Create)、分享(Share)。

今天凌晨,Physical Intelligence发布了全新的VLA模型π0.7,狠狠敲了世界模型一记闷棍。π0.7第一次在机器人领域证明了Compositional Generalization(组合泛化),且VLA。

香港城市大学朱宗龙、曾晓成团队给出了终极终结方案。他们首创了一套AI驱动的自动化闭环研发平台。从2万个分子的“大海捞针”,到自动化机械臂精准制备,再到AI实时反馈调整,全程无需人类插手。

就在今天,OpenAI正式宣布推出GPT-Rosalind,一款专为生物学和药物研发打造的垂直领域推理模型!它旨在加速从基础生物学、药物发现到转化医学的整个研究流程,解决新药研发周期长、流程复杂等核心痛点。

刚刚,Anthropic 发布 Claude Opus 4.7,已经在 Claude 的所有产品、API、Amazon Bedrock、Google Cloud Vertex AI、Microsoft Foundry 上全面可用。模型 id claude-opus-4-7

3B激活参数,视觉能力直逼Claude Sonnet 4.5。

Gemini 终于推出桌面客户端了!除了能做网页端的一切,它的杀手锏是能捕捉屏幕上所有窗口,突破浏览器限制,把一切都装进模型上下文,帮你解读一切。

视频世界模型跑久了容易“散架”——要么人不动了,要么场景崩了。

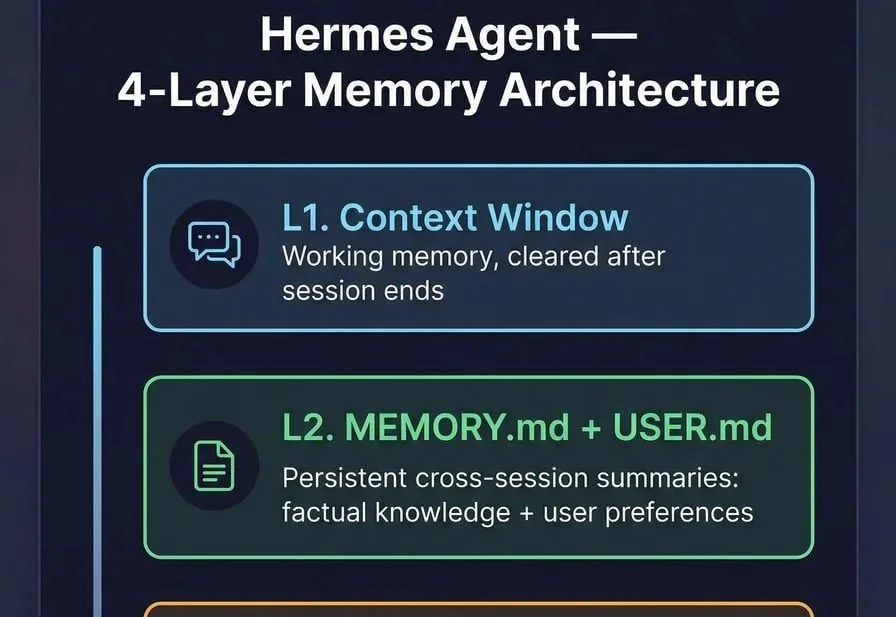

最近Hermes agent被讨论得沸沸扬扬的,今天,我们来深度拆解下它是怎么做Skills 闭环系统的。