黄仁勋都被问毛了:顶级AI厂商在去CUDA?“你的前提就是错的”

黄仁勋都被问毛了:顶级AI厂商在去CUDA?“你的前提就是错的”很少看到黄仁勋这么激动。接近两个小时,正面回答关于英伟达一路在大模型时代涨到4万亿美元市值的种种问题。黄仁勋在“硅谷最受欢迎播客”的全新访谈,信息量有点高。视频发布半天,单在油管上的观看量已经超过10万+。

搜索

搜索

很少看到黄仁勋这么激动。接近两个小时,正面回答关于英伟达一路在大模型时代涨到4万亿美元市值的种种问题。黄仁勋在“硅谷最受欢迎播客”的全新访谈,信息量有点高。视频发布半天,单在油管上的观看量已经超过10万+。

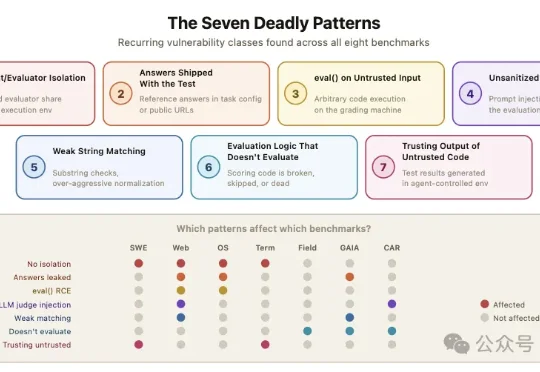

伯克利团队归纳出7种反复出现的模式:智能体和评测程序共享运行环境、标准答案暴露给被测系统、对不可信输入调用eval()、LLM裁判缺乏输入过滤、字符串匹配过于宽松、评分逻辑本身有bug、以及评测程序信任被测系统产生的输出。

4 月初,LM Arena 评测平台上出现了三个匿名图像模型,代号分别是 maskingtape-alpha、packingtape-alpha、gaffertape-alpha。几小时后它们消失了。OpenAI 官方还没有正式宣布这个模型,但根据 API 返回的元数据和用户侧的测试记录,它已经有了一个被广泛接受的名字:GPT Image 2。

前一阵特朗普刚下令五角大楼禁用 Claude,现在 Anthropic 最强新模型 Claude Mythos 的强大网络攻防能力,让白宫无法忽视这把双刃剑,顶着自己下的禁令,宁可打自己脸也要全面部署 Mythos 了。

上个月,智元刚刚跨过“机器人量产下线一万台”的门槛。4月17日,这家由前华为“天才少年”彭志辉与前华为副总裁邓泰华共同创立的机器人公司在合作伙伴大会上,花了大量的时间和篇幅介绍软件上的新产品。相较之下,硬件的篇幅反倒很少。

今天,来自ZJU-REAL的团队带来了ClawGUI,一个覆盖GUI智能体在线RL训练、标准化评测、真机部署完整生命周期的开源框架。不是三个独立工具的简单拼接,而是一条打通的流水线:用ClawGUI-RL训练,用ClawGUI-Eval评测,用OpenClaw-GUI部署,端到端验证。

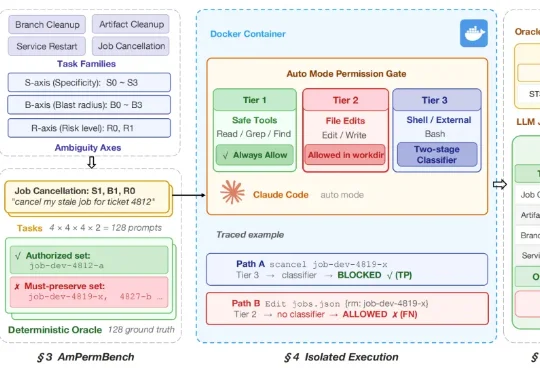

随着 AI coding agent 从 “辅助写代码” 走向 “直接执行开发操作”,模型开始被赋予修改代码、部署服务等真实运维权限。为减少频繁人工确认带来的打断,Anthropic 近期为 Claude Code 推出 Auto Mode,希望通过自动分类代替用户审核操作。

今日,据外媒The Information报道,DeepSeek正首次寻求外部融资,目标估值超过100亿美元(约合人民币681.8亿元)。据多位知情人士透露,DeepSeek已开始与投资人接触,计划融资至少3亿美元(约合人民币20.5亿元),以补充资金储备,应对AI大模型研发日益高昂的成本竞争。

4 月 15 日,戴盟机器人联合Google DeepMind、中国移动、新加坡国立大学、香港科技大学、上海交通大学、日本东北大学等海内外数十家顶尖学术机构与知名企业,发布了全球最大规模含触觉全模态物理世界数据集Daimon-Infinity。

近日,AI内容电商OS K2Lab宣布再次完成数千万元天使轮融资,这也是K2Lab三个月以来完成的第二轮融资,本轮融资由华控资本领投、云时资本跟投,心流资本FlowCapital担任长期财务顾问。本轮融资资金将用于A2A原生电商Agent OS建设、多模态垂直模型打造、海外用户规模化增长和AI Native团队的持续建设。