OpenAI也开始恐惧自己训练出的新模型了

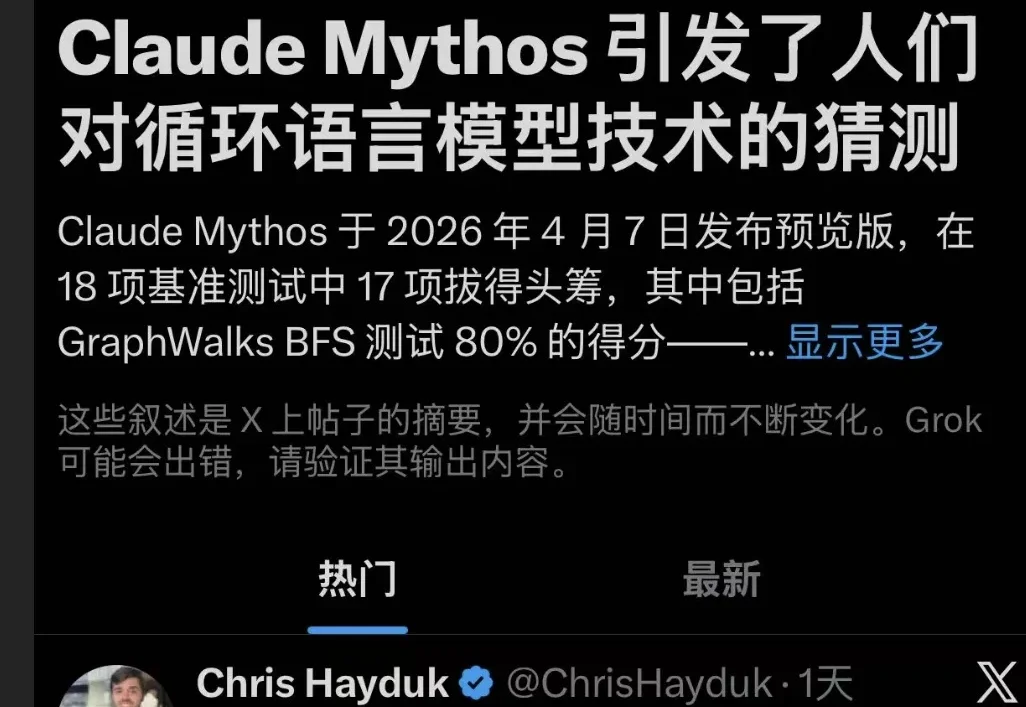

OpenAI也开始恐惧自己训练出的新模型了看到 Anthropic 内测中的下一代旗舰模型 Mythos 强大的网络攻防能力带来的巨大影响和讨论度,奥特曼坐不住了,也计划内测 OpenAI 具有强大的网络攻防能力的 AI。

搜索

搜索

看到 Anthropic 内测中的下一代旗舰模型 Mythos 强大的网络攻防能力带来的巨大影响和讨论度,奥特曼坐不住了,也计划内测 OpenAI 具有强大的网络攻防能力的 AI。

不与世界交手,何以理解世界?

Google DeepMind调查了一万个人,结果让整个AI安全评估体系汗颜:AI做了三倍多的「坏事」,但造成的实际伤害几乎一样。这意味着,我们现在用来证明AI安全的那套逻辑,可能从一开始就是错的。

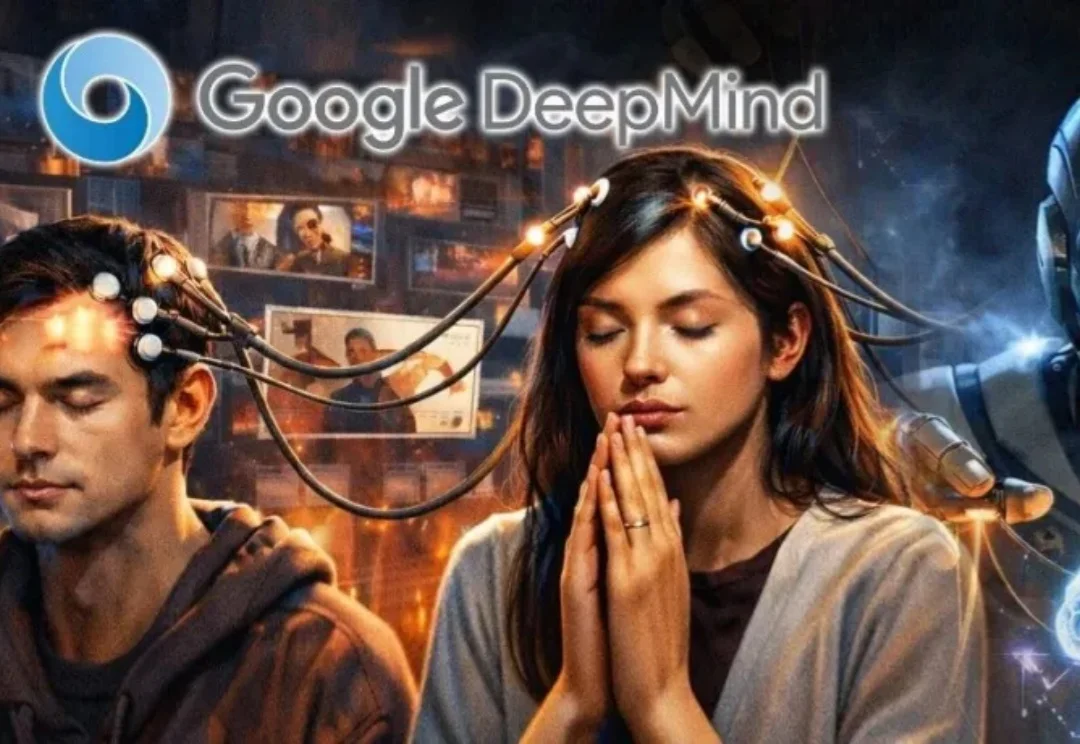

过去一段时间,生成理解统一模型(Unified Model)经常被理解成一种「既能看懂图、又能生成图」的多模态通用系统。

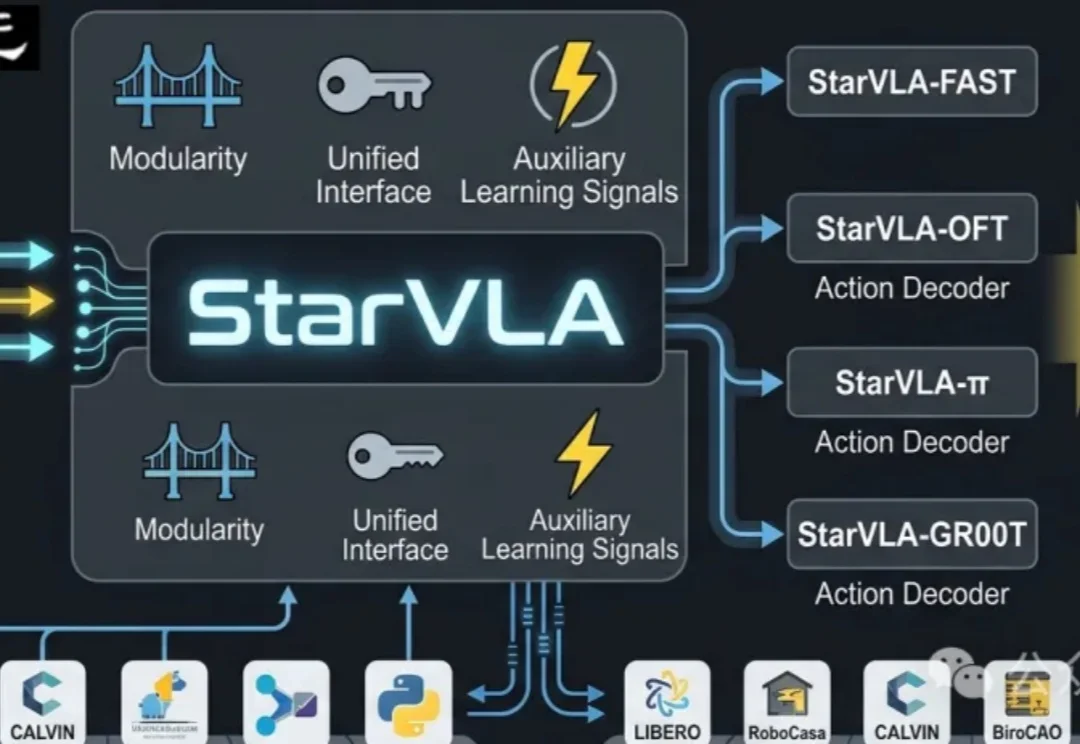

当前具身智能的VLA(Vision-Language-Action)赛道正陷入典型的「碎片化」泥潭:不同团队采用异构的动作解码范式、强耦合的数据管线、互不兼容的评测协议,导致方法难以横向对比,复现成本极高。

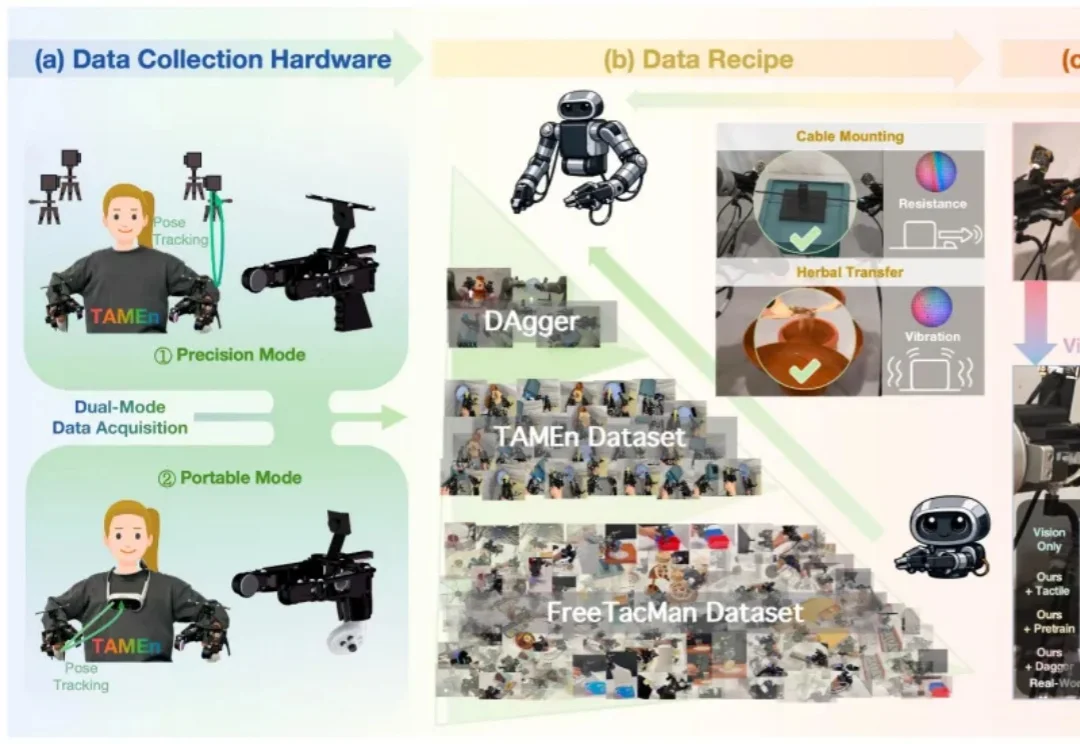

在具身智能快速发展的今天,高质量数据已成为驱动能力提升的关键基础,然而一个核心问题也随之而来: 如何让机器人数据采集更快、更稳、更有效?

让一个模型概括“这是一段什么视频”,并不难。

Claude最强“神话”模型,可能用到来自字节的技术?

过去一年,大模型的能力曲线几乎是指数上升的——推理更强、工具调用更稳、上下文窗口越撑越大。但一个越来越尖锐的问题也随之浮出水面:模型变强了,可承接它的那层东西在哪?

有没有想过让「龙虾」替你打麻将?