硅谷豪赌算力烧到停电,中国团队反向出击!这一刀,直接砍碎Scaling Law

硅谷豪赌算力烧到停电,中国团队反向出击!这一刀,直接砍碎Scaling Law思考token在精不在多。Yuan 3.0 Flash用RAPO+RIRM双杀过度思考,推理token砍75%,网友们惊呼:这就是下一代AI模型的发展方向!

搜索

搜索

思考token在精不在多。Yuan 3.0 Flash用RAPO+RIRM双杀过度思考,推理token砍75%,网友们惊呼:这就是下一代AI模型的发展方向!

Seedance2.0的火,已经烧了好几天了。

AI 时代,别搞虚的,真实才是必杀技。

首个统一系统:将物理机器人提升为与 GPU 同等的计算资源,打破硬件隔阂。

在十九世纪的暹罗王国曾诞生过这样一对连体兄弟:他们分别拥有完整的四肢和独立的大脑,但他们六十余年的人生被腰部相连着的一段不到十厘米的组织带永远绑定在了一起。他们的连体曾带来无尽的束缚,直到他们离开暹罗,走上马戏团的舞台。十年间,两兄弟以近乎合二为一的默契巡演欧美,获得巨大成功。

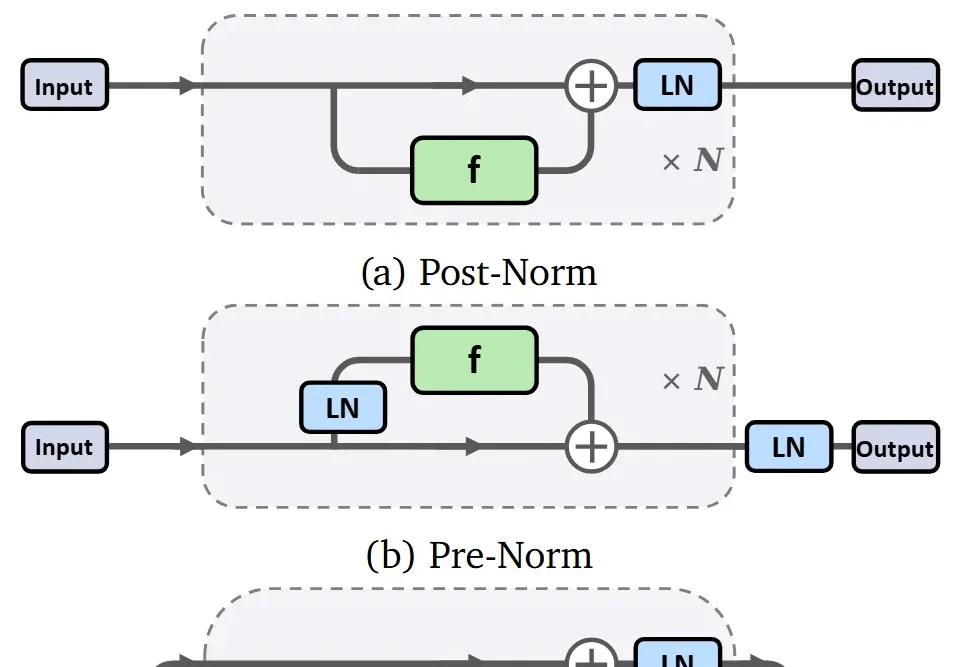

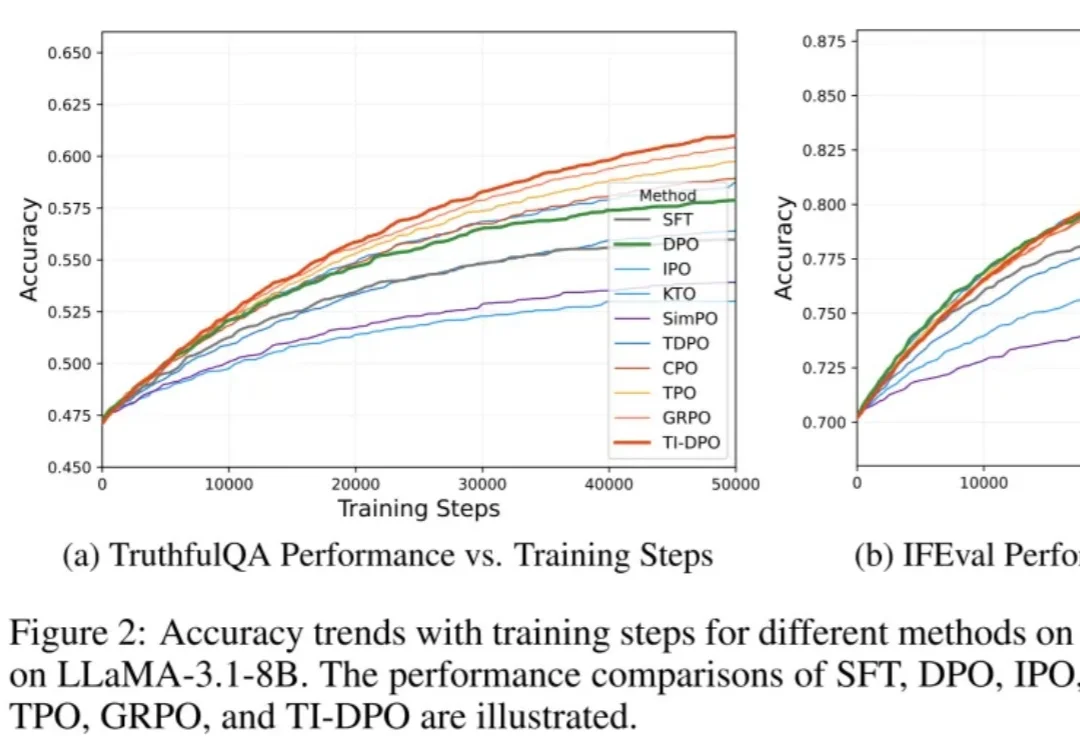

在当今的大模型后训练(Post-training)阶段,DPO(直接偏好优化) 凭借其无需训练独立 Reward Model 的优雅设计和高效性,成功取代 PPO 成为业界的 「版本之子」,被广泛应用于 Llama-3、Mistral 等顶流开源模型的对齐中。

从写代码、调模型,到生成内容、驱动产品,AI 正在重新塑造“创造”的方式,也不断逼近一个绕不开的问题:当机器越来越能干,程序员究竟该站在什么位置?

这两天,一款名为Pony Alpha的模型,凭借在Coding能力上的出色表现,一时间成为了AI圈内最火爆的名字。

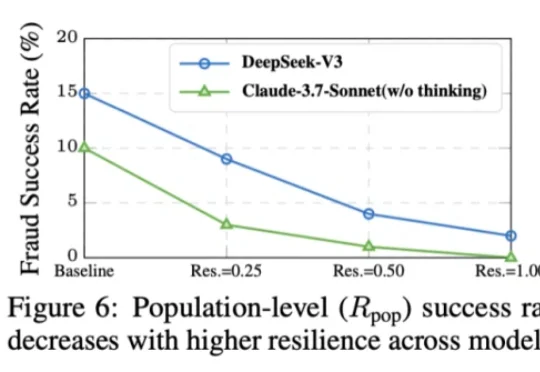

本⽂的主要作者来⾃上海交通⼤学和上海⼈⼯智能实验室,核⼼贡献者包括任麒冰、郑志杰、郭嘉轩,指导⽼师为⻢利庄⽼师和邵婧⽼师,研究⽅向为安全可控⼤模型和智能体。 最近,Moltbook 的爆⽕与随后的迅速

谁能想到啊,在自回归模型(Autoregressive,AR)当道的现在,一个非主流架构的模型突然杀了回马枪——被长期视为学术玩具的扩散语言模型,直接在复杂编程任务中飙出了892 tokens/秒的速度!