斯坦福Arc Tahoe-100M虚拟细胞团队专访:AI制药的壁垒不是"模型"?而是高质量、亿级规模的数据集

斯坦福Arc Tahoe-100M虚拟细胞团队专访:AI制药的壁垒不是"模型"?而是高质量、亿级规模的数据集Vevo Therapeutics(现为Tahoe)与Arc研究所,两家分别在生物技术商业转化和非营利性基础研究领域领先的机构,于2025年2月联合发布了一项里程碑式的成果:全球最大的单细胞药物扰动数据集Tahoe-100M。

Vevo Therapeutics(现为Tahoe)与Arc研究所,两家分别在生物技术商业转化和非营利性基础研究领域领先的机构,于2025年2月联合发布了一项里程碑式的成果:全球最大的单细胞药物扰动数据集Tahoe-100M。

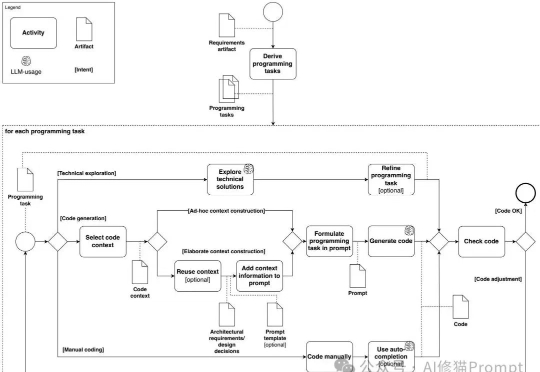

您是否也曾经想过这样的场景:产品经理把idea直接扔给AI编程,然后就能得到完美能用的代码?来自德国弗劳恩霍夫研究所和杜伊斯堡-埃森大学的研究者们刚刚给我们泼了一盆冷水。

在硅谷,顶尖AI人才的身价突破天际!最近,Meta豪掷数亿美元签下最顶尖的AI研究者。硅谷这场人才战争也越演越烈。这是否值得投资?这场人才争夺背后,又隐藏着怎样的深层次问题?

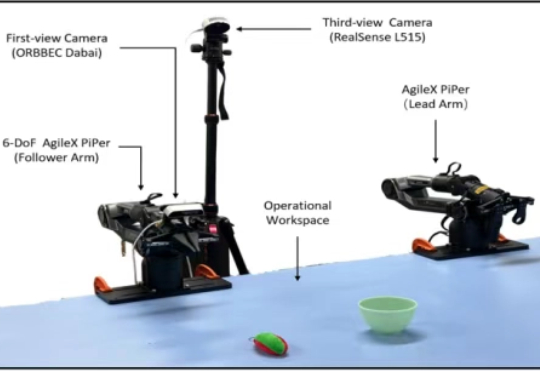

近年来,视觉 - 语言 - 动作(Vision-Language-Action, VLA)模型因其出色的多模态理解与泛化能力,已成为机器人领域的重要研究方向。尽管相关技术取得了显著进展,但在实际部署中,尤其是在高频率和精细操作等任务中,VLA 模型仍受到推理速度瓶颈的严重制约。

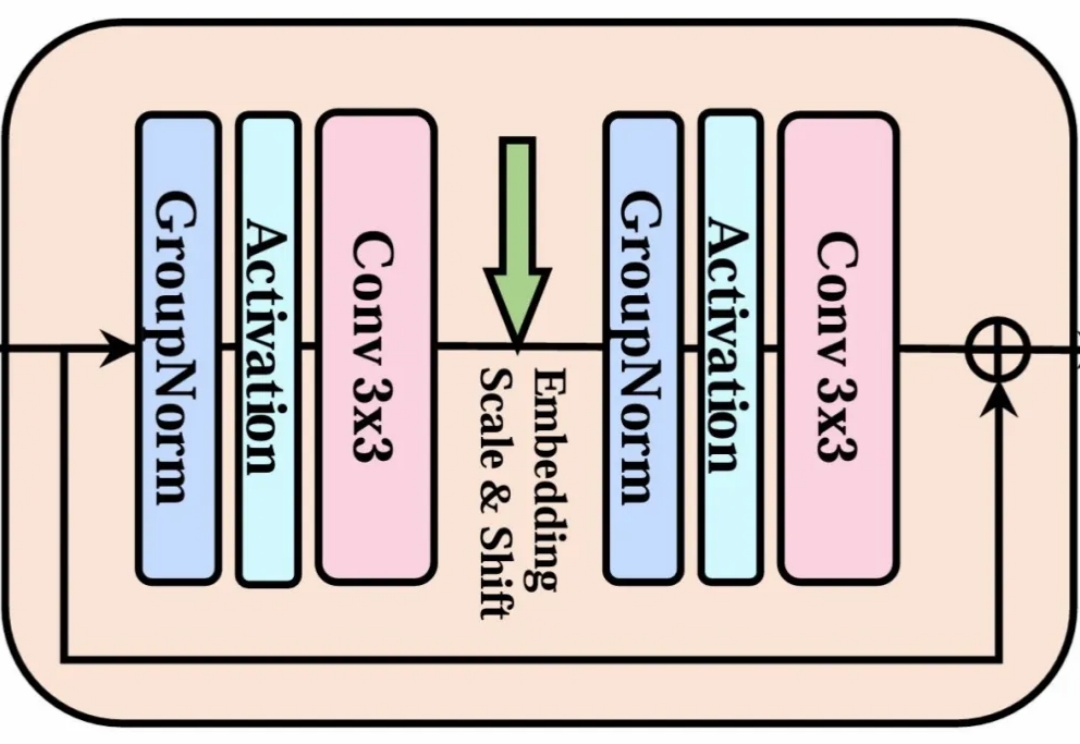

当整个 AI 视觉生成领域都在 Transformer 架构上「卷生卷死」时,一项来自北大、北邮和华为的最新研究却反其道而行之,重新审视了深度学习中最基础、最经典的模块——3x3 卷积。

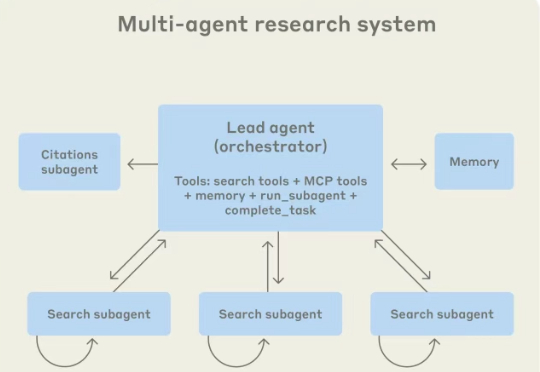

在这篇文章中,它详细展示了如何构建一个有效的多智能体研究系统,这是一个架构,其中主代理(The Lead Agent)会生成和协调子代理(Subagents),以并行方式探索复杂查询,内容涵盖系统架构、提示工程以及评估方法等。

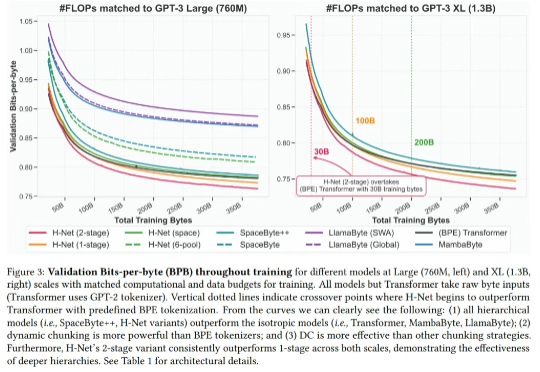

最近,Mamba 作者之一 Albert Gu 又发新研究,他参与的一篇论文《 Dynamic Chunking for End-to-End Hierarchical Sequence Modeling 》提出了一个分层网络 H-Net,其用模型内部的动态分块过程取代 tokenization,从而自动发现和操作有意义的数据单元。

「停止研究 RL 吧,研究者更应该将精力投入到产品开发中,真正推动人工智能大规模发展的关键技术是互联网,而不是像 Transformer 这样的模型架构。」

GPT-4o引爆全球「吉卜力风格」风潮后,其核心成员——华南理工学霸Lu Liu与伯克利博士Allan Jabri——双双跳槽Meta,两人曾在OpenAI主导多模态AI研究,与奥特曼同台展示关键功能。此次挖角再次凸显OpenAI内部动荡后的人才流失危机。

昨天,14亿年薪被挖的大牛刚刚震惊全网,今天Meta就被前研究员怒发「血书」控诉:别再到处撒钱乱挖人了,先治好你们的内斗癌!2000字爆料字字泣血,直指Meta公司文化崩坏、末位淘汰如毒瘤、团队抢功无下限。硅谷最贵围城,真的是墙外人想进,墙内人想逃