斯坦福实测GPT-5与Claude 4.5“双盲实验。AI编程,没有协作类产品的原因找到了

斯坦福实测GPT-5与Claude 4.5“双盲实验。AI编程,没有协作类产品的原因找到了为什么在LLM推理能力大幅跃升的2026,我们依然只有AI Copilot而没有AI Teammate?尽管AI编程工具遍地开花,但不管是Claude Code还是Codex,本质上仍是“单Agent开发”或“主从控制”架构。而“AI结对编程”迟迟无法落地?

为什么在LLM推理能力大幅跃升的2026,我们依然只有AI Copilot而没有AI Teammate?尽管AI编程工具遍地开花,但不管是Claude Code还是Codex,本质上仍是“单Agent开发”或“主从控制”架构。而“AI结对编程”迟迟无法落地?

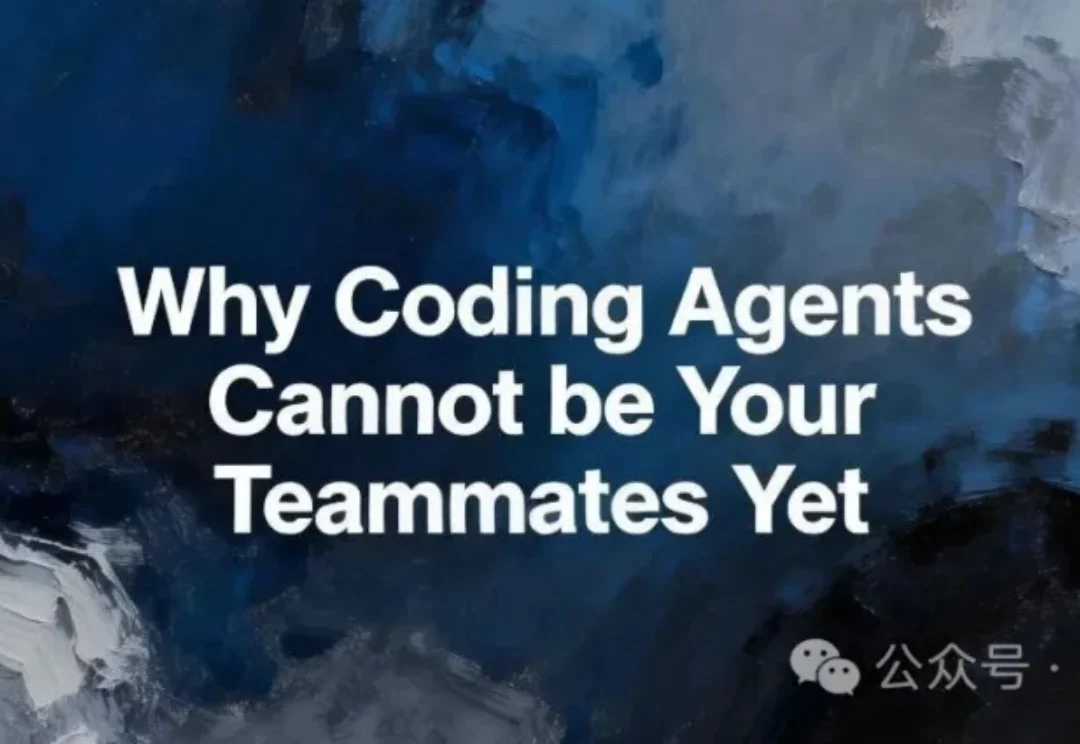

最近,在GitHub上发现一个宝藏项目Project_Golem 。

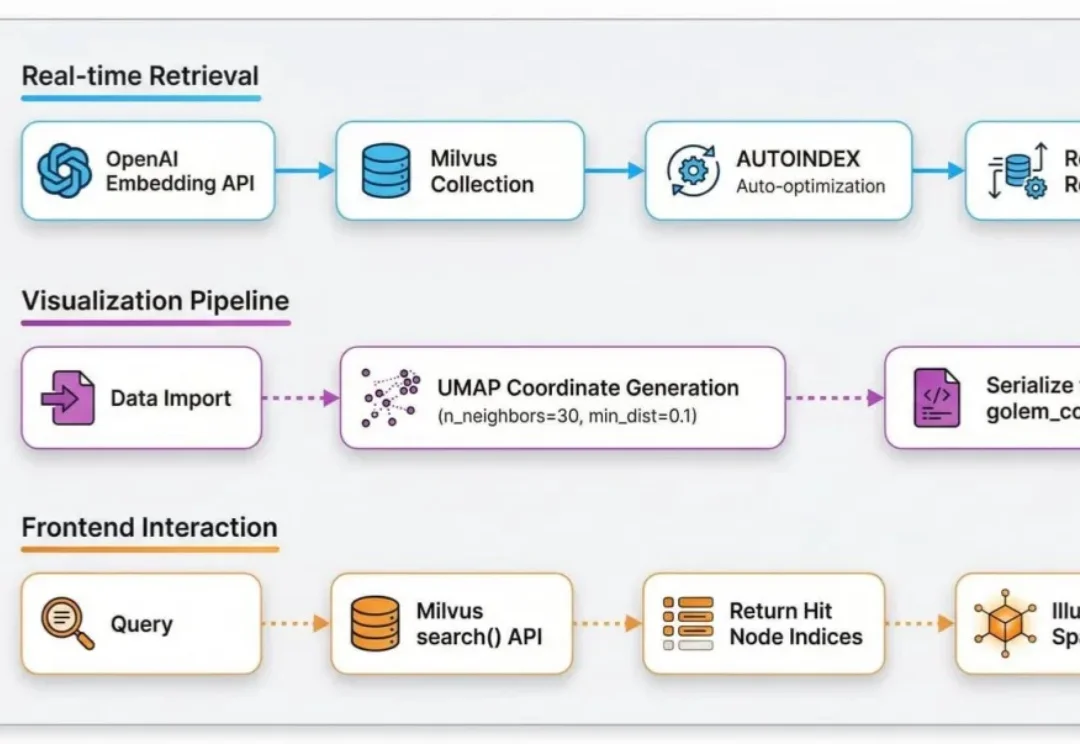

AI 智能体是人工智能领域的重要研究方向之一。近期,字节跳动的李航博士在我国计算机科学领域顶级期刊 Journal of Computer Science and Technology(JCST)上发表了一篇题为《General Framework of AI Agents》的观点论文(将收录于 JCST 创刊 40 周年专辑),提出了一个涵盖软件智能体和硬件智能体的通用框架。

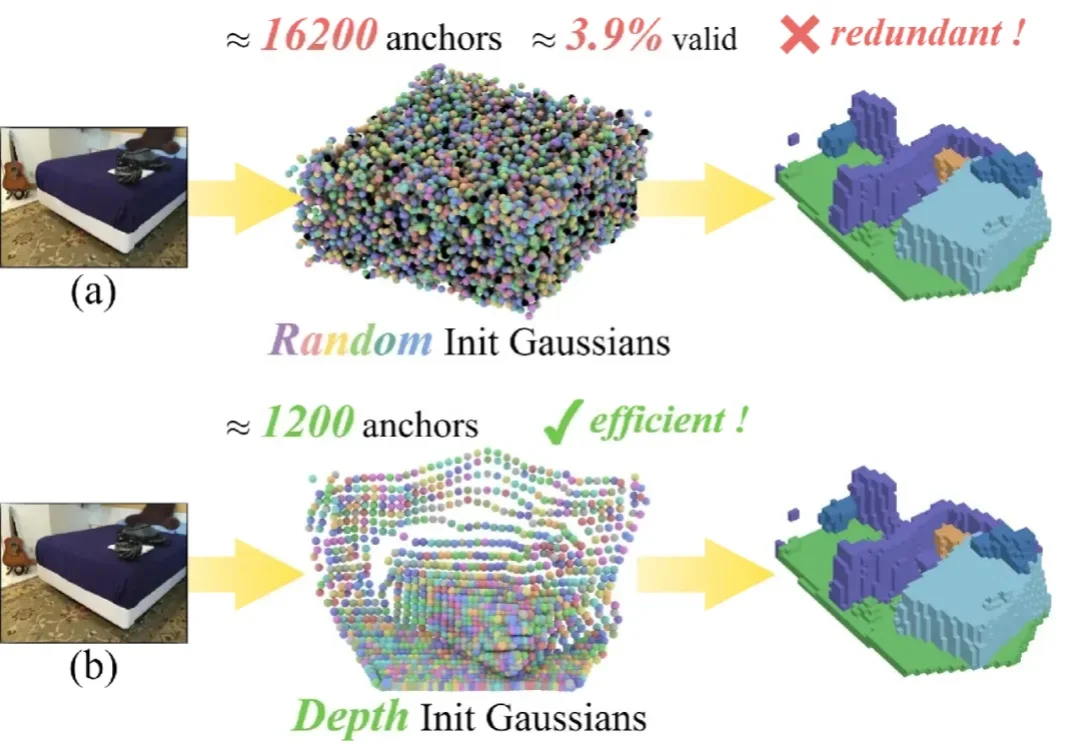

单目 3D 语义场景补全 (Semantic Scene Completion, SSC) 是具身智能与自动驾驶领域的一项核心技术,其目标是仅通过单幅图像预测出场景的密集几何结构与语义标签。

在技术如火如荼发展的当下,业界常常在思考一个问题:如何利用 AI 发现科学问题的新最优解?

在 AI 浪潮席卷全球的今天,大模型在写诗、作画、敲代码上已经展现出惊人的天赋。然而,在面对严谨、硬核的物质科学(物理、化学、材料)时,却常常表现得像个“偏科生”:它们能侃侃而谈化学理论,却在最基础的分子式、晶体结构书写和反应推理上频繁出现不稳定输出:说的像那么回事,写出来却漏洞百出。

2026 刚开年,Anthropic 就用 Claude Cowork 开启了 AI 行业新的创业热点。

什么样的思维链,能「教会」学生更好地推理?

我们都在System Prompt里写过无数次 You are a helpful assistant,但你是否想过:这行文字在模型的残差流(Residual Stream)中究竟对应着怎样的几何结构?

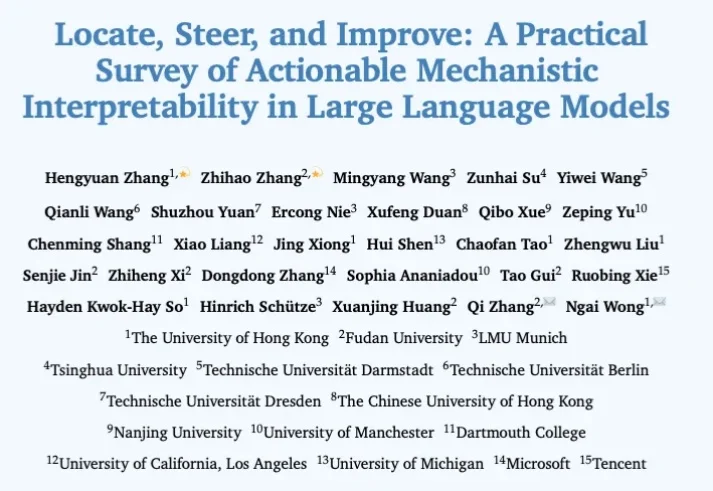

过去几年,机制可解释性(Mechanistic Interpretability)让研究者得以在 Transformer 这一 “黑盒” 里追踪信息如何流动、表征如何形成:从单个神经元到注意力头,再到跨层电路。但在很多场景里,研究者真正关心的不只是 “模型为什么这么答”,还包括 “能不能更稳、更准、更省,更安全”。