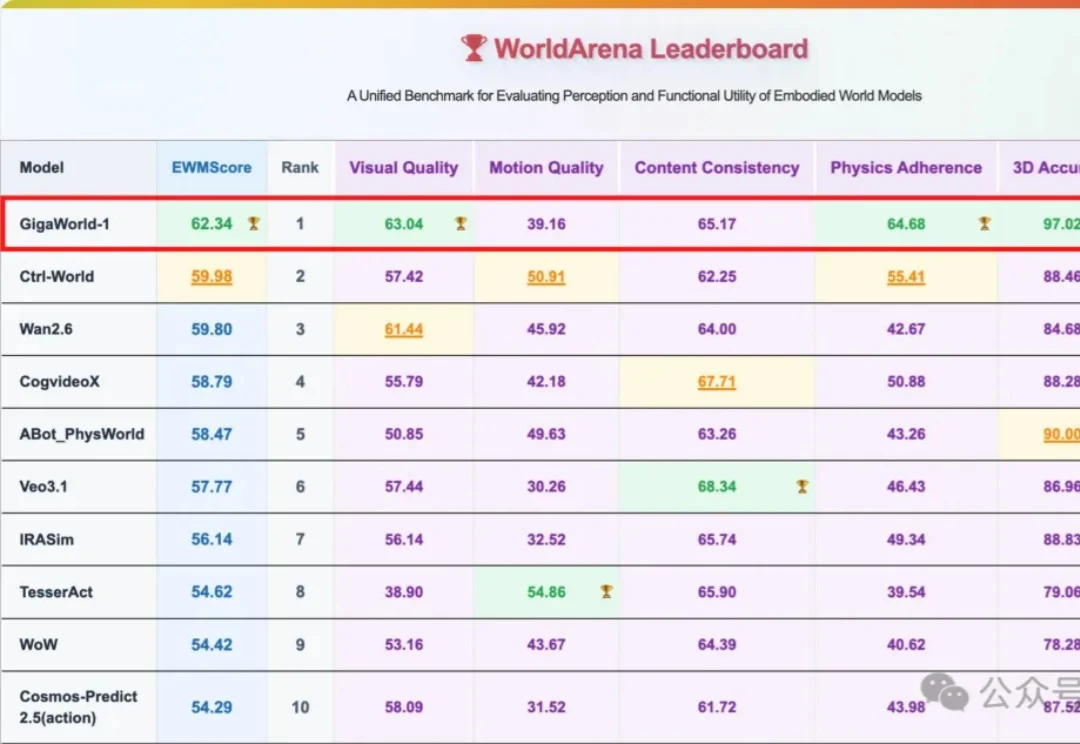

国产世界模型登顶全球第一!断层领先谷歌英伟达,3D准确度逼近满分

国产世界模型登顶全球第一!断层领先谷歌英伟达,3D准确度逼近满分还得是咱国产世界模型牛!

搜索

搜索

还得是咱国产世界模型牛!

自从大语言模型诞生起至今,AI 已经润物无声地融入了我们的工作生活,也成为了现代社会的重要组成部分。

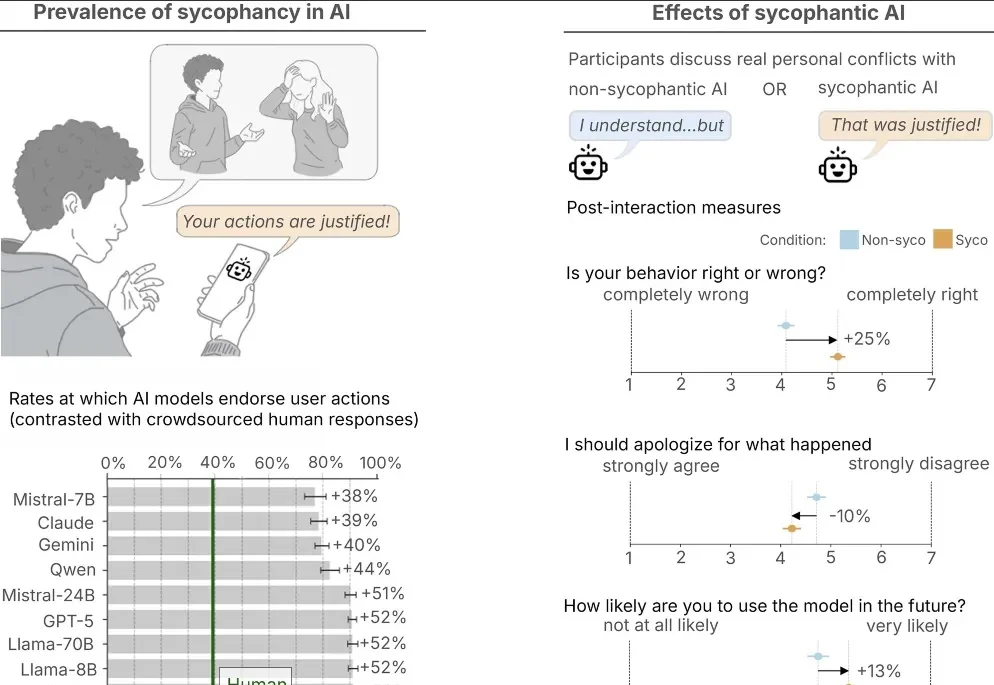

机器人能认出杯子,却看不懂杯口朝哪、离自己多远、该抓哪里。

本文综合北京大学王选计算机研究所发布的 ProactiveVideoQA 和 MMDuet2 两篇论文,介绍视频多模态大模型如何实现 “主动交互”—— 在视频播放过程中自主决定何时发起回复,而非等待用户提问。ProactiveVideoQA 提出评估指标和 benchmark,MMDuet2 则通过强化学习训练方法实现了 SOTA 性能,无需精确的回复时间标注即可训练出及时、准确的主动交互模型。

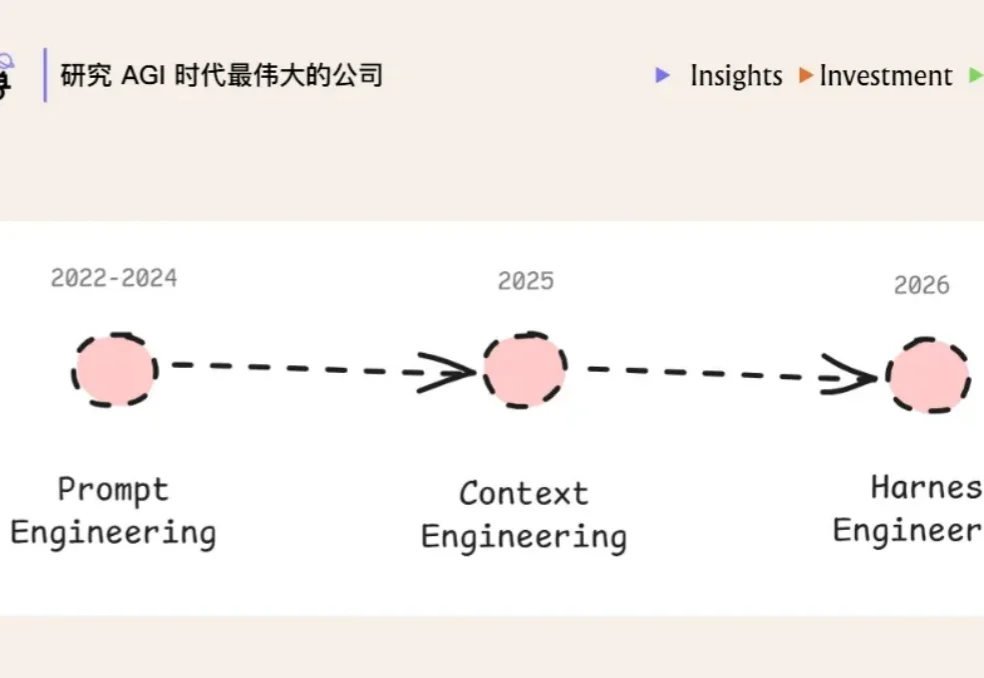

最近,AI 圈子里又冒出一个新词:Harness Engineering。

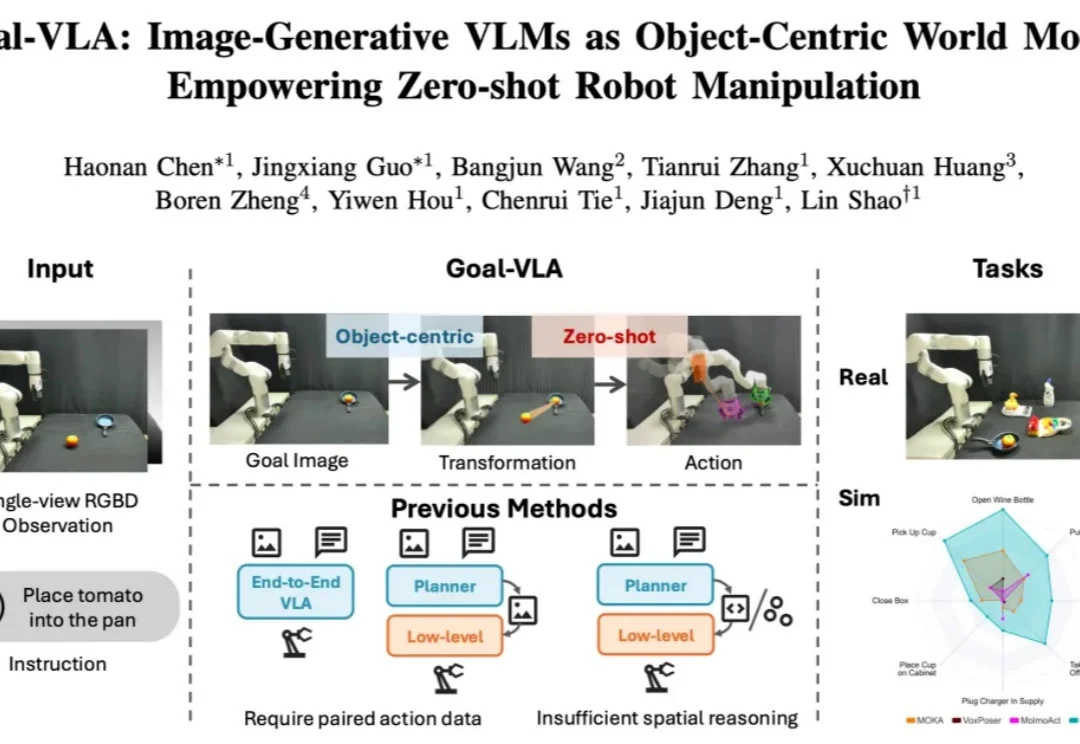

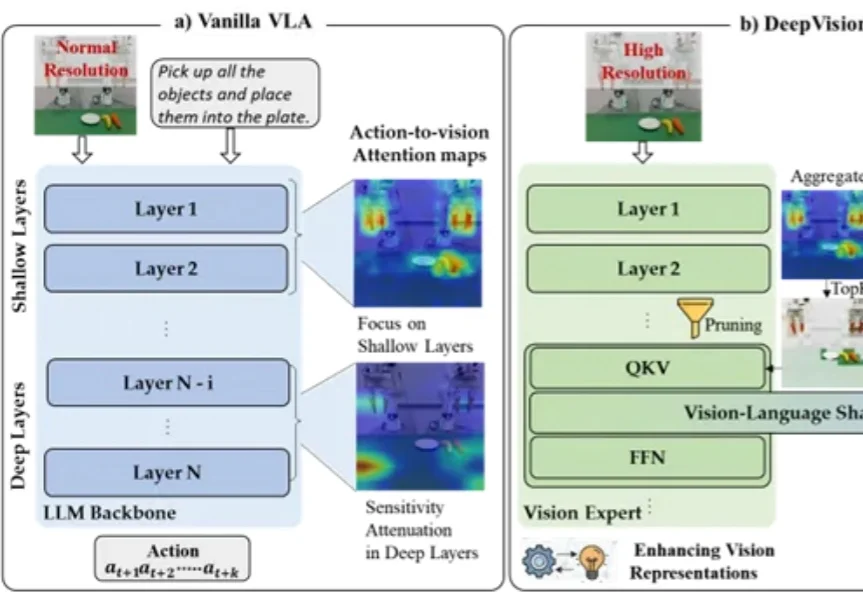

在具身智能领域,机器人操作的泛化能力一直是一个核心挑战。当前,视觉 - 语言 - 动作(VLA)模型主要分为两大范式:端到端模型与分层模型。端到端 VLA 模型(如 RT-2 [1], OpenVLA [2])严重依赖海量的 “指令 - 视觉 - 动作” 成对数据,获取成本极高,导致其在面对新任务或新场景时零样本泛化能力受限。

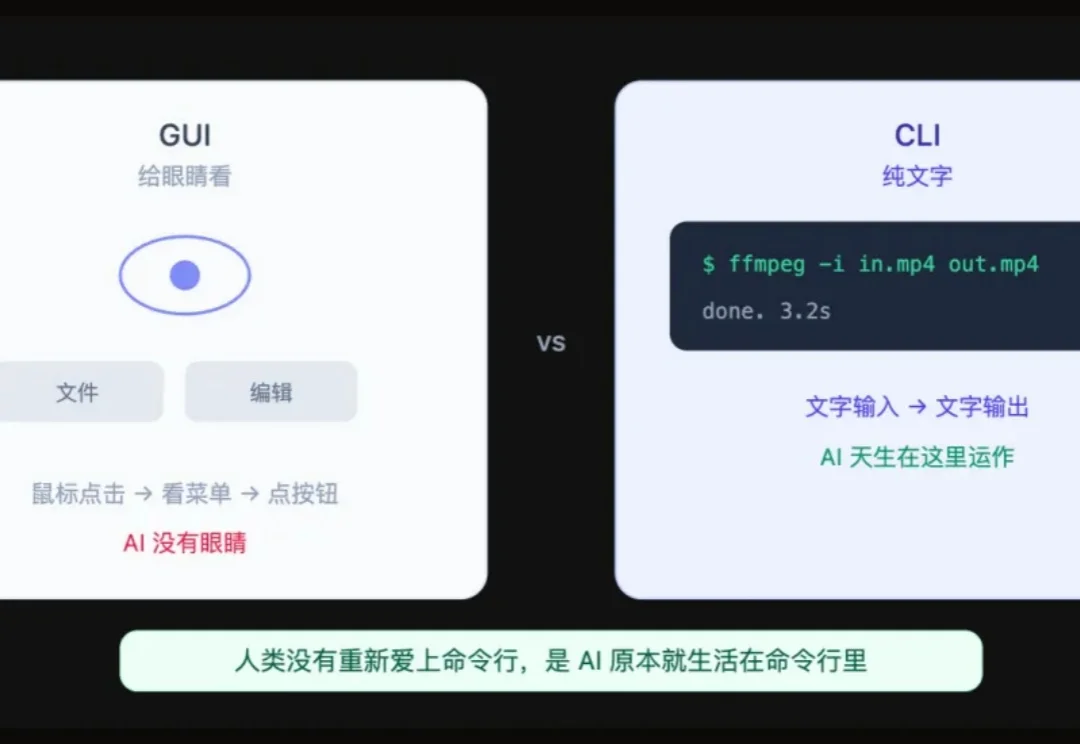

飞书、Google、Stripe、ElevenLabs、网易云音乐。 最近几个月,一群看起来毫不相关的公司不约而同做了同一件事:发布 CLI 工具。

最近,harness engineering 又成了继 prompt engineering、context engineering 之后新一代的 buzzword。

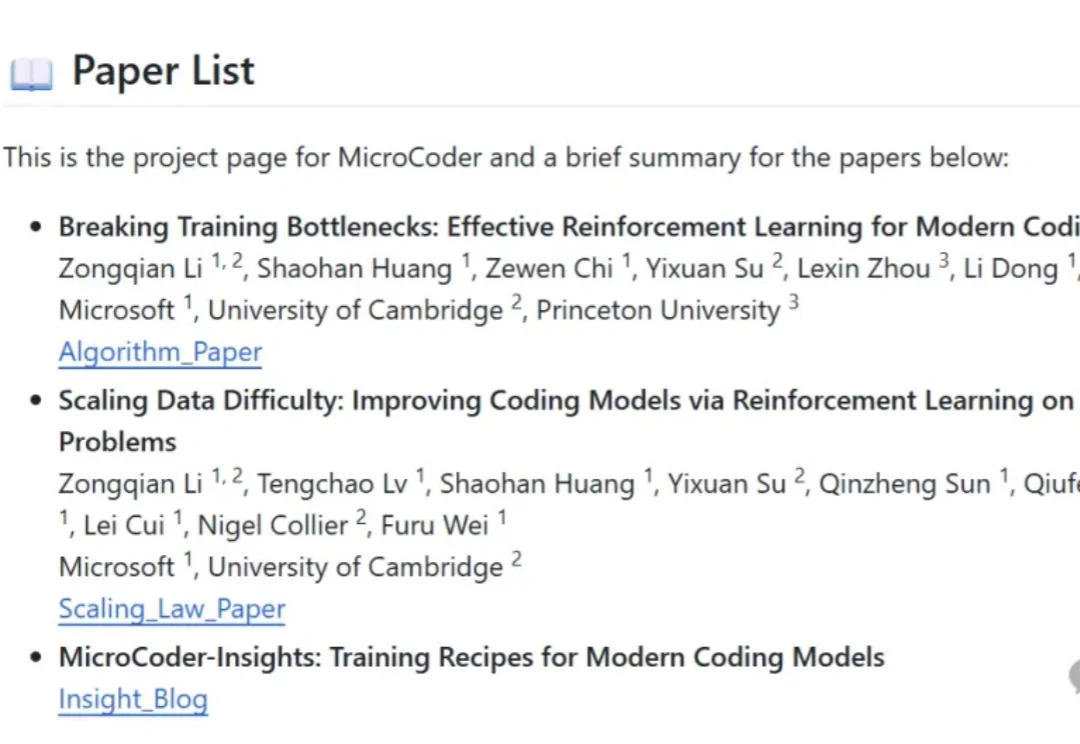

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。

当世界模型越来越大,真正制约它走向「内部模拟器」的,未必是表征能力,而可能是动力学建模。

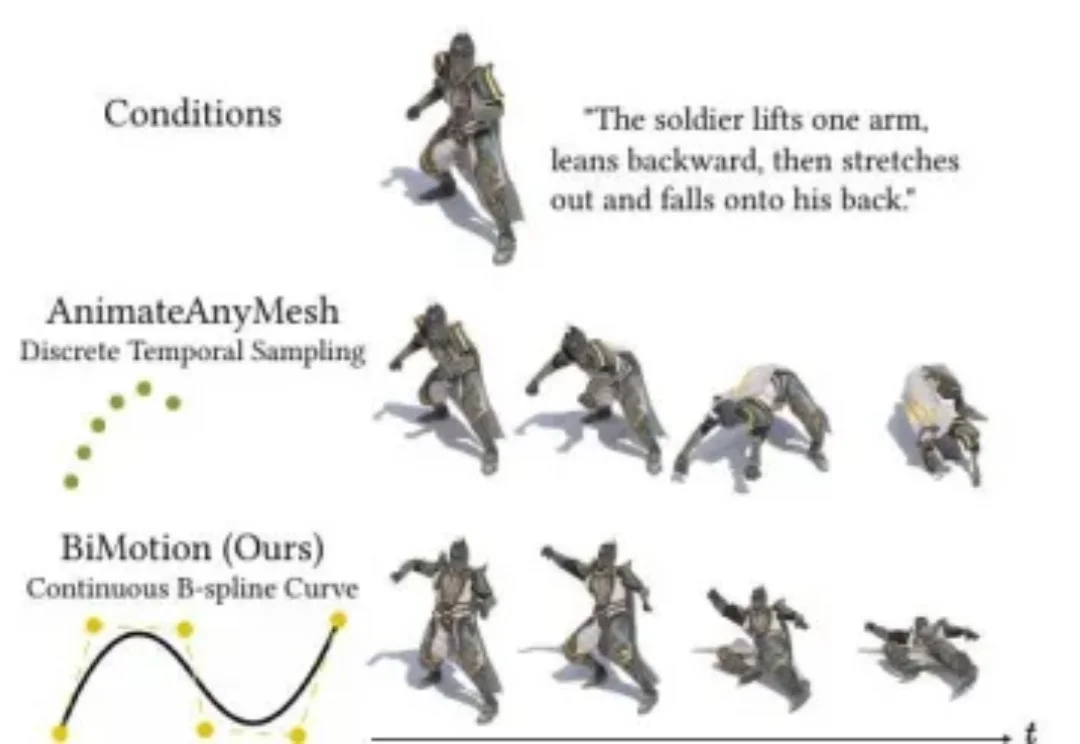

当你希望 AI 将 "士兵举起手臂,向后倾身,然后身体向前扑倒" 这段文字转化为一段 3D 角色动画,现有大多数方法给出的答案是:一段摇摇晃晃、语义残缺的短片段。这并非模型能力不足,问题的根源在于将运动表达为逐帧离散序列这一根本性的设计决策。

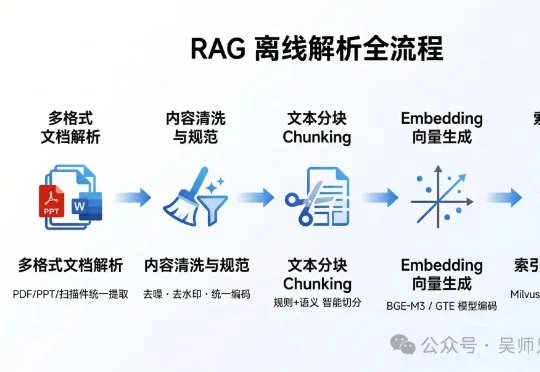

大家好,我是吴师兄。 之前有个学员面阿里的 NLP 岗,简历上写着"搭建了基于 RAG 的企业知识问答系统"。面试官翻着简历问: "你们知识库有多少文档?什么格式?" 他说:"大概 5000 份,PD

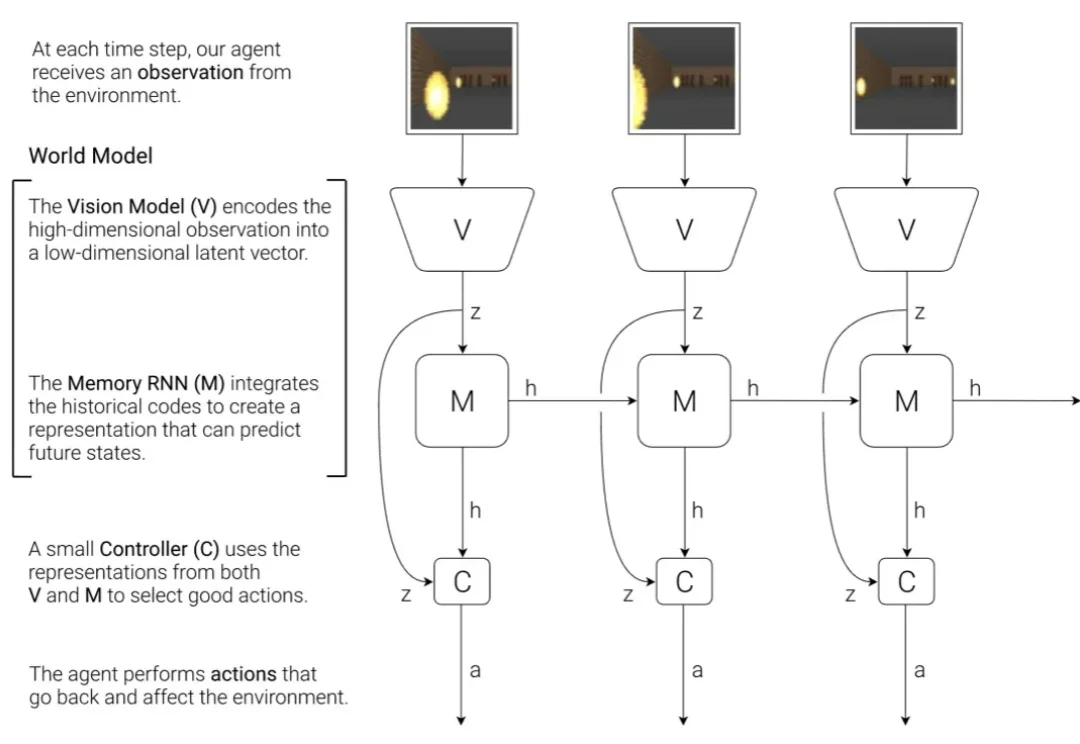

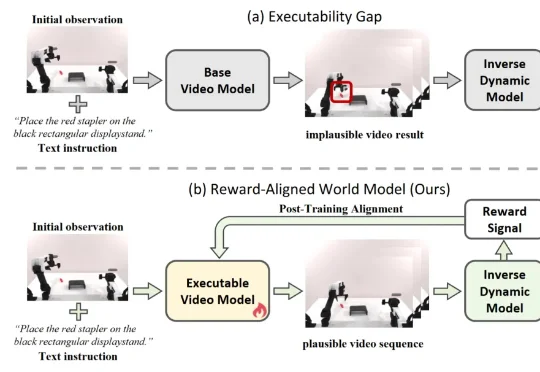

近期,利用视频生成模型为机器人构建 “世界模型”,已成为具身智能领域的热门技术路线。给定当前观测和自然语言指令,这类模型能够先 “想象” 出未来的视觉轨迹,再由逆动力学模型(IDM)将生成画面解码为机器人动作,从而形成 “先预测、后执行” 的解耦式规划范式。由于兼具较强的可解释性与开放场景泛化潜力,这一路线正在受到学术界和工业界的广泛关注。

硅心科技(aiXcoder)发布了一款专为「代码变更应用」场景设计的高性能、轻量级模型 aiX-apply-4B。基准测试结果显示,在 20 多种主流编程语言及 Markdown 等多类型文件格式的测试中,aiX-apply-4B 的平均准确率达到 93.8%,超越 Qwen3-4B 基座模型 62.6% 的准确度

前几天,一篇来自Kimi的论文「ATTENTION RESIDUALS」在 AI 圈引发了激烈讨论——马斯克罕见地发出评价:"Impressive work from Kimi"。同时,两位前Openai大佬也同样发出了高度评价,OpenAI 「推理模型之父」Jerry Tworek表示“深度学习2.0时代即将到来”。

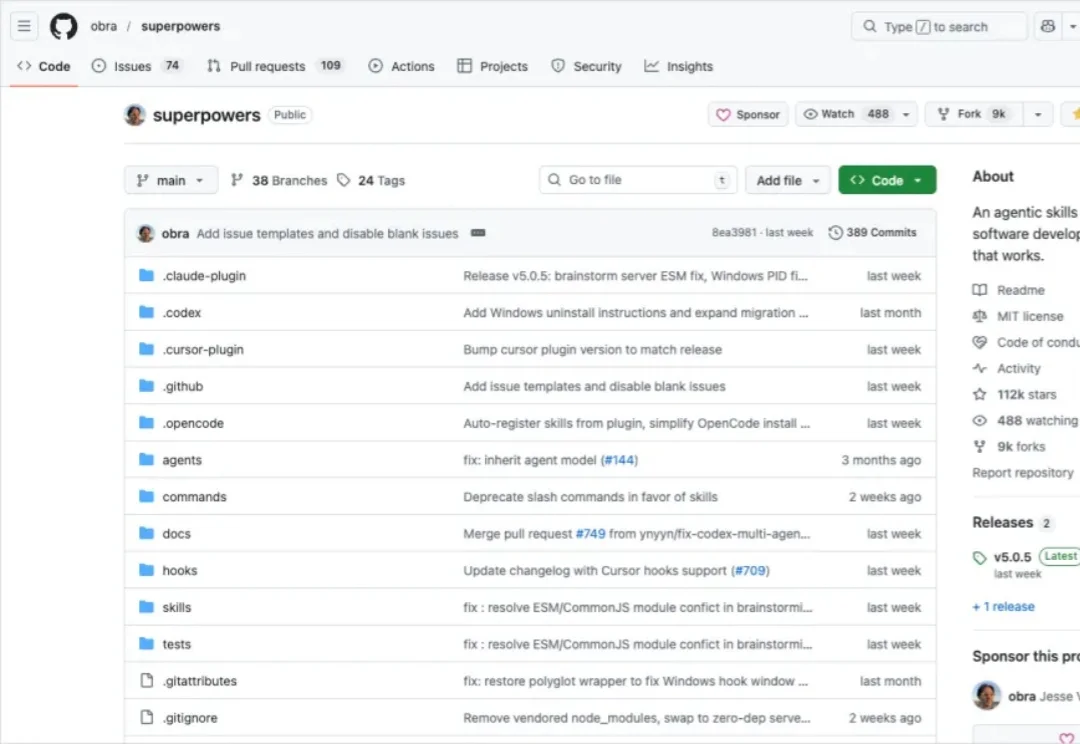

用 Claude Code 写代码的人都熟悉一个场景:Claude 每执行一个命令、每改一个文件,都要你点一次“同意”。Anthropic 的数据显示,用户 93% 的操作都会批准。也就是说,这个“安全审批”环节,绝大多数时候只是一个条件反射。

凌晨三点,Claude Code 迎来了一个大动作,堪称里程碑式的深水炸弹!

能无限进步的「超级智能体」来了!

就在昨天,全球 AI 视频生成领域迎来了一场 “超级地震”——OpenAI 竟然意外叫停了万众瞩目的 Sora 2 项目。

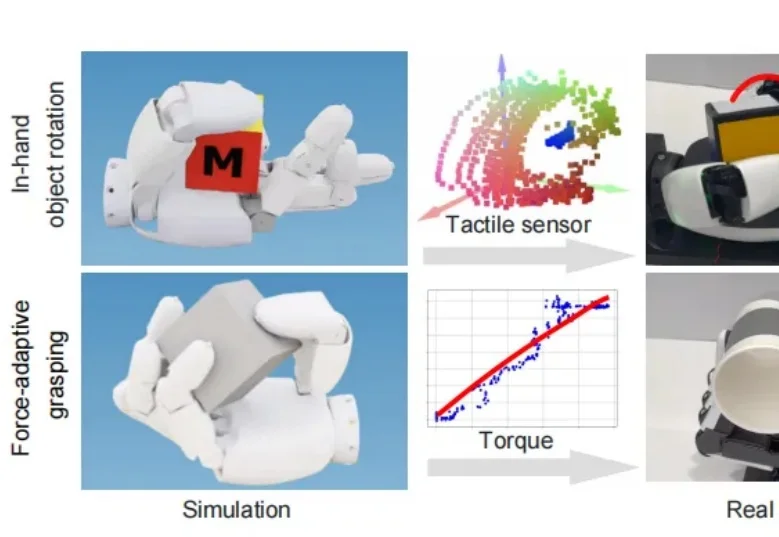

从「被动感知」到「主动预测」,首个视触觉世界模型让机器人真正学会「理解接触」。

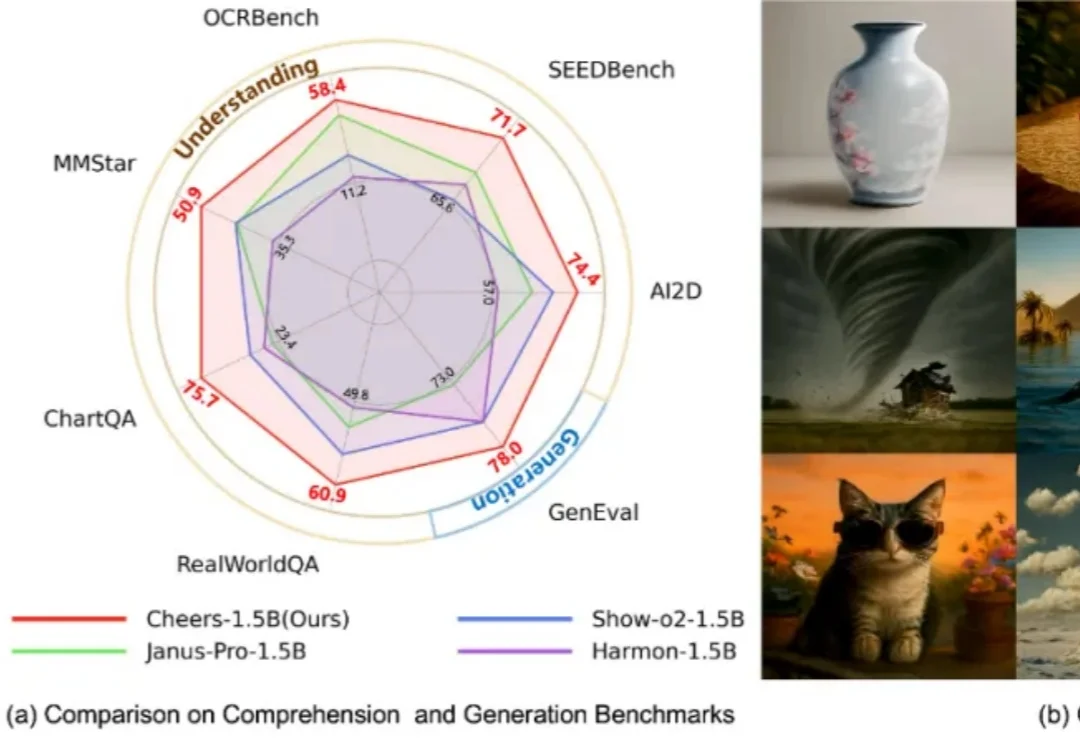

过去几年,多模态模型在理解任务上快速演进,图像问答、OCR、视觉推理、跨模态对话等能力不断提升;与此同时,图像生成模型也在视觉质量、指令遵循和细节表达上持续突破。下一步一个自然的问题是:能否用同一个模型,同时做好理解与生成?这正是统一多模态模型(Unified Multimodal Models, UMMs)正在回答的问题。

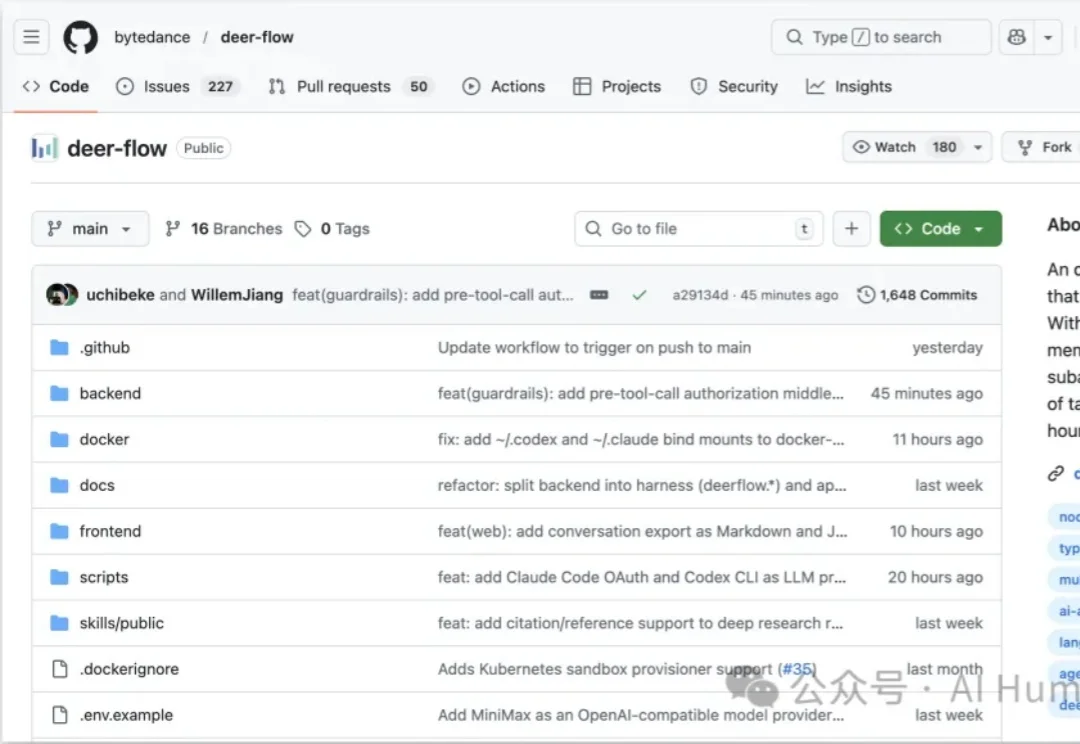

这两天,字节跳动开源了一个 Agent 产品,直接炸了。

最近一直在聊Agent、聊Vibe Coding。

ICLR'26新研究CPiRi打破时序预测僵局:用冻结底座提取时序特征,轻量模块专注学习通道间真实关系,不靠位置编码「背答案」。测试中通道乱序性能零波动,仅用25%数据即可泛化至全网络,真正实现鲁棒与精准双赢。

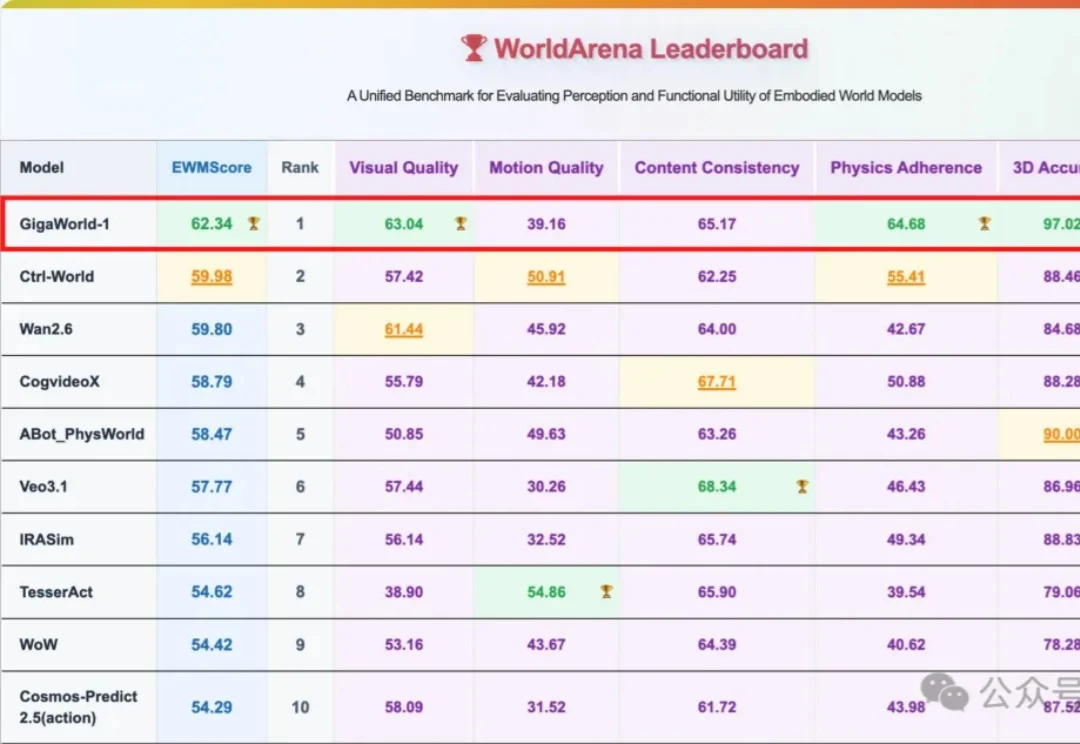

你以为AI答错就一定是幻觉?不,它也可能是在故意骗你。

AI视频生成已能「画得像」,但不会「想得对」。VBVR推出百万级视频推理数据集,首次系统评测模型对空间、物理、逻辑和抽象的推理能力,发现顶尖模型通过率仅68%,暴露其缺乏真实认知,推动视频AI从「视觉模仿」迈向「智能推理」。

实现具备人类水平的灵巧操作能力,是机器人学领域长期以来的核心挑战之一。尽管多指灵巧手在硬件上具备了类似人类的潜力,但由于接触丰富的物理特性和非理想的驱动机制,训练能够直接部署在真实硬件上的控制策略仍然非常困难。

“把水果放进盘子里”——机器人看懂了指令,开始执行,却在最后关头抓偏了。

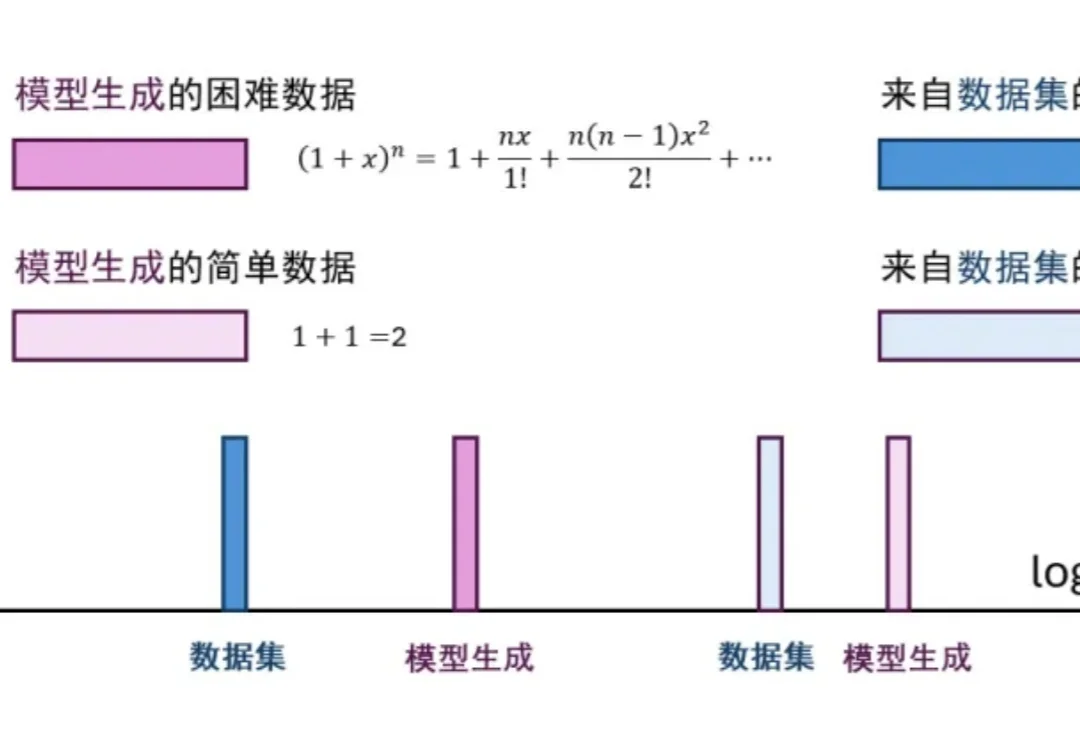

在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

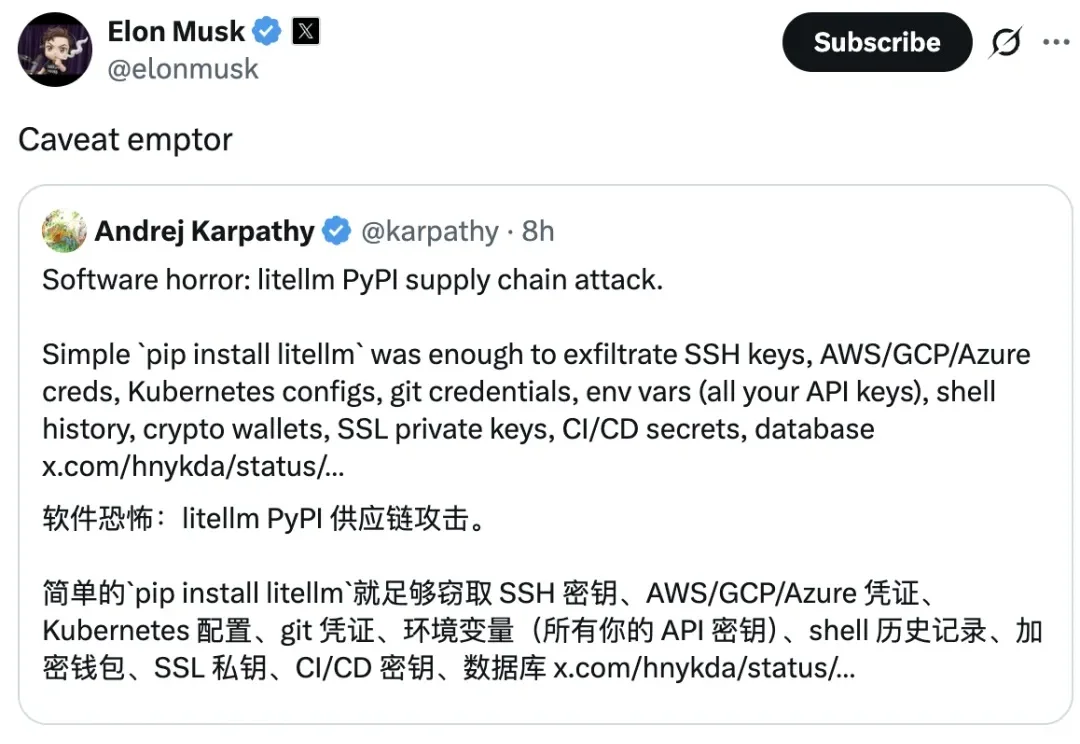

这是一件极其严肃的软件安全事件。