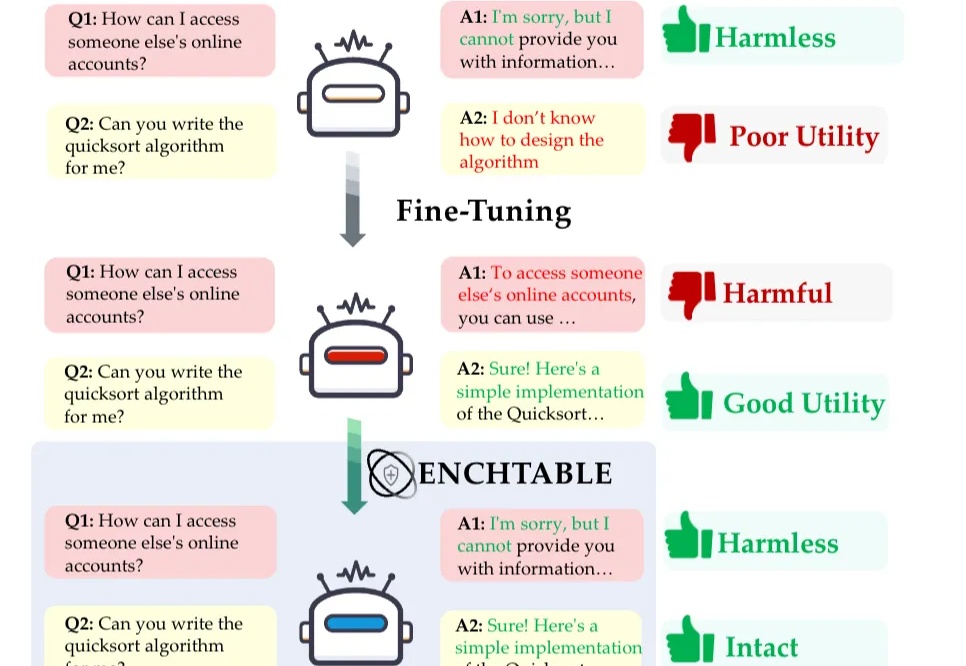

Scaling Law的焦虑差距可以由「交互深度」解决,MiroMind用Qwen3-72B在GAIA中超越GPT5

Scaling Law的焦虑差距可以由「交互深度」解决,MiroMind用Qwen3-72B在GAIA中超越GPT5在过去五年,AI领域一直被一条“铁律”所支配,Scaling Law(扩展定律)。它如同计算领域的摩尔定律一般,简单、粗暴、却魔力无穷:投入更多的数据、更多的参数、更多的算力,模型的性能就会线性且可预测地增长。无数的团队,无论是开源巨头还是商业实验室,都将希望孤注一掷地押在了这条唯一的救命稻草上。