国产最强多模态宝座又易主?671B参数练就“火眼金睛”,基于DeepSeek打造

国产最强多模态宝座又易主?671B参数练就“火眼金睛”,基于DeepSeek打造智东西11月28日报道,刚刚,快手开源其新一代旗舰多模态大模型Keye-VL-671B-A37B。该模型基于DeepSeek-V3-Terminus打造,拥有6710亿个参数,在保持基础模型通用能力的前提下,对视觉感知、跨模态对齐与复杂推理链路进行了升级,实现了较强的多模态理解和复杂推理能力。

智东西11月28日报道,刚刚,快手开源其新一代旗舰多模态大模型Keye-VL-671B-A37B。该模型基于DeepSeek-V3-Terminus打造,拥有6710亿个参数,在保持基础模型通用能力的前提下,对视觉感知、跨模态对齐与复杂推理链路进行了升级,实现了较强的多模态理解和复杂推理能力。

REG 是一种简单而有效的方法,仅通过引入一个 class token 便能大幅加速生成模型的训练收敛。其将基础视觉模型(如 DINOv2)的 class token 与 latent 在空间维度拼接后共同加噪训练,从而显著提升 Diffusion 的收敛速度与性能上限。在 ImageNet 256×256 上,

腾讯混元大模型团队正式发布并开源HunyuanOCR模型!这是一款商业级、开源且轻量(1B参数)的OCR专用视觉语言模型,模型采用原生ViT和轻量LLM结合的架构。目前,该模型在抱抱脸(Hugging Face)趋势榜排名前四,GitHub标星超过700,并在Day 0被vllm官方团队接入。

终于有人要给大模型安“脖子”了!

马斯克主动为Grok 5戴上「纯视觉感知」与「拟人延迟」的双重镣铐,彻底告别API读数据与暴力手速的作弊时代,向传奇战队T1发起挑战。这是一场终极图灵测试,AI不再靠微操碾压,而是像人类一样通过「看」屏幕理解像素、依靠阅读战术与其后的逻辑推理来博弈。

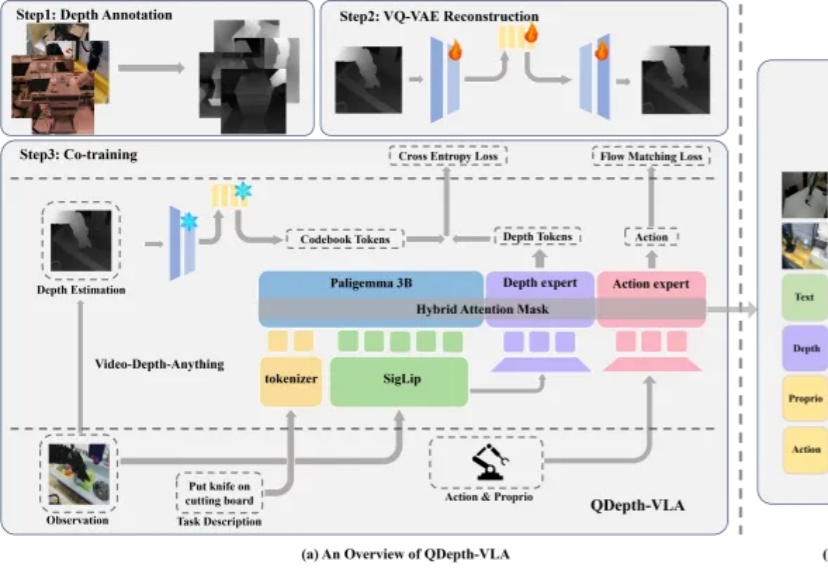

视觉-语言-动作模型(VLA)在机器人操控领域展现出巨大潜力。通过赋予预训练视觉-语言模型(VLM)动作生成能力,机器人能够理解自然语言指令并在多样化场景中展现出强大的泛化能力。然而,这类模型在应对长时序或精细操作任务时,仍然存在性能下降的现象。

今天凌晨,“硅谷钢铁侠”马斯克宣战了!他在 X 帖子中提出了一项引来1500多万网友围观的挑战:让Grok 5在2026年以人类视觉和反应速度限制下,对战《英雄联盟》顶级人类战队。

Black Forest Labs的开源视觉模型FLUX.2上新,这是一款专为现实创意工作流程打造,绝非演示噱头的生产力工具,与前代FLUX.1相比,实现了从「会画」到「懂你要画什么」的跃升。

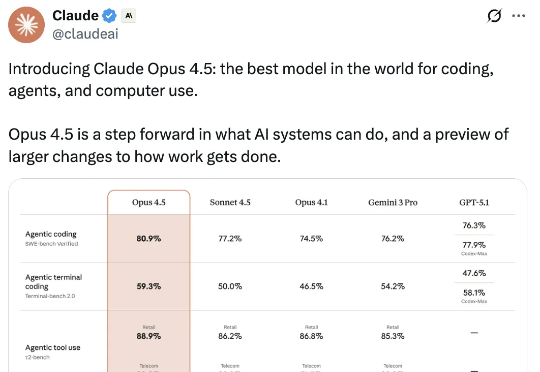

刚刚,Claude Opus 4.5问世,主打编码、Agent与computer use。Opus 4.5在前端开发、视觉能力上显著提升,更擅长使用电脑。在深度研究、PPT制作与电子表格处理等日常任务方面的表现也全面升级。

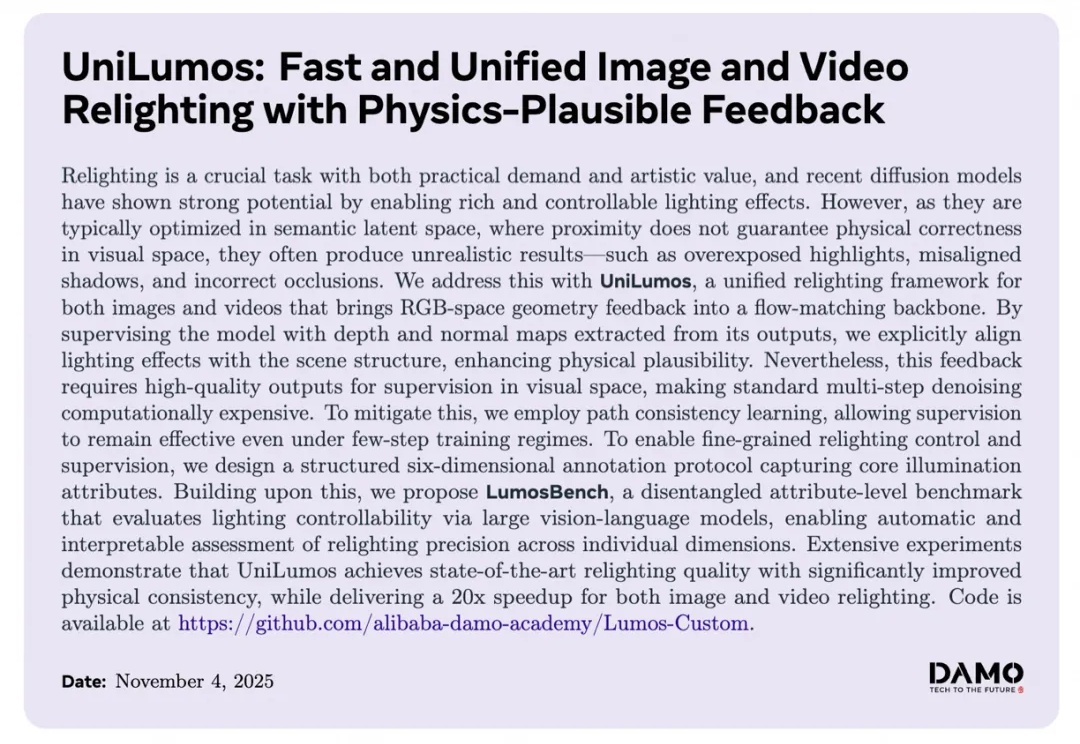

图像与视频重光照(Relighting)技术在计算机视觉与图形学中备受关注,尤其在电影、游戏及增强现实等领域应用广泛。当前,基于扩散模型的方法能够生成多样且可控的光照效果,但其优化过程通常依赖于语义空间,而语义上的相似性无法保证视觉空间中的物理合理性,导致生成结果常出现高光过曝、阴影错位、遮挡关系错误等不合理现象。