Sand.ai开源发布MagiCompiler:突破局部编译界限,定义训推性能上限

Sand.ai开源发布MagiCompiler:突破局部编译界限,定义训推性能上限大模型开发者常面临一个两难选择:要速度,还是省显存?

搜索

搜索

大模型开发者常面临一个两难选择:要速度,还是省显存?

到2025年末,AI编程已经全面从辅助工具Copilot,转向以AI为主、人类监督的Agent时代。

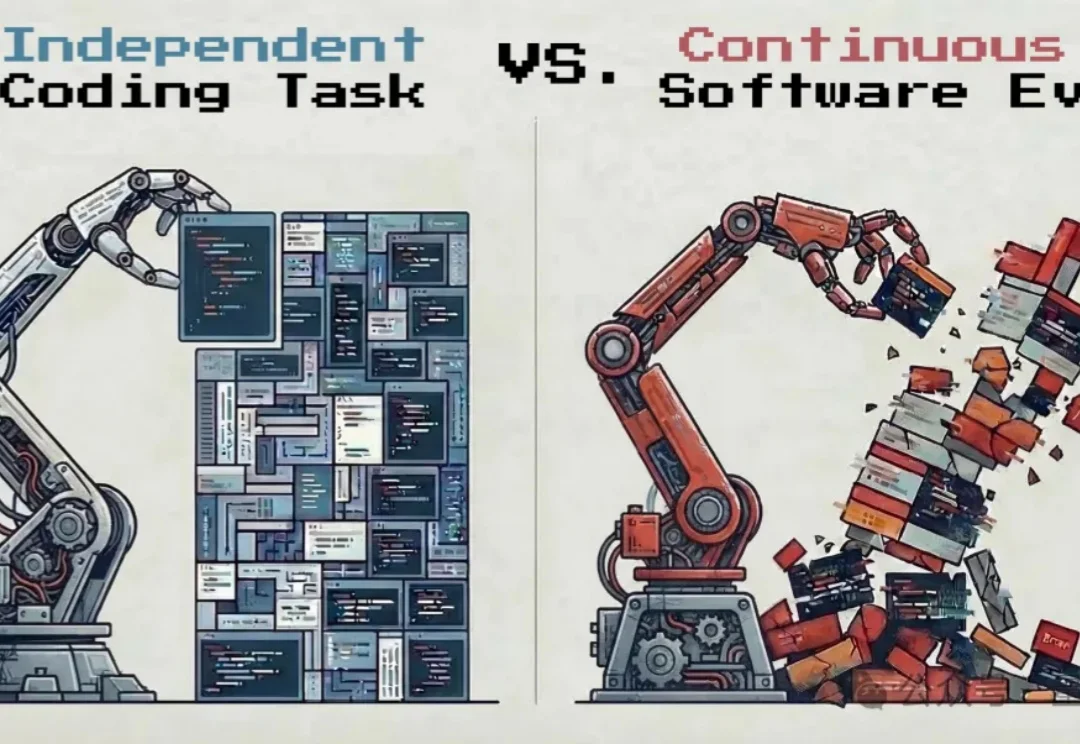

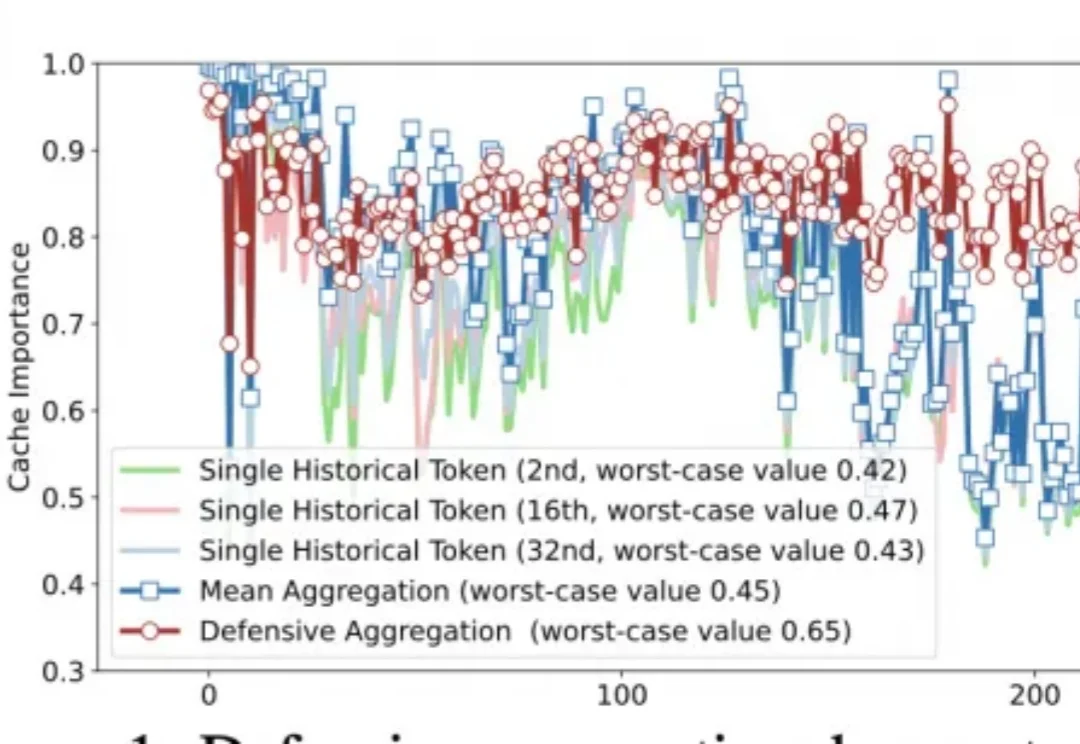

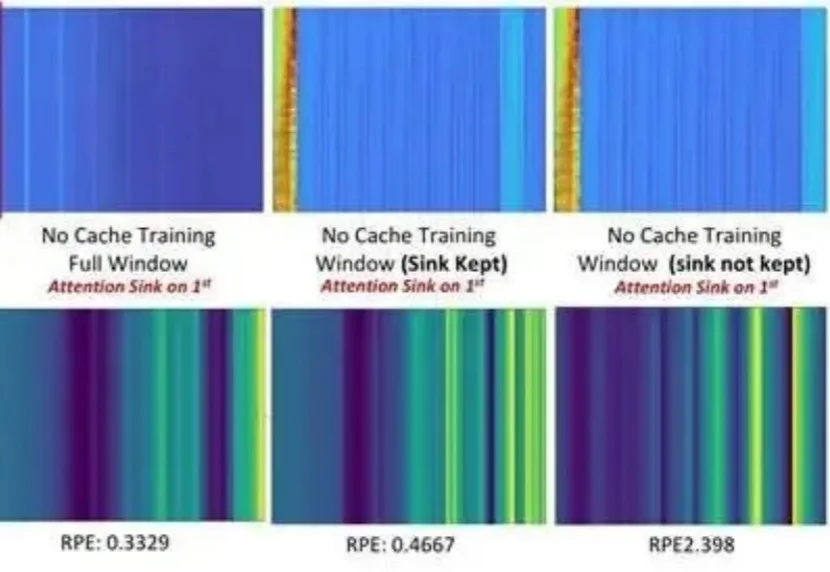

随着大模型长上下文能力快速增长,海量 KV Cache 存储需求急剧增加,各类 KV Cache 压缩方法如雨后春笋般涌现。然而,这些方案在真实场景中的工程落地却常常陷入困境。

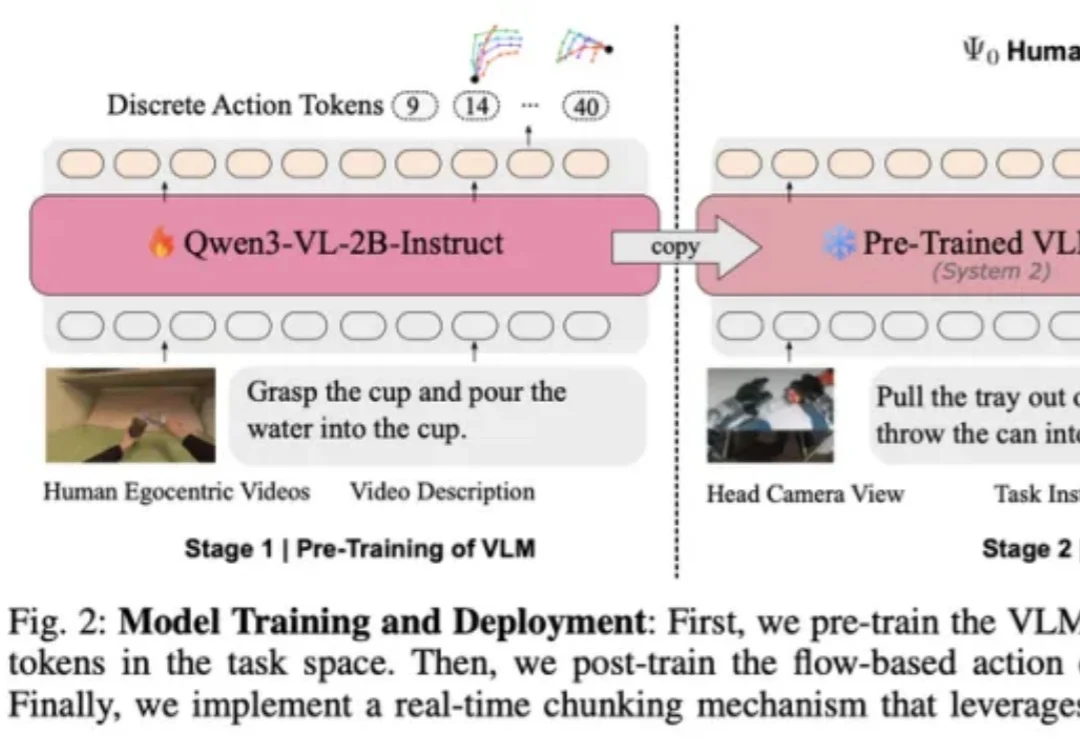

人形机器人在春晚舞台上大放异彩!然而,人们在看惯了机器人跳舞、后空翻,乃至武术表演之后,不禁开始思考:机器人何时才能真正走进大众生活,解决日常生活中的琐碎任务,从而解放人类的双手?

养了这么久的虾,你应该能发现,skills有多重要了。

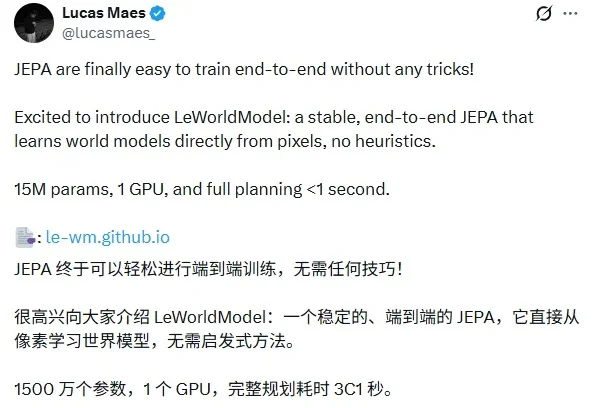

近期,围绕「世界模型」这一方向,有两项工作受到较多关注。

LeCun世界模型最新进展,开源了一套极简训练方案,单GPU就能跑。

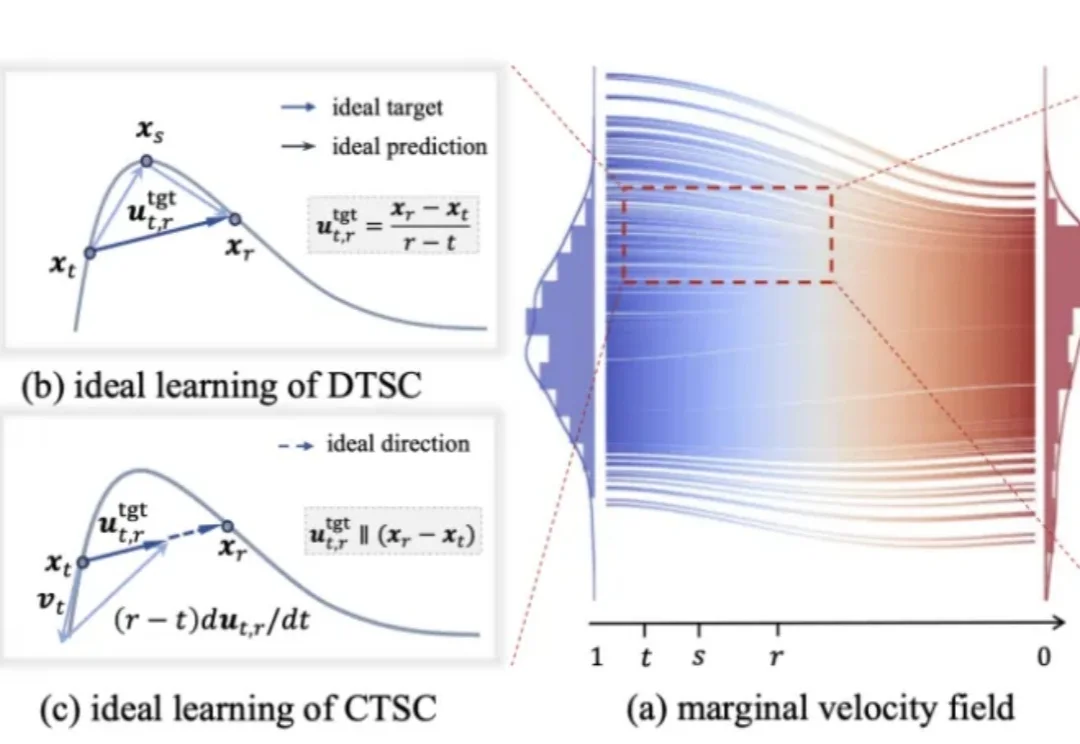

近期,基于捷径化概率流路径(shortcut probability flow trajectory)并从头训练的一步扩散生成模型,展现出强大的实证有效性。然而,这类方法的提出通常建立在较为复杂的理论推导之上,并且往往与具体实现细节高度耦合。这带来一个直接的问题:究竟哪些设计是方法成立的本质要素,哪些又只是可以灵活替换的实现组件。

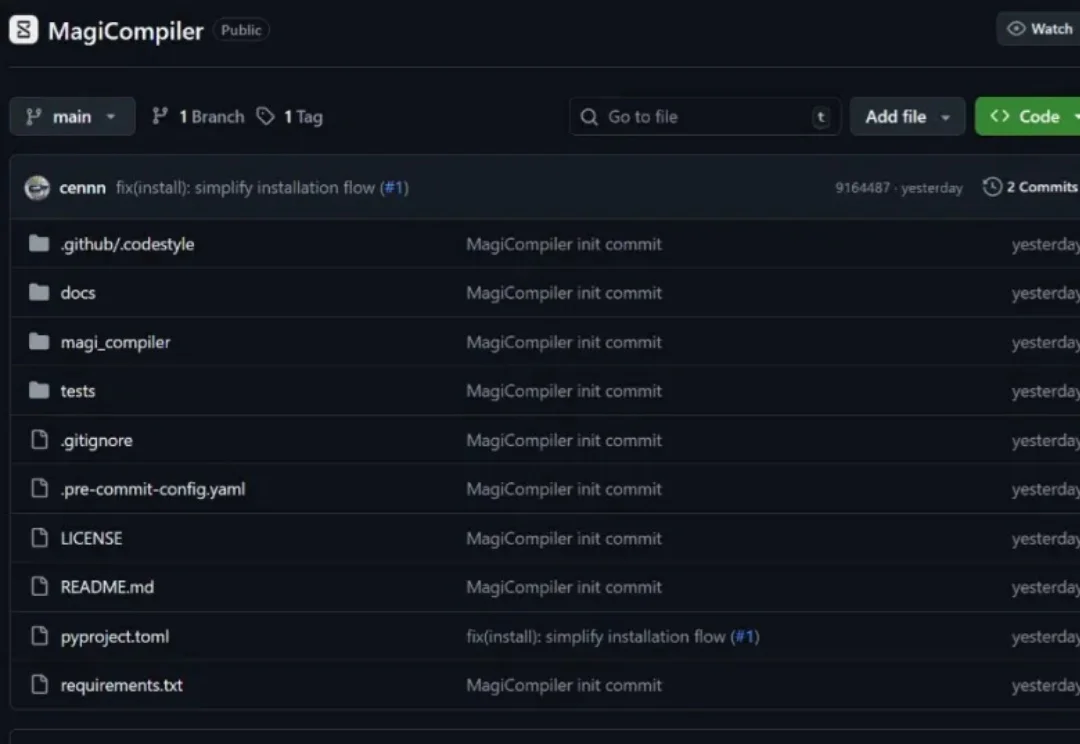

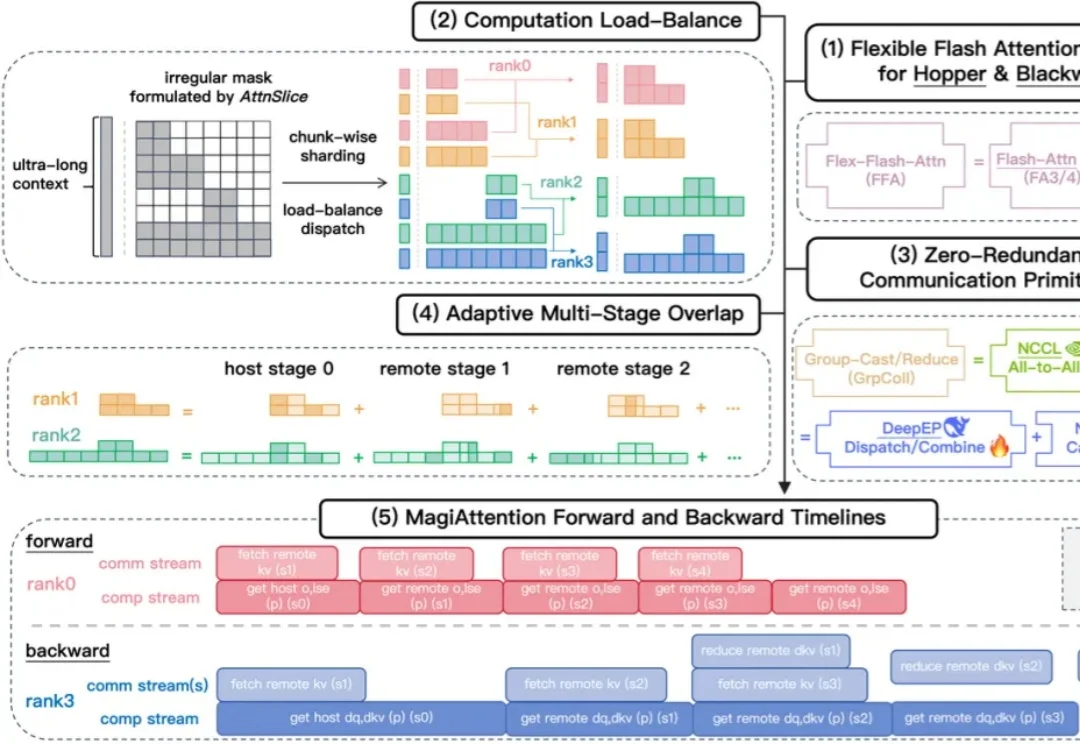

2025 年 4 月,Sand.ai 开源了 MagiAttention v1.0.0,定义了下一代分布式 Attention 的全新设计和系统框架。历经一年的深耕,今天 Sand.ai 正式发布:MagiAttention v1.1.0,以更成熟的原生算子组件,重新定义 Hopper 与 Blackwell 两代架构分布式 Attention 的性能上限。

我们在很多地方都看到了一个词,叫「压缩即智能」

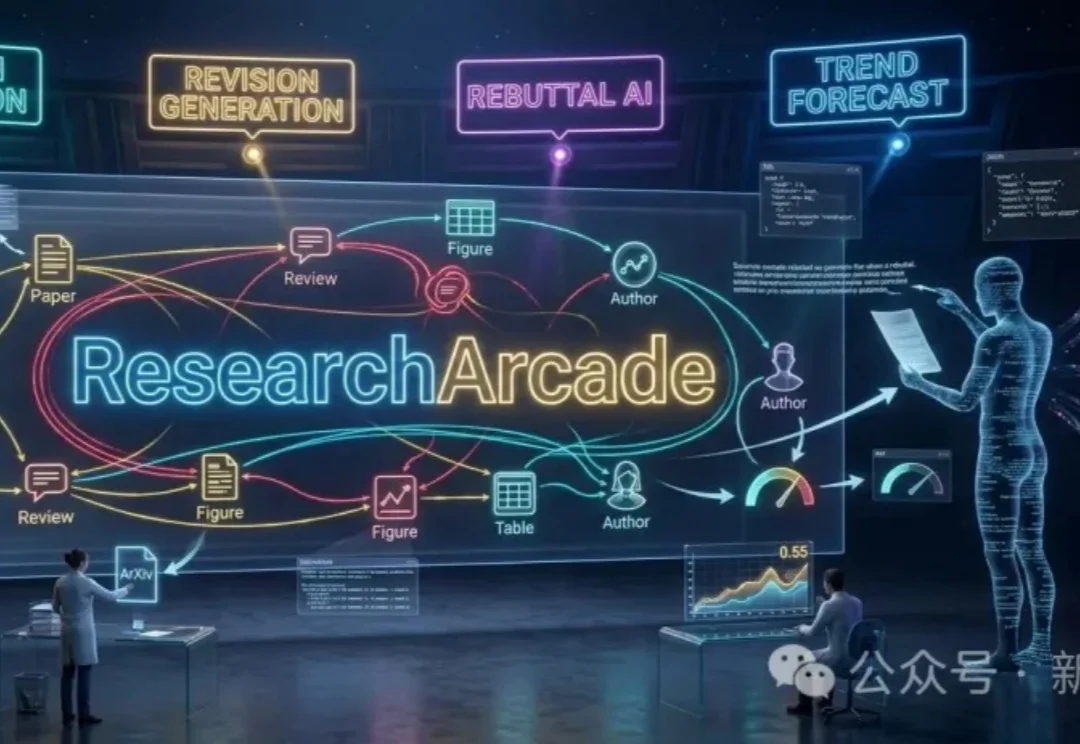

UIUC研究团队打造ResearchArcade,将ArXiv论文、OpenReview评审、图表代码等碎片数据连接成动态知识图谱。模型可直接学习引用关系、修改轨迹与审稿互动,让AI更好辅助科研写作、修订与预测,为下一代科研智能体奠定统一数据基础。

在自动驾驶、具身智能、AR/VR应用中做3D重建,大家都想解决一个终极问题: 模型能不能像人一样,一边往前看,一边持续构建三维世界?

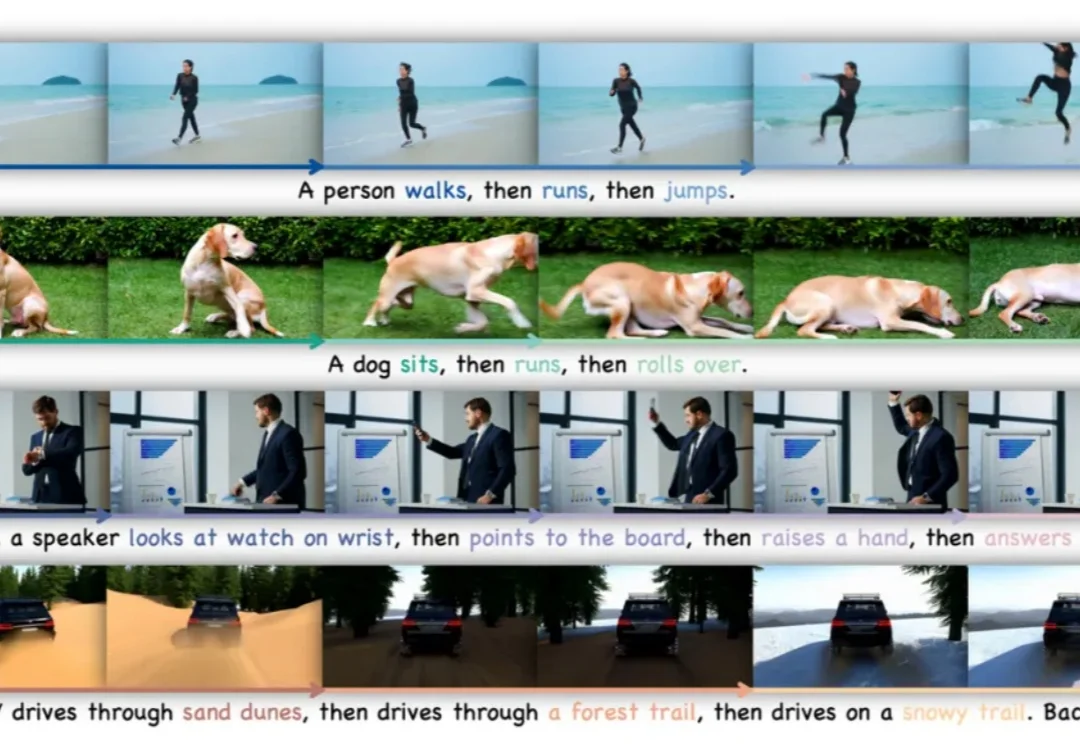

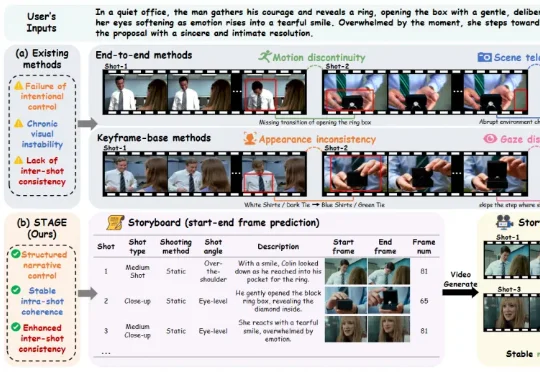

近年来,随着 Sora、Seedance 等文本到视频(T2V)扩散模型的飞速发展,AI 视频生成在视觉保真度与动态表现上已取得突破性进展。特别是近期备受瞩目的 Seedance 2.0,展现出了极其强大的多镜头叙事与复杂分镜控制能力。

AI终于有了「永久记忆」!今天,超级记忆系统ASMR重磅登场,在业界公认最难AI记忆考试中,刷爆SOTA拿下99%成绩。全网直呼太疯狂。

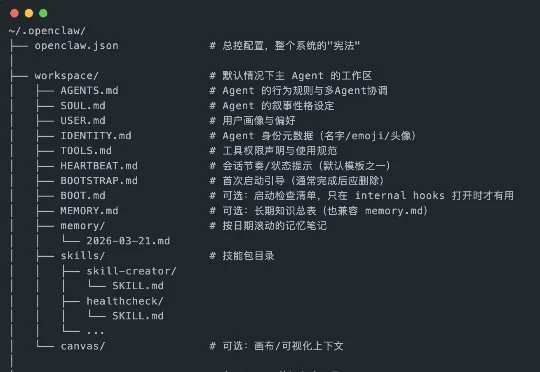

安装完 OpenClaw 的那个晚上,我做的第一件事是这样的: 打开 ClawHub,看到几万个 Skill 整整齐齐排列在那里,于是我一个接一个地给我的小龙虾装...

您用OpenClaw或CC时有没有这样的感受?Skill越装越多,Agent解决问题的能力却没有越变越强。

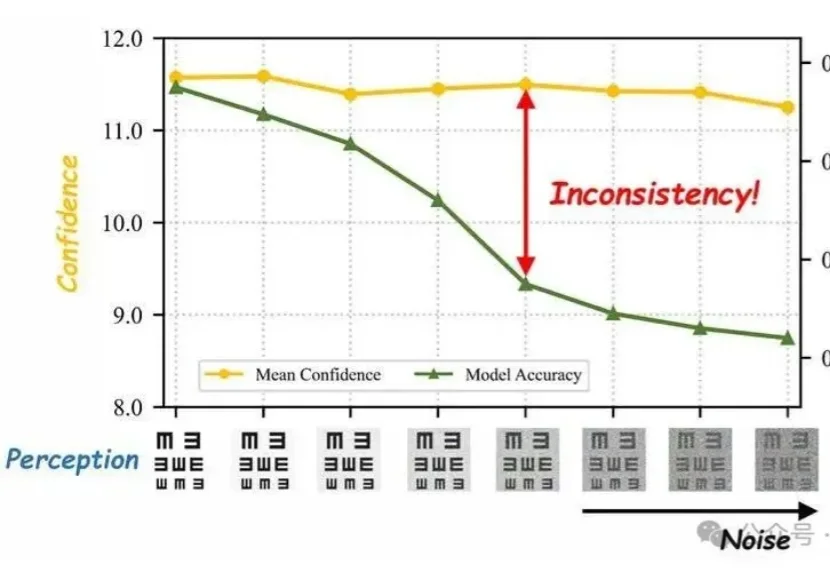

AI最强幻觉,原来不是不会,而是太会「装会」。 「你是专家」这句咒语,可能骗了整个AI圈一年。

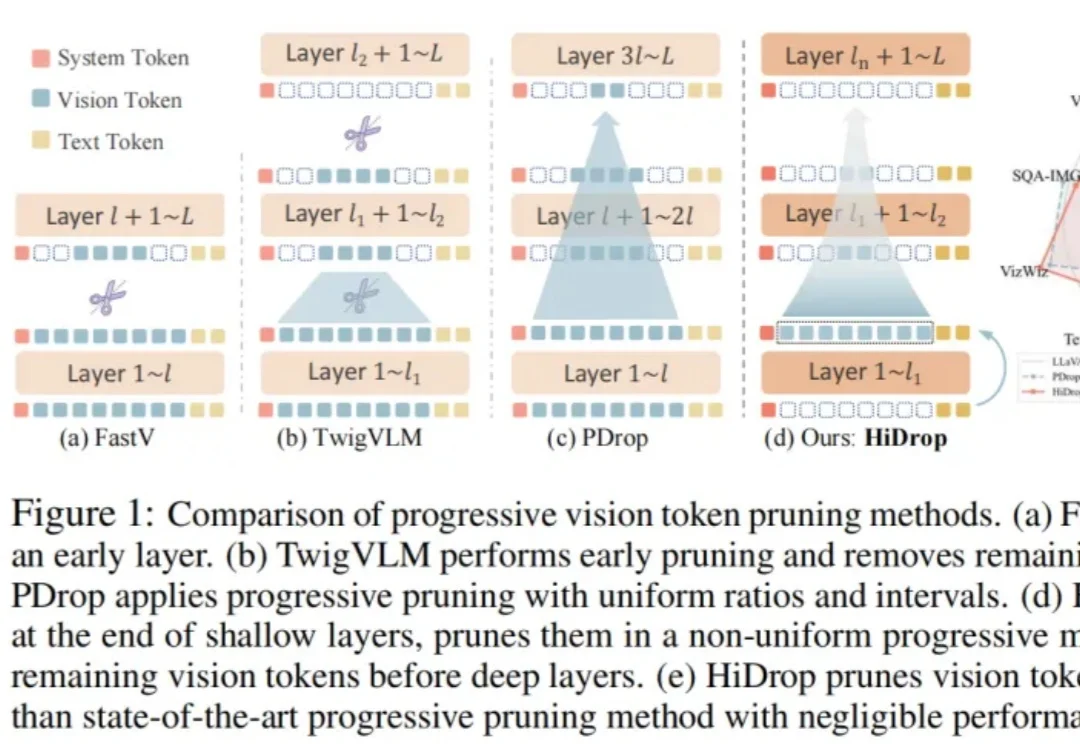

随着多模态大语言模型(MLLM)支持更长上下文,高分辨率图像和长视频会产生远多于文本的视觉 Token,在自注意力二次复杂度下迅速成为效率瓶颈。

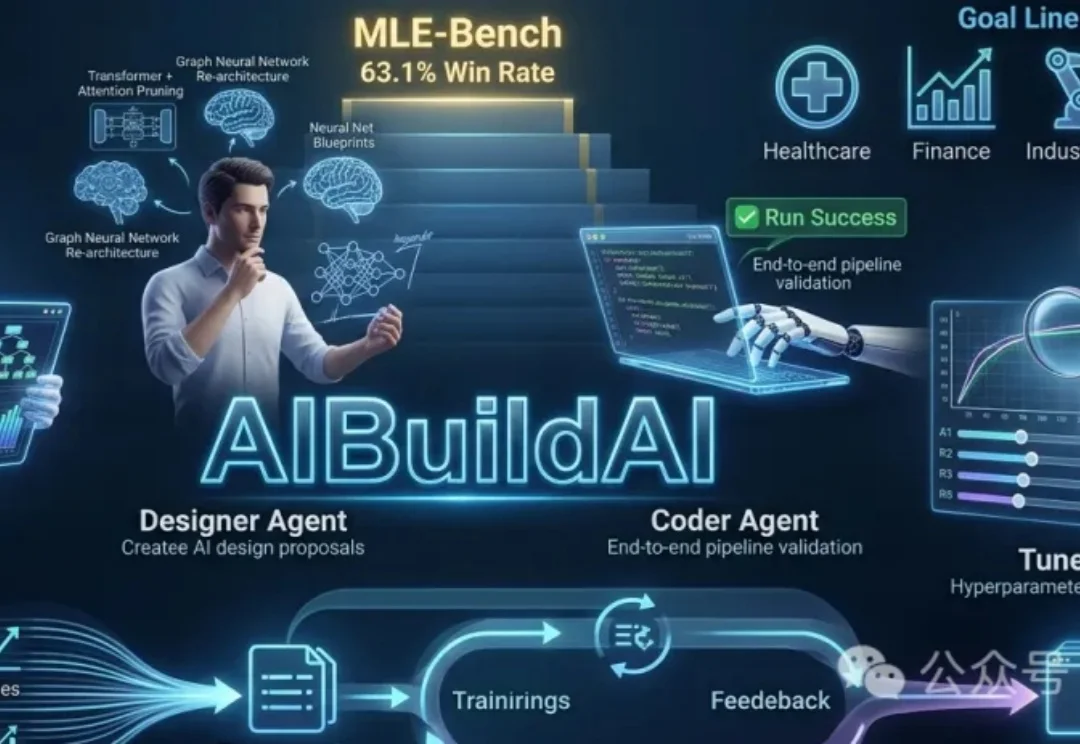

UCSD团队推出AIBuildAI智能体,无需编程,仅用自然语言描述任务,即可自动设计、编码、训练、调参并优化AI模型,分工协作,端到端完成AI开发。在OpenAI MLE-Bench测试中,AIBuildAI以63.1%的获奖率位居第一,性能媲美人类专家,推动AI开发迈向全自动化新时代。

这个 Skill,能让你的 Agent 联网能力提升到最离谱的一集。

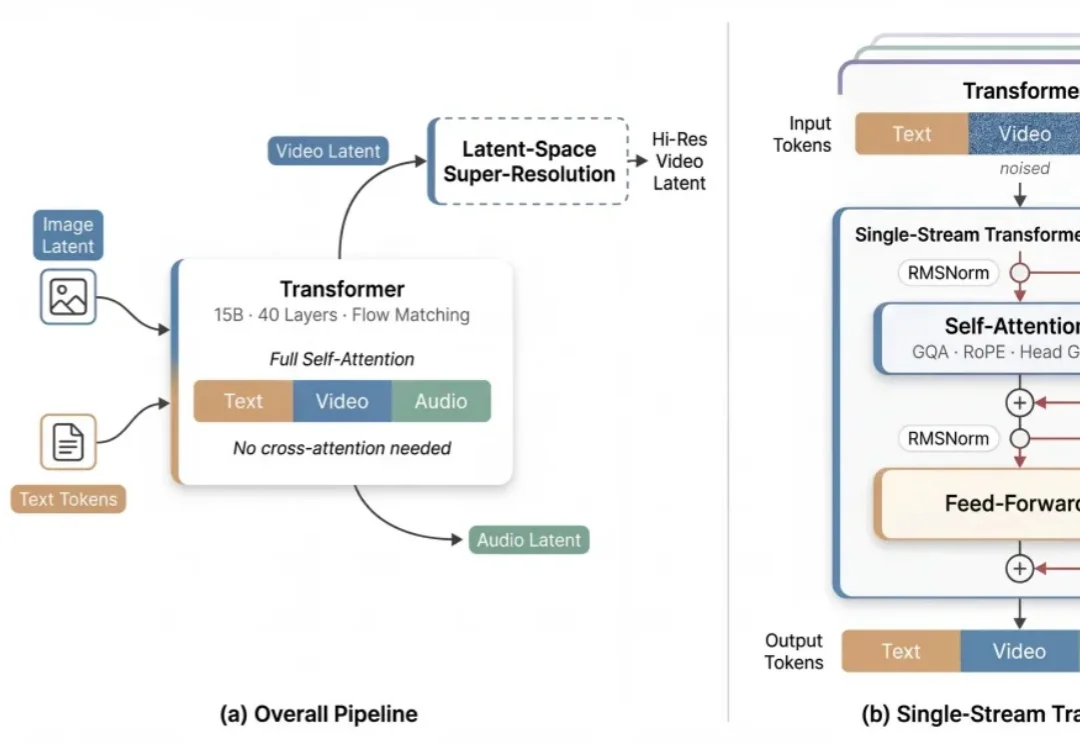

开源多模态生成领域,迎来架构级的底层突破。

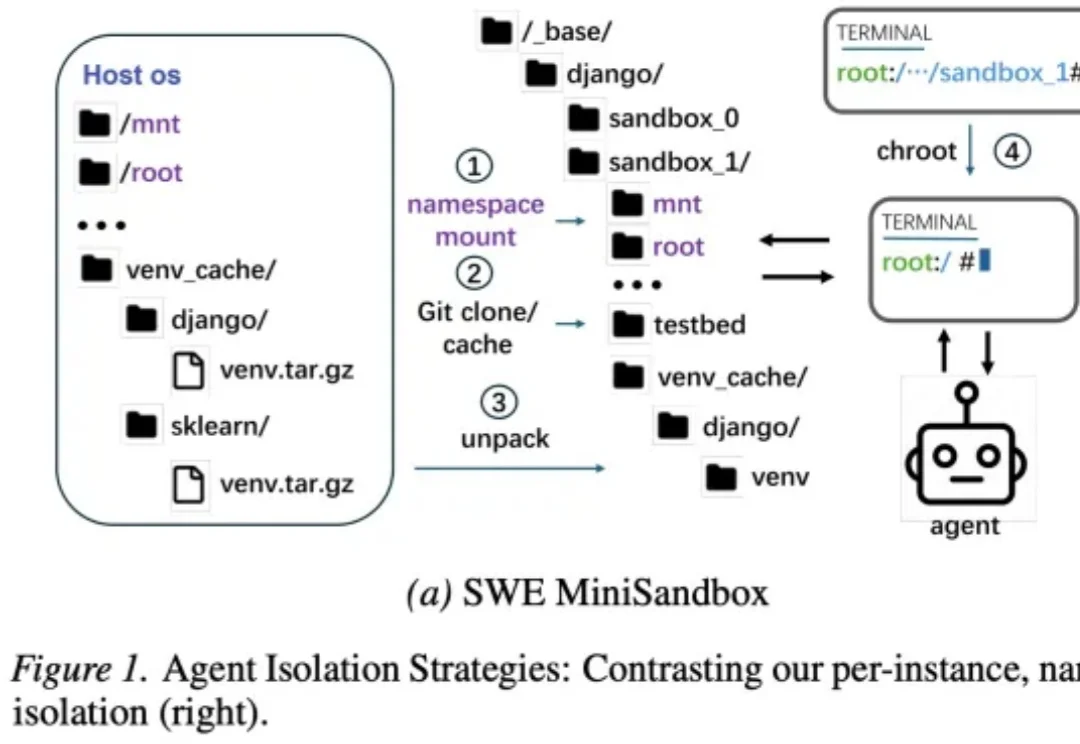

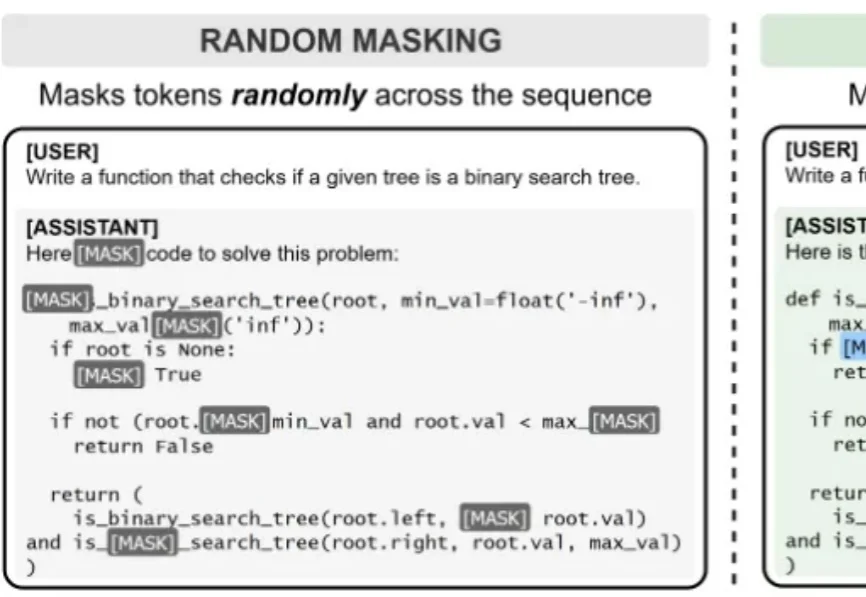

AI 编程这么火,想训练个 SWE Agent 却没有资源怎么办?

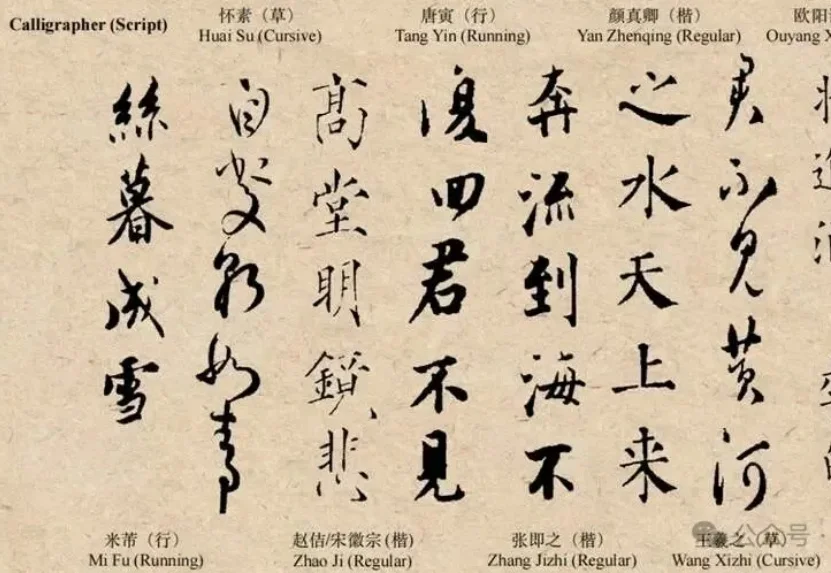

苦于AI单字拼凑没行气,或是排版秒变“鬼画符”?

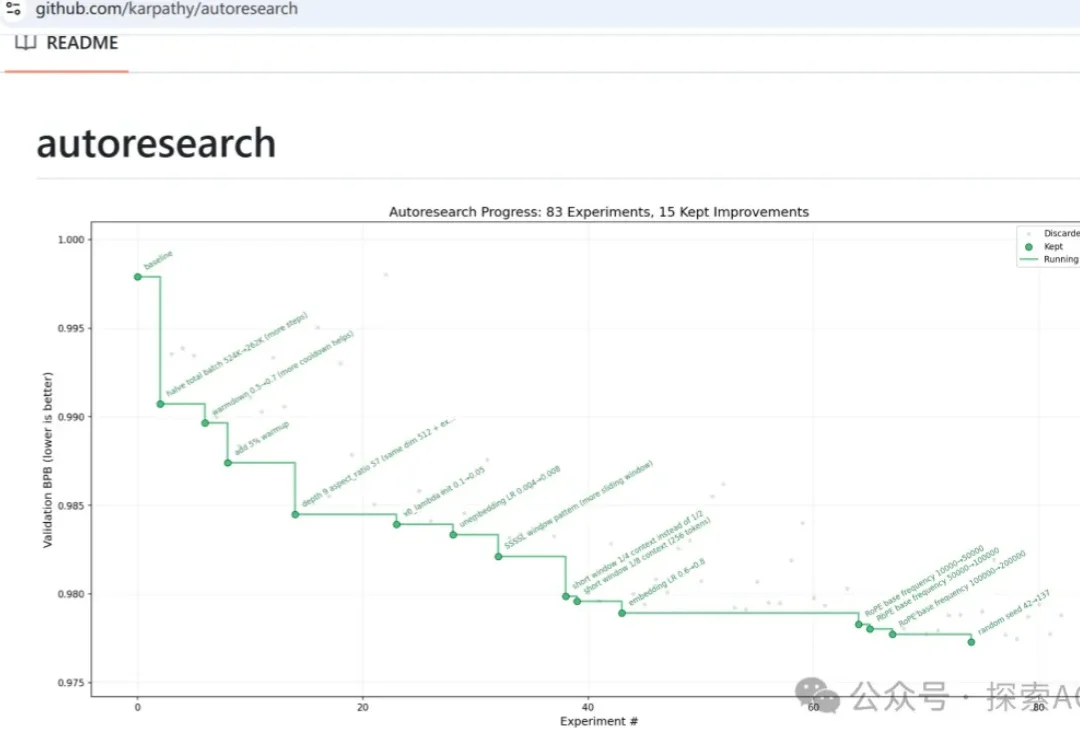

AI 驱动的自动化科研正从概念走向真实系统。近期受到广泛关注的 FARS,以及 Karpathy 开源的 autoresearch,都在不同程度上展示了 AI Scientist 自动进行 AI 领域研究的可行性。

在 AIGC 领域,基于参考图像的图像修复(Reference-based Inpainting)一直是一项备受关注的核心任务,它旨在利用参考图像引导修复过程,生成视觉一致的内容。这一技术在广告营销和电商领域有着巨大的应用潜力,例如让 AI 自动生成 “真人手持或穿戴商品” 的展示图。

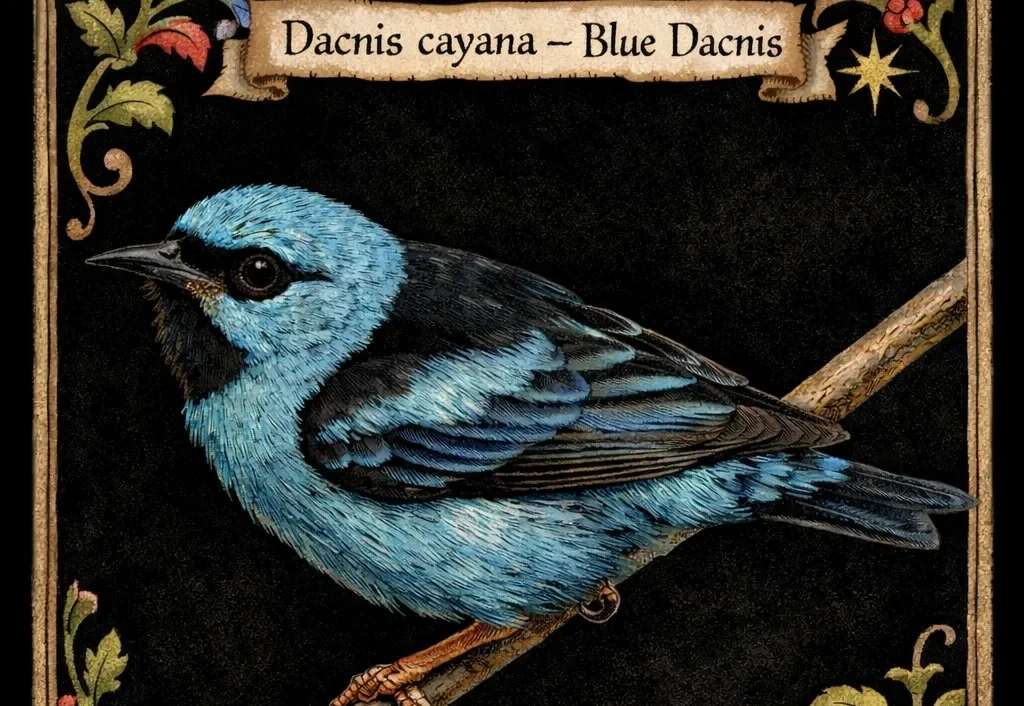

一张蓝锥嘴雀的图片,你能认出它是“鸟”,但能认出它是“鸟纲-雀形目-唐纳雀科-锥嘴雀属-蓝锥嘴雀”吗?

这两年,扩散语言模型(Diffusion LLM)一直是个很有讨论度的方向。

多模态大模型,到底有多“嘴硬”? 浙江大学联合阿里巴巴、香港城市大

一边的人,每次跟 Agent 说话都像重新 onboarding:得再讲一遍背景、偏好和上下文。另一边的人,Agent 已经知道自己是谁、该怎么说话、用户讨厌什么,也记得上次积累下来的东西。这条分界线,叫 workspace。

目前,该论文已录用至 CVPR 2026,相关数据集和模型训练训练和推理代码将逐步开源:究其原因,一个好故事并非一堆漂亮镜头的简单拼接,而是一个有结构、有逻辑的叙事整体。